Big Model Data Assistant

? Introdução ao projeto

Um projeto de aplicativo em larga escala de desenvolvimento leve, de link completo e fáceis de secundário

Um projeto de desenvolvimento de aplicativos de grande modelo único, construído em tecnologias como DIFY, OLLAMA & VLLM, SANIC e TEXT2SQL, usando VUE3, TypeScript e Vite 5 para criar uma interface do usuário moderna. Ele suporta respostas de dados gráficos com base em modelos grandes por meio de Echarts?, E tem a capacidade de processar perguntas e respostas da tabela de arquivos CSV. Ao mesmo tempo, pode ser conveniente conectar-se a sistemas de recuperação de sistemas de pano de código aberto de terceiros, etc. para suportar uma ampla gama de perguntas e respostas gerais de conhecimento.

Como um projeto leve de desenvolvimento de aplicativos de Big Model, o Sanic-Web suporta iteração e expansão rápidas, ajudando grandes projetos de modelos a implementá-los rapidamente.

? Demoção ao vivo

A experiência on -line está prestes a ser lançada, então fique atento!

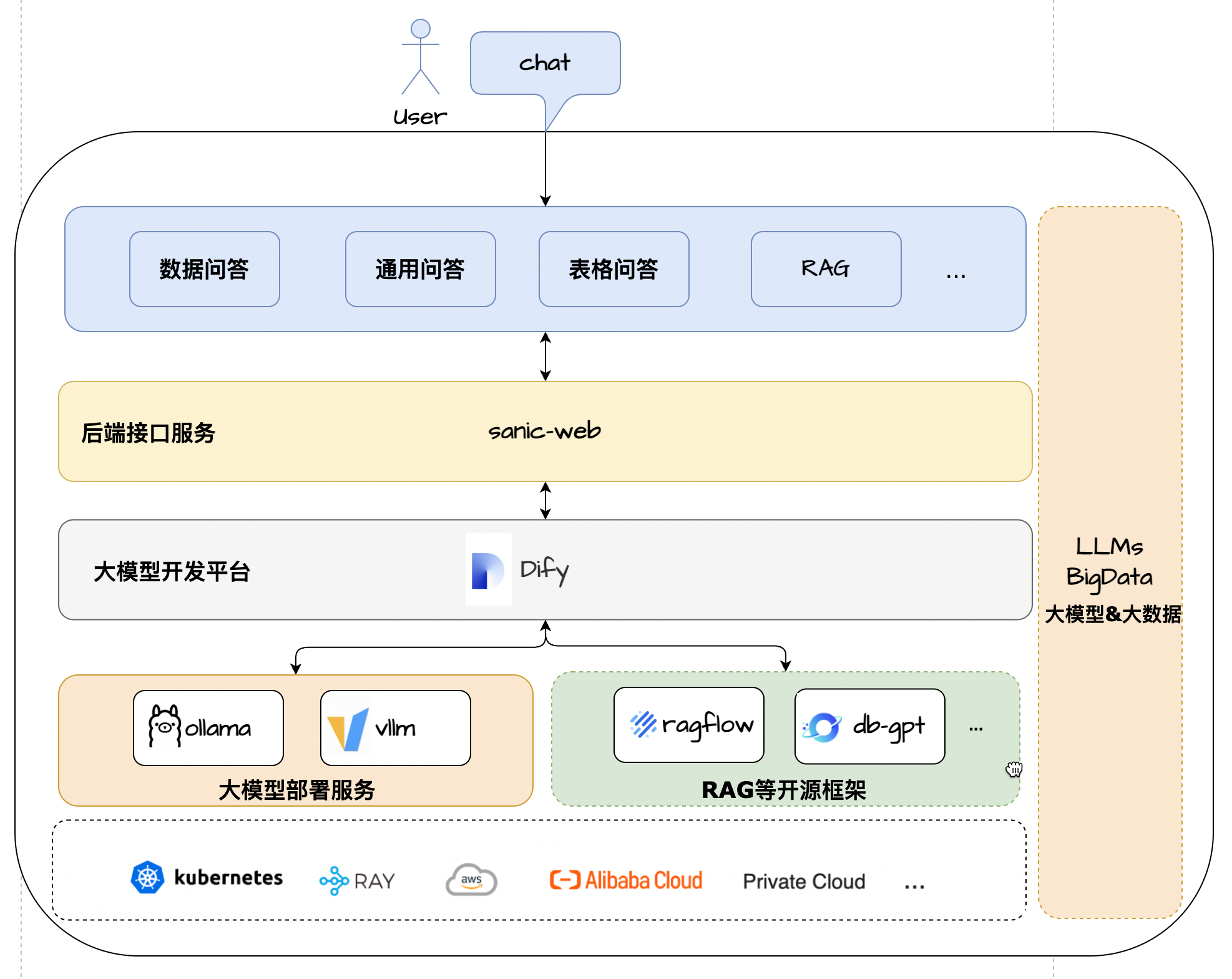

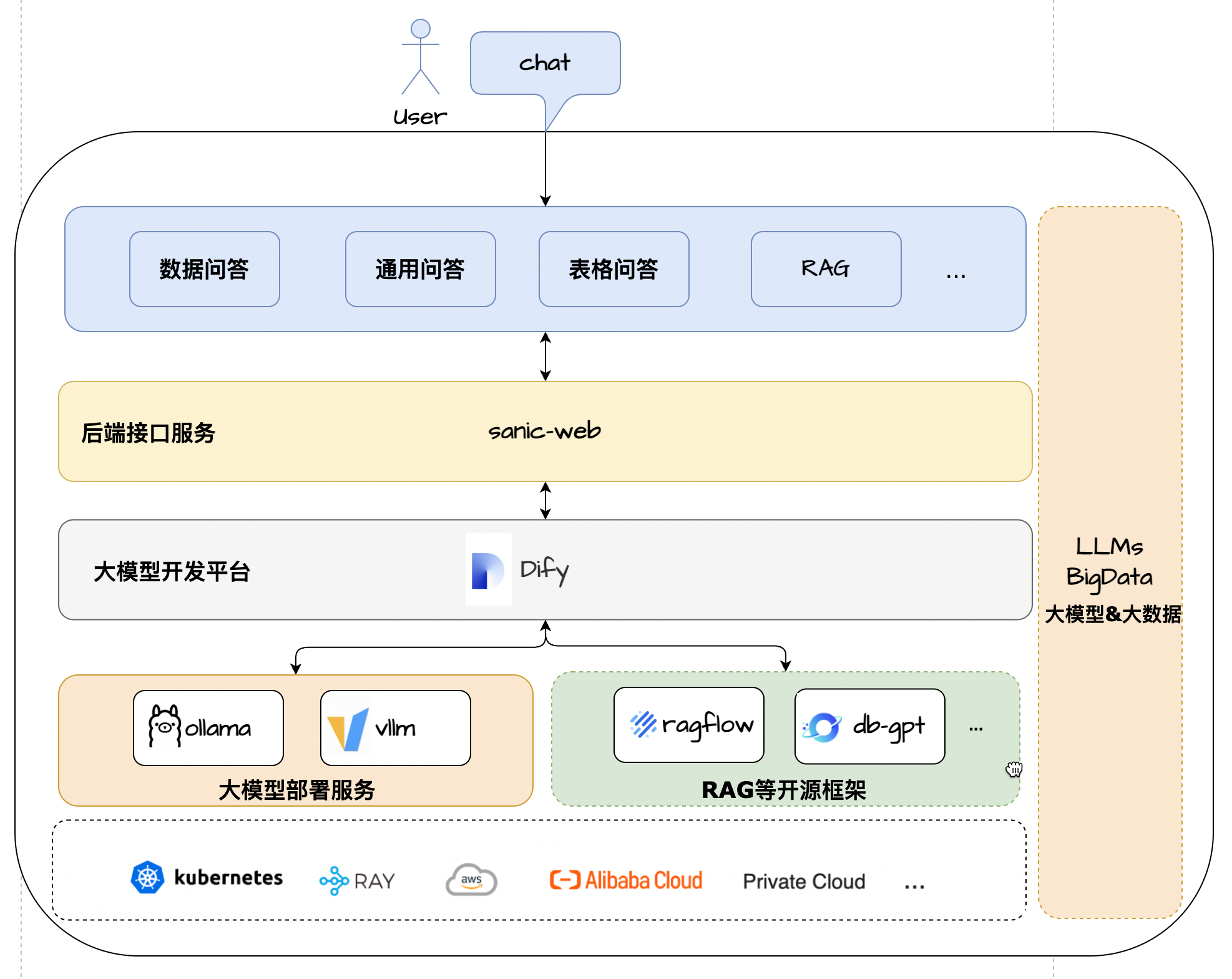

Solução de arquitetura

? característica

- Pilha de tecnologia do núcleo : dify + ollama + rag + llm + text2sql

- Estrutura da interface do usuário : Vue 3 + TypeScript + Vite 5

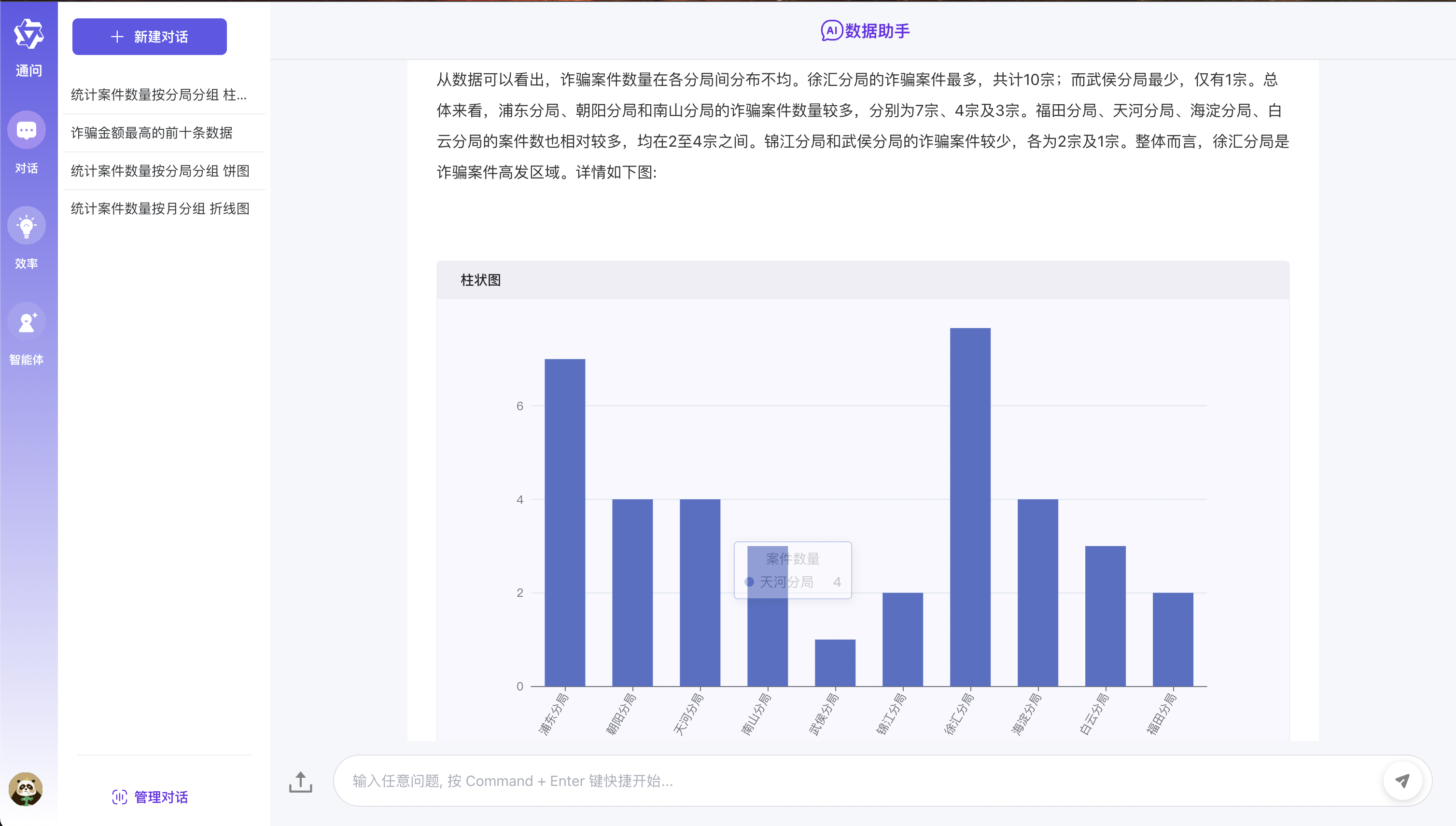

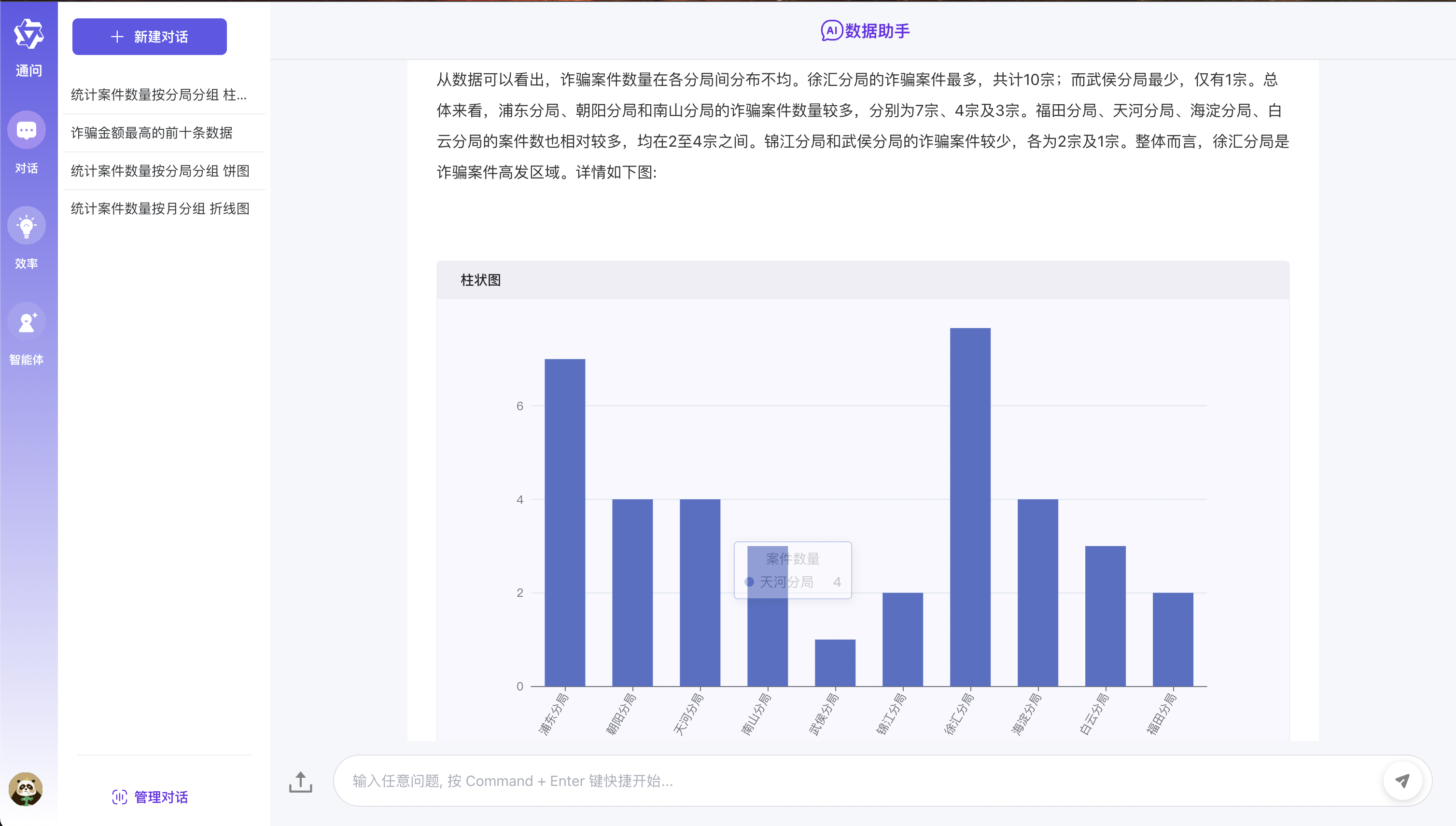

- Perguntas e respostas de dados : modelo ECHARTS integrado para realizar o Text2SQL Lightweight Graphical Data & A Display

- Tabela Perguntas e Respostas : Suporta o upload de arquivos de formato CSV e pré -processamento com base no resumo do modelo Big e perguntas e texto da tabela Text2SQL

- Perguntas e respostas gerais : Suporta perguntas e respostas de formulário de dados gerais com base em encaixar sistema de trapo de três partes + modo de recuperação de rede pública

- Arquitetura de aplicativos : como uma estrutura de aplicativo em larga escala completa completa em grande escala, expansão e implementação convenientes

- Implantação flexível : suporta dependências de desenvolvimento de aplicativos em larga escala de vários componentes Docker-Compose com um clique para implantar rapidamente a configuração zero

Efeito de corrida

Requisitos de configuração do ambiente

Antes de começar, verifique se o seu ambiente de desenvolvimento atende aos seguintes requisitos de configuração mínima:

- Sistema Operacional : Windows 10/11, MacOS M Series, Centos/Ubuntu

- GPU : use o Ollama para implantar localmente e é recomendável usar a placa gráfica NVIDIA ou o modo CPU.

- Memória : 8 GB+

? Pré-condições

- Python 3.8+

- Poesia 1.8.3+

- DIFY 0,7.1+

- MySQL 8.0+

- Node.js 18.12.x+

- PNPM 9.X

Implantação de modelo grande

- Consulte a implantação de Ollama

- Modelo: Qwen2.5

Configuração do ambiente diferente

Use scripts de projeto para instalar o DIFY por padrão

- Para levar em consideração os alunos expostos a grandes aplicativos de modelo pela primeira vez, este projeto fornece uma configuração Zero Zero Service Zero, com um clique, e também inicie o método de serviço para facilitar todos para experimentá-lo rapidamente.

- Endereço de acesso local DIFY: http: // Conta de localhost: [email protected] Senha: admin123

# 拉起内置的dify服务

cd docker/dify/docker

docker-compose up -d

Se o ambiente diferente foi instalado

- Se você já possui um ambiente difícil, só pode modificar o código -fonte localmente neste caso para iniciar o serviço !!!

- A primeira etapa é importar diretamente as perguntas e respostas do Docker/Dify/Data no diretório raiz da tela do Project.yml para Dify

- A segunda etapa é modificar a tecla Database_QA no código -fonte DiFyappenum Enum ( a chave é obtida na tela do processo Diify )

- A terceira etapa é modificar o arquivo .env no diretório raiz do projeto e modificar o endereço real da interface de serviço DIFY REST de acordo com o ambiente.

- Etapa 4 Modifique a configuração HTTPrequest na tela Dify e modifique o endereço de URL para o endereço de serviço do Sanic-Web específico

Instale a versão mais recente do Dify

- Se você precisar instalar a versão mais recente do DIFY, poderá consultar o documento oficial do documento DIFY.

Experiência rápida

- As etapas específicas são as seguintes:

- O primeiro passo é clonar o código para a área local

- A segunda etapa é se referir à implantação do Big Model acima. Primeiro instale o Ollama para implantar o modelo QWEN2.5.

- A terceira etapa é consultar diretamente a configuração do ambiente Dify na configuração do ambiente DIFY acima. No primeiro caso, [usando scripts do projeto para instalar o DIFY por padrão] é muito importante !!!

- As etapas específicas para iniciar o serviço na quarta etapa são as seguintes:

- Clonando o repositório

git clone https://github.com/apconw/sanic-web.git

- Inicie o serviço

# 拉起前后端服务和中间件

cd docker

docker compose up -d

- Inicialização de dados

cd docker

./init.sh

或执行

cd docker

python3 ../common/initialize_mysql.py

- Serviços de acesso

- Serviço front-end: http: // localhost: 8081

Desenvolvimento local

- O primeiro passo é clonar o código para a área local

- A segunda etapa é se referir à implantação do Big Model acima. Primeiro instale o Ollama para implantar o modelo QWEN2.5.

- A terceira etapa é configurar o ambiente do ambiente de desenvolvimento local. Consulte a configuração do ambiente DIFY acima. Você pode escolher as primeiras ou segundas situações sozinho.

- Etapa 4: edite o arquivo .env no diretório raiz do projeto, modifique as informações de configuração Env = dev e do banco de dados.

- Etapa 5: instale as dependências do projeto frontal e back-end e inicie os serviços frontal e back-end. As etapas específicas são as seguintes:

- Instalação de dependência de back -end

- Documentação oficial de poesia de referência de instalação de poesia

# 安装poetry

pip install poetry

# 安装依赖根目录执行

# 设置国内仓库

poetry source add --priority=default mirrors https://pypi.tuna.tsinghua.edu.cn/simple/

poetry install

- Instale o banco de dados

docker run --name mysql-local

-p 13006:3306

-v /Users/lihuan/docker-mount/mysql:/var/lib/mysql

-e MYSQL_ROOT_PASSWORD=1

-d mysql:latest

- Inicialize o banco de dados

- Se você usar o ambiente local MySQL, precisará modificar o código -fonte inicialize_mysql ao inicializar os dados e modificar as informações de conexão do banco de dados.

cd docker

./init.sh

或执行

cd docker

python3 ../common/initialize_mysql.py

Instalação de dependência front-end

- O front-end é baseado em projetos de código aberto. Você pode consultar o ChatGPT-VUE3-LIGHT-MVP para instalar a segunda abertura.

# 安装前端依赖&启动服务

cd web

#安装依赖

npm install -g pnpm

pnpm i

#启动服务

pnpm dev

Start Backend Service

Serviços de acesso

- Serviço front-end: http: // localhost: 2048

? Construa um espelho

- Edite o arquivo .ENV no diretório raiz do projeto, modifique Env = teste e salve.

- Execute o comando Build:

# 构建前端镜像

make web-build

# 构建后端镜像

make server-build

? apoiar

Se você gosta deste projeto ou achar útil, clique em Star no canto superior direito para apoiá -lo. Seu apoio é a nossa força motriz para melhorias contínuas, obrigado! ^_^

Se você achar este projeto útil para você, ou gostar do que fazemos, clique no botão [aste Star] no canto superior direito para nos apoiar! Toda sua estrela é um grande incentivo para nós e também é a força motriz para nossa melhoria e desenvolvimento contínuos. Obrigado pelo seu apoio! ^_^

Além disso, se você tiver alguma sugestão ou deseja participar do desenvolvimento do projeto, também poderá entrar em contato conosco através dos seguintes métodos:

- Enviar emissão - se você encontrar algum problema ou ter sugestões de melhoria, poderá enviá -lo em questões.

- Participe da discussão - você pode adicionar ao nosso grupo de discussão para se comunicar e discutir. Participar da discussão.

- Código de contribuição - Se você estiver interessado em contribuir com código, poderá consultar o guia de contribuição.

Obrigado novamente pelo seu apoio!

Grupo de comunicação de controle de qualidade

- Bem -vindo ao Big Model Application Exchange Group, bem -vindo a ingressar no grupo para discutir e compartilhar a experiência

- Siga a conta oficial abaixo e clique no menu do grupo WeChat para adicionar o WeChat para trazê -lo para o grupo

| Grupo WeChat |

|---|

|

Licença

MIT Licença | Copyright © 2024-Apresentador Aiadventurer