Этот репозиторий содержит код для воспроизведения результатов и обученных моделей ImageNet, в следующей статье:

Переосмысление значения сетевой обрезки. [arxiv] [OpenReview]

Zhuang Liu*, Mingjie Sun*, Tinghui Zhou, Gao Huang, Trevor Darrell (*равный вклад).

ICLR 2019. Также Best Paper Award на семинаре NIPS 2018 по компактным глубоководным сети.

Реализации нескольких методов обрезки, содержащихся в этом репо, также могут быть легко использованы в других исследовательских целях.

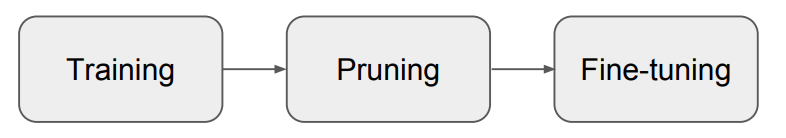

Наша статья показывает, что для структурированной обрезки обучение модели с ощущением с нуля может почти всегда достигать сопоставимого или более высокого уровня точности, чем модель, полученная из типичной процедуры «Тренировка, обрезка и тонкая настройка» (рис. 1) . Мы заключаем, что для этих методов обрезки:

Наши результаты предполагают необходимость более тщательных базовых оценок в будущих исследованиях структурированных методов обрезки.

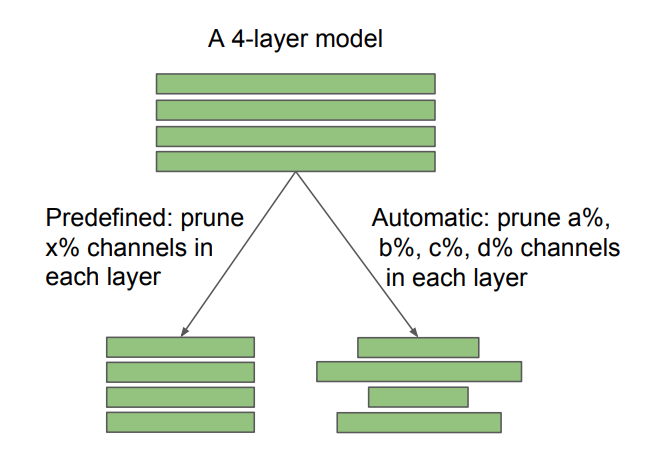

Рис. 2: Разница между предопределенными и автоматически обнаруженными целевыми архитектурами, в обрезке каналов. Коэффициент обрезки x определяется пользователем, в то время как A, B, C, D определяется алгоритмом обрезки. Неструктурированная редкая обрезка также можно рассматривать как автоматическую. Наш вывод имеет различные последствия для предопределенных и автоматических методов: для предопределенного метода можно пропустить традиционный трубопровод «тренировки, обрезки и тонкой настройки» и непосредственно обучить модель обрезки; Для автоматических методов обрезка может рассматриваться как форма обучения архитектуре.

Мы также сравниваем с «Гипотезой лотерейного билета» (Frankle & Carbin 2019) и обнаруживаем, что с оптимальной скоростью обучения инициализация «победного билета», используемая в Frankle & Carbin (2019), не приносит улучшения по сравнению с случайной инициализацией. Для получения более подробной информации, пожалуйста, обратитесь к нашей статье.

Мы оценили следующие семь методов обрезки.

Первые шесть структурированы, а последний - неструктурирован (или редкий). Для CIFAR наш код основан на классепификации Pytorch и сети. Для ImageNet мы используем официальный код обучения Pytorch ImageNet. Инструкции и модели находятся в каждой подпапке.

Для экспериментов по гипотезе лотерейного билета, пожалуйста, обратитесь к папке Cifar/Lottery Ticket.

Наша экспериментальная среда - Python 3.6 и Pytorch 0.3.1.

Не стесняйтесь обсуждать документы/код с нами через проблемы/электронные письма!

SunMJ15 на gmail.com

Liuzhuangthu на gmail.com

Если вы используете наш код в своем исследовании, пожалуйста, укажите:

@inproceedings{liu2018rethinking,

title={Rethinking the Value of Network Pruning},

author={Liu, Zhuang and Sun, Mingjie and Zhou, Tinghui and Huang, Gao and Darrell, Trevor},

booktitle={ICLR},

year={2019}

}