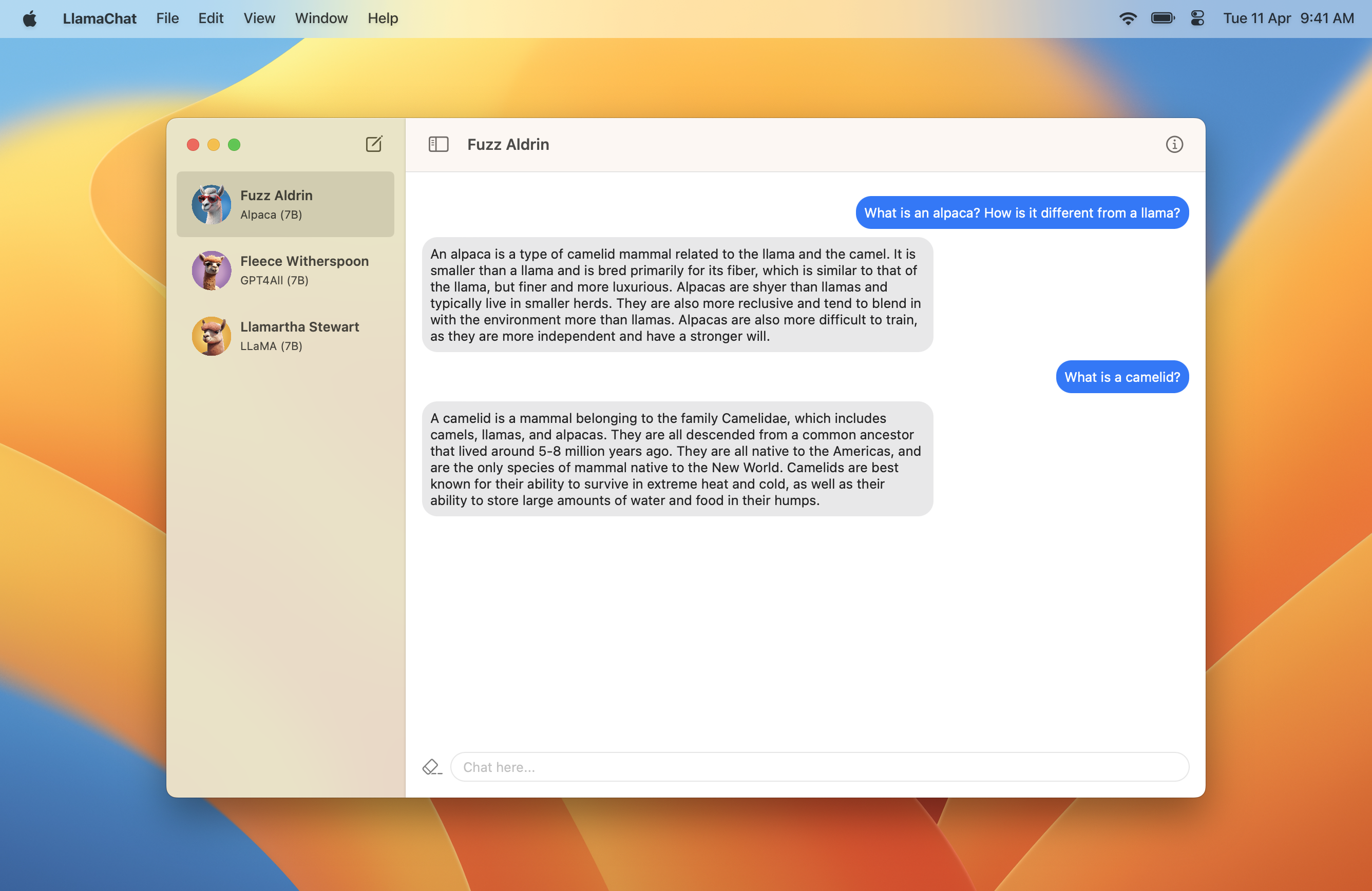

Llamachat - это приложение MacOS, которое позволяет вам общаться с моделями Llama, Alpaca и GPT4all, которые работают локально на вашем Mac.

Llamachat требует MacOS 13 Ventura, а также процессор Intel или Apple Silicon.

Загрузите .dmg содержащий последнюю версию здесь?

git clone https://github.com/alexrozanski/LlamaChat.git

cd LlamaChat

open LlamaChat.xcodeprojПримечание. Лламачат включает в себя Sparkle для Autoupdates, которые не будут загружаться, если Llamachat не будет подписан. Убедитесь, что вы используете действительный сертификат подписания при строительстве и управлении Llamachat.

ПРИМЕЧАНИЕ. Модель вывода работает очень медленно в сборке отладки, поэтому, если построение из источника убедитесь, что Build Configuration в LlamaChat > Edit Scheme... > Run установлен для Release .

.pth форме контрольных точек Pytorch, либо в формате .ggml ..ggml совместимые с Llamachat и Llama.cpp в приложении.Примечание: Llamachat не поставляется с какими -либо модельными файлами и требует, чтобы вы получили их из соответствующих источников в соответствии с их соответствующими условиями.

.pth ), либо в предварительно конвертированном файле .ggml (формат, используемом Llama.cpp, который поддерживает Llamachat)..pth :7B , 13B и т. Д.) В потоке преобразования, который включает файлы consolidated.NN.pth и params.json .tokenizer.model . Например, чтобы использовать модель Llama-13b, ваш модельный каталог должен выглядеть примерно как приведенный ниже, и вы должны выбрать каталог 13B : .

│ ...

├── 13B

│ ├── checklist.chk.txt

│ ├── consolidated.00.pth

│ ├── consolidated.01.pth

│ └── params.json

│ ...

└── tokenizer.model.ggml убедитесь, что они в курсе. Если вы столкнетесь с проблемами, вам может потребоваться использовать сценарии конверсии от llama.cpp:Запросы на вытягивание и проблемы приветствуются и очень ценятся. Пожалуйста, обязательно придерживайтесь кодекса поведения в любое время.

Llamachat полностью построен с использованием Swift и Swiftui и использует Llama.Swift под капотом для выполнения вывода и выполнения модельных операций.

Проект в основном построен с использованием MVVM и широко использует комбинированную и быструю параллелизм.

Лламачат лицензирован по лицензии MIT.