Awesome-llm-kg

Uma coleção de trabalhos e recursos sobre a unificação de grandes modelos de idiomas (LLMS) e gráficos de conhecimento (KGS).

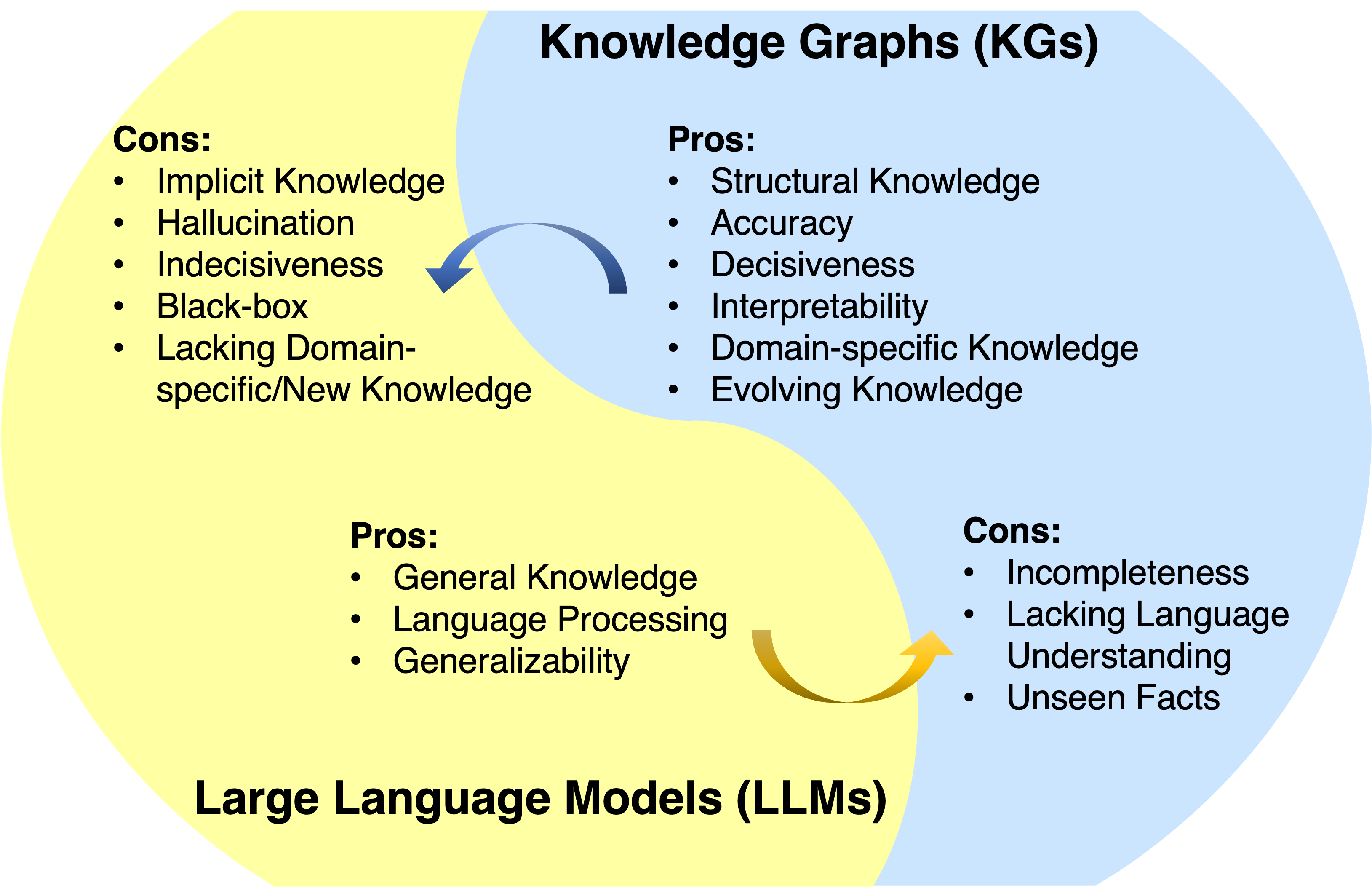

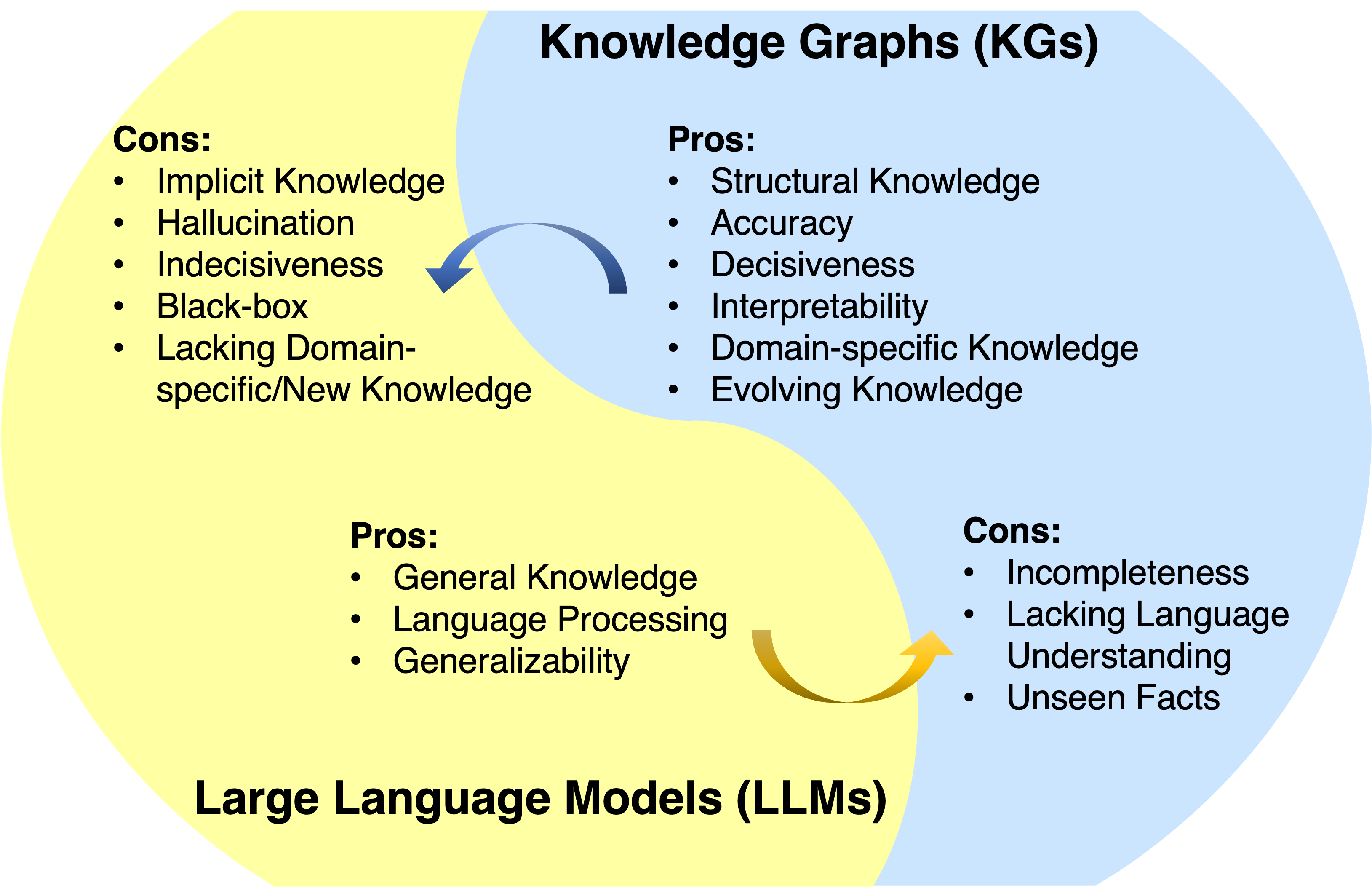

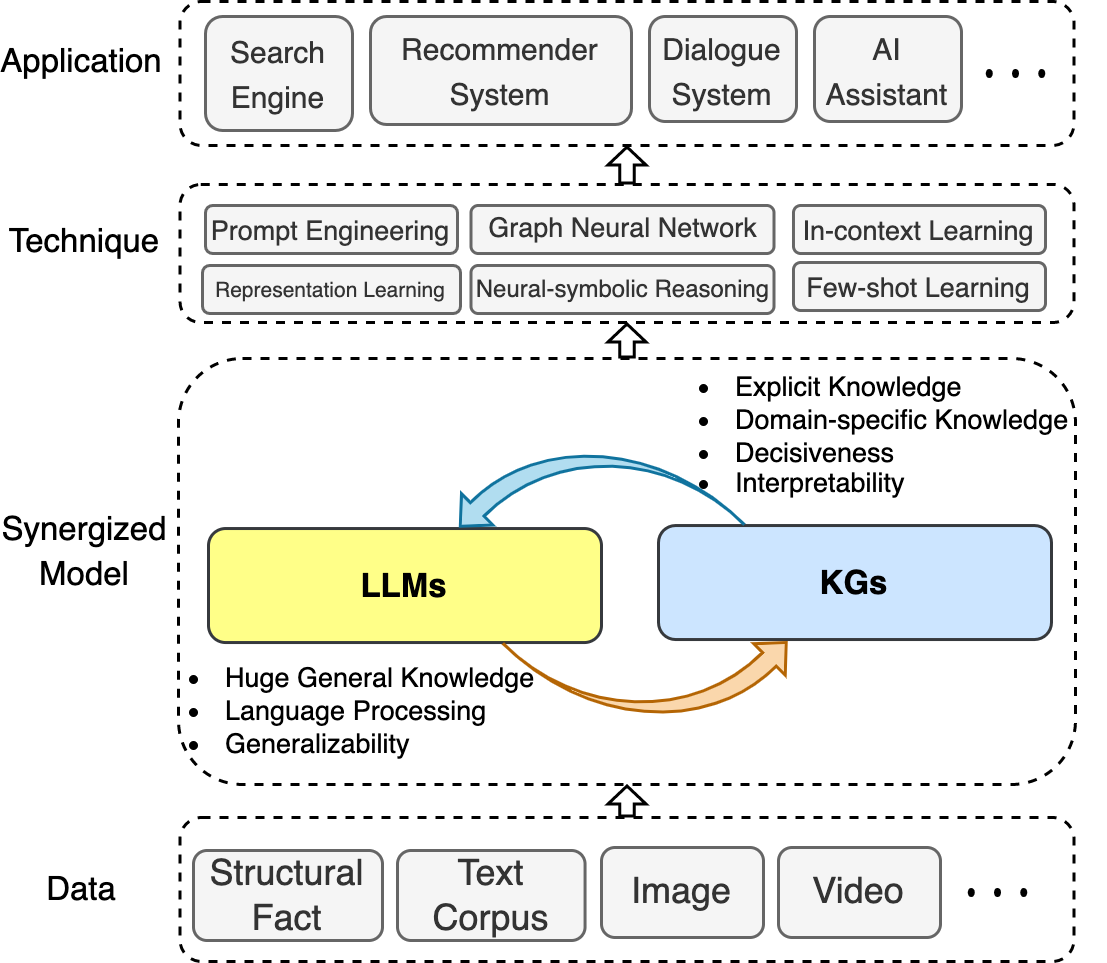

Os grandes modelos de idiomas (LLMs) alcançaram notável sucesso e generalização em várias aplicações. No entanto, eles geralmente ficam aquém de capturar e acessar o conhecimento factual. Os gráficos de conhecimento (KGs) são modelos de dados estruturados que armazenam explicitamente ricos conhecimentos factuais. No entanto, os KGs são difíceis de construir e os métodos existentes em KGs são inadequados ao lidar com a natureza incompleta e em mudança dinamicamente dos KGs do mundo real. Portanto, é natural unificar LLMs e KGs juntos e, simultaneamente, alavancar suas vantagens.

Notícias

? Este projeto está em desenvolvimento. Você pode acertar a estrela e assistir para seguir as atualizações.

- Nosso trabalho mais recente sobre KG + LLM Reaosning agora é público: Raciocínio com restrição de gráficos: raciocínio fiel em gráficos de conhecimento com grandes modelos de linguagem

- Nosso LLM para o trabalho de raciocínio temporal de kg: Adaptação dinâmica guiada por modelos de idiomas para o raciocínio do gráfico de conhecimento temporal foi aceito pelo Neurips 2024!

- Nosso KG para analisar Documento de Raciocínio LLM: Avaliação direta da cadeia de pensamentos no raciocínio multi-hop com gráficos de conhecimento foi aceito pelo ACL 2024.

- Nosso papel de roteiro foi aceito pela TKDE.

- Nosso KG para LLM Probing Paper: Avaliação sistemática do conhecimento factual em grandes modelos de idiomas foi aceito pelo EMNLP 2023.

- Nosso documento de raciocínio KG + LLM: Raciocínio nos gráficos: O raciocínio fiel e interpretável do modelo de linguagem grande foi aceito pelo ICLR 2024.

- Nosso LLM para KG Raciacing Paper: ChatRule: Mineração Regras lógicas com grandes modelos de idiomas para o raciocínio do gráfico de conhecimento agora é público.

- Nosso papel de roteiro: unificar grandes modelos de idiomas e gráficos de conhecimento: um roteiro agora é público.

Visão geral

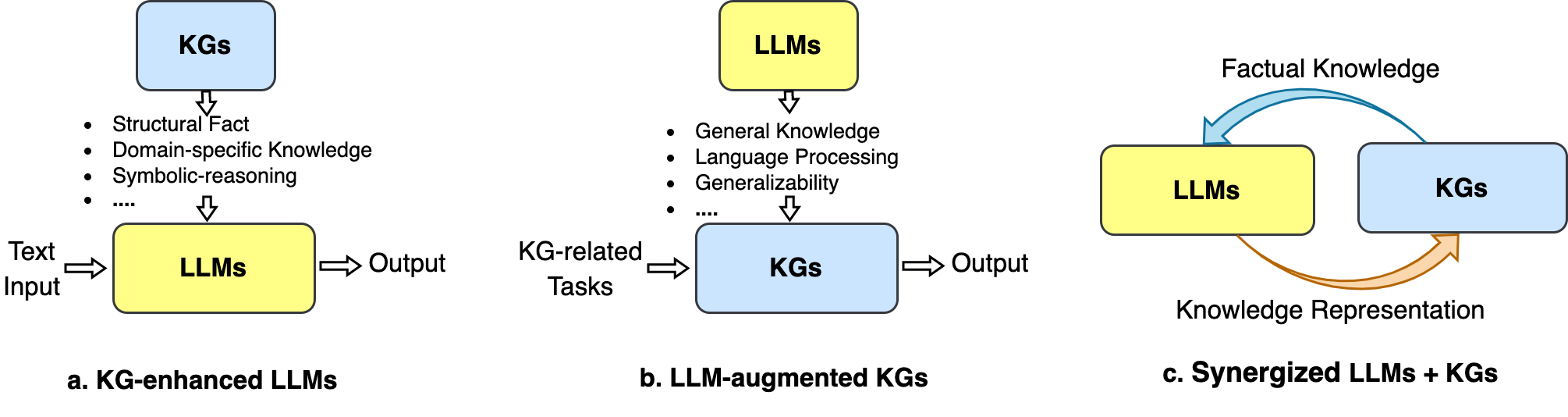

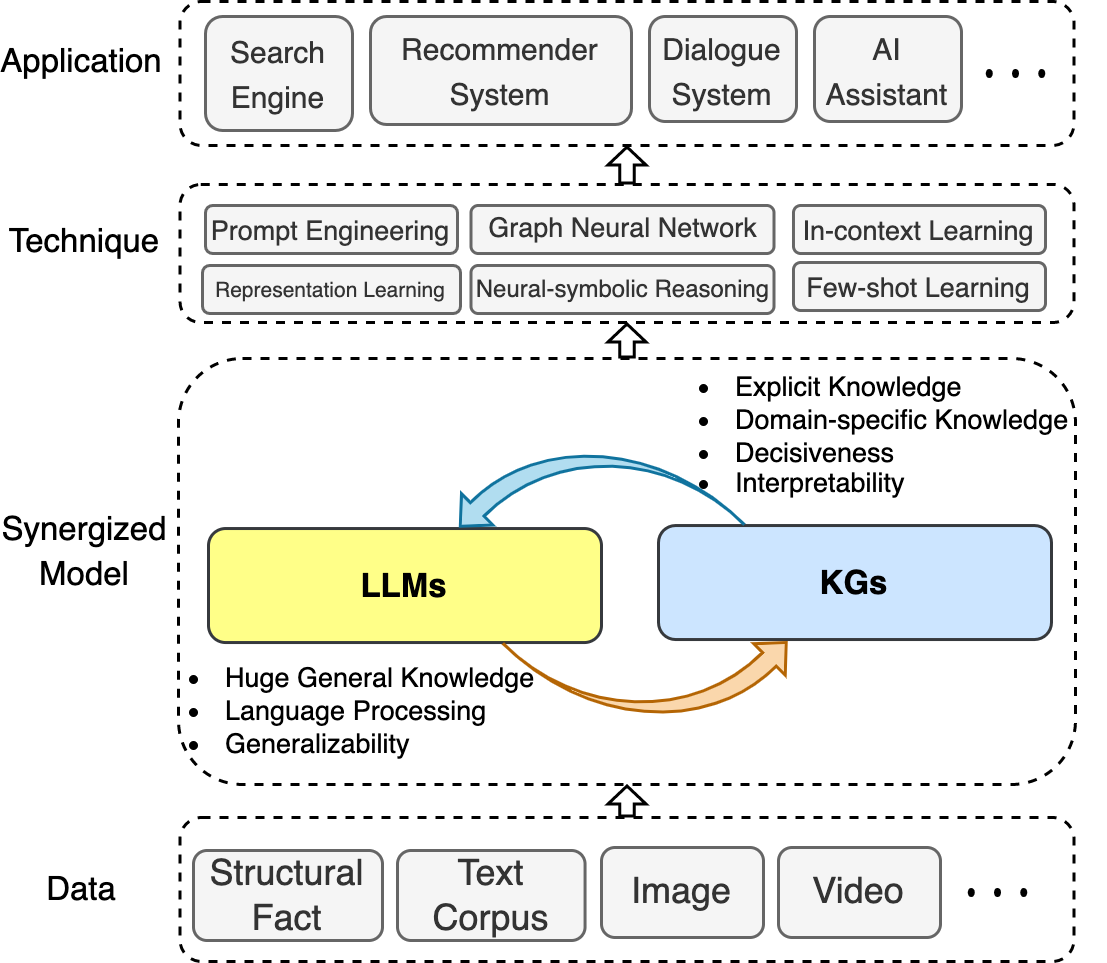

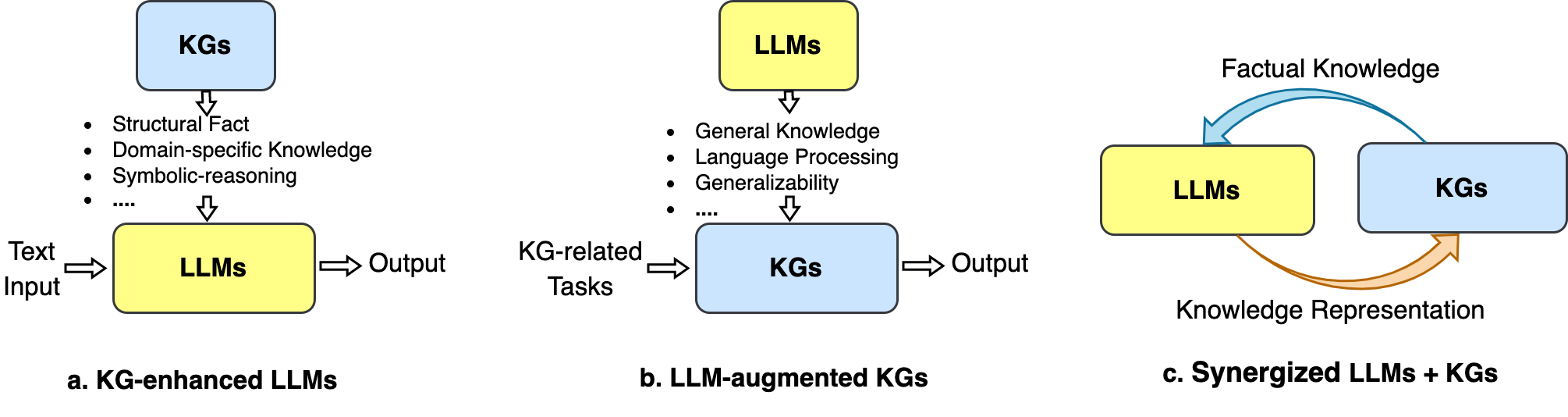

Neste repositório, coletamos avanços recentes na unificação de LLMs e KGs. Apresentamos um roteiro que resume três estruturas gerais: 1) KG-KG-HANDEND LLMS , 2) KGS com agitação de LLMS e 3) Sinergizados LLMs + Kgs .

Também ilustramos as técnicas e aplicações envolvidas.

Esperamos que esse repositório possa ajudar pesquisadores e profissionais a entender melhor esse campo emergente.

Se este repositório for útil para você, o PLASE nos ajude citando este artigo:

@article{llm_kg,

title={Unifying Large Language Models and Knowledge Graphs: A Roadmap},

author={Pan, Shirui and Luo, Linhao and Wang, Yufei and Chen, Chen and Wang, Jiapu and Wu, Xindong},

journal={IEEE Transactions on Knowledge and Data Engineering (TKDE)},

year={2024}

}Índice

- Awesome-llm-kg

- Notícias

- Visão geral

- Índice

- Pesquisas relacionadas

- KG-ENHANCED LLMS

- KG-Enheded LLM pré-treinamento

- Inferência LLM de Kg-Hanceanced

- Interpretabilidade LLM de Kg-Hanceanced

- LLM KGS agentado

- A incorporação de KG agente-agente

- Conclusão KG de LLM-agentada

- Geração KG-T-TEXT, geração de texto

- Llm-agentado kg perguntas de resposta

- LLMS sinergizados + kgs

- Representação do conhecimento

- Raciocínio

- Aplicações

- Recomendação

- Análise de falhas

Pesquisas relacionadas

- Unificar grandes modelos de idiomas e gráficos de conhecimento: um roteiro (TKDE, 2024) [Paper]

- Uma pesquisa sobre modelos de idiomas pré-treinados aprimorados pelo conhecimento (Arxiv, 2023) [Paper]

- Uma pesquisa com PNL com uso intensivo de conhecimento com modelos de idiomas pré-treinados (Arxiv, 2022) [Paper]

- Uma revisão sobre modelos de idiomas como bases de conhecimento (Arxiv, 2022) [Paper]

- Construção de gráficos de conhecimento generativo: uma revisão (EMNLP, 2022) [Paper]

- Modelos de idiomas pré -tenhados com conhecimento aprimorado: uma pesquisa compreensiva (Arxiv, 2021) [Paper]

- Raciocínio sobre diferentes tipos de gráficos de conhecimento: estático, temporal e multimodal (Arxiv, 2022) [Paper] [Código]

KG-ENHANCED LLMS

KG-Enheded LLM pré-treinamento

- Ernie: Representação de linguagem aprimorada com entidades informativas (ACL, 2019) [Paper]

- Explorando o conhecimento estruturado em texto por meio de representação guiada por gráficos Learning (EMNLP, 2019) [Paper]

- SKEP: Conhecimento de sentimentos aprimorados pré-treinamento para análise de sentimentos (ACL, 2020) [Paper]

- E-Bert: Um modelo de linguagem aprimorada por conhecimento de frase e produto para comércio eletrônico (Arxiv, 2020) [Paper]

- Enciclopédia pré-treinada: Modelo de Idioma pré-adquirido com conhecimento fracamente supervisionado (ICLR, 2020) [Paper]

- BERT-MK: Integrando o gráfico contextualizado conhecimento em modelos de idiomas pré-treinados (EMNLP, 2020) [Paper]

- K-Bert: Habilitando a representação de idiomas com o Knowledge Graph (AAAI, 2020) [Paper]

- COLAKE: Incorporação de linguagem e conhecimento contextualizados (Coling, 2020) [Paper]

- Kepler: Um modelo unificado para incorporação de conhecimento e representação de idiomas pré-treinada (TACL, 2021) [Paper]

- K-Adapter: Infusando o conhecimento em modelos pré-treinados com adaptadores (achados da ACL, 2021) [Paper]

- Cokebert: Seleção de conhecimento contextual e incorporação para modelos de linguagem pré-treinados aprimorados (IA Open, 2021) [Paper]

- Ernie 3.0: Conhecimento em larga escala aprimorou o pré-treinamento para compreensão e geração de idiomas (Arixv, 2021) [Paper]

- Modelos de idiomas pré-treinamento com conhecimento factual determinístico (EMNLP, 2022) [Paper]

- Kala: Adaptação do Modelo de Linguagem agente-up (NAACL, 2022) [Artigo]

- DKPLM: Modelo de idioma pré-treinado com conhecimento decomposto para o entendimento da linguagem natural (AAAI, 2022) [Paper]

- Dict-Bert: Aprimorando o modelo de idioma pré-treinamento com dicionário (ACL Acoundings, 2022) [Paper]

- Jaket: Pré-treinamento conjunto do gráfico de conhecimento e entendimento da linguagem (AAAI, 2022) [Artigo]

- Tele-conhecimento pré-treinamento para análise de falhas (ICDE, 2023) [Paper]

Inferência LLM de Kg-Hanceanced

- Esposa de Barack Hillary: usando gráficos de conhecimento para modelagem de idiomas com reconhecimento de fatos (ACL, 2019) [Paper]

- Geração de recuperação useada para tarefas de PNL com uso intensivo de conhecimento (Neurips, 2020) [Paper]

- Reino: Modelo de idioma de recuperação de recuperação pré-treinamento (ICML, 2020) [Paper]

- QA-GNN: Raciocínio com modelos de idiomas e gráficos de conhecimento para resposta a perguntas (NAACL, 2021) [Paper]

- Modelos de memória e conhecimento aumentados para inferir saliência em histórias de formato longo (EMNLP, 2021) [Paper]

- Jointlk: Raciocínio conjunto com modelos de idiomas e gráficos de conhecimento para resposta ao senso comum (NAACL, 2022) [Paper]

- Compreensão aprimorada de histórias para grandes modelos de linguagem por meio de gráficos de conhecimento baseados em documentos dinâmicos (AAAI, 2022) [Paper]

- Greaselm: Modelos de linguagem aprimorados de raciocínio gráfico (ICLR, 2022) [Paper]

- Um transformador eficiente em agosto de memória para tarefas de PNL com uso intensivo de conhecimento (EMNLP, 2022) [Paper]

- Modelo de idioma agente com conhecimento que solicita a resposta do gráfico de conhecimentos zero (NLRSE@ACL, 2023) [Paper]

- Resposta de perguntas multi-hop baseada em LLM com integração de gráficos de conhecimento em ambientes em evolução (EMNLP Acalhos, 2024) [Paper]

Interpretabilidade LLM de Kg-Hanceanced

- Modelos de idiomas como bases de conhecimento (EMNLP, 2019) [Artigo]

- Kagnet: redes gráficas com conhecimento do conhecimento para raciocínio de senso comum (Arxiv, 2019) [Paper]

- Autoprompt: provocando conhecimento de modelos de idiomas com prompts gerados automaticamente (EMNLP, 2020) [Paper]

- Como podemos saber quais modelos de idiomas sabem? (ACL, 2020) [Papel]

- Neurônios do conhecimento em transformadores pré -criados (ACL, 2021) [Papel]

- Os modelos de idiomas podem ser bases de conhecimento biomédico? (EMNLP, 2021) [Papel]

- Interpretando modelos de linguagem através da extração de gráficos de conhecimento (Arxiv, 2021) [Paper]

- QA-GNN: Raciocínio com modelos de idiomas e gráficos de conhecimento para resposta a perguntas (ACL, 2021) [Paper]

- Como consultar modelos de linguagem? (Arxiv, 2021) [Papel]

- Recobrir-se-sonda: uma receita contrastiva para investigar o conhecimento biomédico dos modelos de linguagem pré-treinados (Arxiv, 2021) [Paper]

- Quando não confiar em modelos de idiomas: investigando eficácia e limitações de memórias paramétricas e não paramétricas (Arxiv, 2022) [Paper]

- Como os modelos de linguagem pré-treinados capturam conhecimento factual? Uma análise de inspiração causal (ARXIV, 2022) [papel]

- Os gráficos de conhecimento podem simplificar o texto? (CIKM, 2023) [Papel]

LLM KGS agentado

A incorporação de KG agente-agente

- Alinhamento de entidade com anotações barulhentas de grandes modelos de idiomas (Neurips, 2024) [papel]

- Lambdakg: uma biblioteca para o gráfico de conhecimento baseado em modelo de linguagem pré-treinado (Arxiv, 2023) [Paper]

- Integração de modelos de idiomas de incorporação de gráficos de conhecimento e pré -treinamento em espaços hipercomplexos (Arxiv, 2022) [Paper]

- Modelos de linguagem dotando com representações de gráficos de conhecimento multimodal (Arxiv, 2022) [Paper]

- Modelo de idioma Guiado Gráfico de Conhecimento INCEDDINGS (IEEE Access, 2022) [Paper]

- Modelos de idiomas como incorporações de conhecimento (IJCAI, 2022) [Paper]

- Pretain-KGE: Learning Knowledge Representation de modelos de idiomas pré-criados (EMNLP, 2020) [Paper]

- Kepler: Um modelo unificado para incorporação de conhecimento e representação de idiomas pré-treinada (TACL, 2020) [Paper]

Conclusão de KG agentada por LLM

- Melhoria de várias perspectivas da conclusão do gráfico de conhecimento com grandes modelos de idiomas (Coling 2024) [Paper] [Código]

- KG-Bert: Bert for Knowledge Graph Conclusão (Arxiv, 2019) [Paper]

- Conclusão de gráficos de aprendizagem de várias tarefas com modelos de idiomas pré-treinados (Coling, 2020) [Paper]

- Os modelos pré-treinados beneficiam a conclusão do gráfico de conhecimento? Uma avaliação confiável e uma abordagem razoável (ACL, 2022) [papel]

- Incorporação semântica e de estrutura da linguagem conjunta para a conclusão do gráfico de conhecimento (Coling, 2022) [Paper]

- MEM-KGC: Modelo de entidade mascarada para conclusão de gráficos de conhecimento com modelo de idioma pré-treinado (IEEE Access, 2021) [Paper]

- Extensão do gráfico de conhecimento com um modelo de idioma pré-treinado via método de aprendizado unificado (Knowl. Syst., 2023) [Paper]

- Representação de texto com estrutura de estrutura Aprendizagem para conclusão eficiente do gráfico de conhecimento (www, 2021) [Paper]

- SIMKGC: Conclusão simples do gráfico de conhecimento contrastivo com modelos de idiomas pré-treinados (ACL, 2022) [Paper]

- LP-Bert: Gráfico de conhecimento pré-treinamento com várias tarefas Bert para previsão de link (Arxiv, 2022) [Paper]

- Da discriminação à geração: Conclusão do gráfico de conhecimento com transformador generativo (www, 2022) [Paper]

- Conclusão do gráfico de conhecimento de sequência a sequência e resposta a perguntas (ACL, 2022) [Paper]

- O conhecimento é plano: uma estrutura generativa SEQ2SEQ para várias conclusão do gráfico de conhecimento (Coling, 2022) [Paper]

- Uma estrutura para adaptar modelos de linguagem pré-treinados à conclusão do gráfico de conhecimento (EMNLP, 2022) [Paper]

- Molho PLMS de imersão: estrutura de ponte e texto para conclusão eficaz do gráfico de conhecimento por meio de aviso suave condicional (ACL, 2023) [papel]

Geração KG-T-TEXT, geração de texto

- Genwiki: Um conjunto de dados de 1,3 milhão de texto e gráficos de compartilhamento de conteúdo para geração de gráfico para texto não supervisionado (Coling, 2020) [Paper]

- KGPT: pré-treinamento fundamentado no conhecimento para geração de dados para texto (EMNLP 2020) [Paper]

- JointGT: Aprendizagem de representação conjunta de texto gráfico para geração de texto a partir de gráficos de conhecimento (ACL InCoundings, 2021) [Paper]

- Investigando modelos de idiomas pré-rastreados para geração de gráfico para texto (NLP4Convai, 2021) [Paper]

- Geração de gráfico para texto com poucos tiro com modelos de idiomas pré-treinados (ACL, 2021) [Paper]

- Eventnarrative: um conjunto de dados centrado em eventos em larga escala para geração de gráfico para texto (Neurips, 2021) [papel] [Paper]

- Gap: Uma estrutura de modelo de idioma gráfico para geração de gráfico para texto (Coling, 2022) [Paper]

Llm-agentado kg perguntas de resposta

- UNIKGQA: Recuperação unificada e raciocínio para resolver perguntas multi-hop Respondendo o gráfico de conhecimento (ICLR, 2023) [Paper]

- StructGPT: Uma estrutura geral para um modelo de linguagem grande para raciocinar dados estruturados (Arxiv, 2023) [Paper]

- Um estudo empírico do GPT-3 para VQA baseado no conhecimento (AAAI, 2022) [Paper] baseado no conhecimento (AAAI, 2022) [Artigo]

- Um estudo empírico de modelos de idiomas pré-treinados em perguntas simples de perguntas sobre gráficos de conhecimento (World Wide Web Journal, 2023) [Artigo]

- Capacitando modelos de idiomas com raciocínio gráfico de conhecimento para respostas de perguntas de domínio aberto (EMNLP, 2022) [Paper]

- DRLK: Raciocínio hierárquico dinâmico com modelo de idioma e gráfico de conhecimento para resposta a perguntas (EMNLP, 2022) [Paper]

- Modelo aprimorado de recuperação de subgrafias para resposta a perguntas da base de conhecimento multi-hop (ACL, 2022) [Paper]

- Greaselm: Raciocínio de gráficos Modelos de linguagem aprimorados para resposta a perguntas (ICLR, 2022) [Paper]

- LAKO: Resposta de perguntas visuais orientadas pelo conhecimento por meio de injeção tardia de conhecimento em texto (IJCKG, 2022) [Paper]

- QA-GNN: Raciocínio com modelos de idiomas e gráficos de conhecimento para resposta a perguntas (NAACL, 2021) [Paper]

LLMS sinergizados + kgs

Representação do conhecimento

- Tele-conhecimento pré-treinamento para análise de falhas (ICDE, 2023) [Paper]

- Modelo de idioma pré-treinamento que incorpora o conhecimento heterogêneo específico do domínio em uma representação unificada (Sistemas de Especialistas com Aplicativos, 2023) [Paper]

- Gráfico de idioma bidirecional profundo pré-treinamento (NIPS, 2022) [papel]

- Kepler: Um modelo unificado para incorporação de conhecimento e representação de idiomas pré-treinada (TACL, 2021) [Paper]

- JointGT: representação conjunta de texto gráfico Aprendizagem para geração de texto a partir de gráficos de conhecimento (ACL 2021) [Paper]

Raciocínio

- Um serviço de aumento de gráfico de conhecimento unificado para aumentar as tarefas de PNL específicas para domínio (ARXIV, 2023) [Paper]

- Unificar o raciocínio da estrutura e o modelo de idioma pré-treinamento para raciocínio complexo (Arxiv, 2023) [Paper]

- Raciocínio lógico complexo sobre gráficos de conhecimento usando grandes modelos de linguagem (Arxiv, 2023) [Paper]

Aplicações

Sistema de recomendação

- Recindial: Uma estrutura unificada para recomendação de conversação com modelos de idiomas pré -rastreados (Arxiv, 2023) [Paper]

Análise de falhas

- Tele-conhecimento pré-treinamento para análise de falhas (ICDE, 2023) [Paper]