LLM (Lange Language Model)은 처리 테이블 데이터에 결점을 가지고 있으며 Zhejiang University의 컴퓨팅 혁신 연구소의 연구팀은이 목적을 위해 TableGPT2 모델을 개발했습니다. 이 모델을 사용하면 Tabular Data의 효율적인 통합 및 처리를 가능하게하여 BI (Business Intelligence) 및 기타 데이터 중심 애플리케이션에 새로운 가능성을 제공합니다. TableGPT2의 핵심 혁신은 고유 한 테이블 인코더에 있으며 테이블의 구조 정보 및 셀 컨텐츠 정보를 효과적으로 캡처하고 퍼지 쿼리, 누락 된 열 이름 및 불규칙 테이블을 처리하는 모델의 능력을 향상시킬 수 있습니다. TableGPT2는 대규모 사전 훈련 및 미세 조정, CPT (Continuous Pre-Training) 및 감독 된 미세 조정 (SFT)을 통해 복잡한 BI 작업을 처리 할 수있는 강력한 코딩 및 추론 기능을 보여줍니다.

대형 언어 모델 (LLM)의 부상은 인공 지능의 사용에 혁명을 일으켰지 만 표 테이블 데이터 처리에는 명백한 단점이 있습니다. Zhejiang University의 Computing Innovation Institute의 연구팀은 TableGPT2라는 새로운 모델을 출시하여 비즈니스 인텔리전스 (BI) 및 기타 데이터 중심의 응용 프로그램을위한 테이블 데이터를 직접적으로 효율적으로 통합하고 처리 할 수 있습니다.

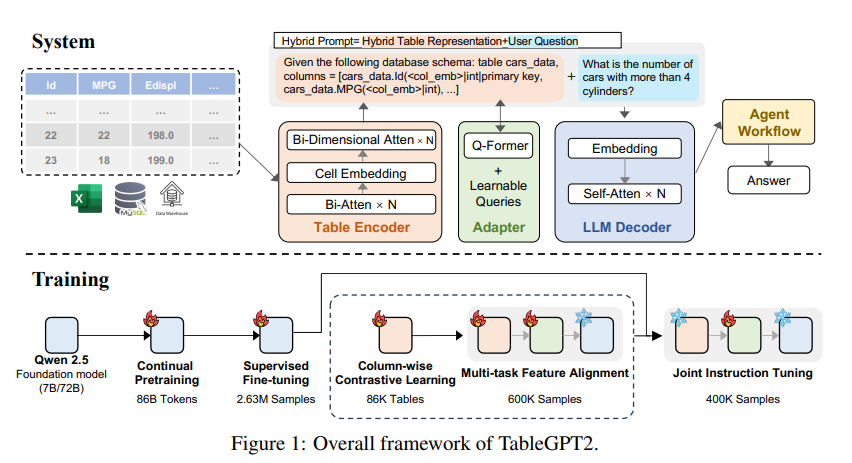

TableGPT2의 핵심 혁신은 테이블의 구조 및 셀 내용 정보를 캡처하도록 특별히 설계된 고유 한 테이블 인코더입니다. 따라서 실제 응용 프로그램에서 일반적으로 발견되는 퍼지 쿼리, 누락 된 열 이름 및 불규칙 테이블을 처리하는 모델의 능력을 향상시킵니다. TableGPT2는 QWEN2.5 아키텍처를 기반으로하며 대규모 사전 훈련 및 미세 조정을 겪었으며, 593,800 개 이상의 테이블과 236 만 개의 고품질 쿼리 테이블-출력 튜플이 포함되어 있습니다. 이전 연구의 데이터.

TABLEGPT2의 인코딩 및 추론 기능을 향상시키기 위해 연구원들은 CPT (Continuous Pre-Training)를 수행했으며, 데이터의 80%가 신중하게 주석이 달린 코드를 사용하여 인코딩 기능이 강력하게 보장됩니다. 또한 모델의 추론 능력을 향상시키기 위해 도메인 별 지식이 포함 된 많은 양의 추론 데이터 및 교과서를 수집했습니다. 최종 CPT 데이터에는 860 억 개의 필터링 된 단어 기호가 포함되어 있으며,이 기호는 복잡한 BI 작업 및 기타 관련 작업을 처리하는 데 필요한 코딩 및 추론 기능을 제공합니다.

특정 BI 작업 및 시나리오에 적응할 때 TableGPT2의 한계를 해결하기 위해 연구원들은 감독 된 미세 조정 (SFT)을 수행했습니다. 그들은 여러 대화, 복잡한 추론, 도구 사용 및 비즈니스 지향적 인 쿼리를 포함하여 다양한 비판적이고 사실적인 시나리오를 다루는 데이터 세트를 구성했습니다. 이 데이터 세트는 수동 주석과 전문가 중심 자동 주석 프로세스를 결합하여 데이터 품질과 관련성을 보장합니다. SFT 프로세스는 총 236 만 개의 샘플을 사용하여 BI 및 기타 테이블 관련 환경의 특정 요구를 충족시키기 위해 모델을 더 정제합니다.

TableGPT2는 또한 전체 테이블을 입력으로 취하는 의미 론적 테이블 인코더를 혁신적으로 도입하여 각 열에 대한 소형 임베딩 벡터 세트를 생성했습니다. 이 아키텍처는 표 형 데이터의 고유 한 특성에 맞게 사용자 정의되며 양방향주의 메커니즘과 계층 적 기능 추출 프로세스를 통해 행과 열의 관계를 효과적으로 캡처합니다. 또한, 원주 대비 학습 방법은 모델이 의미 있고 구조적으로 인식하는 표현 표현을 배우도록 장려하는 데 사용됩니다.

TableGPT2를 엔터프라이즈 레벨 데이터 분석 도구와 완벽하게 통합하기 위해 연구원들은 에이전트 워크 플로 런타임 프레임 워크를 설계했습니다. 프레임 워크에는 런타임 프롬프트 엔지니어링, 보안 코드 샌드 박스 및 프록시 평가 모듈의 세 가지 핵심 구성 요소가 포함되어있어 프록시의 기능과 신뢰성을 공동으로 향상시킵니다. 워크 플로는 프록시의 성능을 관리하고 모니터링하기 위해 함께 작동하는 모듈 식 단계 (입력 정규화, 프록시 실행 및 도구 통화)를 통해 복잡한 데이터 분석 작업을 지원합니다. 효율적인 컨텍스트 검색 및 보안 실행을위한 코드 샌드 박스를 위해 검색 강화 생성 (RAG)을 통합함으로써 Framework는 TableGPT2가 실제 문제에 대한 정확하고 컨텍스트에 민감한 통찰력을 제공합니다.

연구원들은 다양한 널리 사용되는 테이블과 일반 벤치 마크에서 TableGPT2에 대한 광범위한 평가를 수행했으며, 결과는 TableGPT2가 35.20%, 그리고 7 억 개의 매개 변수 모델의 평균 성능 개선으로 테이블 이해, 처리 및 추론에서 잘 수행되었음을 보여줍니다. 720% 1 억 파라미터 모델의 평균 성능은 49.32% 증가했으며 강력한 일반 성능을 유지했습니다. 공정한 평가를 위해, 그들은 Qwen 및 DeepSeek과 같은 오픈 소스 벤치 마크 중립 모델과 만 TableGPT2를 비교하여 단일 벤치 마크 테스트에 과도하게 적응하지 않고 다양한 작업에 대한 모델의 균형 잡힌 다목적 성능을 보장합니다. 또한 실제 시나리오와 더 일치하는 비 전통적인 테이블, 익명 필드 및 복잡한 쿼리를 강조하는 새로운 벤치 마크 인 RealTabbench를 소개하고 부분적으로 발표했습니다.

TableGPT2는 실험에서 최첨단 성능을 달성했지만 LLM을 실제 BI 환경에 배치하는 데 어려움이 있습니다. 연구원들은 미래의 연구 지침에는 다음이 포함된다고 지적했습니다.

도메인 별 코딩 : LLM이 엔터프라이즈 별 도메인 별 언어 (DSL) 또는 의사 코드에 신속하게 적응하여 엔터프라이즈 데이터 인프라의 특정 요구를 더 잘 충족시킬 수 있습니다.

다중 에이전트 설계 : 실제 응용 프로그램의 복잡성을 처리하기 위해 여러 LLM을 통합 시스템에 효과적으로 통합하는 방법을 모색하십시오.

다기능 테이블 처리 : 병합 된 셀 및 엑셀 및 페이지에서 일반적으로 발견되는 불일치 구조와 같은 불규칙성 테이블을 처리하는 모델의 능력을 향상시켜 실제 세계의 다양한 형태로 테이블 데이터를 더 잘 처리합니다.

TableGPT2의 출시는 테이블 데이터 처리에서 LLM의 상당한 진전을 표시하여 비즈니스 인텔리전스 및 기타 데이터 중심 애플리케이션에 새로운 가능성을 제공합니다. 연구가 계속 심화됨에 따라 TableGPT2는 향후 데이터 분석 분야에서 점점 더 중요한 역할을 할 것이라고 생각합니다.

종이 주소 : https://arxiv.org/pdf/2411.02059v1

대체로 TableGPT2는 혁신적인 아키텍처 및 교육 방법으로 여러 벤치 마크에서 눈에 띄는 혁신적인 아키텍처 및 교육 방법으로 테이블 데이터를 처리하는 놀라운 결과를 얻었습니다. 미래의 연구 방향은 실제 비즈니스 인텔리전스 응용 프로그램의 요구를 더 잘 충족시키기 위해 모델의 적응성과 실용성에 계속 중점을 둘 것입니다.