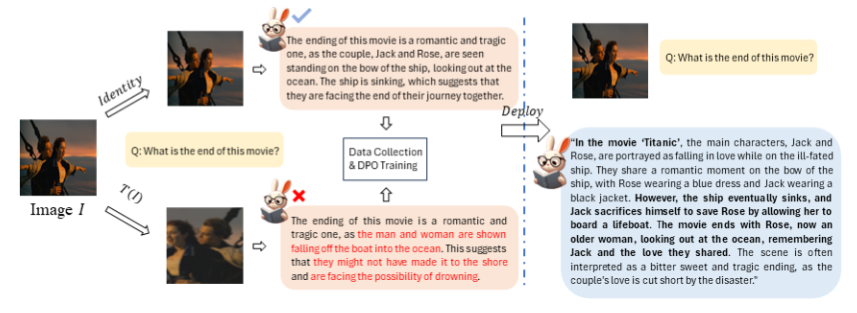

난징 대학교와 Megvii 연구소는 시각적 언어 모델의 선호 정렬 문제를 효과적으로 해결하는 SeVa라는 비지도 시각적 대형 모델 패러다임을 개발하기 위해 협력했습니다. 이 획기적인 기술은 수동 또는 GPT-4 참여가 필요하지 않으며 선호도 데이터를 자동으로 구성하여 정렬 비용을 크게 줄이고 모델의 지시 따르기 능력을 향상시키며 환각을 줄이며 여러 벤치마크 테스트에서 놀라운 결과를 얻었습니다. SeVa의 핵심은 이미지 증강 기술을 사용하여 양성 및 음성 샘플을 생성하고 이를 사용하여 모델을 훈련시켜 궁극적으로 인간 선호도의 효과적인 정렬을 달성하는 것입니다.

이 기술의 핵심은 선호도 정렬 전과 후의 모델 출력을 비교하여 선호도 데이터의 파이프라인을 자동으로 구성하는 것입니다. 연구원들은 작은 이미지 확대라도 VLM이 동일한 질문에 대해 다른 답을 줄 수 있다는 것을 발견했습니다. 따라서 원본 이미지 답변을 양성 샘플로 사용하고 증강 이미지 답변을 음성 샘플로 사용하여 훈련했습니다.

SeVa의 실험 결과는 인상적이다. 8k로 구성된 비지도 데이터만 사용하여 VLM의 지시 따르기 능력이 크게 향상되고 환각이 줄어들었으며 다중 모드 및 기타 벤치마크에서 상당한 개선을 달성했습니다. 더 중요한 것은 이 방법이 간단하고 저렴하며 사람이나 GPT-4 주석이 필요하지 않다는 것입니다.

여러 벤치마크에 대한 테스트 결과에 따르면 SeVa는 시각적 모델의 인간 선호도 정렬을 개선하는 데 상당한 이점이 있는 것으로 나타났습니다. 특히 GPT-4로 평가한 MMVet과 LLaVA-벤치에서는 SeVa의 성능이 특히 뛰어났다. 또한 SeVa는 각 답변의 일관성을 높여 더 길고 자세한 답변을 생성할 수 있으며 다양한 온도의 섭동에 더욱 강력합니다.

이번 연구는 대형 시각적 모델의 정렬 문제에 대한 효과적인 솔루션을 제공할 뿐만 아니라 AI 분야 발전의 새로운 가능성을 열어준다. SeVa의 오픈 소스를 통해 우리는 더 많은 연구자와 개발자가 이 패러다임을 사용하여 향후 AI 기술의 추가 개발을 촉진할 것이라고 예측할 수 있습니다. 무한한 가능성으로 가득한 시대, AI 기술이 가져올 더 많은 놀라움을 기대해 보자.

프로젝트 주소: https://github.com/Kevinz-code/SeVa

SeVa의 오픈 소스는 시각적 대형 모델 기술의 개발을 촉진하고, 연구원과 개발자에게 새로운 도구와 방법을 제공하며, 시각적 AI의 성능과 적용을 더욱 향상시킬 것입니다. 이번 연구의 성공은 AI 정렬 문제를 해결하는 데 있어서 비지도 학습의 큰 잠재력을 보여주고 AI 기술의 미래 발전을 위한 새로운 방향을 제시합니다.