La Universidad de Nanjing y el Instituto de Investigación Megvii colaboraron para desarrollar un paradigma de modelo visual grande no supervisado llamado SeVa, que resuelve eficazmente el problema de la alineación de preferencias de los modelos de lenguaje visual. Esta innovadora tecnología no requiere participación manual o GPT-4. Reduce significativamente los costos de alineación al construir automáticamente datos de preferencia, mejora la capacidad del modelo para seguir instrucciones, reduce las alucinaciones y ha logrado resultados notables en múltiples pruebas de referencia. El núcleo de SeVa es utilizar tecnología de aumento de imágenes para generar muestras positivas y negativas, y utilizarlas para entrenar el modelo, logrando en última instancia una alineación efectiva de las preferencias humanas.

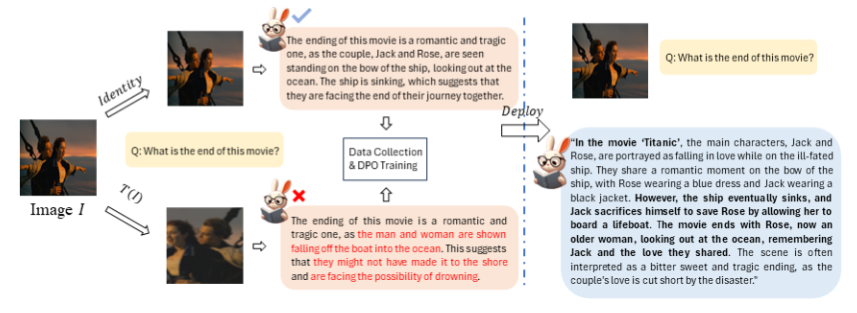

El núcleo de esta tecnología es construir automáticamente una canalización de datos de preferencias. Al comparar el resultado del modelo antes y después de la alineación de preferencias, los cambios se pueden ver claramente. Los investigadores descubrieron que incluso pequeños aumentos de imágenes podrían dar a VLM diferentes respuestas a la misma pregunta. Por lo tanto, utilizaron las respuestas de la imagen original como muestras positivas y las respuestas de la imagen aumentada como muestras negativas para el entrenamiento.

Los resultados experimentales de SeVa son impresionantes. El uso de solo datos no supervisados construidos en 8k ha mejorado significativamente la capacidad de seguimiento de instrucciones de VLM, ha reducido las alucinaciones y ha logrado mejoras significativas en puntos de referencia multimodales y de otro tipo. Más importante aún, este método es simple, de bajo costo y no requiere ninguna anotación humana o GPT-4.

Los resultados de las pruebas en múltiples puntos de referencia muestran que SeVa tiene ventajas significativas para mejorar la alineación de las preferencias humanas de los modelos visuales. Especialmente en los bancos MMVet y LLaVA evaluados por GPT-4, el rendimiento de SeVa es particularmente sobresaliente. Además, SeVa también puede producir respuestas más largas y detalladas, con mayor coherencia en cada respuesta y es más robusto a perturbaciones de diferentes temperaturas.

Esta investigación no solo proporciona una solución eficaz al problema de alineación de grandes modelos visuales, sino que también abre nuevas posibilidades para el desarrollo del campo de la IA. Con el código abierto de SeVa, podemos prever que más investigadores y desarrolladores utilizarán este paradigma para promover un mayor desarrollo de la tecnología de IA en el futuro. En esta era llena de infinitas posibilidades, esperemos más sorpresas que traerá la tecnología de inteligencia artificial.

Dirección del proyecto: https://github.com/Kevinz-code/SeVa

El código abierto de SeVa promoverá el desarrollo de tecnología de modelos visuales de gran tamaño, proporcionará a investigadores y desarrolladores nuevas herramientas y métodos y mejorará aún más el rendimiento y la aplicación de la IA visual. El éxito de esta investigación demuestra el gran potencial del aprendizaje no supervisado para resolver problemas de alineación de la IA y señala una nueva dirección para el desarrollo futuro de la tecnología de la IA.