L'Université de Nanjing et l'Institut de recherche Megvii ont collaboré pour développer un paradigme de grand modèle visuel non supervisé appelé SeVa, qui résout efficacement le problème de l'alignement des préférences des modèles de langage visuel. Cette technologie révolutionnaire ne nécessite pas de participation manuelle ou GPT-4. Elle réduit considérablement les coûts d'alignement en construisant automatiquement des données de préférence, améliore la capacité de suivi des instructions du modèle, réduit les hallucinations et a obtenu des résultats remarquables dans plusieurs tests de référence. Le cœur de SeVa est d’utiliser la technologie d’augmentation d’image pour générer des échantillons positifs et négatifs, et de l’utiliser pour entraîner le modèle, obtenant ainsi un alignement efficace des préférences humaines.

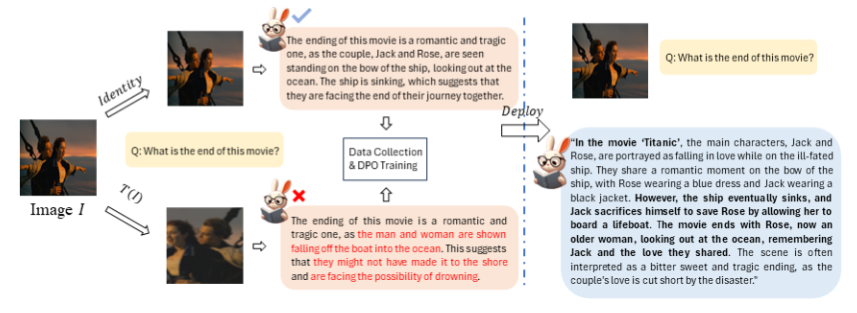

Le cœur de cette technologie est de construire automatiquement un pipeline de données de préférences. En comparant les résultats du modèle avant et après l'alignement des préférences, les changements peuvent être clairement visibles. Les chercheurs ont découvert que même de petites augmentations d’image pouvaient donner à VLM des réponses différentes à la même question. Par conséquent, ils ont utilisé les réponses de l’image originale comme échantillons positifs et les réponses de l’image augmentée comme échantillons négatifs pour la formation.

Les résultats expérimentaux de SeVa sont impressionnants. L'utilisation de seulement 8 000 données non supervisées construites a considérablement amélioré la capacité de suivi des instructions de VLM, réduit les hallucinations et obtenu des améliorations significatives dans les tests multimodaux et autres. Plus important encore, cette méthode est simple, peu coûteuse et ne nécessite aucune annotation humaine ou GPT-4.

Les résultats des tests sur plusieurs benchmarks montrent que SeVa présente des avantages significatifs dans l’amélioration de l’alignement des préférences humaines des modèles visuels. Surtout sur les bancs MMVet et LLaVA évalués par GPT-4, les performances de SeVa sont particulièrement remarquables. De plus, SeVa peut également produire des réponses plus longues et plus détaillées, avec une plus grande cohérence dans chaque réponse, et est plus robuste aux perturbations de différentes températures.

Cette recherche apporte non seulement une solution efficace au problème d’alignement des grands modèles visuels, mais ouvre également de nouvelles possibilités pour le développement du domaine de l’IA. Avec l’open source de SeVa, nous pouvons prévoir que davantage de chercheurs et de développeurs utiliseront ce paradigme pour promouvoir le développement futur de la technologie de l’IA. Dans cette époque pleine de possibilités infinies, attendons avec impatience d’autres surprises apportées par la technologie de l’IA.

Adresse du projet : https://github.com/Kevinz-code/SeVa

L'open source de SeVa favorisera le développement de la technologie visuelle des grands modèles, fournira aux chercheurs et aux développeurs de nouveaux outils et méthodes, et améliorera encore les performances et l'application de l'IA visuelle. Le succès de cette recherche démontre le grand potentiel de l’apprentissage non supervisé pour résoudre les problèmes d’alignement de l’IA et indique une nouvelle direction pour le développement futur de la technologie de l’IA.