このColab Notebookは、ビデオをビデオにクローン化することにより、ディープフェイクビデオを生成するための段階的なガイドを提供します。このプロセスには、ビデオファイルと音声ファイルのアップロード、それらの名前変更、オーディオの抽出、オーディオチャンクの作成、最後にdeepfake生成のためにWAV2LIPを使用することが含まれます。

このノートブックを実行する前に、少なくともビデオファイル(MP4形式)を備えたdeepfakeという名前のGoogleドライブにフォルダーが必要です。音声をクローンするオーディオ(MP3形式)ファイルも含めることを強くお勧めします。特にビデオ内の英語以外の言語の場合は、英語のオーディオファイルもアップロードすることが不可欠です。

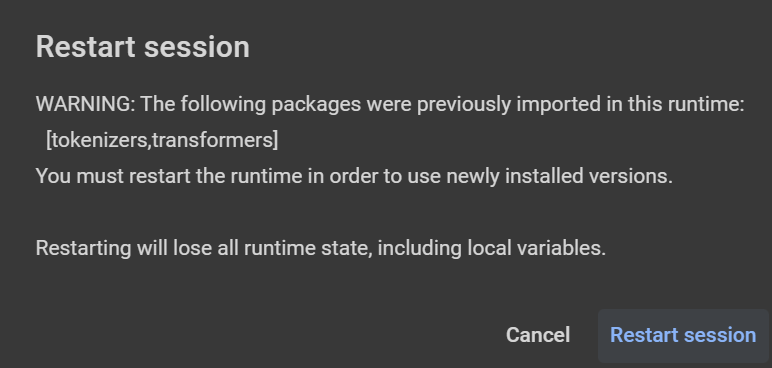

注意:テキストプロンプトは、「|」で分離する必要があります。 1から2つの文(それを読むのに必要な〜20秒ごと)。警告と再起動セッションが提案されている場合(下の図に示すように、ライブラリをインストールした後 - Librosaなど)、「キャンセル」をクリックします。フリーバージョン(15GB VRAMと〜13GB RAMを備えたT4またはV100)では、最大オーディオ/ビデオの持続時間は約50秒(スクリプトを実行して結果を得るのに〜30分かかります)。より長いテキストプロンプトの場合、より大きなGPUが必要です(22.5GB VRAMを備えたL4および40GB VRAMおよび〜84GB RAMを搭載したA100を使用してL4を使用して有料バージョン - 後者はより多くのコンピューテユニット/時間を使用します)。

from google . colab import drive

drive . mount ( '/content/gdrive' )

cd gdrive / MyDrive / deepfakeビデオファイルとオーディオファイルのベースパスを指定します。

base_path = '/content/gdrive/MyDrive/deepfake'TTS、Pydub、およびMoviepyライブラリをインストールします。

!p ip install - q pydub == 0.25 . 1 TTS == 0.22 . 0 moviepy == 1.0 . 3クローンされた声で読まれる英語のテキストを設定します。

text_to_read = "Joining two modalities results in a surprising increase in generalization! \ n What would happen if we combined them all? " アップロードされたオーディオおよびビデオファイルを、それぞれinput_voice.mp3とvideo_full.mp4に変更します。

ビデオのみが提供されている場合は、そこからオーディオを抽出して、個人をクローンするために使用します。

カメの入力として使用される10秒のオーディオを備えたフォルダーを作成します。

オーディオとビデオが同じ期間を確保してください。そうでない場合は、より短いものに一致するように長くトリミングします(または、両方を20秒にカットします)。

wav2lip githubリポジトリのクローン、事前に訓練されたモデルをダウンロードし、依存関係をインストールします。

WAV2LIP Incerenceスクリプトを実行して、DeepFakeビデオを生成します。

一時的なファイルとフォルダーを削除します。