Colab Notebook ini menyediakan panduan langkah demi langkah untuk menghasilkan video Deepfake dengan mengkloning suara ke video. Prosesnya melibatkan pengunggahan file video dan suara, mengganti nama, mengekstraksi audio, membuat potongan audio, dan akhirnya menggunakan WAV2LIP untuk pembuatan DeepFake.

Sebelum menjalankan buku catatan ini, kita perlu memiliki folder di Google Drive kami bernama deepfake dengan setidaknya file video (format MP4). Sangat disarankan untuk juga memasukkan file audio (format MP3) untuk mengkloning suara dari. Khusus untuk kasus bahasa non-Inggris dalam video, penting untuk mengunggah file audio bahasa Inggris juga.

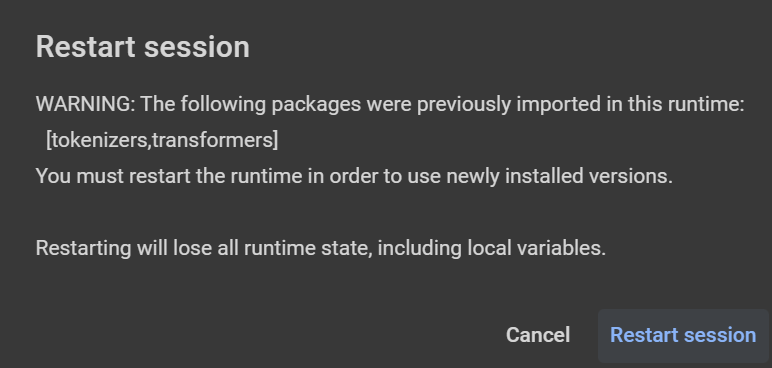

Perhatian: Prompt teks harus dipisahkan dengan '|' Setiap satu hingga dua kalimat (setiap ~ 20 detik yang diperlukan untuk membacanya). Jika Anda mendapatkan peringatan dan restart sesi disarankan (setelah menginstal perpustakaan - misalnya Librosa, seperti yang ditunjukkan pada gambar di bawah), klik 'Batal'. Dalam versi gratis (T4 atau V100 dengan 15GB VRAM dan ~ 13GB RAM) Durasi audio/video maksimum dapat ~ 50 detik (membutuhkan ~ 30 menit untuk menjalankan skrip dan mendapatkan hasil). Untuk permintaan teks yang lebih panjang diperlukan GPU yang lebih besar (versi berbayar menggunakan L4 dengan 22.5GB VRAM dan ~ 63GB RAM atau A100 dengan VRAM 40GB dan ~ 84GB RAM - yang terakhir menggunakan lebih banyak unit/jam komputasi).

from google . colab import drive

drive . mount ( '/content/gdrive' )

cd gdrive / MyDrive / deepfakeTentukan jalur dasar untuk file video dan audio.

base_path = '/content/gdrive/MyDrive/deepfake'Instal perpustakaan TTS, PyDub, dan MoviePy.

!p ip install - q pydub == 0.25 . 1 TTS == 0.22 . 0 moviepy == 1.0 . 3Atur teks bahasa Inggris yang akan dibaca dengan suara yang dikloning.

text_to_read = "Joining two modalities results in a surprising increase in generalization! \ n What would happen if we combined them all? " Ubah nama file audio dan video yang diunggah ke input_voice.mp3 dan video_full.mp4 , masing -masing.

Jika hanya video yang disediakan, ekstrak audio dari itu untuk digunakan untuk mengkloning individu.

Buat folder dengan potongan audio 10 detik untuk digunakan sebagai input dalam kura-kura.

Pastikan audio dan video memiliki durasi yang sama. Jika tidak, rapikan yang lebih panjang agar sesuai dengan yang lebih pendek (atau potong keduanya hingga 20 detik).

Klon WAV2LIP GITHUB Repositori, Unduh model pra-terlatih, dan instal dependensi.

Jalankan skrip inferensi WAV2LIP untuk menghasilkan video DeepFake.

Hapus file dan folder sementara.