Este cuaderno de Colab proporciona una guía paso a paso para generar un video de Deepfake clonando una voz en un video. El proceso implica cargar archivos de video y voz, renombrarlos, extraer audio, crear fragmentos de audio y finalmente usar WAV2LIP para Deepfake Generation.

Antes de ejecutar este cuaderno, necesitamos tener una carpeta en nuestra unidad de Google llamada deepfake con al menos un archivo de video (formato MP4). Se recomienda encarecidamente que también incluya un archivo de audio (formato mp3) para clonar la voz. Especialmente para casos de idioma no inglés en el video, también es esencial cargar un archivo de audio en inglés.

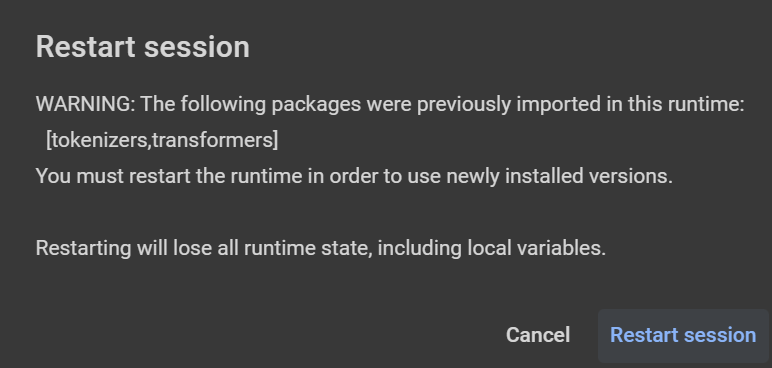

PRECAUCIÓN: el mensaje de texto debe separarse con '|' cada una o dos oraciones (cada ~ 20 segundos se necesitan para leerlo). Si obtiene alguna advertencia y se sugiere una sesión de reinicio (después de instalar una biblioteca, por ejemplo, la biblioteca, como se muestra en la figura a continuación), haga clic en 'Cancelar'. En la versión gratuita (T4 o V100 con 15 GB de VRAM y ~ 13 GB de RAM), la duración máxima de audio/video puede ser de ~ 50 segundos (tarda ~ 30 minutos en ejecutar el script y obtener resultados). Para un mensaje de texto más largo se necesita una GPU más grande (la versión pagada que usa L4 con 22.5GB VRAM y ~ 63 GB de RAM o A100 con VRAM de 40 GB y ~ 84 GB de RAM: este último usa más unidades de cómputo/hora).

from google . colab import drive

drive . mount ( '/content/gdrive' )

cd gdrive / MyDrive / deepfakeEspecifique la ruta base para archivos de video y audio.

base_path = '/content/gdrive/MyDrive/deepfake'Instale las bibliotecas TTS, Pydub y Moviepy.

!p ip install - q pydub == 0.25 . 1 TTS == 0.22 . 0 moviepy == 1.0 . 3Establezca el texto en inglés que se lee con la voz clonada.

text_to_read = "Joining two modalities results in a surprising increase in generalization! \ n What would happen if we combined them all? " Cambie el nombre de los archivos de audio y video cargados a input_voice.mp3 y video_full.mp4 , respectivamente.

Si solo se proporciona un video, extraiga el audio para que se use para clonar al individuo.

Cree una carpeta con trozos de audio de 10 segundos para ser utilizados como entrada en Tortoise.

Asegúrese de que el audio y el video tengan la misma duración. Si no, recorte el más largo para que coincida con el más corto (o córtelos a ambos a 20 segundos).

Repositorio de GitHub Wav2Lip Clone, descargue modelos previamente capacitados e instalar dependencias.

Ejecute el script de inferencia WAV2LIP para generar el video DeepFake.

Eliminar archivos y carpetas temporales.