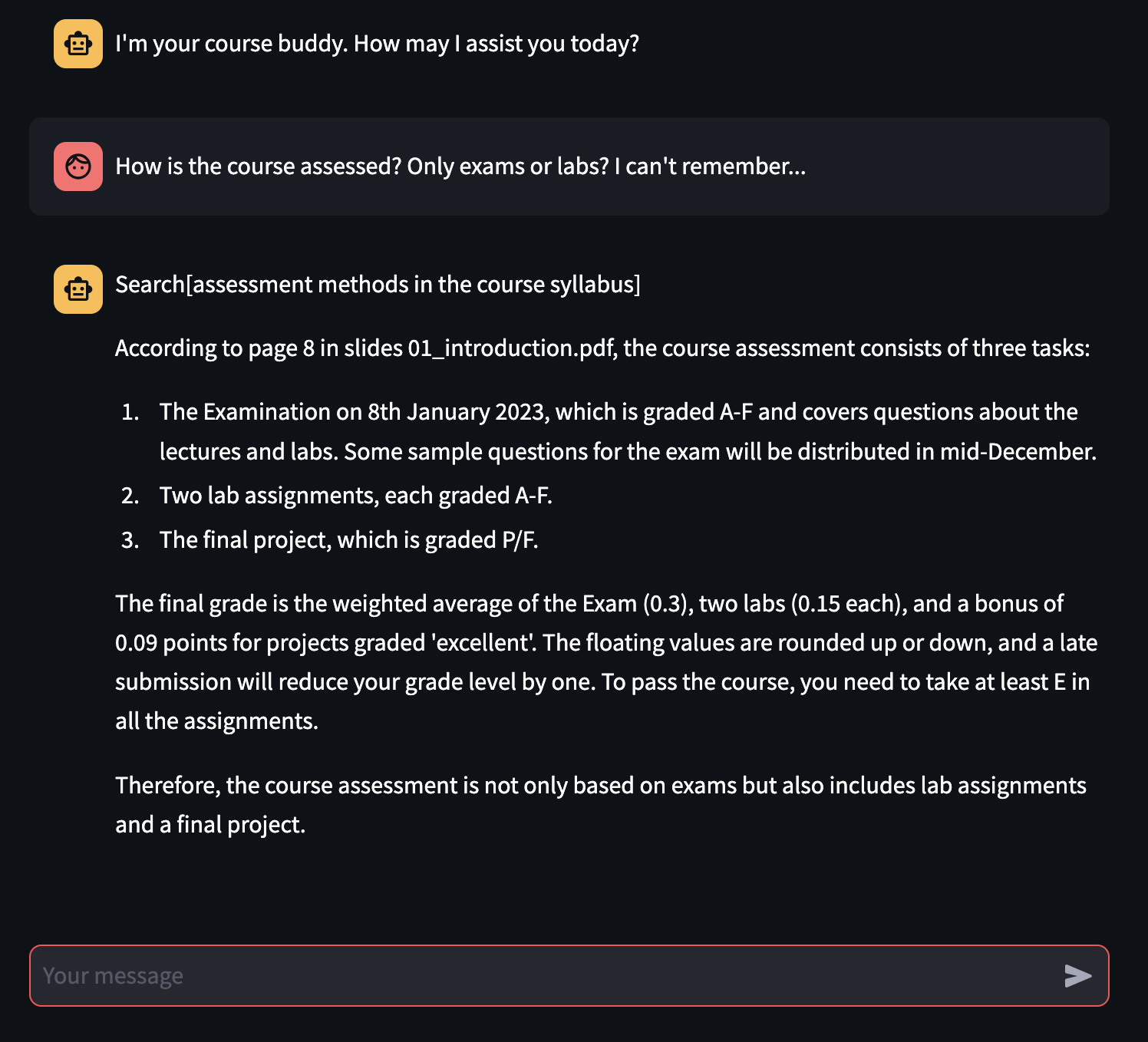

Saat mempersiapkan ujian universitas, memiliki pasangan telah terbukti penting untuk menemukan kesenjangan pengetahuan dan mengklarifikasi keraguan spesifik tentang topik yang diperlakukan selama kelas. Sementara chatbots berdasarkan LLM seperti ChatGPT, Phind dan Clod sudah memberikan bantuan kepada siswa, mereka tidak dapat memberikan bantuan kuliah/material pada kursus universitas siswa. Kami mengusulkan untuk membuat sistem untuk menyempurnakan chatbots pada materi tertentu dari kursus tertentu. Berkat ini, kami akan membuat teman belajar untuk kursus mahasiswa yang khas, dapat menjawab keraguan, menghasilkan pertanyaan dan banyak lagi!

Dimungkinkan untuk menguji chatbot di tautan ini.

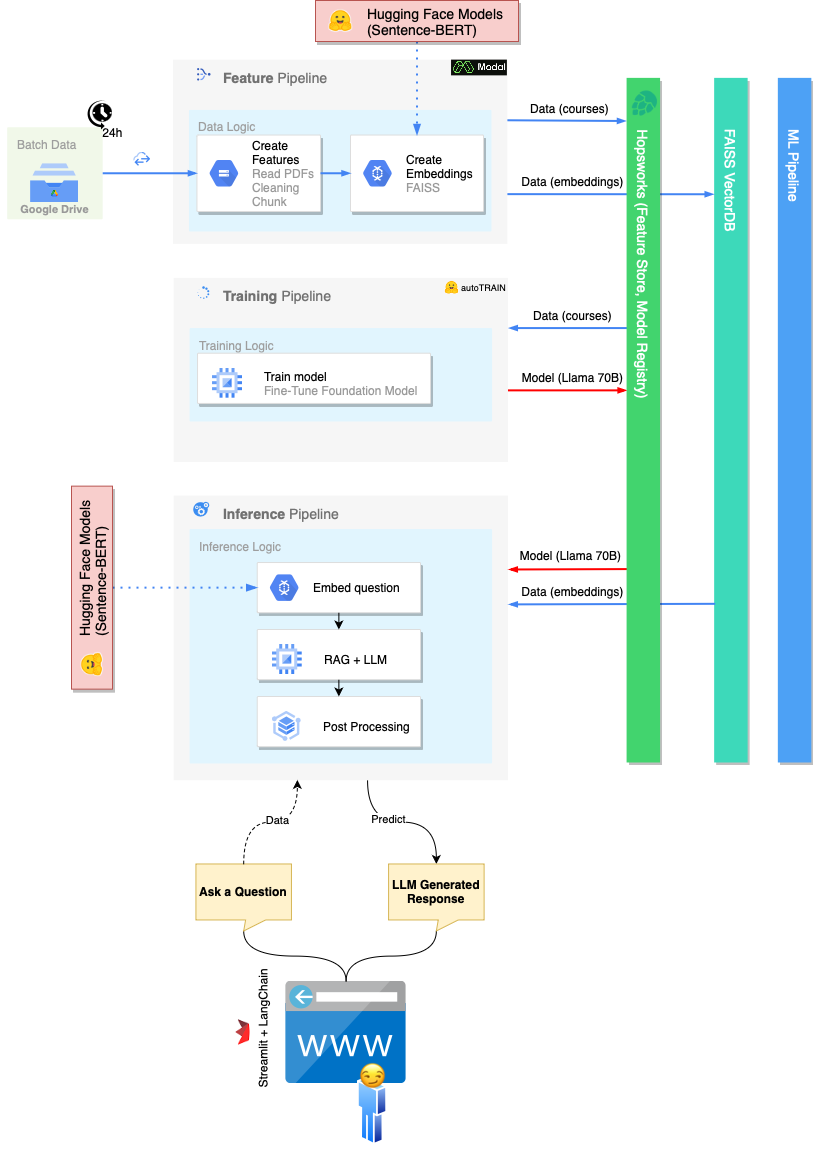

Ruang lingkup implisit dari proyek (dan dari seluruh kursus) adalah membangun infrastruktur yang dapat diskalakan yang dapat meng -host MLOPS kami. Untuk alasan ini, pipa ML monolitik tradisional dibagi menjadi tiga proses yang berbeda: pipa fitur , pipa pelatihan , pipa inferensi .

Pipa fitur bertanggung jawab atas:

Ada beberapa opsi untuk menjalankan pipa fitur:

FeaturePipeline/Reading.ipynbFeaturePipeline/FeaturePipeline.py menggunakan python3 FeaturePipeline/FeaturePipeline.py Salinan yang terakhir sedikit dimodifikasi dalam file FeaturePipeline/FeaturePipeline_modal.py untuk membuatnya dapat dijalankan pada layanan hosting modal menggunakan modal [run|deploy] FeaturePipeline/FeaturePipeline.py

Pipa pelatihan bertanggung jawab atas:

Untuk menjalankan pipa pelatihan, jalankan notebook TrainingPipeline/FineTuning.ipynb

Pipa inferensi bertanggung jawab atas:

Untuk menjalankan pipa inferensi, jalankan streamlit run chatbot_app.py

Sementara secara eksperimental proses penyempurnaan tidak cukup untuk membuat model dasar secara konsisten lebih baik daripada yang tidak disesuaikan dengan baik, chatbot yang diaktifkan RAG tidak hanya dapat menjawab pertanyaan pengguna dengan benar mengikuti materi asli, tetapi juga dapat memberikan (kebanyakan) referensi yang benar dari mana jawabannya diambil, fitur penting untuk pelajaran siswa untuk sebuah contoh universitas!

Tuning fine tidak berfungsi sebaik yang dimaksudkan karena kurangnya bahan yang digunakan dan sumber daya komputasi. Sebagai pekerjaan di masa depan, kami ingin meningkatkan proses ekstraksi pengetahuan dan menggunakan lebih banyak kekuatan komputasi untuk mengatasi masalah yang ditunjukkan dalam laporan.