Yunqing Zhao * , Keshigeyan Chandrasegaran * , Milad Abdollahzadeh * , Ngai -Man Cheung †

Universitas Teknologi dan Desain Singapura

Neurips 2022, Ernest N. Morial Convention Center, New Orleans, LA, USA. * Kontribusi yang sama

[Halaman proyek] [poster] [slide] [kertas]

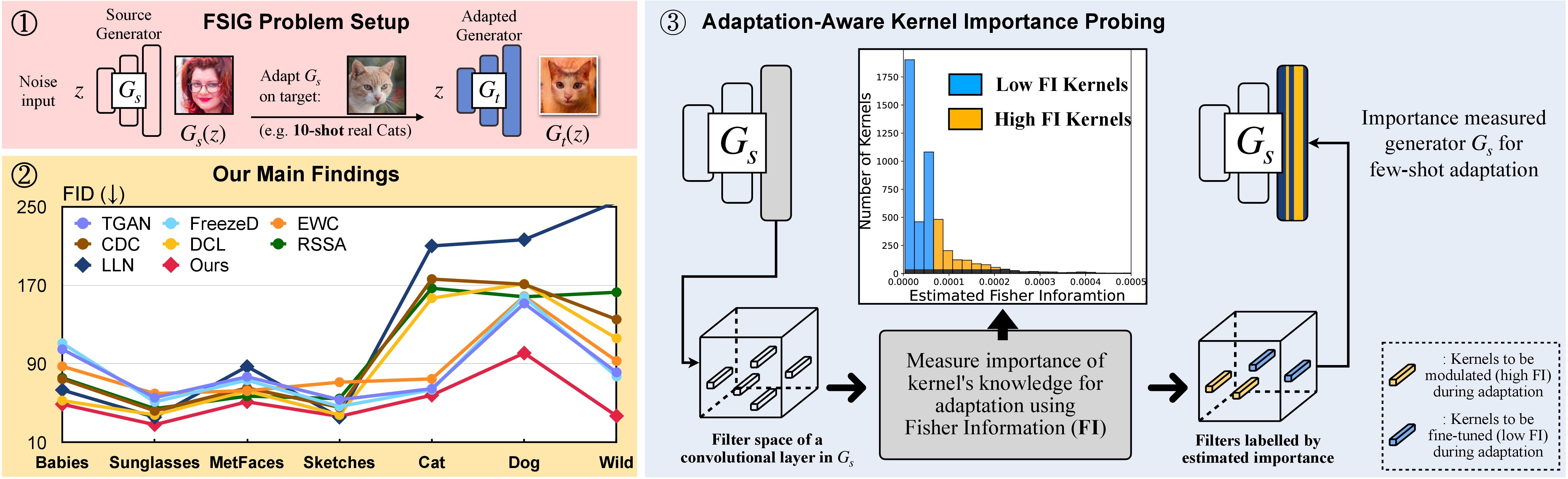

In this research, we propose Adaptation-Aware Kernel Modulation (AdAM) for few-shot image generation, that aims to identify kernels in source GAN important for target adaptation.

The model can perform GAN adaptation using very few samples from target domains with different proximity to the source.

Atau, lingkungan Conda yang cocok bernama adam dapat dibuat dan diaktifkan dengan:

git clone https://github.com/yunqing-me/AdAM.git

conda env create -f environment.yml

conda activate adam

cd AdAM

Kami menganalisis hubungan domain target sumber ↦ dalam SEC. 3 (dan Tambahan). Lihat di bawah untuk langkah -langkah terkait dalam analisis ini.

Langkah 1. git clone https://github.com/rosinality/stylegan2-pytorch.git

Langkah 2. Pindahkan ./visualization ke ./stylegan2-pytorch

Langkah 3. Lalu, lihat kode visualisasi di ./visualization .

Siapkan Dataset Pelatihan beberapa-tembakan menggunakan format LMDB

Misalnya, unduh set target 10-shot, Babies (tautan) dan AFHQ-Cat (tautan), dan atur direktori Anda sebagai berikut:

10-shot-{babies/afhq_cat}

└── images

└── image-1.png

└── image-2.png

└── ...

└── image-10.png

Kemudian, ubah ke format LMDB:

python prepare_data.py --input_path [your_data_path_of_{babies/afhq_cat}] --output_path ./_processed_train/[your_lmdb_data_path_of_{babies/afhq_cat}]

Siapkan seluruh dataset target untuk evaluasi

Misalnya, unduh seluruh dataset, Babies (tautan) dan AFHQ-Cat (tautan), dan atur direktori Anda sebagai berikut:

entire-{babies/afhq_cat}

└── images

└── image-1.png

└── image-2.png

└── ...

└── image-n.png

Kemudian, ubah ke format LMDB untuk evaluasi

python prepare_data.py --input_path [your_data_path_of_entire_{babies/afhq_cat}] --output_path ./_processed_test/[your_lmdb_data_path_of_entire_{babies/afhq_cat}]

Unduh Model GAN Pretrained di FFHQ dari sini. Kemudian, simpan ke ./_pretrained/style_gan_source_ffhq.pt .

Menghasilkan input noise Gaussian secara acak (dimensi yang sama dengan input ke generator) untuk probing yang penting, simpan untuk ./_noise/ :

python noise_generation.py

bash _bash_importance_probing.sh Kita dapat memperoleh informasi fisher yang diperkirakan dari kernel yang dimodulasi dan akan disimpan di ./_output_style_gan/args.exp/checkpoints/filter_fisher_g.pt dan ./_output_style_gan/args.exp/checkpoints/filter_fisher_d.pt

# you can tune hyperparameters here

bash _bash_main_adaptation.sh Dinamika pelatihan dan hasil evaluasi akan ditampilkan di wandb

Kami mencatat bahwa, idealnya langkah 1. dan langkah 2. Dapat digabungkan bersama. Di sini, untuk kesederhanaan kami menggunakan dua langkah sebagai demonstrasi.

Gunakan Bayi dan AFHQ-CAT sebagai contoh: Unduh gambar dari sini, lalu pindahkan folder yang belum di-zip ke ./cluster_center , lalu lihat Evaluator di AdAM_main_adaptation.py .

Perkiraan informasi Fisher (yaitu, output dari probing penting) dan bobot (yaitu, output dari adaptasi utama yang sesuai dengan Gambar 4 di koran utama) dapat ditemukan di sini.

Kami menyediakan semua gambar dan model target 10-shot yang digunakan dalam kertas utama dan tambahan kami. Anda juga dapat beradaptasi dengan gambar lain yang dipilih sendiri.

Sumber Gan:

Sampel target: tautan

Ikuti bagian percobaan dalam repo ini dan Anda dapat menghasilkan hasil yang disesuaikan.

Jika Anda menemukan proyek ini berguna dalam penelitian Anda, silakan pertimbangkan mengutip makalah kami:

@inproceedings{zhao2022fewshot,

title={Few-shot Image Generation via Adaptation-Aware Kernel Modulation},

author={Yunqing Zhao and Keshigeyan Chandrasegaran and Milad Abdollahzadeh and Ngai-man Cheung},

booktitle={Advances in Neural Information Processing Systems},

editor={Alice H. Oh and Alekh Agarwal and Danielle Belgrave and Kyunghyun Cho},

year={2022},

url={https://openreview.net/forum?id=Z5SE9PiAO4t}

}

Sementara itu, kami juga menunjukkan penelitian yang relevan yang bertujuan untuk mengidentifikasi dan menghapus pengetahuan yang tidak kompatibel (Rick, CVPR-2023) untuk beberapa pembuatan gambar beberapa shot:

@inproceedings{zhao2023exploring,

title={Exploring incompatible knowledge transfer in few-shot image generation},

author={Zhao, Yunqing and Du, Chao and Abdollahzadeh, Milad and Pang, Tianyu and Lin, Min and Yan, Shuicheng and Cheung, Ngai-Man},

booktitle={Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition},

pages={7380--7391},

year={2023}

}

Kami menghargai implementasi dasar yang luar biasa dari StyleGan-V2 dari @rosinality. Kami berterima kasih kepada @mseitzer, @ojha dan @richzhang atas implementasi mereka pada skor FID dan intra-lpips.

Kami juga berterima kasih atas alat pelatihan dan evaluasi yang berguna yang digunakan dalam pekerjaan ini, dari @miaoyun.