Dans le domaine de l'intelligence artificielle, le développement de modèles de grandes langues (LLM) change chaque jour qui passe. L'équipe de recherche de l'Université Carnegie Mellon (CMU) et HuggingFace ont récemment proposé une approche innovante appelée "Meta Renfort Finedinging" (MRT). Cette technique vise à optimiser l'efficacité de calcul des modèles de grands langues pendant la phase de test, en particulier lorsqu'il s'agit de tâches d'inférence complexes.

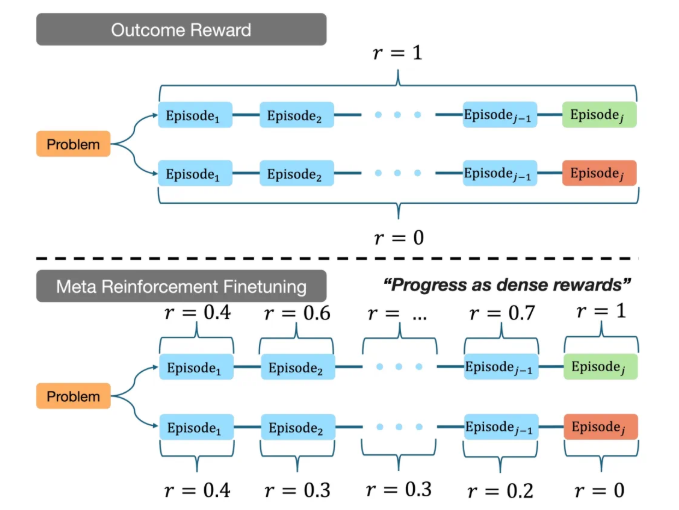

La recherche montre que les modèles de grande langue existants consomment souvent de nombreuses ressources informatiques au cours du processus d'inférence, tandis que l'objectif de MRT est d'aider le modèle à trouver des réponses plus efficacement dans un budget informatique limité. Cette méthode réalise un équilibre entre l'exploration et l'utilisation en segmentant la sortie du modèle grand langage en plusieurs fragments. Grâce à une analyse approfondie des données de formation, le MRT permet au modèle d'utiliser pleinement des informations connues lorsqu'ils sont confrontés à des problèmes inconnus et à explorer de nouvelles stratégies de résolution de problèmes.

Dans les expériences de l'équipe CMU, le modèle a été affiné à l'aide de MRT a très bien fonctionné dans plusieurs repères d'inférence. Par rapport aux résultats traditionnels récompenses l'apprentissage du renforcement (GRPO), la précision du MRT est 2 à 3 fois plus élevée, tandis que 1,5 fois plus élevé dans l'efficacité d'utilisation des jetons. Ce résultat montre que le MRT peut non seulement améliorer la capacité d'inférence du modèle, mais aussi réduire considérablement la consommation de ressources informatiques, ce qui la rend plus compétitive dans les applications pratiques.

En outre, l'équipe de recherche a également proposé des méthodes pour évaluer efficacement les performances des modèles d'inférence existants, fournissant une référence importante pour les recherches futures. Cette réalisation démontre non seulement le potentiel de la MRT, mais souligne également la direction du développement de modèles de gros langues dans des scénarios d'application plus complexes.

Grâce à cette innovation, l'équipe de recherche de CMU et HuggingFace a franchi une étape importante dans la promotion du champ de pointe de la technologie de l'intelligence artificielle, l'autonomisation des machines avec des capacités de raisonnement plus fortes et la pose d'une base solide pour les applications plus intelligentes à l'avenir.

Adresse du projet: https://cohenqu.github.io/mrt.github.io/