Sitio web | Docios | Tutoriales | Parque infantil | Blog | Discordia

NOS es un servidor de inferencia de Pytorch rápido y flexible que se ejecuta en cualquier nube o AI HW.

inf2 ).Recomendamos encarecidamente que vaya a nuestra guía QuickStart para comenzar. Para instalar el cliente NOS, puede ejecutar el siguiente comando:

conda create -n nos python=3.8 -y

conda activate nos

pip install torch-nos Una vez que se instala el cliente, puede iniciar el servidor NOS a través de la CLI NOS serve . Esto detectará automáticamente su entorno local, descargue la imagen de tiempo de ejecución de Docker y gire el servidor NOS:

nos serve up --http --logging-level INFO ¡Ahora está listo para ejecutar su primera solicitud de inferencia con NOS! Puede ejecutar cualquiera de los siguientes comandos para probar las cosas. Puede establecer el nivel de registro en DEBUG si desea información más detallada del servidor.

NOS proporciona un servidor compatible con OpenAI con soporte de transmisión para que pueda conectar su cliente LLM compatible con OpenAI favorito para hablar con NOS.

API de GRPC ⚡

from nos . client import Client

client = Client ()

model = client . Module ( "TinyLlama/TinyLlama-1.1B-Chat-v1.0" )

response = model . chat ( message = "Tell me a story of 1000 words with emojis" , _stream = True )API REST

curl

-X POST http://localhost:8000/v1/chat/completions

-H " Content-Type: application/json "

-d ' {

"model": "TinyLlama/TinyLlama-1.1B-Chat-v1.0",

"messages": [{

"role": "user",

"content": "Tell me a story of 1000 words with emojis"

}],

"temperature": 0.7,

"stream": true

} 'Construye bots de discordia de mediana edad en segundos.

API de GRPC ⚡

from nos . client import Client

client = Client ()

sdxl = client . Module ( "stabilityai/stable-diffusion-xl-base-1-0" )

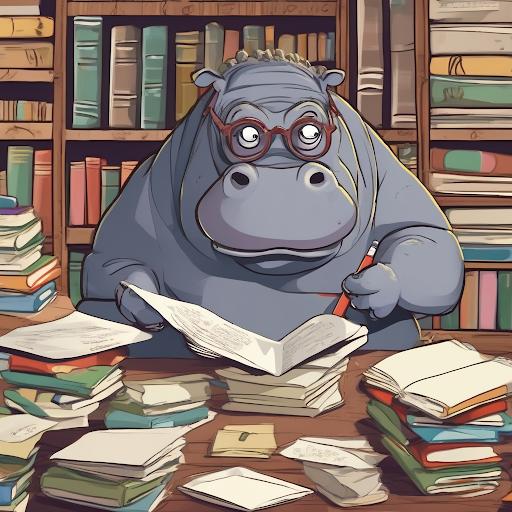

image , = sdxl ( prompts = [ "hippo with glasses in a library, cartoon styling" ],

width = 1024 , height = 1024 , num_images = 1 )API REST

curl

-X POST http://localhost:8000/v1/infer

-H ' Content-Type: application/json '

-d ' {

"model_id": "stabilityai/stable-diffusion-xl-base-1-0",

"inputs": {

"prompts": ["hippo with glasses in a library, cartoon styling"],

"width": 1024, "height": 1024,

"num_images": 1

}

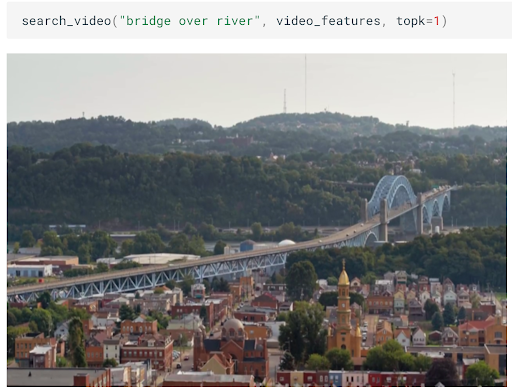

} 'Construya búsqueda semántica escalable de imágenes/videos en minutos.

API de GRPC ⚡

from nos . client import Client

client = Client ()

clip = client . Module ( "openai/clip-vit-base-patch32" )

txt_vec = clip . encode_text ( texts = [ "fox jumped over the moon" ])API REST

curl

-X POST http://localhost:8000/v1/infer

-H ' Content-Type: application/json '

-d ' {

"model_id": "openai/clip-vit-base-patch32",

"method": "encode_text",

"inputs": {

"texts": ["fox jumped over the moon"]

}

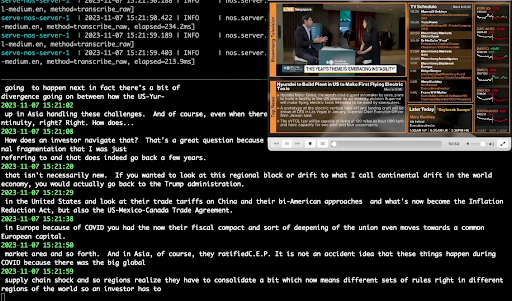

} 'Realice la transcripción de audio en tiempo real usando Whisper.

API de GRPC ⚡

from pathlib import Path

from nos . client import Client

client = Client ()

model = client . Module ( "openai/whisper-small.en" )

with client . UploadFile ( Path ( "audio.wav" )) as remote_path :

response = model ( path = remote_path )

# {"chunks": ...}API REST

curl

-X POST http://localhost:8000/v1/infer/file

-H ' accept: application/json '

-H ' Content-Type: multipart/form-data '

-F ' model_id=openai/whisper-small.en '

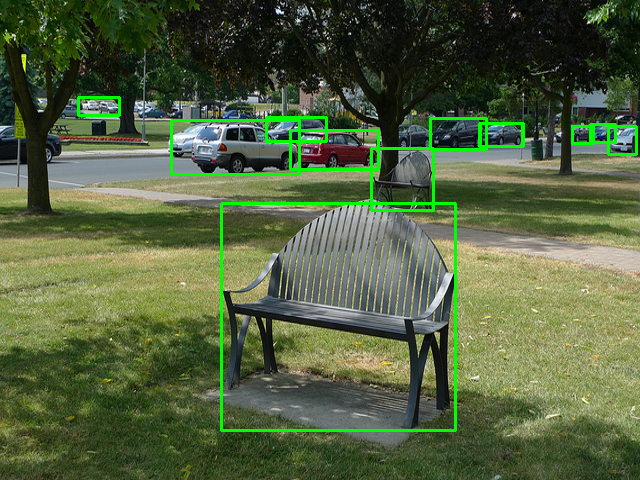

-F ' [email protected] 'Ejecute tareas clásicas de visión por computadora en 2 líneas de código.

API de GRPC ⚡

from pathlib import Path

from nos . client import Client

client = Client ()

model = client . Module ( "yolox/medium" )

response = model ( images = [ Image . open ( "image.jpg" )])API REST

curl

-X POST http://localhost:8000/v1/infer/file

-H ' accept: application/json '

-H ' Content-Type: multipart/form-data '

-F ' model_id=yolox/medium '

-F ' [email protected] '¿Quieres ejecutar modelos no compatibles con NOS? Puede agregar fácilmente sus propios modelos siguiendo los ejemplos en el patio de juegos de NOS.

Este proyecto tiene licencia bajo la licencia Apache-2.0.

NOS recopila datos de uso anónimo usando Sentry. Esto se usa para ayudarnos a comprender cómo la comunidad está utilizando NOS y para ayudarnos a priorizar las características. Puede optar por no participar en la telemetría configurando NOS_TELEMETRY_ENABLED=0 .

¡Agradecemos las contribuciones! Consulte nuestra guía de contribución para obtener más información.