For those enquiring about how to extract visual and audio features, please check this out: https://github.com/soujanyaporia/MUStARD

| تاريخ | الإعلانات |

|---|---|

| 10/03/2024 | إذا كنت مهتمًا بـ IQ Testing LLMS ، تحقق من عملنا الجديد: Algopuzzlevqa |

| 03/08/2021 | ؟ ؟ لقد أصدرنا مجموعة بيانات جديدة M2H2: مجموعة بيانات هندية متعددة الوسائط متعددة الوسائط للتعرف على الفكاهة في المحادثات. تحقق من ذلك: M2H2. يتم إنشاء خطوط الأساس لمجموعة بيانات M2H2 استنادًا إلى Dialoguernn و BCLSTM. |

| 18/05/2021 | ؟ ؟ لقد أصدرنا ريبو جديد يحتوي على نماذج لحل مشكلة العاطفة تسبب التعرف في المحادثات. تحقق من ذلك: استخراج العاطفة. بفضل Pengfei Hong لتجميع هذا. |

| 24/12/2020 | ؟ ؟ هل أنت مهتم بموضوع التعرف على أسباب العاطفة في المحادثات؟ لقد أصدرنا للتو مجموعة بيانات لهذا الغرض. توجه إلى https://github.com/declare-lab/reccon. |

| 06/10/2020 | ؟ ؟ ورقة جديدة وسوتا في التعرف على العاطفة في المحادثات. الرجوع إلى الدليل الكوني للرمز. اقرأ الورقة - الكونية: المعرفة المنطقية لتحديد العاطفة في المحادثات. |

| 30/09/2020 | تم إصدار ورقة جديدة وخطوط الأساس في فهم الحوار على مستوى الكلام. اقرأ فهم الحوار على مستوى الكلام الورقي: دراسة تجريبية. شوكة الرموز. |

| 26/07/2020 | تم إصدار رمز حوار جديد. يرجى زيارة https://github.com/declare-lab/conv-emotion/tree/master/dialoguegcn-mianzhang. كل الفضل يذهب إلى ميان تشانغ (https://github.com/mianzhang/) |

| 11/07/2020 | هل أنت مهتم بقراءة الأوراق على ERC أو المهام ذات الصلة مثل اكتشاف السخرية في المحادثات؟ قمنا بتجميع قائمة قراءة شاملة للأوراق. يرجى زيارة https://github.com/declare-lab/awesome-emotion-recognition-in-in-conversations |

| 07/06/2020: | سيتم إصدار نتائج جديدة على أحدث حالات لمهمة ERC قريبًا. |

| 07/06/2020: | سيتم الحفاظ على ريبو conv-emotion على https://github.com/declare-lab/ |

| 22/12/2019: | تم إصدار كود لـ DialogueGCN. |

| 11/10/2019: | ورقة جديدة: نقل المحادثة التعلم للتعرف على العاطفة. |

| 09/08/2019: | ورقة جديدة عن التعرف على العاطفة في المحادثة (ERC). |

| 06/03/2019: | تم إصدار ميزات ورموز لتدريب Dialoguernn على مجموعة بيانات MELD. |

| 20/11/2018: | تم إصدار النسخة الشاملة من Icon و Dialoguernn. |

Cosmic هو أفضل نموذج أداء في هذا الريبو ويرجى زيارة الروابط أدناه لمقارنة النماذج على مجموعات بيانات ERC المختلفة.

يحتوي هذا المستودع على تطبيقات للعديد من التعرف على العاطفة في أساليب المحادثات وكذلك خوارزميات للتعرف على العاطفة في المحادثات:

على عكس نماذج الكشف عن المشاعر الأخرى ، تعتبر هذه التقنيات الدول الحزبية والتبعيات بين الأحزاب لنمذجة سياق المحادثة ذات الصلة بالتعرف على العاطفة. الغرض الأساسي من كل هذه التقنيات هو ما قبل نموذج الكشف عن العاطفة لتوليد الحوار التعاطف.

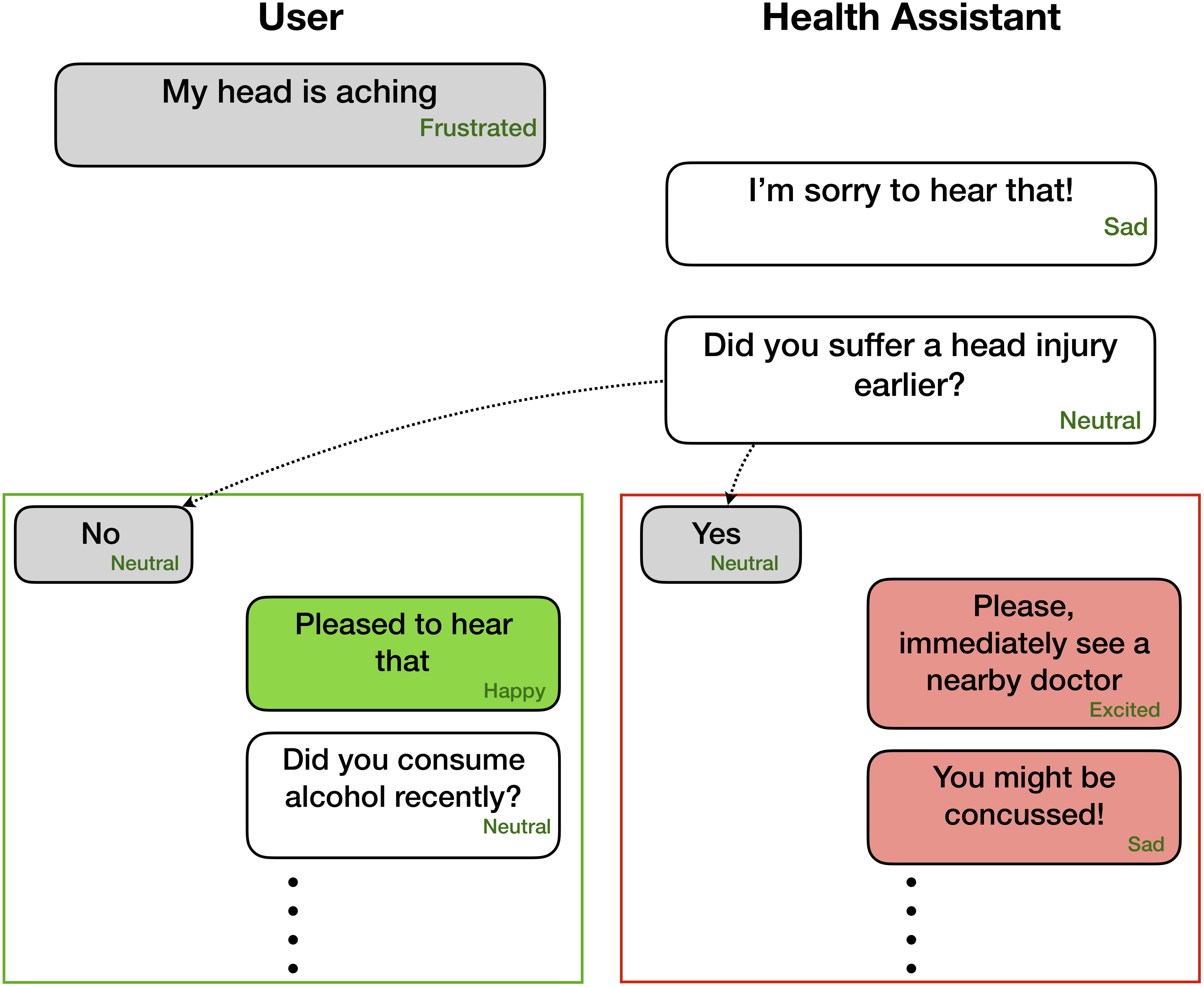

يمكن أن يكون التعرف على العاطفة مفيدًا جدًا لتوليد الحوار العاطفي والعاطفي -

تتوقع هذه الشبكات تسمية العاطفة/المشاعر ومعلومات المتحدث لكل كلام موجود في حوار مثل

Party 1: I hate my girlfriend (angry)

Party 2: you got a girlfriend?! (surprise)

Party 1: yes (angry)

ومع ذلك ، يمكن إدراك الرمز لأداء المهام التي تتوفر فيها الكلام السابق فقط ، دون تسمياتها المقابلة ، حيث أن السياق والهدف هو تسمية الكلام الحالي/الهدف فقط. على سبيل المثال ، السياق هو

Party 1: I hate my girlfriend

Party 2: you got a girlfriend?!

الهدف هو

Party 1: yes (angry)

حيث تكون العاطفة المستهدفة غاضبة . علاوة على ذلك ، يمكن أيضًا تشكيل هذا الرمز لتدريب الشبكة بطريقة شاملة. سندفع هذه التغييرات المفيدة قريبًا.

| طُرق | IEMOCAP | DailyDialog | تخيل | emorynlp | |||

|---|---|---|---|---|---|---|---|

| W-AVG F1 | ماكرو F1 | Micro F1 | W-AVG F1 (3-CLS) | W-AVG F1 (7-CLS) | W-AVG F1 (3-CLS) | W-AVG F1 (7-CLS) | |

| روبرتا | 54.55 | 48.20 | 55.16 | 72.12 | 62.02 | 55.28 | 37.29 |

| روبرتا الحوار | 64.76 | 49.65 | 57.32 | 72.14 | 63.61 | 55.36 | 37.44 |

| روبرتا كوزميتش | 65.28 | 51.05 | 58.48 | 73.20 | 65.21 | 56.51 | 38.11 |

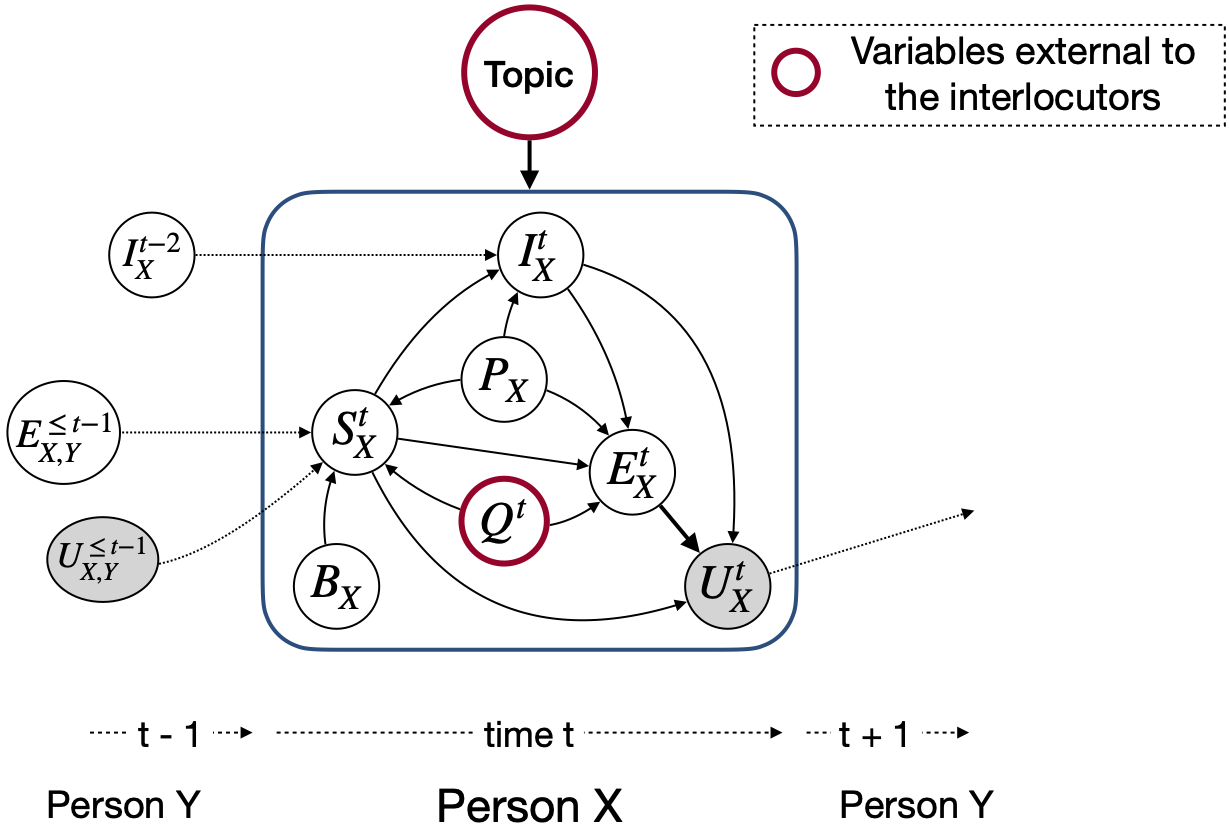

يعالج Cosmic مهمة التعرف على مستوى الكلام في المحادثات باستخدام المعرفة المنطقية. إنه إطار جديد يتضمن عناصر مختلفة من المنطقية مثل الحالات العقلية والأحداث والعلاقات السببية ، وبناءها لتعلم التفاعلات بين المحاورين المشاركين في محادثة. غالبًا ما تواجه الأساليب الحديثة في كثير من الأحيان صعوبات في انتشار السياق ، واكتشاف تحول العاطفة ، والتمييز بين فئات العاطفة ذات الصلة. من خلال تعلم التمثيلات المنطقية المتميزة ، يعالج Cosmic هذه التحديات ويحقق نتائج جديدة على أحدث حالات التعرف على العاطفة على أربع مجموعات بيانات محادثة مختلفة.

قم أولاً بتنزيل ميزات Roberta و Colet هنا واحتفظ بها في الدلائل المناسبة في COSMIC/erc-training . ثم يجب القيام بالتدريب والتقييم على مجموعات البيانات الأربعة على النحو التالي:

python train_iemocap.py --active-listenerpython train_dailydialog.py --active-listener --class-weight --residualpython train_meld.py --active-listener --attention simple --dropout 0.5 --rec_dropout 0.3 --lr 0.0001 --mode1 2 --classify emotion --mu 0 --l2 0.00003 --epochs 60python train_meld.py --active-listener --class-weight --residual --classify sentimentpython train_emorynlp.py --active-listener --class-weight --residualpython train_emorynlp.py --active-listener --class-weight --residual --classify sentimentيرجى الاستشهاد بالورقة التالية إذا وجدت هذا الرمز مفيدًا في عملك.

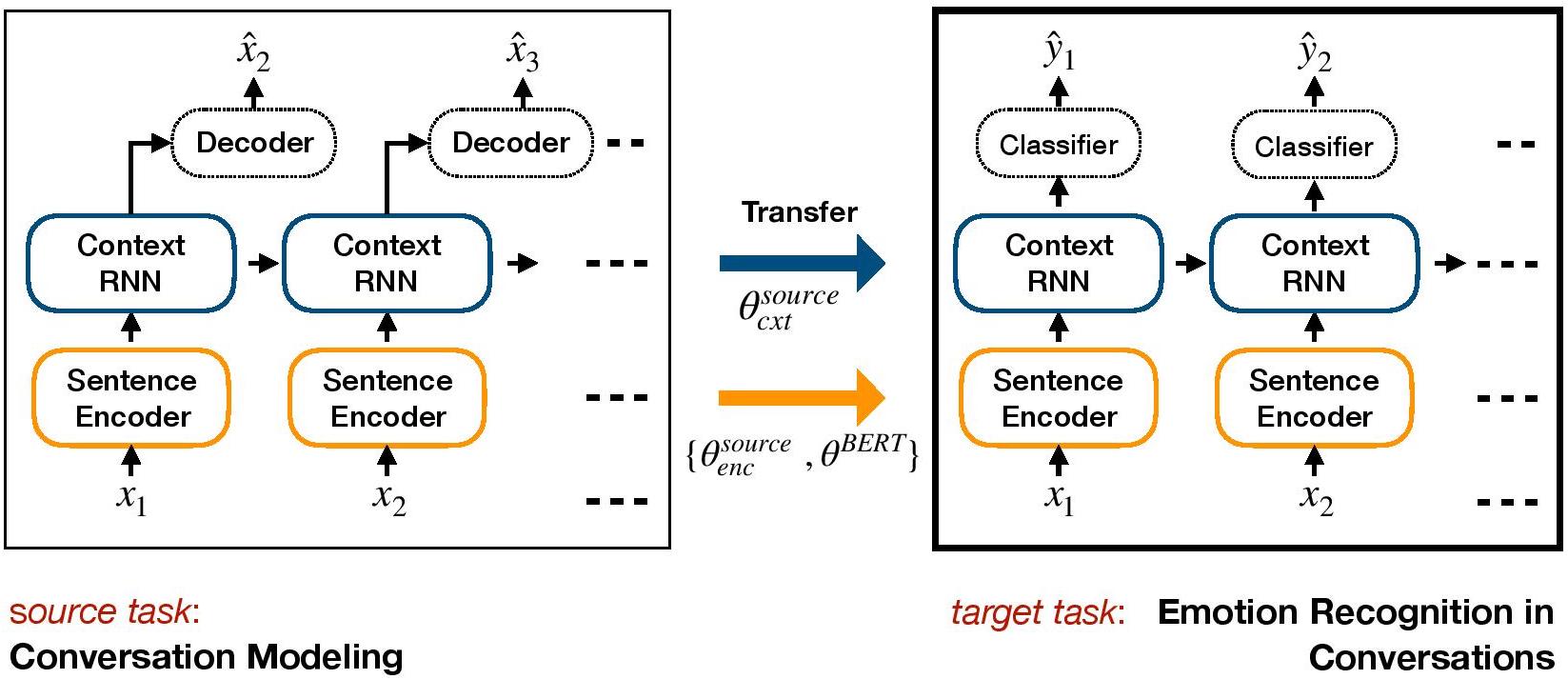

COSMIC: COmmonSense knowledge for eMotion Identification in Conversations. D. Ghosal, N. Majumder, A. Gelbukh, R. Mihalcea, & S. Poria. Findings of EMNLP 2020.TL-ERC هو إطار عمل قائم على التعلم لـ ERC. يدرب مسبقًا نموذج حوار توليني وينقل الأوزان على مستوى السياق التي تتضمن المعرفة العاطفية في النموذج التمييزي المستهدف لـ ERC.

إعداد بيئة مع كوندا:

conda env create -f environment.yml

conda activate TL_ERC

cd TL_ERC

python setup.py قم بتنزيل ملفات مجموعة البيانات IEMOCAP و DailyDialog وتخزينها في ./datasets/ .

قم بتنزيل أوزان HRED التي تم تدريبها مسبقًا على مجموعات بيانات Cornell و Ubuntu وتخزينها في ./generative_weights/

[اختياري]: لتدريب أوزان توليدية جديدة من نماذج الحوار ، راجع https://github.com/ctr4si/a-hierarchical-latent-tructure-for-variational-conversation-modeling.

cd bert_modelpython train.py --load_checkpoint=../generative_weights/cornell_weights.pkl --data=iemocap .cornell إلى ubuntu و iemocap إلى dailydialog لمجموعات مجموعات البيانات الأخرى.load_checkpoint لتجنب تهيئة الأوزان السياقية.configs.pypython iemocap_preprocess.py . وبالمثل ل dailydialog .يرجى الاستشهاد بالورقة التالية إذا وجدت هذا الرمز مفيدًا في عملك.

Conversational transfer learning for emotion recognition. Hazarika, D., Poria, S., Zimmermann, R., & Mihalcea, R. (2020). Information Fusion.DialogueGCN (الشبكة التلافيفية الرسم البياني للحوار) ، هو نهج رسم بياني يعتمد على الشبكة العصبية لـ ERC. نحن نستفيد من الاعتماد على الذات والمكبرات المحمولة للمحاورين لنمذجة سياق المحادثة للتعرف على العاطفة. من خلال شبكة الرسم البياني ، يعالج DialogueGCN مشكلات نشر السياق في الأساليب الحالية المستندة إلى RNN. DialogueGCN مناسب بشكل طبيعي للحوارات متعددة الأحزاب.

ملحوظة : تقوم Pytorch الهندسية بالاستخدام الثقيل للعمليات الذرية CUDA وهو مصدر لغير الحتام. لإعادة إنتاج النتائج المذكورة في الورقة ، نوصي باستخدام أمر التنفيذ التالي. لاحظ أن هذا البرنامج النصي سوف يتم تنفيذه في وحدة المعالجة المركزية. لقد قمنا بتفكيك متوسط درجات F1 الموزونة من 64.67 في جهازنا و 64.44 في Google Colaboratory لمجموعة بيانات IEMOCAP مع الأمر التالي.

python train_IEMOCAP.py --base-model 'LSTM' --graph-model --nodal-attention --dropout 0.4 --lr 0.0003 --batch-size 32 --class-weight --l2 0.0 --no-cudaيرجى الاستشهاد بالورقة التالية إذا وجدت هذا الرمز مفيدًا في عملك.

DialogueGCN: A Graph Convolutional Neural Network for Emotion Recognition in Conversation. D. Ghosal, N. Majumder, S. Poria, N. Chhaya, & A. Gelbukh. EMNLP-IJCNLP (2019), Hong Kong, China.تنفيذ Pytorch على الورق "DialogueGCN: شبكة عصبية تلافيفية للرسم البياني للتعرف على العاطفة في المحادثة".

يمكنك تشغيل العملية بأكملها بسهولة شديدة. خذ مجموعة IEMOCAP على سبيل المثال:

./scripts/iemocap.sh preprocess./scripts/iemocap.sh train| - | مجموعة البيانات | مرجح F1 |

|---|---|---|

| إبداعي | IEMOCAP | 64.18 ٪ |

| هذا التنفيذ | IEMOCAP | 64.10 ٪ |

ميان تشانغ (جيثب: ميانزانغ)

يرجى الاستشهاد بالورقة التالية إذا وجدت هذا الرمز مفيدًا في عملك.

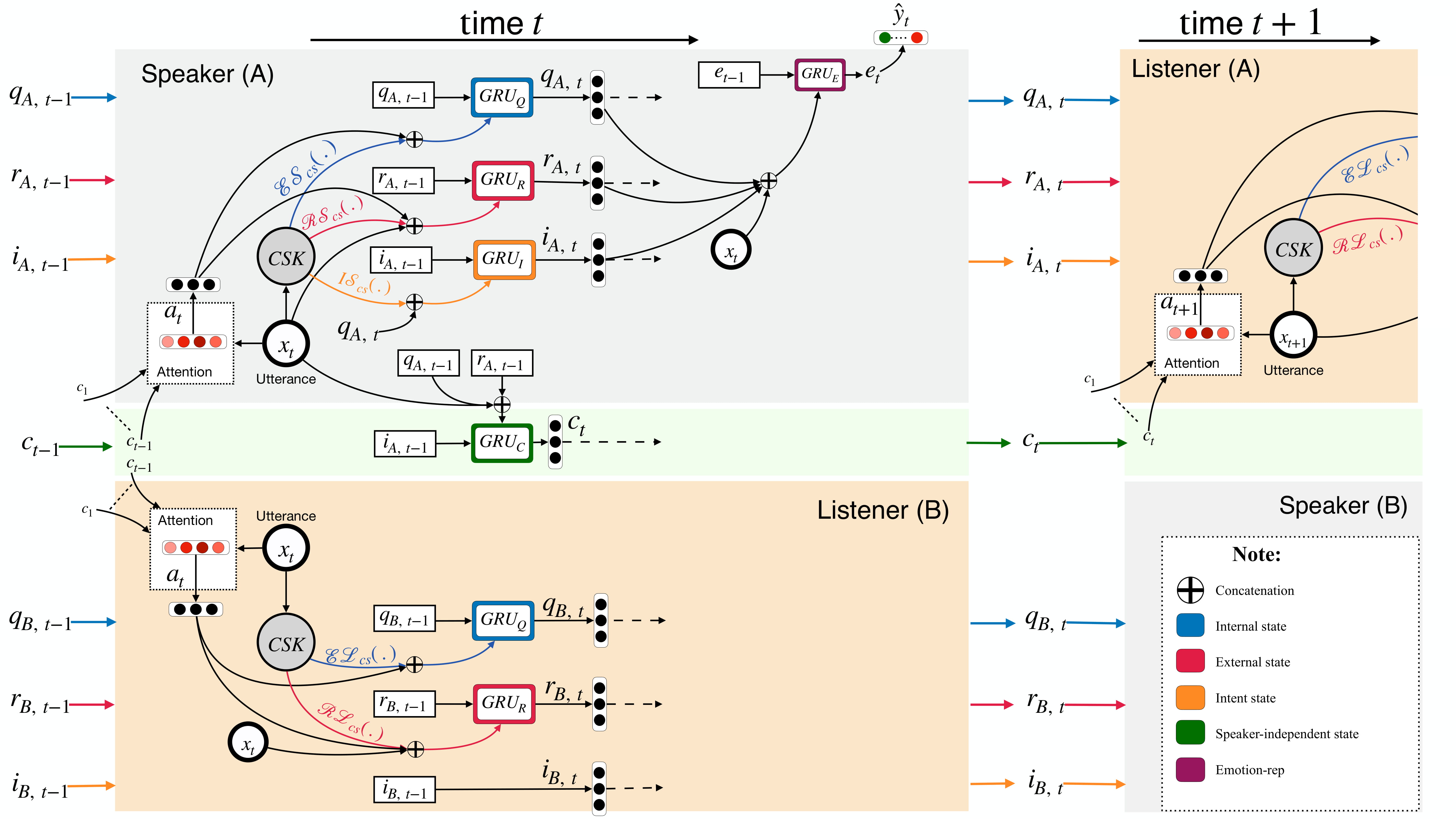

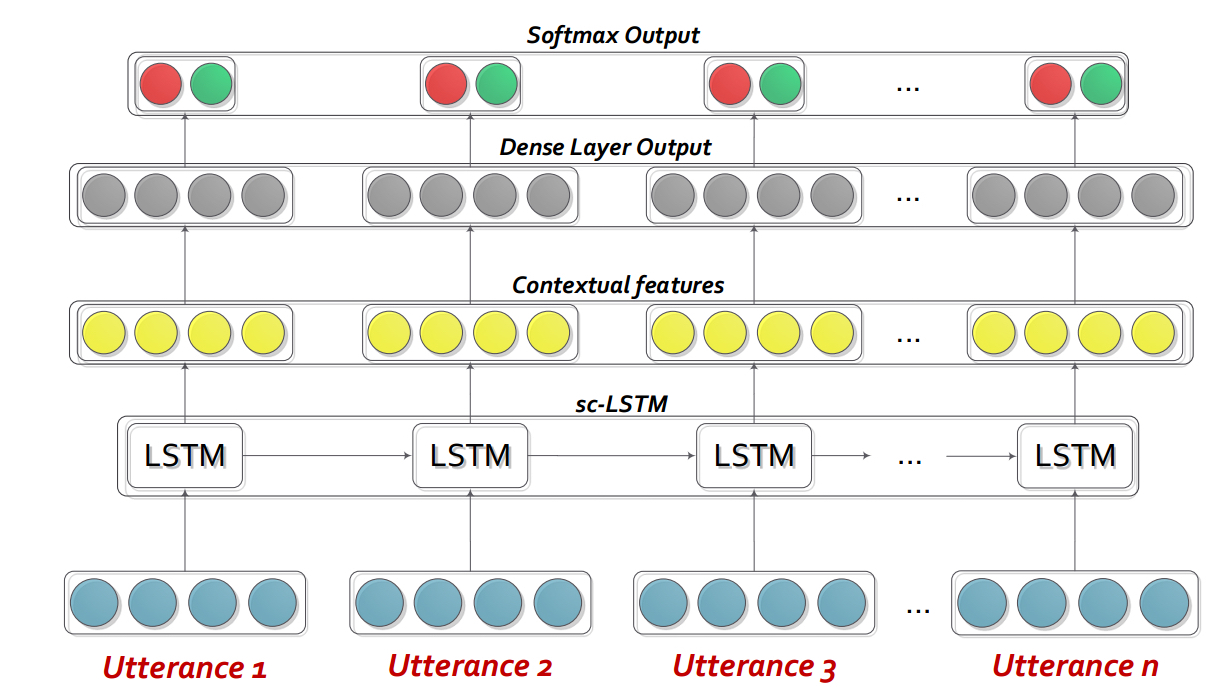

DialogueGCN: A Graph Convolutional Neural Network for Emotion Recognition in Conversation. D. Ghosal, N. Majumder, S. Poria, N. Chhaya, & A. Gelbukh. EMNLP-IJCNLP (2019), Hong Kong, China.Dialoguernn هي في الأساس شبكة عصبية متكررة مخصصة (RNN) تملأ كل متحدث في محادثة/حوار على الطيران ، بينما يضعف سياق المحادثة في نفس الوقت. يمكن بسهولة تمديد هذا النموذج إلى سيناريو متعدد الأحزاب. أيضا ، يمكن استخدامه كنموذج ما قبل الجري لتوليد الحوار التعاطف.

ملاحظة : تعد الإعدادات الافتراضية (مقاييس البارامات والوسائط الخاصة بمنتخب أوامر) في الكود بالنسبة إلى Bidialoguernn+ATT. يحتاج المستخدم إلى تحسين الإعدادات للمتغيرات والتغييرات الأخرى.

يرجى استخراج محتويات DialogueRNN_features.zip .

python train_IEMOCAP.py <command-line arguments>python train_AVEC.py <command-line arguments>--no-cuda : لا يستخدم GPU--lr : معدل التعلم--l2 : وزن التنظيم L2--rec-dropout : التسرب المتكرر--dropout : التسرب--batch-size : حجم الدُفعة--epochs : عدد الحقبة--class-weight : وزن الفصل (لا ينطبق على AVEC)--active-listener : وضع Lisnener الصريح--attention : نوع الانتباه--tensorboard : تمكين سجل Tensorboard--attribute : السمة من 1 إلى 4 (فقط لـ AVEC ؛ 1 = التكافؤ ، 2 = التنشيط/الإثارة ، 3 = التوقع/التوقع ، 4 = الطاقة)يرجى الاستشهاد بالورقة التالية إذا وجدت هذا الرمز مفيدًا في عملك.

DialogueRNN: An Attentive RNN for Emotion Detection in Conversations. N. Majumder, S. Poria, D. Hazarika, R. Mihalcea, E. Cambria, and G. Alexander. AAAI (2019), Honolulu, Hawaii, USAشبكة ذاكرة المحادثة التفاعلية (ICON) هي إطار عمل متعدد الوسائط للكشف عن العاطفة يستخرج الميزات متعددة الوسائط من مقاطع الفيديو المحادثة ونماذج هرمية بشكل هرمي textit {self} و textit {inter-Speaker} في الذكريات العالمية. تولد مثل هذه الذكريات ملخصات سياقية تساعد في التنبؤ بالتوجه العاطفي للفيديوس الكلامية.

cd ICON

فك ضغط البيانات على النحو التالي:

/ICON/IEMOCAP/data/ . نموذج العينة لتحقيق ذلك: unzip {path_to_zip_file} -d ./IEMOCAP/تدريب نموذج الأيقونة:

python train_iemocap.py لـ iemocapICON: Interactive Conversational Memory Networkfor Multimodal Emotion Detection. D. Hazarika, S. Poria, R. Mihalcea, E. Cambria, and R. Zimmermann. EMNLP (2018), Brussels, Belgium CMN هو إطار عصبي للكشف عن العاطفة في المحادثات الثلجية. إنه يعزز الإشارات الطافية من الطرائق النصية والصوت والبصرية. إنه يشتمل على وجه التحديد على تبعيات خاصة بالسماعات في بنيةها لنمذجة السياق. ثم يتم إنشاء الملخصات من هذا السياق باستخدام شبكات الذاكرة متعددة القفاز.

cd CMN

فك ضغط البيانات على النحو التالي:

/CMN/IEMOCAP/data/ . نموذج العينة لتحقيق ذلك: unzip {path_to_zip_file} -d ./IEMOCAP/تدريب نموذج الأيقونة:

python train_iemocap.py لـ iemocapيرجى الاستشهاد بالورقة التالية إذا وجدت هذا الرمز مفيدًا في عملك.

Hazarika, D., Poria, S., Zadeh, A., Cambria, E., Morency, L.P. and Zimmermann, R., 2018. Conversational Memory Network for Emotion Recognition in Dyadic Dialogue Videos. In Proceedings of the 2018 Conference of the North American Chapter of the Association for Computational Linguistics: Human Language Technologies, Volume 1 (Long Papers) (Vol. 1, pp. 2122-2132).BC-LSTM-PYTORCH هي شبكة لاستخدام السياق لاكتشاف العاطفة من الكلام في حوار. النموذج بسيط ولكنه فعال يستخدم فقط LSTM لنمذجة العلاقة الزمنية بين الكلمات. في هذا الريبو ، قدمنا بيانات المهمة Semeval 2019. لقد استخدمنا وقدمنا البيانات التي نشرتها Semeval 2019 المهمة 3 - "التعرف على العاطفة في السياق". في هذه المهمة ، تم توفير 3 كلمات فقط - Clutrance1 (user1) ، clutrance2 (user2) ، cutrance3 (user1) على التوالي. المهمة هي التنبؤ بملصق العاطفة من الكلام 3. لم يتم تقديم علامة العاطفة لكل كلام. ومع ذلك ، إذا كانت بياناتك تحتوي على ملصق العاطفة لكل كلام ، فلا يزال بإمكانك استخدام هذا الرمز وتكييفه وفقًا لذلك. وبالتالي ، لا يزال هذا الرمز قابل للتطبيق لمجموعات البيانات مثل Mosi و Mosei و IEMOCAP و AVEC و DailyDialogue وما إلى ذلك.

cd bc-LSTM-pytorch

تدريب نموذج BC-LSTM:

python train_IEMOCAP.py لـ iemocapيرجى الاستشهاد بالورقة التالية إذا وجدت هذا الرمز مفيدًا في عملك.

Poria, S., Cambria, E., Hazarika, D., Majumder, N., Zadeh, A. and Morency, L.P., 2017. Context-dependent sentiment analysis in user-generated videos. In Proceedings of the 55th Annual Meeting of the Association for Computational Linguistics (Volume 1: Long Papers) (Vol. 1, pp. 873-883).تنفيذ Keras من BC-LSTM .

cd bc-LSTM

تدريب نموذج BC-LSTM:

python baseline.py -config testBaseline.configيرجى الاستشهاد بالورقة التالية إذا وجدت هذا الرمز مفيدًا في عملك.

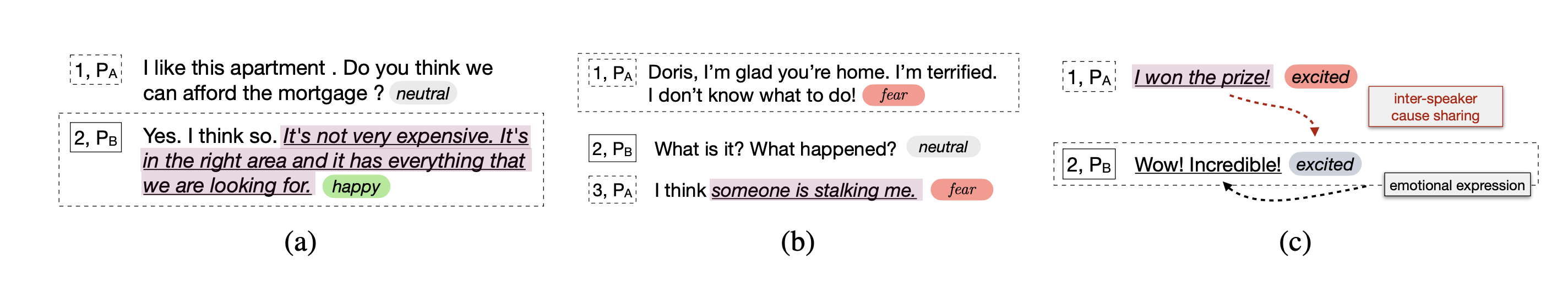

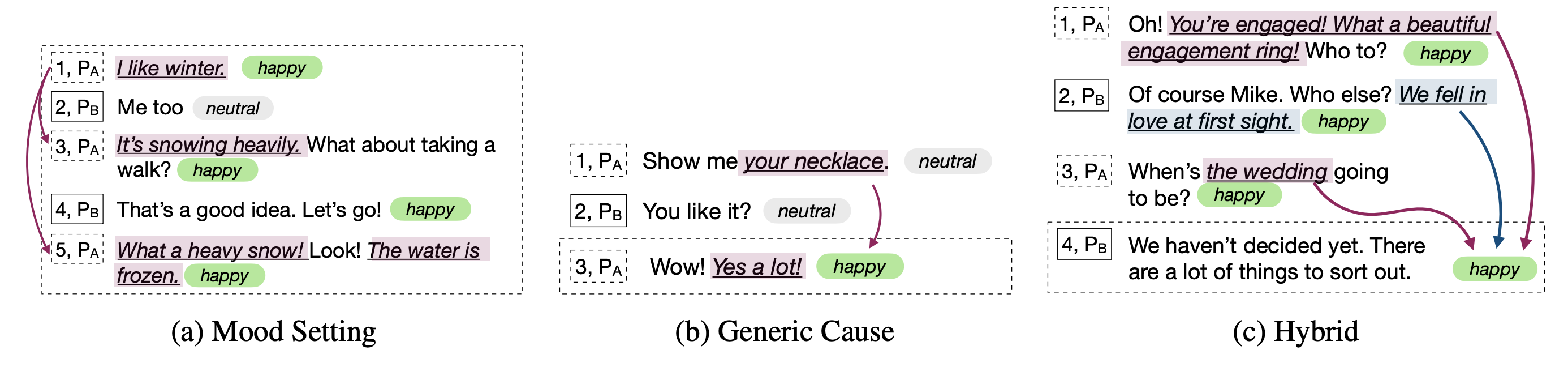

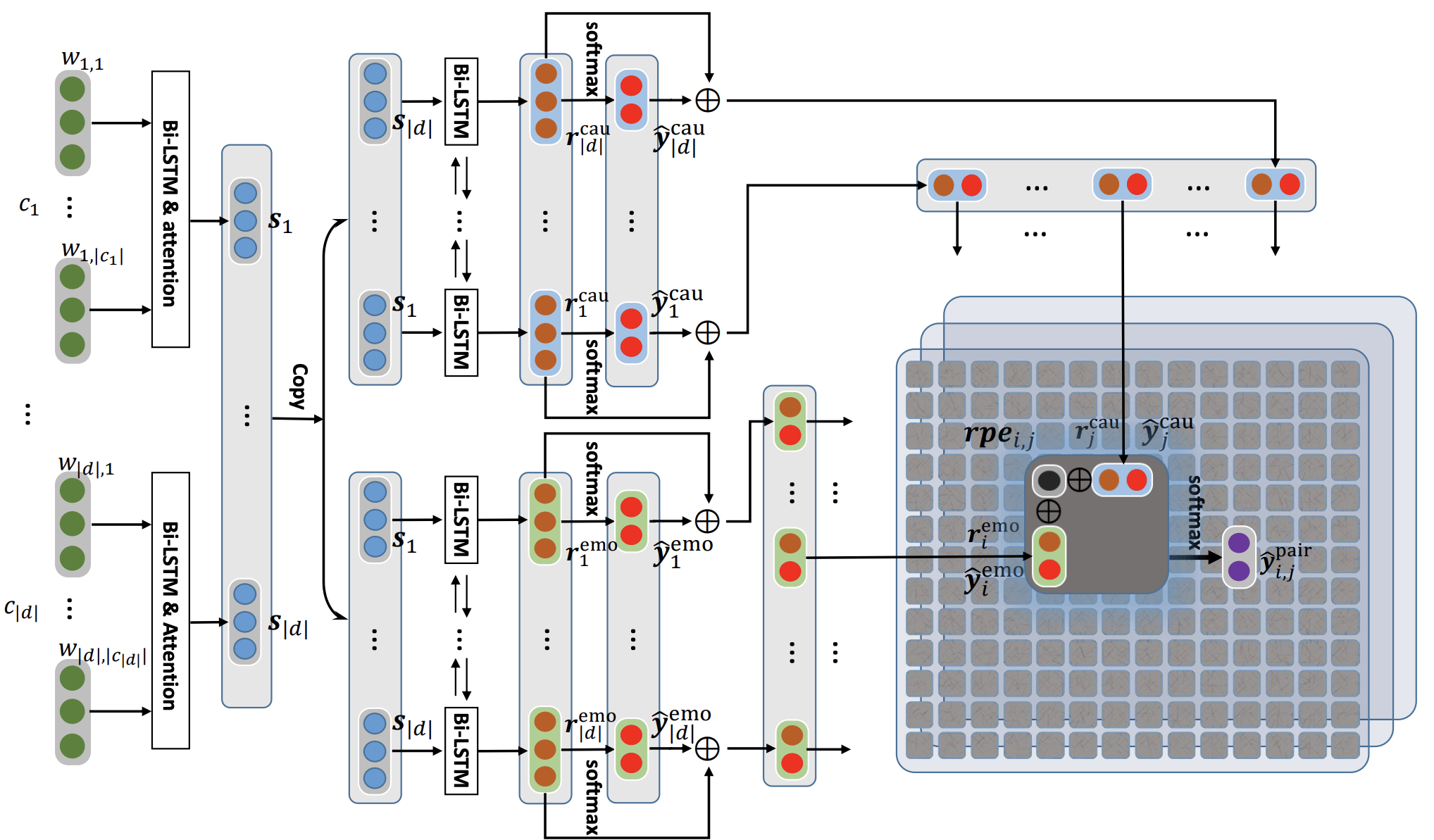

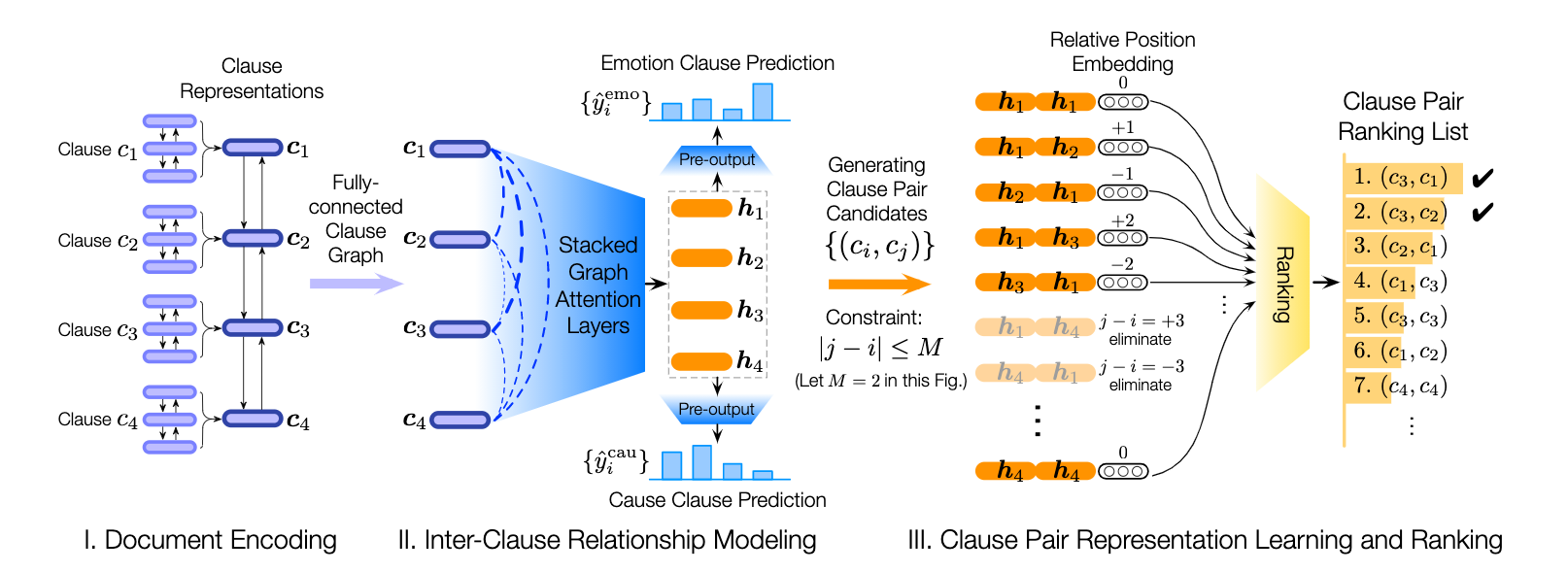

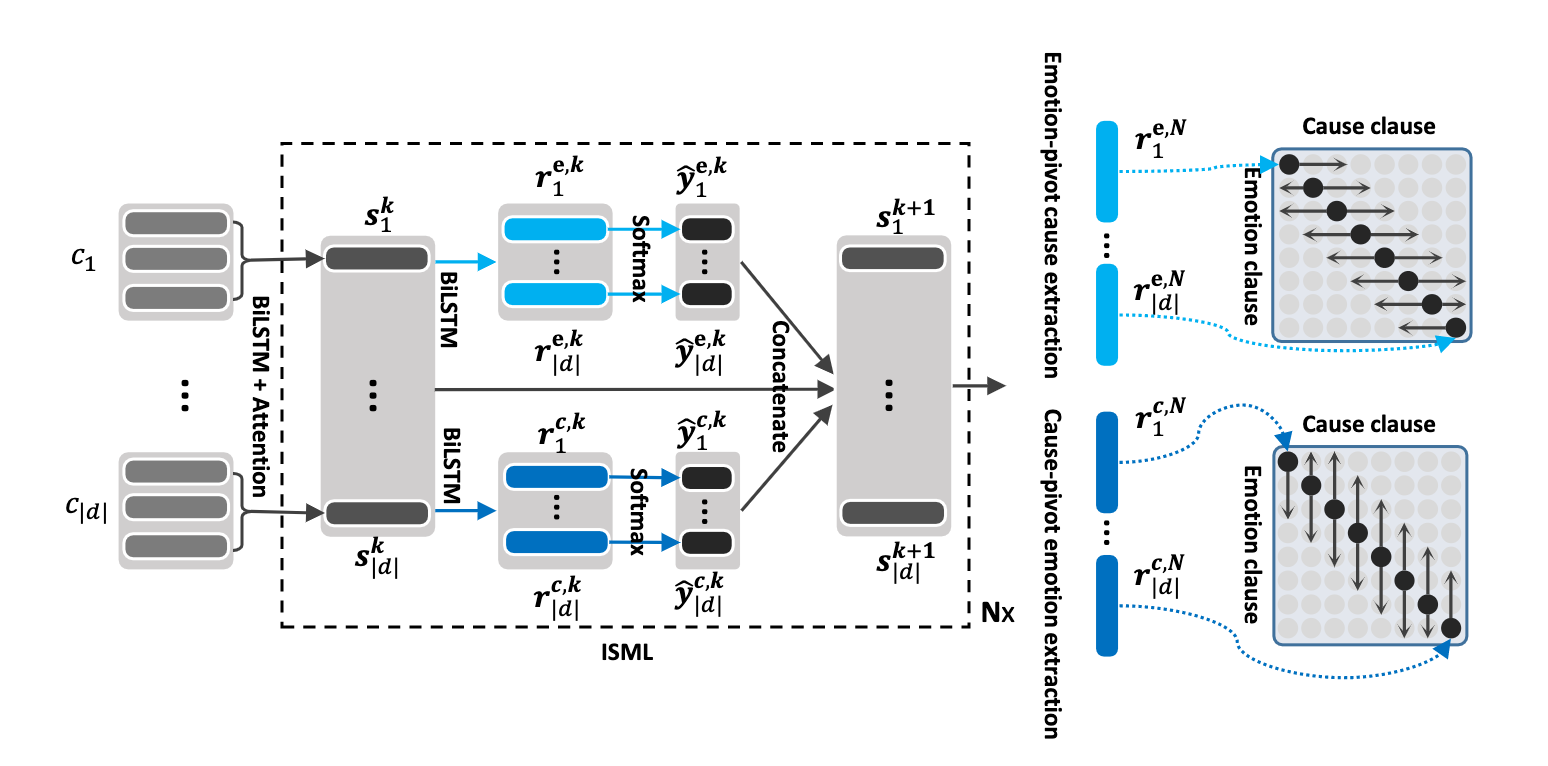

Poria, S., Cambria, E., Hazarika, D., Majumder, N., Zadeh, A. and Morency, L.P., 2017. Context-dependent sentiment analysis in user-generated videos. In Proceedings of the 55th Annual Meeting of the Association for Computational Linguistics (Volume 1: Long Papers) (Vol. 1, pp. 873-883).يحتوي هذا المستودع أيضًا على تطبيقات من البنى المختلفة لاكتشاف العاطفة تسبب في المحادثات.

| نموذج | EMO_F1 | POS_F1 | neg_f1 | macro_avg |

|---|---|---|---|---|

| ECPE-2D Cross_road (0 طبقة تحويل) | 52.76 | 52.39 | 95.86 | 73.62 |

| ECPE-2D Window_crained (1 طبقة تحويل) | 70.48 | 48.80 | 93.85 | 71.32 |

| ECPE-2D Cross_road (2 طبقة التحويل) | 52.76 | 55.50 | 94.96 | 75.23 |

| ECPE-MLL | - | 48.48 | 94.68 | 71.58 |

| ترتيب العاطفة قضية | - | 33.00 | 97.30 | 65.15 |

| روبرتا قاعدة | - | 64.28 | 88.74 | 76.51 |

| روبرتا لارج | - | 66.23 | 87.89 | 77.06 |

الاقتباس: يرجى الاستشهاد بالأوراق التالية إذا كنت تستخدم هذا الرمز.

الاقتباس: يرجى الاستشهاد بالأوراق التالية إذا كنت تستخدم هذا الرمز.

الاقتباس: يرجى الاستشهاد بالأوراق التالية إذا كنت تستخدم هذا الرمز.

روبرتا و Spanbert الأساس كما هو موضح في ورقة Reccon الأصلية. الرجوع إلى هذا.

الاقتباس: يرجى الاستشهاد بالأوراق التالية إذا كنت تستخدم هذا الرمز.