科幻電影中的“讀心術”似乎正在成為現實!耶魯大學、達特茅斯學院和劍橋大學的科學家們聯合開發了一款名為MindLLM的AI模型,能夠將功能性磁共振成像(fMRI)掃描的大腦信號直接解碼為人類可理解的文字。這一突破性技術讓人不禁感嘆,未來已經悄然來臨。

將復雜的大腦活動轉化為文字一直是神經科學領域的巨大挑戰,難度堪比攀登珠穆朗瑪峰。以往的技術要么預測效果不佳,要么只能處理簡單的任務,且跨受試者的通用性幾乎為零。然而,MindLLM的出現徹底改變了這一局面。

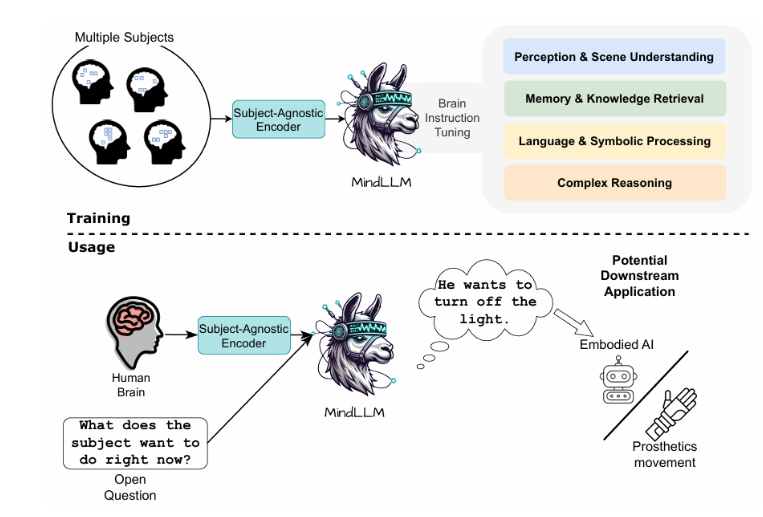

MindLLM就像一位“超級翻譯官”,不僅能理解大腦的活動,還能將其轉化為文字,且不受主題和受試者的限制。這一突破得益於研究人員開發的大腦指令調整(BIT)技術,該技術使MindLLM能夠更精準地捕捉fMRI信號中的語義信息,從而大幅提升了解碼能力。

在實際測試中,MindLLM的表現令人驚嘆。在各種fMRI到文本的任務中,它的性能遠超以往所有模型,下游任務性能提升了12.0%,未知主題泛化能力提升了16.4%,新任務適應能力更是暴增25.0%。這一“全能學霸”的表現無疑為腦機接口技術開闢了新的可能性。

MindLLM的應用前景極為廣闊。對於失語症、漸凍症等語言障礙患者來說,它有望幫助他們重新獲得表達的能力,與世界重新建立連接。對於健康人群,MindLLM也為“意念控制”數字設備打開了大門,無論是操控AI還是控制假肢,都將變得更加自然和人性化。

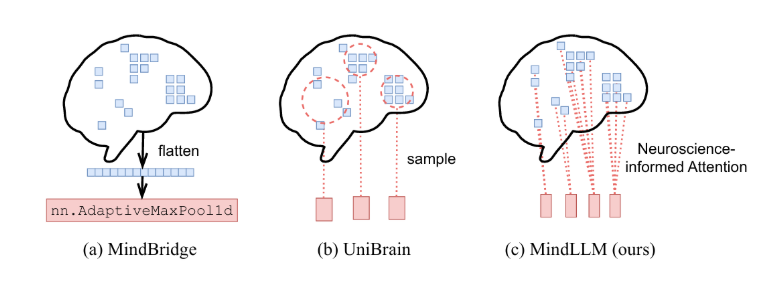

MindLLM的成功離不開其“內外兼修”的設計。它採用了主題無關的fMRI編碼器,能夠從復雜的fMRI信號中精準提取大腦活動的關鍵特徵,且適用於不同受試者。同時,它還搭載了大型語言模型(LLM),能夠將提取的腦電特徵流暢地轉化為人類語言。

為了進一步提升解碼的準確性和通用性,研究人員還開發了大腦指令調整(BIT)技術。通過圖像作為中介,MindLLM能夠學習各種任務,包括感知、記憶、語言和推理等,從而全面提升對大腦語義信息的理解能力。

在嚴格的測試中,MindLLM的表現遠超預期,不僅在各項指標上全面超越基線模型,還能有效適應各種新任務,展現出驚人的可塑性和靈活性。此外,研究人員還深入分析了MindLLM的注意力機制,發現其決策過程具有可解釋性,這為我們進一步理解大腦的工作原理提供了寶貴的見解。

MindLLM的誕生無疑是fMRI到文本解碼領域的里程碑式突破。它不僅大幅提升了解碼的精度和泛用性,還為腦機接口技術的未來發展點燃了無限遐想。或許在不久的將來,“意念交流”將不再是科幻電影中的橋段,而是真真切切地走進我們的生活,開啟人機交互的全新紀元。

論文鏈接:https://arxiv.org/abs/2502.15786