上海AI實驗室近日發布了一款名為InternLM-XComposer-2.5(簡稱IXC-2.5)的多模態大型語言模型,這一開源項目在人工智能領域引起了廣泛關注。該模型不僅在技術上實現了多項突破,還在實際應用中展現了強大的潛力,特別是在超高分辨率圖像理解、細粒度視頻理解和多輪圖像對話等方面,其表現尤為突出。

IXC-2.5的發布填補了國內在多模態LLM領域的空白,尤其是在網頁製作和圖文混排文章生成方面,該模型進行了特別的優化,為內容創作者提供了極大的便利。無論是網頁設計還是圖文內容的生成,IXC-2.5都能提供高效且精準的解決方案,極大地提升了創作效率。

IXC-2.5模型的核心特點包括:

長上下文處理能力:該模型原生支持24K標記的輸入,並可擴展到96K,這意味著它能夠處理超長的文本和圖像輸入,為用戶提供了更大的創作空間。無論是複雜的文檔還是大量的圖像數據,IXC-2.5都能輕鬆應對。

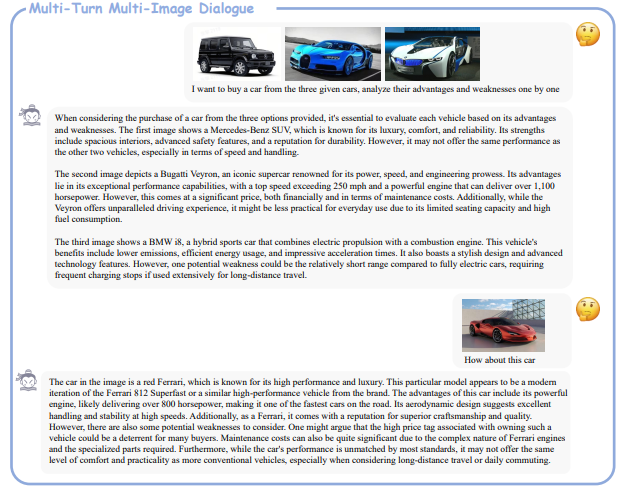

多樣化的視覺能力:IXC-2.5不僅支持超高分辨率的圖像理解,還能進行細粒度的視頻理解和多輪多圖對話。這種多模態的處理能力在以往的模型中極為罕見,尤其是在視頻理解方面,IXC-2.5能夠將視頻中的幀沿短邊拼接,形成高分辨率圖像,同時保留幀的索引以提供時間關係。

強大的生成能力:IXC-2.5能夠生成網頁和高質量的圖文文章,將文本和圖像的結合提升到了一個新的高度。無論是網頁設計還是圖文混排的文章生成,IXC-2.5都能提供高質量的輸出,滿足不同場景的需求。

先進的模型架構:IXC-2.5採用了輕量級的視覺編碼器、大型語言模型以及部分LoRA對齊技術,這些技術的結合使得模型在性能上有了顯著的提升。尤其是在處理複雜的多模態數據時,IXC-2.5展現出了卓越的效率。

在28個基準測試中,IXC-2.5在16項測試中超過了現有的開源模型,另外16項測試中的表現接近或超過了GPT-4V和Gemini Pro。這一測試結果充分證明了IXC-2.5的強大實力,尤其是在視頻理解、結構化高分辨率圖像理解、多輪多圖對話和通用視覺問答等任務上,IXC-2.5展現出了極強的競爭力。

IXC-2.5的研發團隊由上海人工智能實驗室、香港中文大學、商湯科技集團以及清華大學聯合組成。該模型的設計初衷是為了支持長上下文的輸入與輸出,以應對日益複雜的文本圖像理解和創作任務。在預訓練階段,IXC-2.5通過位置編碼外推,將上下文窗口擴展到96K,這在人機交互和內容創作方面展現出了卓越的能力。

在圖像處理方面,IXC-2.5採用了統一的動態圖像分割策略,能夠適應任意分辨率和縱橫比的圖像。而在視頻處理方面,它能夠將視頻中的幀沿短邊拼接,形成高分辨率圖像,同時保留幀的索引以提供時間關係。這種處理方式使得IXC-2.5在視頻理解任務中表現出色。

此外,IXC-2.5還擴展了其在網頁生成方面的應用,能夠根據視覺截圖、自由形式指令或簡歷文檔自動構建網頁。在文本圖像文章創作方面,IXC-2.5通過結合多種技術,提出了一種可擴展的流程,以生成高質量和穩定的文本圖像文章。

IXC-2.5的開源不僅是技術上的一次飛躍,更是對整個人工智能領域的一大貢獻。它讓我們看到了多模態LLM的無限可能,也為未來的AI應用開闢了新的道路。無論是內容創作、網頁設計還是多模態數據處理,IXC-2.5都將成為未來人工智能應用中的重要工具。

項目地址:https://top.aibase.com/tool/internlm-xcomposer-2-5

論文地址:https://arxiv.org/pdf/2407.03320