Shanghai AI Laboratory lanzó recientemente un modelo de lenguaje grande multimodal llamado Internlm-xComposer-2.5 (IXC-2.5 para abreviar), y este proyecto de código abierto ha atraído una atención generalizada en el campo de la inteligencia artificial. Este modelo no solo logró muchos avances en tecnología, sino que también mostró un fuerte potencial en aplicaciones prácticas, especialmente en la comprensión de la imagen de resolución ultra alta, la comprensión de video de grano fino y el diálogo de imágenes de ronda múltiple.

El lanzamiento de IXC-2.5 ha llenado la brecha en el campo de la LLM multimodal en China, especialmente en la producción de páginas web y la generación de artículos gráficos y de texto mixtos ha sido especialmente optimizado, proporcionando una gran comodidad para los creadores de contenido. Ya sea por diseño web o la generación de contenido gráfico, IXC-2.5 puede proporcionar soluciones eficientes y precisas, mejorando en gran medida la eficiencia creativa.

Las características principales del modelo IXC-2.5 incluyen:

Capacidad de procesamiento de contexto largo: el modelo es compatible con las entradas de marcadores de 24k y se puede ampliar a 96k, lo que significa que puede manejar entradas de texto e imágenes ultra largas, proporcionando a los usuarios un espacio más creativo. Ya sea que se trate de documentos complejos o grandes cantidades de datos de imagen, IXC-2.5 puede manejarlo fácilmente.

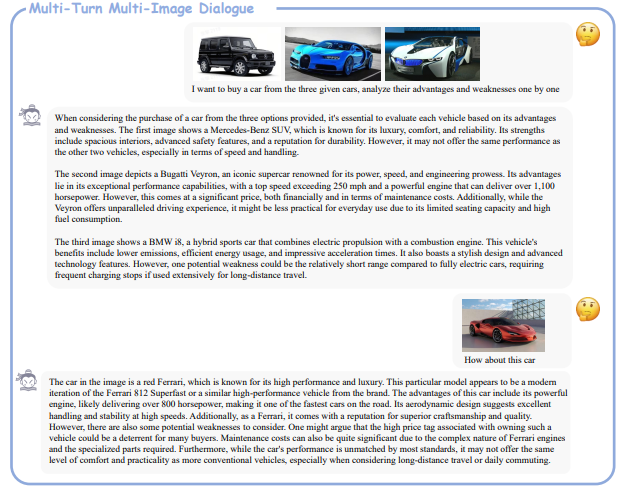

Capacidades visuales diversas: IXC-2.5 no solo admite la comprensión de la imagen de ultra alta resolución, sino que también permite una comprensión de video de grano fino y un diálogo múltiple de ronda múltiple. Esta capacidad de procesamiento multimodal es extremadamente rara en modelos anteriores, especialmente en términos de comprensión de video.

Capacidad de generación fuerte: IXC-2.5 puede generar páginas web y artículos gráficos de alta calidad, llevando la combinación de texto e imágenes a un nuevo nivel. Ya sea que se trate de diseño web o generación de artículos de texto mixto, IXC-2.5 puede proporcionar una producción de alta calidad para satisfacer las necesidades de diferentes escenarios.

Arquitectura del modelo avanzado: IXC-2.5 utiliza un codificador de visión ligero, modelos de lenguaje grande y algunas tecnologías de alineación de Lora. Especialmente cuando se trata de datos multimodales complejos, IXC-2.5 demuestra una excelente eficiencia.

De los 28 puntos de referencia, IXC-2.5 superó al modelo de código abierto existente en 16 pruebas, y el rendimiento en otras 16 pruebas fue cercana o superando el GPT-4V y Gemini Pro. Este resultado de la prueba prueba completamente la fuerte fuerza de IXC-2.5, especialmente en tareas como la comprensión de video, la comprensión estructurada de imágenes de alta resolución, múltiples rondas de diálogos múltiples y preguntas y respuestas visuales generales. Competitividad.

El equipo de I + D de IXC-2.5 está compuesto conjuntamente por el Laboratorio de Inteligencia Artificial de Shanghai, la Universidad China de Hong Kong, el Grupo de Tecnología Sensret y la Universidad de Tsinghua. El diseño original de este modelo es admitir la entrada y salida de contexto largo para hacer frente a las tareas de comprensión de imágenes de texto cada vez más complejas y tareas de creación. Durante la fase de pre-entrenamiento, IXC-2.5 extiende la ventana de contexto a 96K a través de la extrapolación de codificación de posición, lo que demuestra capacidades sobresalientes en la interacción humana y la creación de contenido.

En términos de procesamiento de imágenes, IXC-2.5 adopta una estrategia de segmentación de imágenes dinámicas unificadas, que puede adaptarse a las imágenes de cualquier resolución y relación de aspecto. En términos de procesamiento de videos, puede empalmar los marcos en el video a lo largo de los bordes cortos para formar imágenes de alta resolución mientras se conserva el índice de los marcos para proporcionar relaciones de tiempo. Este enfoque hace que IXC-2.5 funcione bien en las tareas de comprensión de video.

Además, IXC-2.5 también expande su aplicación en la generación de páginas web, lo que le permite crear automáticamente páginas web basadas en capturas de pantalla visuales, instrucciones de forma libre o documentos de reanudar. En términos de creación de artículos de imagen de texto, IXC-2.5 propone un proceso escalable mediante la combinación de múltiples tecnologías para generar artículos de imagen de texto de alta calidad y estables.

El código abierto de IXC-2.5 no es solo un salto tecnológico, sino también una gran contribución a todo el campo de la inteligencia artificial. Nos permite ver las infinitas posibilidades de LLM multimodal y también abre nuevas rutas para futuras aplicaciones de IA. Ya sea que se trate de creación de contenido, diseño web o procesamiento de datos multimodales, IXC-2.5 se convertirá en una herramienta importante en futuras aplicaciones de inteligencia artificial.

Dirección del proyecto: https://top.aibase.com/tool/internlm-xcomposer-2-5

Dirección en papel: https://arxiv.org/pdf/2407.03320