O Shanghai AI Laboratory lançou recentemente um modelo de grande linguagem multimodal chamado InternLM-Xcomposer-2.5 (IXC-2.5 para abreviação), e esse projeto de código aberto atraiu atenção generalizada no campo da inteligência artificial. Esse modelo não apenas alcançou muitos avanços na tecnologia, mas também mostrou um forte potencial em aplicações práticas, especialmente no entendimento da imagem de alta resolução, entendimento de vídeo de granulação fina e diálogo de imagem com várias rodadas.

O lançamento do IXC-2.5 preencheu a lacuna no campo do LLM multimodal na China, especialmente na produção de páginas da Web e na geração de artigos gráficos e de texto misto. Seja web design ou a geração de conteúdo gráfico, o IXC-2.5 pode fornecer soluções eficientes e precisas, melhorando bastante a eficiência criativa.

Os principais recursos do modelo ixc-2.5 incluem:

Capacidade de processamento de contexto longo: o modelo suporta de maneira nativamente as entradas de marcadores de 24k e pode ser expandida para 96K, o que significa que pode lidar com entradas de texto e imagem ultra-longa, fornecendo aos usuários um espaço mais criativo. Sejam documentos complexos ou grandes quantidades de dados de imagem, o IXC-2.5 pode lidar com isso facilmente.

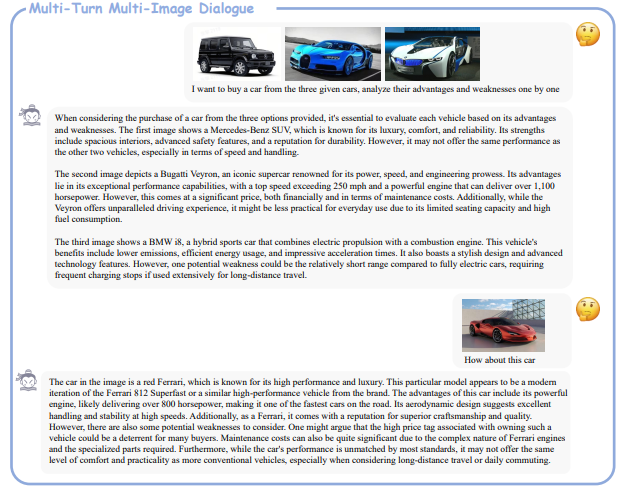

Recursos visuais diversos: o IXC-2.5 não apenas suporta o entendimento da imagem de resolução ultra-alta, mas também permite a compreensão de vídeo de granulação fina e o diálogo multi-gráfico de várias rodadas. Esse recurso de processamento multimodal é extremamente raro em modelos anteriores, especialmente em termos de entendimento de vídeo.

Forte capacidade de geração: o IXC-2.5 pode gerar páginas da Web e artigos gráficos de alta qualidade, levando a combinação de texto e imagens a um novo nível. Seja o design da web ou a geração de artigos de texto misto, o IXC-2.5 pode fornecer saída de alta qualidade para atender às necessidades de diferentes cenários.

Arquitetura avançada do modelo: o IXC-2.5 usa o codificador de visão leve, modelos de idiomas grandes e algumas tecnologias de alinhamento da LORA. Especialmente ao lidar com dados multimodais complexos, o IXC-2.5 demonstra excelente eficiência.

Dos 28 benchmarks, o IXC-2.5 superou o modelo de código aberto existente em 16 testes, e o desempenho em outros 16 testes foi próximo ou superando o GPT-4V e o Gemini Pro. Esse resultado do teste prova totalmente a forte força do IXC-2.5, especialmente em tarefas como entendimento de vídeo, entendimento de imagem de alta resolução, várias rodadas de diálogos com várias fotos e perguntas e respostas visuais gerais. Competitividade.

A equipe de P&D do IXC-2.5 é composta em conjunto pelo Laboratório de Inteligência Artificial de Xangai, pela Universidade Chinesa de Hong Kong, Grupo de Tecnologia Sensetime e Universidade de Tsinghua. O design original deste modelo é suportar a entrada e a saída de longo contexto para lidar com as tarefas de compreensão e criação de imagem de texto cada vez mais complexas. Durante a fase de pré-treinamento, o IXC-2.5 estende a janela de contexto para 96k através da codificação de posição, que demonstra excelentes capacidades na interação humano-computador e criação de conteúdo.

Em termos de processamento de imagem, o IXC-2.5 adota uma estratégia de segmentação de imagem dinâmica unificada, que pode se adaptar a imagens de qualquer resolução e proporção. Em termos de processamento de vídeo, ele pode unir quadros no vídeo ao longo das bordas curtas para formar imagens de alta resolução, mantendo o índice dos quadros para fornecer relacionamentos de tempo. Essa abordagem faz com que o IXC-2.5 tenha um bom desempenho em tarefas de compreensão de vídeo.

Além disso, o IXC-2.5 também expande seu aplicativo na geração de páginas da web, permitindo criar páginas da Web automaticamente com base em capturas visuais, instruções de forma livre ou retomar documentos. Em termos de criação de artigos de imagem de texto, o IXC-2.5 propõe um processo escalável, combinando várias tecnologias para gerar artigos de imagem de texto de alta qualidade e estáveis.

O código aberto do IXC-2.5 não é apenas um salto tecnológico, mas também uma grande contribuição para todo o campo da inteligência artificial. Ele nos permite ver as infinitas possibilidades do LLM multimodal e também abre novos caminhos para futuros aplicativos de IA. Seja a criação de conteúdo, o design da web ou o processamento de dados multimodais, o IXC-2.5 se tornará uma ferramenta importante em futuros aplicativos de inteligência artificial.

Endereço do projeto: https://top.aibase.com/tool/internlm-xcomposer-2-5

Endereço em papel: https://arxiv.org/pdf/2407.03320