Das Shanghai AI Laboratory hat kürzlich ein multimodales Großsprachmodell namens Internlm-Xcomposer-2.5 (kurz IXC-2.5) veröffentlicht, und dieses Open-Source-Projekt hat auf dem Gebiet der künstlichen Intelligenz weit verbreitete Aufmerksamkeit auf sich gezogen. Dieses Modell erzielte nicht nur viele Durchbrüche in der Technologie, sondern zeigte auch ein starkes Potenzial in praktischen Anwendungen, insbesondere im Bildverständnis von Ultra-High-Auflösungen, feinkörnigem Videoverständnis und Multi-Runden-Bilddialog.

Die Veröffentlichung von IXC-2.5 hat die Lücke im Bereich multimodaler LLM in China gefüllt, insbesondere in der Produktion von Webseiten und der Erzeugung gemischter Grafik- und Textartikel. Egal, ob es sich um Webdesign oder die Erzeugung von Grafikinhalten handelt, IXC-2.5 kann effiziente und genaue Lösungen bieten und die kreative Effizienz erheblich verbessern.

Die Kernmerkmale des IXC-2.5-Modells umfassen:

Lange Kontextverarbeitungsfähigkeit: Das Modell unterstützt nativ 24K-Markierungseingänge und kann auf 96K erweitert werden. Dies bedeutet, dass es ultra-langen Text- und Bildeingaben verarbeiten kann und den Benutzern kreativeren Speicherplatz bietet. Unabhängig davon, ob es sich um komplexe Dokumente oder große Mengen an Bilddaten handelt, kann IXC-2.5 sie leicht verarbeiten.

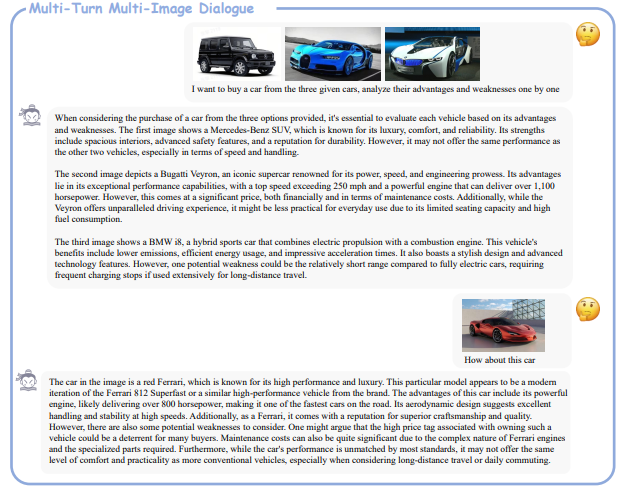

Verschiedene visuelle Funktionen: IXC-2.5 unterstützt nicht nur das Bildverständnis der ultrahohen Auflösung, sondern ermöglicht auch ein feinkörniges Videoverständnis und ein multi-runden-multi-grafischer Dialog. Diese multimodale Verarbeitungsfähigkeit ist in früheren Modellen äußerst selten, insbesondere in Bezug auf das Videoverständnis.

Starke Generation Fähigkeit: IXC-2.5 kann Webseiten und hochwertige Grafikartikel generieren und die Kombination von Text und Bildern auf eine neue Ebene bringen. Unabhängig davon, ob es sich um Webdesign oder gemischte Textartikelgenerierung handelt, kann IXC-2.5 eine qualitativ hochwertige Ausgabe liefern, um den Anforderungen verschiedener Szenarien gerecht zu werden.

Advanced Model Architecture: IXC-2.5 verwendet einen leichten Visionscodierer, Großsprachenmodelle und einige LORA-Alignment-Technologien. Insbesondere im Umgang mit komplexen multimodalen Daten zeigt IXC-2.5 eine hervorragende Effizienz.

Von den 28 Benchmarks übertraf IXC-2.5 das vorhandene Open-Source-Modell in 16 Tests, und die Leistung in weiteren 16 Tests lag in der Nähe oder übertraf das GPT-4V und Gemini Pro. Dieses Testergebnis beweist vollständig die starke Stärke von IXC-2.5, insbesondere bei Aufgaben wie Videoverständnis, strukturiertem hochauflösendes Bildverständnis, mehreren Runden von Multi-Picture-Dialogen und allgemeinen visuellen Frage und Antworten. Wettbewerbsfähigkeit.

Das F & E-Team von IXC-2.5 besteht gemeinsam aus Shanghai Artificial Intelligence Laboratory, der chinesischen Universität von Hongkong, der sensetime Technology Group und der Tsinghua University. Das ursprüngliche Design dieses Modells besteht darin, die Eingabe und Ausgabe von Langkontext zu unterstützen, um mit zunehmend komplexerem Textbildverständnis und Erstellungsaufgaben fertig zu werden. Während der Phase vor der Ausbildung erweitert IXC-2.5 das Kontextfenster auf 96K durch Positionscodierungs-Extrapolation, was herausragende Fähigkeiten bei der Interaktion zwischen Mensch und Komputer und Erstellung von Inhalten zeigt.

In Bezug auf die Bildverarbeitung weist IXC-2.5 eine einheitliche dynamische Bildsegmentierungsstrategie an, die sich an Bilder eines beliebigen Auflösungs- und Seitenverhältnisses anpassen kann. In Bezug auf die Videoverarbeitung können Rahmen im Video an kurzen Kanten gespleißt werden, um hochauflösende Bilder zu bilden und gleichzeitig den Index der Frames zu erhalten, um Zeitbeziehungen bereitzustellen. Dieser Ansatz macht IXC-2.5 in Videoverständnisaufgaben gut ab.

Darüber hinaus erweitert IXC-2.5 seine Anwendung in der Webseitengenerierung und ermöglicht es, Webseiten automatisch basierend auf visuellen Screenshots, Anweisungen für freie Form oder Lebenslauf zu erstellen. In Bezug auf die Erstellung von Textbildartikeln schlägt IXC-2.5 einen skalierbaren Prozess vor, indem mehrere Technologien kombiniert werden, um hochwertige und stabile Textbildartikel zu generieren.

Die Open Source von IXC-2.5 ist nicht nur ein technologischer Sprung, sondern auch ein großer Beitrag zum gesamten Bereich der künstlichen Intelligenz. Es ermöglicht uns, die unendlichen Möglichkeiten multimodaler LLM zu sehen und eröffnet auch neue Wege für zukünftige KI -Anwendungen. Egal, ob es sich bei der Erstellung von Inhalten, dem Webdesign oder der multimodalen Datenverarbeitung handelt, IXC-2.5 wird zu einem wichtigen Instrument für zukünftige Anwendungen für künstliche Intelligenz.

Projektadresse: https://top.aibase.com/tool/internlm-xcomposer-2-5

Papieradresse: https://arxiv.org/pdf/2407.03320