清華大學研究團隊推出了SonicSim行動音源模擬平台和SonicSet資料集,旨在解決語音處理領域行動聲音來源場景下資料不足的問題。 Downcodes小編帶您了解這項突破性研究成果,它如何模擬真實聲學環境,以及如何為語音分離和增強模型的訓練提供高品質的資料支援。

清華大學的研究團隊近日發布了一個名為SonicSim 的行動音源模擬平台,旨在解決目前語音處理領域在行動聲音來源場景下資料缺乏的難題。

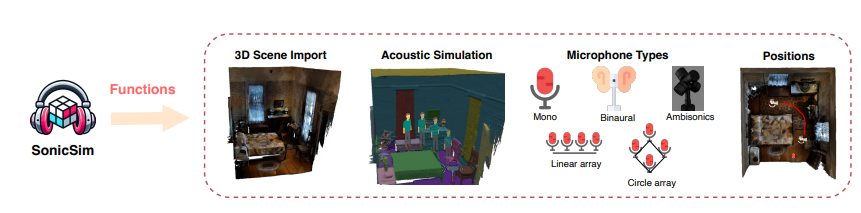

此平台基於Habitat-sim 模擬平台構建,能夠高度逼真地模擬真實世界的聲學環境,為語音分離和增強模型的訓練和評估提供更優質的數據支援。

現有的語音分離和增強資料集大多基於靜態聲源,難以滿足移動聲源場景下的需求。

雖然現實世界中也存在一些真實錄製的資料集,但其規模有限,且採集成本高昂。相較之下,合成資料集雖然規模較大,但其聲學模擬的真實性往往不足,難以準確反映真實環境中的聲學特徵。

SonicSim 平台的出現有效解決了上述問題。 該平台能夠模擬各種複雜的聲學環境,包括障礙物遮擋、房間幾何形狀以及不同材料對聲音的吸收、反射和散射特性等,並支援用戶自訂場景佈局、聲音來源和麥克風位置、麥克風類型等參數。

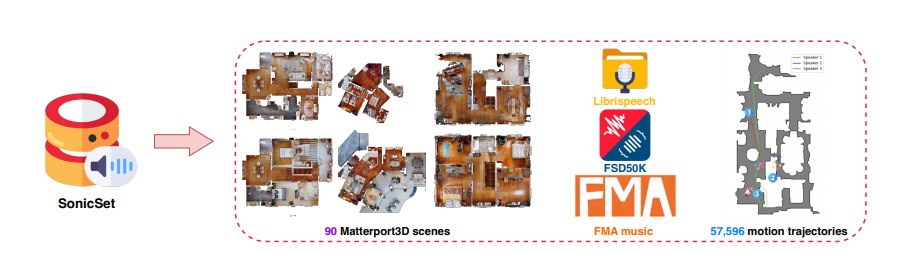

基於SonicSim 平台,研究團隊也建構了一個名為SonicSet 的大型多場景移動音源資料集。

該數據集使用了來自LibriSpeech、Freesound Dataset50k 和Free Music Archive 的語音和噪音數據,以及90個來自Matterport3D 數據集的真實場景,包含了豐富的語音、環境噪音和音樂噪音數據。

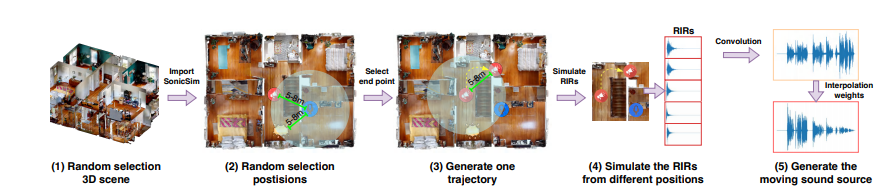

SonicSet 資料集的建構過程高度自動化,能夠隨機產生聲音來源和麥克風的位置以及聲音來源的運動軌跡,確保了資料的真實性和多樣性。

為了驗證SonicSim 平台和SonicSet 資料集的有效性,研究團隊在語音分離和語音增強任務上進行了大量的實驗。

結果表明,在SonicSet 資料集上訓練的模型在真實世界錄製的資料集上取得了更優異的性能,證明了SonicSim 平台能夠有效模擬真實世界的聲學環境,為語音處理領域的研究提供了強有力的支持。

SonicSim 平台和SonicSet 資料集的發布,為語音處理領域的研究帶來了新的突破。 隨著模擬工具的不斷改進和模型演算法的最佳化,未來將進一步推動語音處理技術在複雜環境中的應用。

然而,SonicSim 平台的真實性仍然受到3D 場景建模細節的限制。 當匯入的3D 場景存在缺失或不完整結構時,平台無法準確模擬目前環境中的殘響效果。

論文網址:https://arxiv.org/pdf/2410.01481

SonicSim和SonicSet的出現為語音處理技術發展帶來了新的希望,但仍需不斷改進。 期待未來在更複雜的聲學環境中看到該技術的應用。 Downcodes小編將持續關注該領域的研究進展。