gpt2 ml

V1.0 Release

中文说明|英语

| 尺寸 | 语言 | 语料库 | 词汇 | link1 | link2 | SHA256 |

|---|---|---|---|---|---|---|

| 1.5B参数 | 中国人 | 〜30克 | 线索(8021令牌) | Google Drive | 百度锅(FFZ6) | E698CC97A7F5F706F84F58BB469D614E 51D3C0CE5F9AB9BF77E01E3FCB41D482 |

| 1.5B参数 | 中国人 | 〜15克 | 伯特(21128代币) | Google Drive | 百度锅(Q9VR) | 4A6E5124DF8DB7AC2BDD902E6191B807 A6983A7F5D09FB10CE011F9A073B183E |

Thucnews和nlp_chinese_corpus的语料库

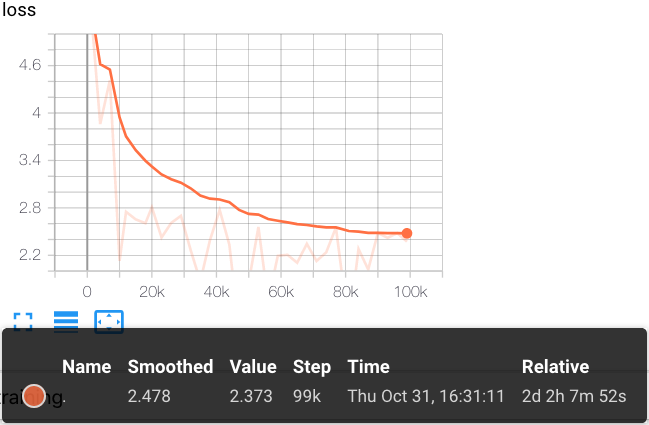

使用云TPU POD V3-256训练22W步骤

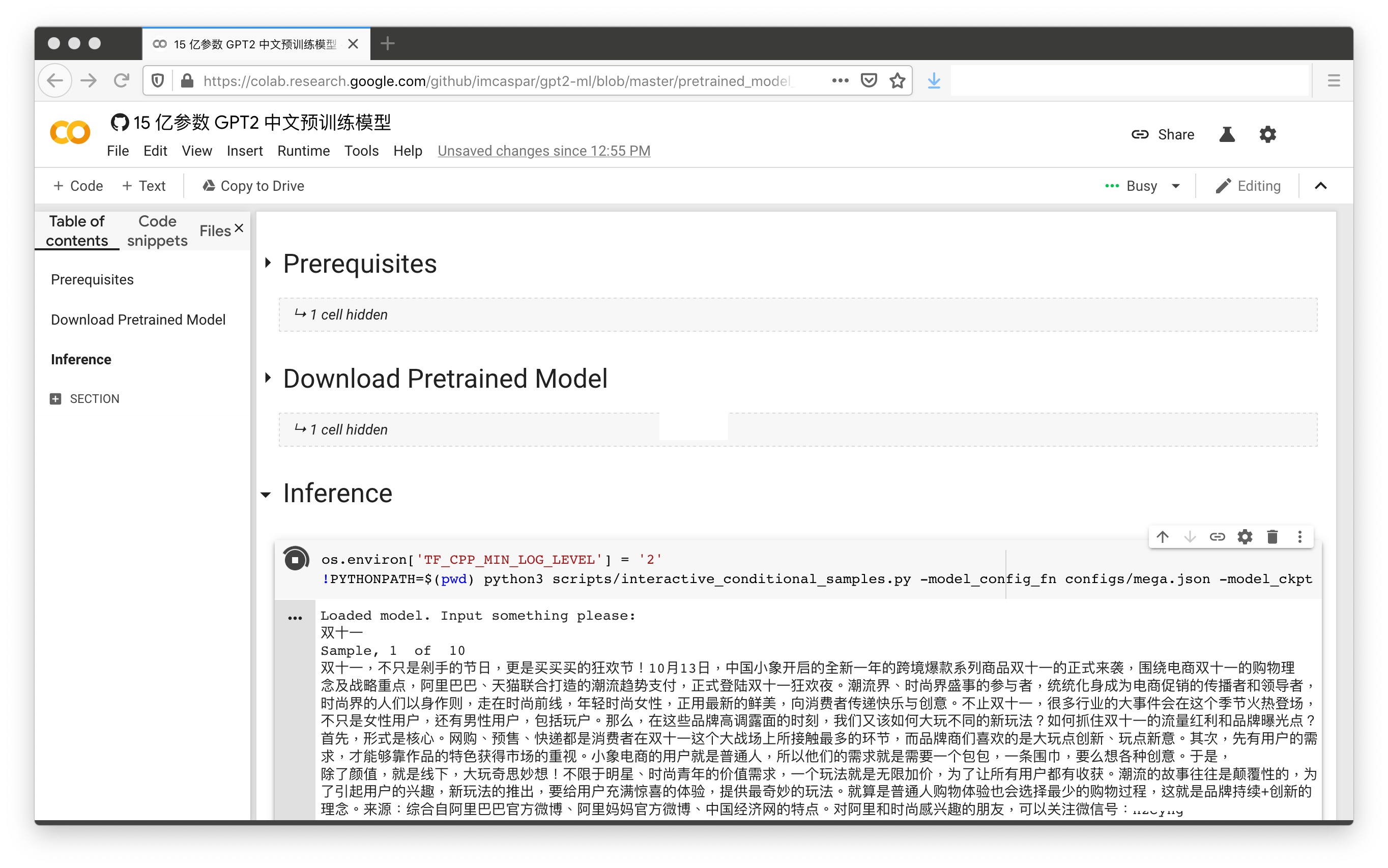

只需单击2次点击(不包括Colab auth过程),1.5B预处理的中国模型演示已准备就绪:

[COLAB笔记本]

该存储库中的内容是出于学术研究目的,我们没有提供任何结论性的评论。

@misc{GPT2-ML,

author = {Zhibo Zhang},

title = {GPT2-ML: GPT-2 for Multiple Languages},

year = {2019},

publisher = {GitHub},

journal = {GitHub repository},

howpublished = {url{https://github.com/imcaspar/gpt2-ml}},

}

https://github.com/google-research/bert

https://github.com/rowanz/grover

Google的Tensorflow Research Cloud(TFRC)的Cloud TPU支持了研究

[机器之心]只需单击三次,让中文gpt-2为你生成定制故事

[科学空间]现在可以用凯拉斯玩中文gpt2了