gpt2 ml

V1.0 Release

中文说明| Inglês

| Tamanho | Linguagem | Corpus | Vocab | Link1 | Link2 | SHA256 |

|---|---|---|---|---|---|---|

| 1,5b params | chinês | ~ 30G | Pista (8021 tokens) | Google Drive | Baidu Pan (FFZ6) | E698CC97A7F5F706F84F58BB469D614E 51D3C0CE5F9AB9BF77E01E3FCB41D482 |

| 1,5b params | chinês | ~ 15g | Bert (21128 tokens) | Google Drive | Baidu Pan (Q9VR) | 4A6E5124DF8DB7AC2BDD902E6191B807 A6983A7F5D09FB10CE011F9A073B183E |

Corpus de Thucnews e NLP_CHINESE_CORPUS

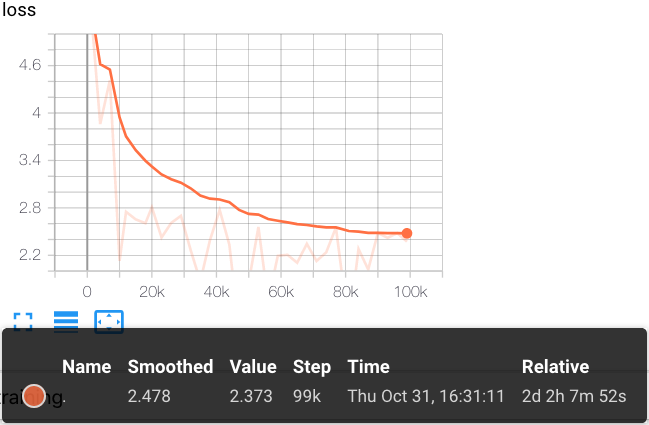

Usando o Cloud TPU POD V3-256 para treinar 22W degraus

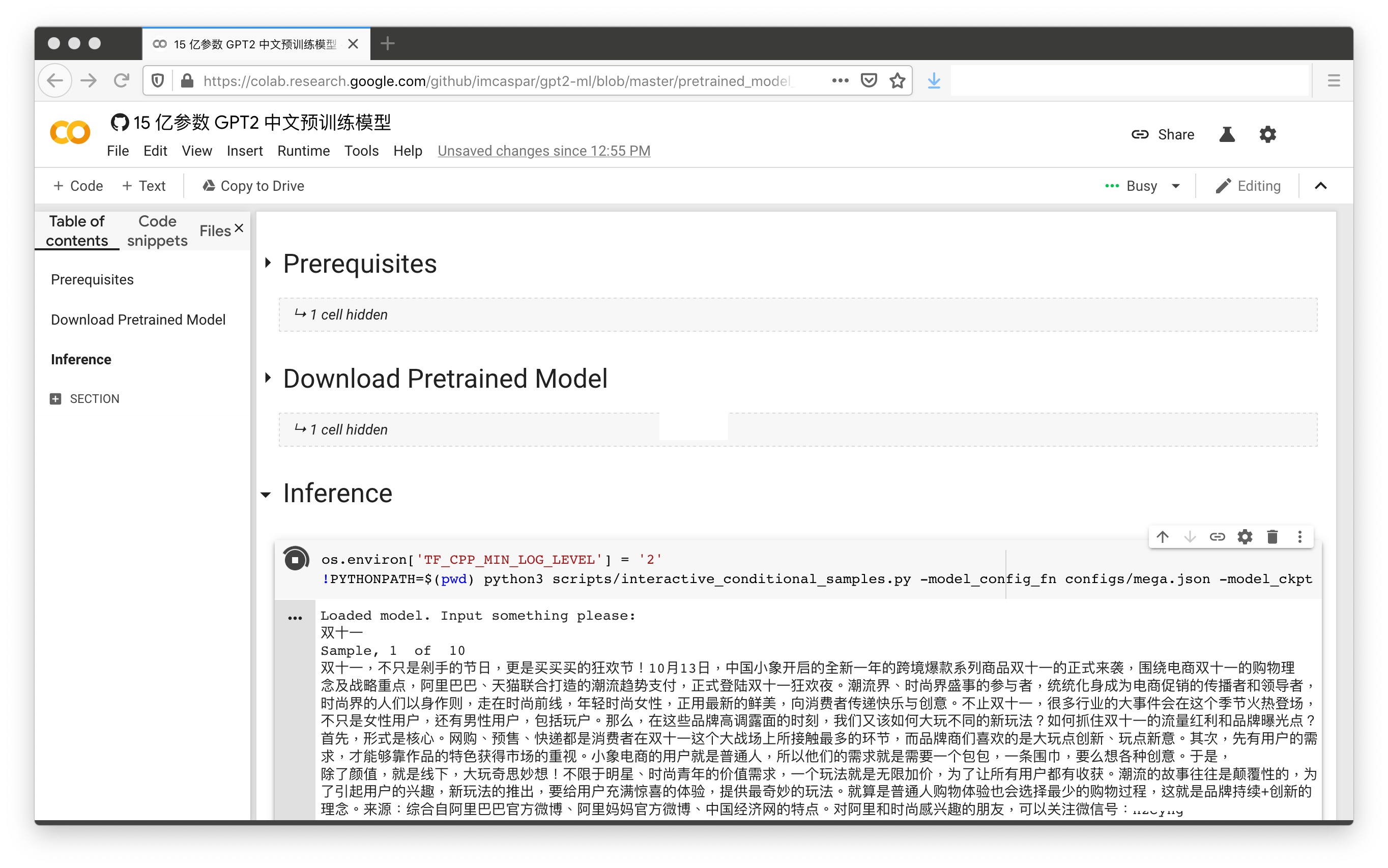

Com apenas 2 cliques (sem incluir o processo de autenticação do COLAB), a demonstração de modelo chinesa de 1,5 bilhão está pronta para ir:

[Notebook Colab]

O conteúdo deste repositório é para fins de pesquisa acadêmica e não fornecemos comentários conclusivos.

@misc{GPT2-ML,

author = {Zhibo Zhang},

title = {GPT2-ML: GPT-2 for Multiple Languages},

year = {2019},

publisher = {GitHub},

journal = {GitHub repository},

howpublished = {url{https://github.com/imcaspar/gpt2-ml}},

}

https://github.com/google-research/bert

https://github.com/rowanz/grover

Pesquisas suportadas com TPUs em nuvem da Cloud de pesquisa TensorFlow do Google (TFRC)

[机器之心] 只需单击三次 , 让中文 GPT-2 为你生成定制故事

[科学空间] 现在可以用 Keras 玩中文 Gpt2 了