gpt2 ml

V1.0 Release

中文说明| Английский

| Размер | Язык | Корпус | Слока | Link1 | Link2 | SHA256 |

|---|---|---|---|---|---|---|

| 1,5B Params | китайский | ~ 30 г | Подсказка (8021 токены) | Google Drive | PAIDU PAN (FFZ6) | E698CC97A7F5F706F84F58BB469D614E 51D3C0CE5F9AB9BF77E01E3FCB41D482 |

| 1,5B Params | китайский | ~ 15G | Берт (21128 токенов) | Google Drive | Baidu Pan (Q9VR) | 4A6E5124DF8DB7AC2BDD902E6191B807 A6983A7F5D09FB10CE011F9A073B183E |

Корпус из Thucnews и NLP_CHINESE_CORPUS

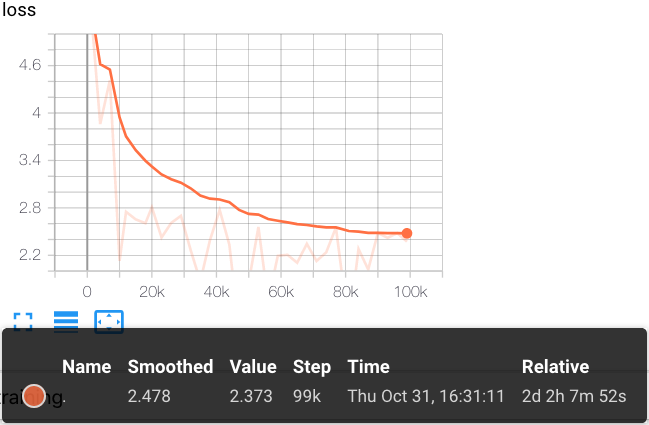

Использование облачного TPU POD V3-256 для тренировок 22 Вт

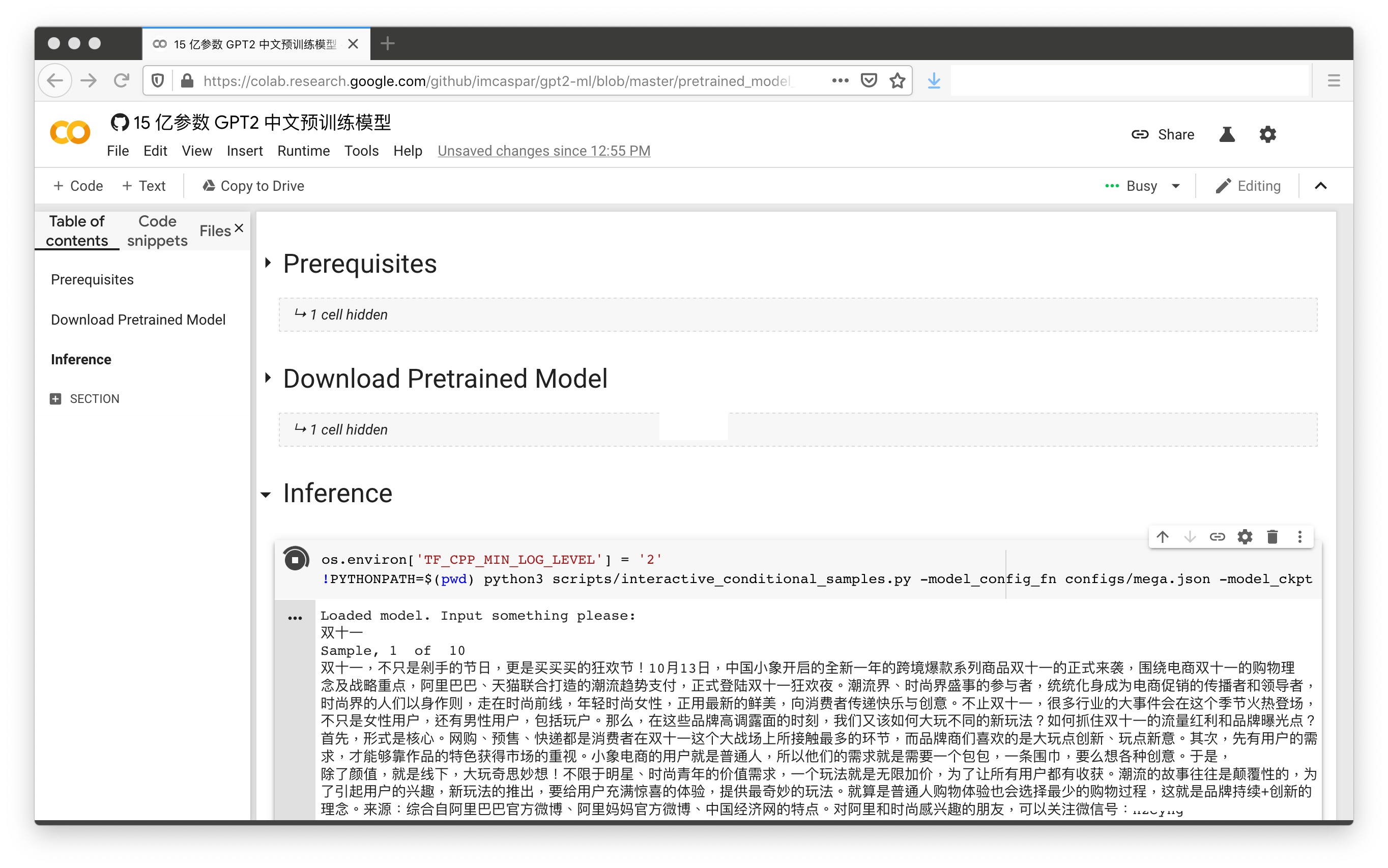

С всего лишь 2 щелчка (не включая процесс Colab Auth), демо, предварительно проведенная в 1,5B, готово к работе:

[Colab Notebook]

Содержание в этом хранилище предназначено для академических исследований, и мы не предоставляем никаких убедительных замечаний.

@misc{GPT2-ML,

author = {Zhibo Zhang},

title = {GPT2-ML: GPT-2 for Multiple Languages},

year = {2019},

publisher = {GitHub},

journal = {GitHub repository},

howpublished = {url{https://github.com/imcaspar/gpt2-ml}},

}

https://github.com/google-research/bert

https://github.com/rowanz/grover

Исследования, поддерживаемые облачными TPU из Google Tensorflow Research Cloud (TFRC)

[机器之心] 只需单击三次 , 让中文 gpt-2 为你生成定制故事

[科学空间] 现在可以用 керас 玩中文 gpt2 了