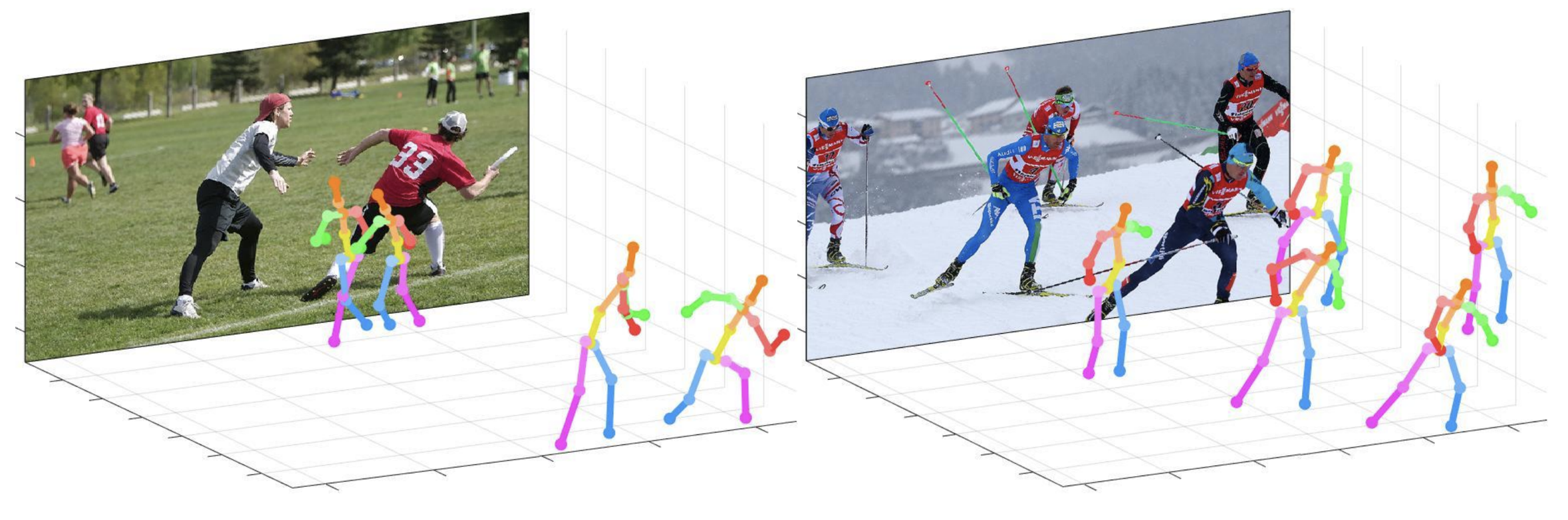

repo นี้เป็นการใช้งาน Pytorch อย่างเป็นทางการของ วิธีการจากบนลงล่างของกล้องระยะไกลสำหรับการประมาณแบบหลายบุคคลแบบ 3D จากภาพ RGB เดียว (ICCV 2019) มันมีส่วน Posenet

สิ่งที่ repo นี้ให้:

รหัสนี้ได้รับการทดสอบภายใต้ Ubuntu 16.04, Cuda 9.0, Cudnn 7.1 สภาพแวดล้อมที่มีสอง Nvidia 1080Ti GPU

Python 3.6.5 เวอร์ชั่นกับ Anaconda 3 ใช้สำหรับการพัฒนา

คุณสามารถลองสาธิตอย่างรวดเร็วที่ demo สาธิต

input.jpg และสแนปชอตที่ผ่านการฝึกอบรมมาแล้วที่โฟลเดอร์ demobbox_list ที่นี่root_depth_list ที่นี่python demo.py --gpu 0 --test_epoch 24 หากคุณต้องการทำงานบน GPU 0output_pose_2d.jpg และหน้าต่างใหม่ที่แสดงท่า 3 มิติ ${POSE_ROOT} อธิบายไว้ด้านล่าง

${POSE_ROOT}

|-- data

|-- demo

|-- common

|-- main

|-- tool

|-- vis

`-- output

data มีรหัสการโหลดข้อมูลและลิงก์ซอฟต์ไปยังไดเรกทอรีรูปภาพและคำอธิบายประกอบdemo มีรหัสสาธิตcommon ประกอบด้วยรหัสเคอร์เนลสำหรับระบบการประมาณแบบหลายบุคคล 3Dmain มีรหัสระดับสูงสำหรับการฝึกอบรมหรือทดสอบเครือข่ายtool มีรหัสการประมวลผลข้อมูลล่วงหน้า คุณไม่ต้องเรียกใช้รหัสนี้ ฉันให้ข้อมูลที่ประมวลผลล่วงหน้าด้านล่างvis มีสคริปต์สำหรับการสร้างภาพ 3 มิติoutput ประกอบด้วยบันทึกโมเดลที่ผ่านการฝึกอบรมเอาต์พุตที่มองเห็นได้และผลการทดสอบ คุณต้องทำตามโครงสร้างไดเรกทอรีของ data ด้านล่าง

${POSE_ROOT}

|-- data

| |-- Human36M

| | |-- bbox_root

| | | |-- bbox_root_human36m_output.json

| | |-- images

| | |-- annotations

| |-- MPII

| | |-- images

| | |-- annotations

| |-- MSCOCO

| | |-- bbox_root

| | | |-- bbox_root_coco_output.json

| | |-- images

| | | |-- train2017

| | | |-- val2017

| | |-- annotations

| |-- MuCo

| | |-- data

| | | |-- augmented_set

| | | |-- unaugmented_set

| | | |-- MuCo-3DHP.json

| |-- MuPoTS

| | |-- bbox_root

| | | |-- bbox_mupots_output.json

| | |-- data

| | | |-- MultiPersonTestSet

| | | |-- MuPoTS-3D.json

หากต้องการดาวน์โหลดหลายไฟล์จาก Google Drive โดยไม่ต้องบีบอัดลองใช้สิ่งนี้ หากคุณมีปัญหากับปัญหา 'การดาวน์โหลดขีด จำกัด ' เมื่อพยายามดาวน์โหลดชุดข้อมูลจากลิงค์ Google Drive โปรดลองใช้เคล็ดลับนี้

* Go the shared folder, which contains files you want to copy to your drive

* Select all the files you want to copy

* In the upper right corner click on three vertical dots and select “make a copy”

* Then, the file is copied to your personal google drive account. You can download it from your personal account.

คุณต้องทำตามโครงสร้างไดเรกทอรีของโฟลเดอร์ output ท์พุทด้านล่าง

${POSE_ROOT}

|-- output

|-- |-- log

|-- |-- model_dump

|-- |-- result

`-- |-- vis

output เป็นแบบฟอร์มลิงค์ซอฟต์แทนแบบฟอร์มโฟลเดอร์เพราะจะต้องใช้ความจุในการจัดเก็บขนาดใหญ่log ประกอบด้วยไฟล์บันทึกการฝึกอบรมmodel_dump มีจุดตรวจที่บันทึกไว้สำหรับแต่ละยุคresult มีไฟล์การประมาณขั้นสุดท้ายที่สร้างขึ้นในขั้นตอนการทดสอบvis มีผลลัพธ์ที่เห็นภาพ$DB_NAME_img_name.py เพื่อรับชื่อไฟล์ภาพในรูปแบบ. .txtpreds_2d_kpt_$DB_NAME.mat , preds_3d_kpt_$DB_NAME.mat ) ในโฟลเดอร์ single หรือ multi โฟลเดอร์draw_3Dpose_$DB_NAME.m main/config.py คุณสามารถเปลี่ยนการตั้งค่าของรุ่นรวมถึงชุดข้อมูลที่จะใช้แบ็คโบนเครือข่ายและขนาดอินพุตและอื่น ๆ ในโฟลเดอร์ main เรียกใช้

python train.py --gpu 0-1เพื่อฝึกอบรมเครือข่ายบน GPU 0,1

หากคุณต้องการทำการทดลองต่อให้เรียกใช้

python train.py --gpu 0-1 --continue --gpu 0,1 สามารถใช้แทน --gpu 0-1

วางโมเดลที่ผ่านการฝึกอบรมไว้ที่ output/model_dump/

ในโฟลเดอร์ main เรียกใช้

python test.py --gpu 0-1 --test_epoch 20 เพื่อทดสอบเครือข่ายบน GPU 0,1 ด้วยรูปแบบที่ผ่านการฝึกอบรมครั้งที่ 20 --gpu 0,1 สามารถใช้แทน --gpu 0-1

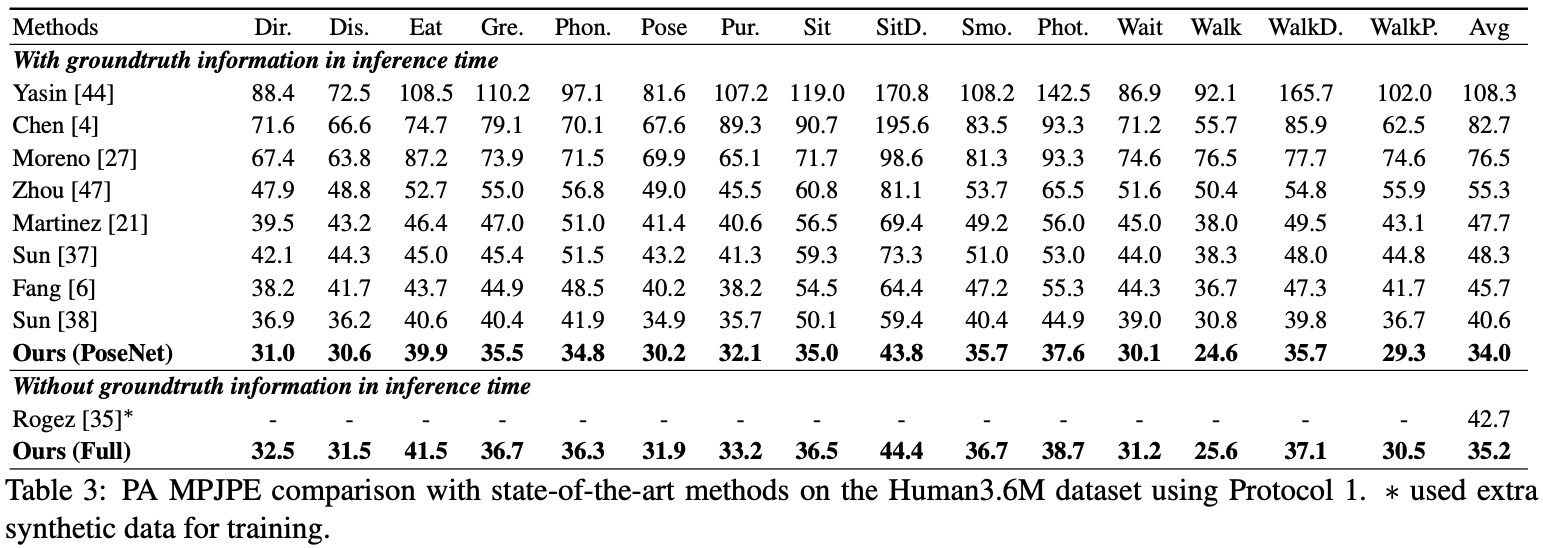

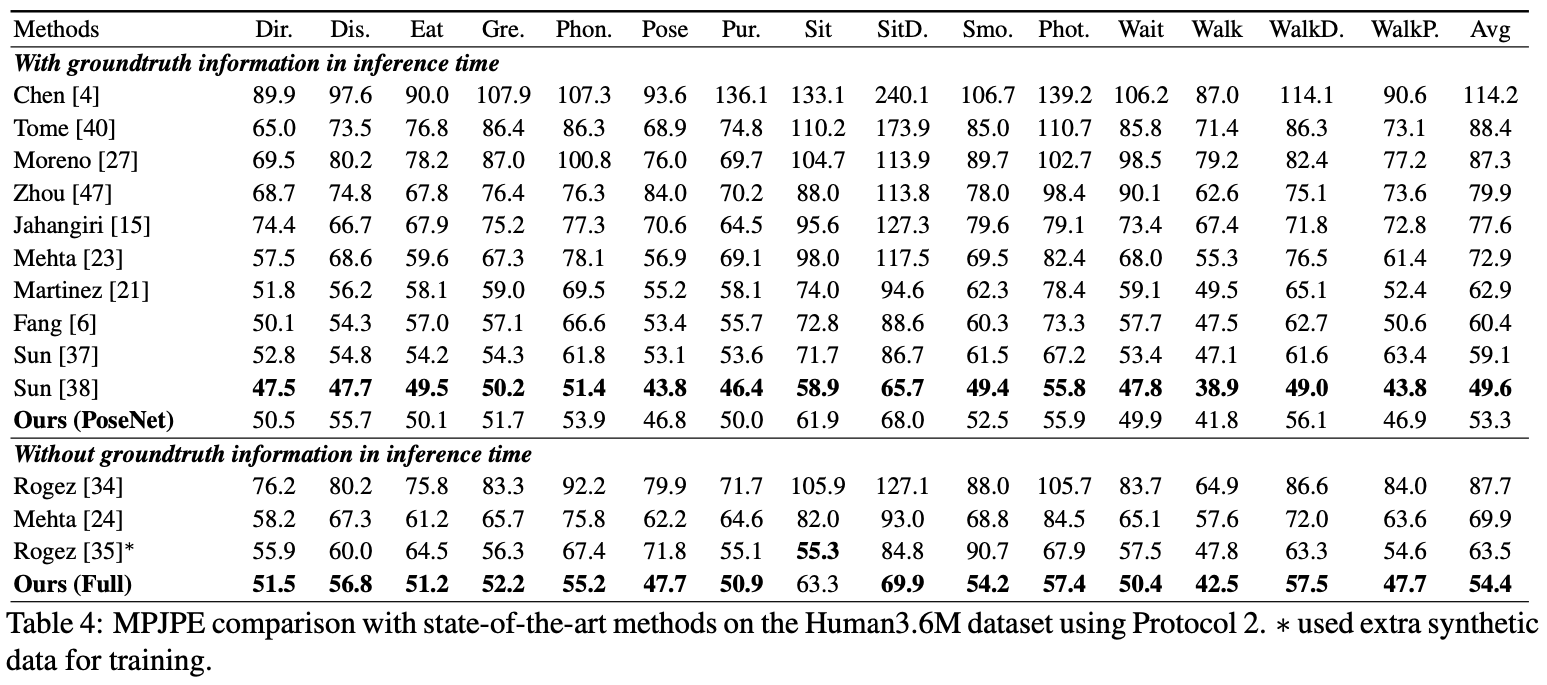

ที่นี่ฉันรายงานประสิทธิภาพของ Posenet

สำหรับการประเมินผลคุณสามารถเรียกใช้ test.py หรือมีรหัสการประเมินใน Human36M

สำหรับการประเมินผลคุณสามารถเรียกใช้ test.py หรือมีรหัสการประเมินใน Human36M

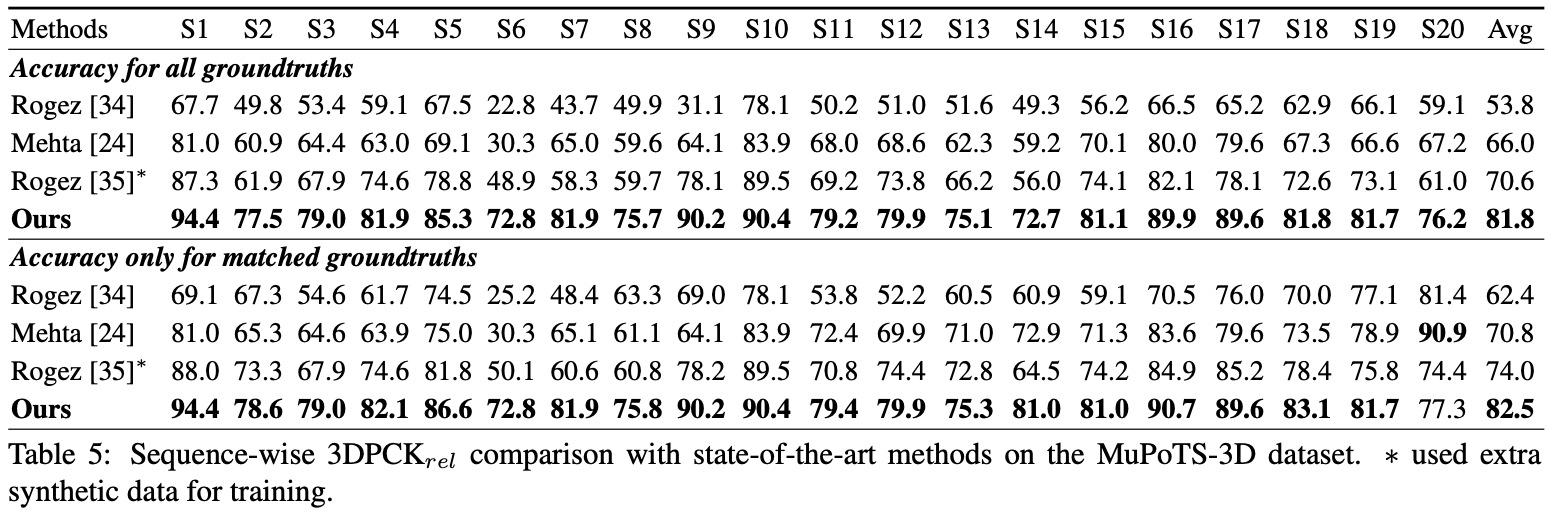

สำหรับการประเมินผลให้ Run test.py หลังจากนั้นให้ย้าย data/MuPoTS/mpii_mupots_multiperson_eval.m ใน data/MuPoTS/data นอกจากนี้ให้ย้ายไฟล์ผลการทดสอบ ( preds_2d_kpt_mupots.mat และ preds_3d_kpt_mupots.mat ) ใน data/MuPoTS/data จากนั้นเรียกใช้ mpii_mupots_multiperson_eval.m พร้อมอาร์กิวเมนต์โหมดการประเมินของคุณ

นอกจากนี้เรายังมีพิกัดรากมนุษย์ 3 มิติโดยประมาณในชุดข้อมูล MSCOCO พิกัดอยู่ในระบบพิกัดกล้อง 3 มิติและความยาวโฟกัสถูกตั้งค่าเป็น 1500 มม. สำหรับแกน X และ Y คุณสามารถเปลี่ยนความยาวโฟกัสและระยะทางที่สอดคล้องกันโดยใช้สมการ 2 หรือสมการในวัสดุเสริมของกระดาษของฉัน

@InProceedings{Moon_2019_ICCV_3DMPPE,

author = {Moon, Gyeongsik and Chang, Juyong and Lee, Kyoung Mu},

title = {Camera Distance-aware Top-down Approach for 3D Multi-person Pose Estimation from a Single RGB Image},

booktitle = {The IEEE Conference on International Conference on Computer Vision (ICCV)},

year = {2019}

}