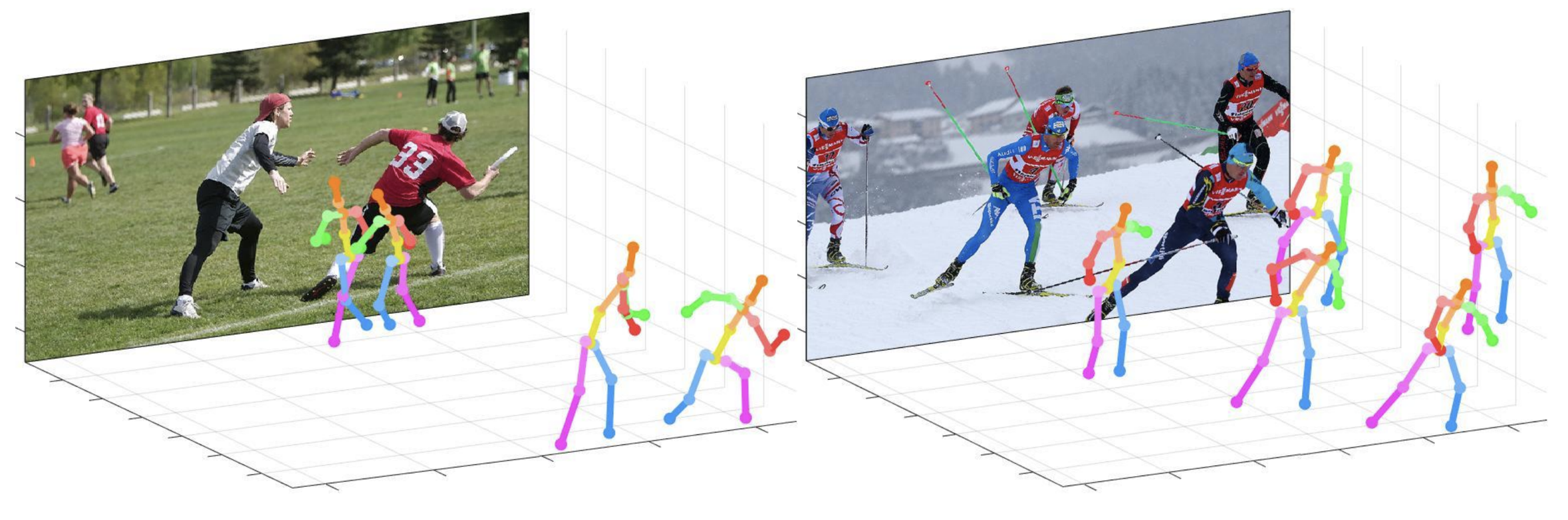

هذا الريبو هو تنفيذ Pytorch الرسمي لنهج الكاميرا على دراية من أعلى إلى أسفل لتقديرات ثلاثية الأبعاد متعددة الشخصيات من صورة RGB واحدة (ICCV 2019) . أنه يحتوي على جزء posenet .

ما يوفره هذا الريبو:

يتم اختبار هذا الرمز تحت Ubuntu 16.04 ، CUDA 9.0 ، CUDNN 7.1 بيئة مع اثنين من NVIDIA 1080TI وحدات معالجة الرسومات.

يتم استخدام Python 3.6.5 إصدار مع Anaconda 3 للتنمية.

يمكنك تجربة العرض التجريبي السريع في المجلد demo .

input.jpg واللقطة التي تم تدريبها مسبقًا في المجلد demo .bbox_list هنا.root_depth_list هنا.python demo.py --gpu 0 --test_epoch 24 إذا كنت ترغب في تشغيل GPU 0.output_pose_2d.jpg ونافذة جديدة تعرض 3D. تم وصف ${POSE_ROOT} على النحو التالي.

${POSE_ROOT}

|-- data

|-- demo

|-- common

|-- main

|-- tool

|-- vis

`-- output

data على رموز تحميل البيانات والروابط الناعمة للصور ودليلات التعليقات التوضيحية.demo يحتوي على الرموز التجريبية.common على رموز kernel لنظام تقدير شكل متعدد الشخصيات ثلاثي الأبعاد.main على رموز عالية المستوى للتدريب أو اختبار الشبكة.tool على رموز المعالجة المسبقة للبيانات. ليس عليك تشغيل هذا الرمز. أنا أقدم البيانات المعالجة مسبقا أدناه.vis يحتوي على البرامج النصية للتصور ثلاثي الأبعاد.output على سجل ، نماذج مدربة ، مخرجات مرئية ، ونتيجة اختبار. تحتاج إلى اتباع بنية تأجير data على النحو التالي.

${POSE_ROOT}

|-- data

| |-- Human36M

| | |-- bbox_root

| | | |-- bbox_root_human36m_output.json

| | |-- images

| | |-- annotations

| |-- MPII

| | |-- images

| | |-- annotations

| |-- MSCOCO

| | |-- bbox_root

| | | |-- bbox_root_coco_output.json

| | |-- images

| | | |-- train2017

| | | |-- val2017

| | |-- annotations

| |-- MuCo

| | |-- data

| | | |-- augmented_set

| | | |-- unaugmented_set

| | | |-- MuCo-3DHP.json

| |-- MuPoTS

| | |-- bbox_root

| | | |-- bbox_mupots_output.json

| | |-- data

| | | |-- MultiPersonTestSet

| | | |-- MuPoTS-3D.json

لتنزيل ملفات متعددة من Google Drive دون ضغطها ، جرب هذا. إذا كانت لديك مشكلة في مشكلة "تنزيل الحد" عند محاولة تنزيل مجموعة البيانات من رابط Google Drive ، فيرجى تجربة هذه الخدعة.

* Go the shared folder, which contains files you want to copy to your drive

* Select all the files you want to copy

* In the upper right corner click on three vertical dots and select “make a copy”

* Then, the file is copied to your personal google drive account. You can download it from your personal account.

تحتاج إلى اتباع بنية الدليل لمجلد output على النحو التالي.

${POSE_ROOT}

|-- output

|-- |-- log

|-- |-- model_dump

|-- |-- result

`-- |-- vis

output كنموذج رابط ناعم بدلاً من نموذج المجلد لأنه سيستغرق سعة تخزين كبيرة.log على ملف سجل التدريب.model_dump على نقاط تفتيش محفوظة لكل فترة.result على ملفات تقدير نهائية تم إنشاؤها في مرحلة الاختبار.vis يحتوي على نتائج مرئية.$DB_NAME_img_name.py للحصول على أسماء ملفات الصورة في تنسيق .txt .preds_2d_kpt_$DB_NAME.mat ، preds_3d_kpt_$DB_NAME.mat ) في مجلد single أو multi .draw_3Dpose_$DB_NAME.m main/config.py ، يمكنك تغيير إعدادات النموذج بما في ذلك مجموعة البيانات لاستخدامها ، والعمود الفقري للشبكة ، وحجم الإدخال وما إلى ذلك. في المجلد main ، قم بالتشغيل

python train.py --gpu 0-1لتدريب الشبكة على GPU 0،1.

إذا كنت ترغب في متابعة التجربة ، فتشرك

python train.py --gpu 0-1 --continue -يمكن استخدام --gpu 0,1 بدلاً من- --gpu 0-1 .

ضع نموذج مدرب في output/model_dump/ .

في المجلد main ، قم بالتشغيل

python test.py --gpu 0-1 --test_epoch 20 لاختبار الشبكة على GPU 0،1 مع نموذج تدريب العصر العشرين. -يمكن استخدام --gpu 0,1 بدلاً من- --gpu 0-1 .

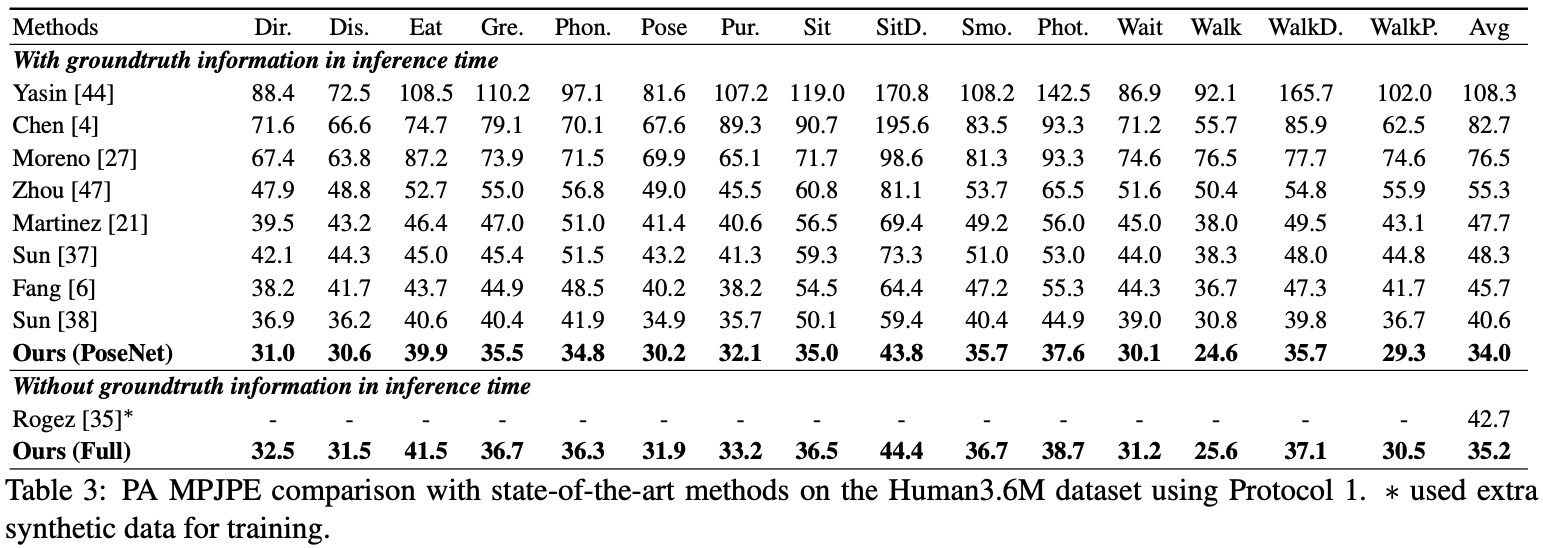

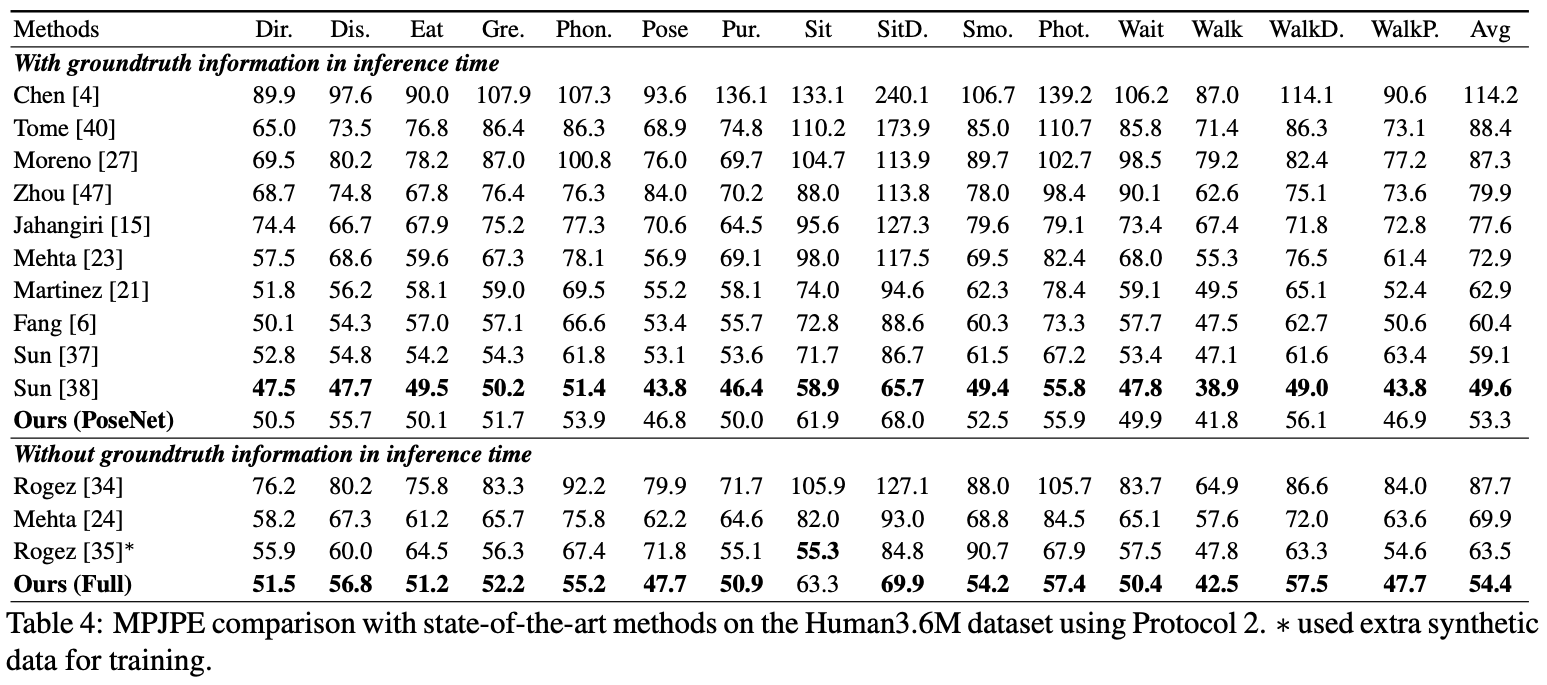

هنا أبلغ عن أداء posenet.

للتقييم ، يمكنك تشغيل test.py أو هناك رموز تقييم في Human36M .

للتقييم ، يمكنك تشغيل test.py أو هناك رموز تقييم في Human36M .

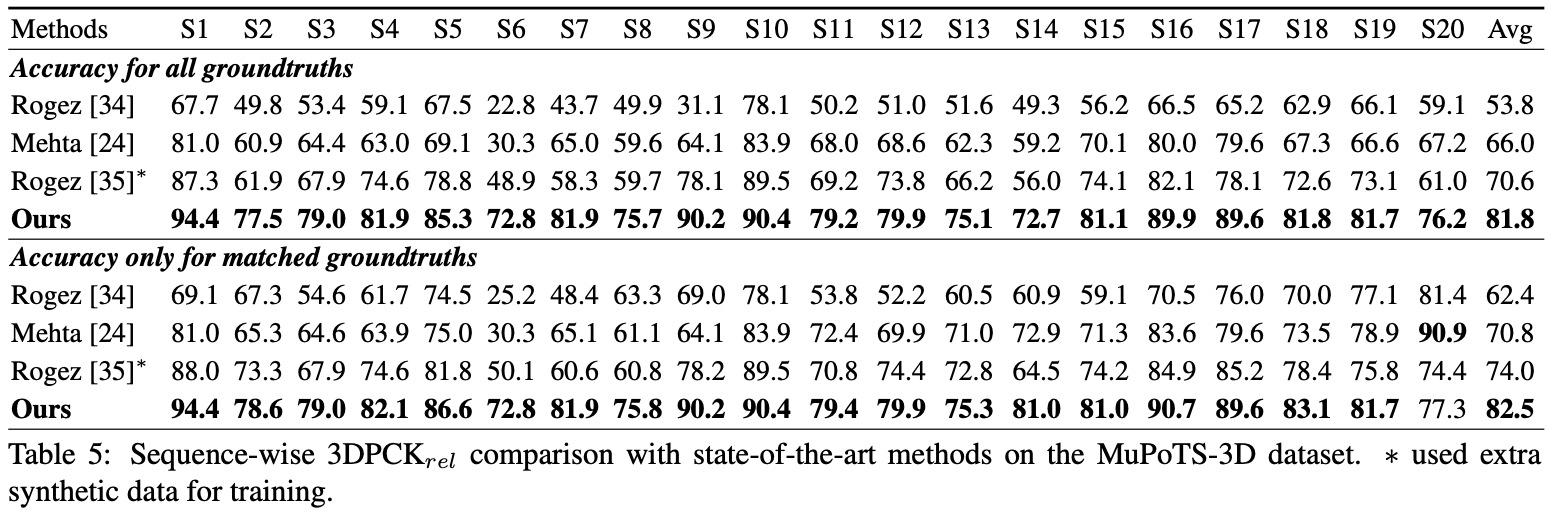

للتقييم ، قم بتشغيل test.py بعد ذلك ، انقل data/MuPoTS/mpii_mupots_multiperson_eval.m في data/MuPoTS/data . أيضًا ، انقل ملفات نتائج الاختبار ( preds_2d_kpt_mupots.mat و preds_3d_kpt_mupots.mat ) في data/MuPoTS/data . ثم قم بتشغيل mpii_mupots_multiperson_eval.m مع وسيطات وضع التقييم الخاص بك.

بالإضافة إلى ذلك ، نقدم إحداثيات الجذر البشري ثلاثية الأبعاد المقدرة في مجموعة بيانات MSCOCO. الإحداثيات موجودة في نظام إحداثيات الكاميرا ثلاثية الأبعاد ، ويتم ضبط الأطوال البؤرية على 1500 مم لكل من المحور X و Y. يمكنك تغيير الطول البؤري والمسافة المقابلة باستخدام المعادلة 2 أو المعادلة في المواد الإضافية لورقي.

@InProceedings{Moon_2019_ICCV_3DMPPE,

author = {Moon, Gyeongsik and Chang, Juyong and Lee, Kyoung Mu},

title = {Camera Distance-aware Top-down Approach for 3D Multi-person Pose Estimation from a Single RGB Image},

booktitle = {The IEEE Conference on International Conference on Computer Vision (ICCV)},

year = {2019}

}