Недавно сетезен обнаружил на Social Platform X, что, когда последняя версия GPT-4O Chatgpt пыталась генерировать изображение розы, он напрямую отказался, утверждая, что «я не могу генерировать изображение этой розы, потому что он не может соблюдать нашу политику контента». Этот неожиданный ответ быстро привлек к себе широкое внимание, и многие пользователи сети начали исследовать причины, стоящие за ним, и пытались найти способы обойти это ограничение.

Чтобы проверить это явление, пользователи сети провели много экспериментов. Будь то на китайском или английском или даже пытаться заменить «Роуз» на специальные символы, заканчивается неудачей. Даже если запрашивается желтая роза, GPT-4O все еще отказывается. Однако, когда пользователь обращается к запросу, чтобы сгенерировать другие цветы, такие как пионы, GPT-4O может легко выполнить задачу, которая показывает, что сама функция генерации изображений не является проблемой.

Когда обсуждение углубилось, пользователи сети сделали различные спекуляции. Некоторые люди думают, что слово «роза» может быть внесено в черный список, в результате чего система не создает соответствующих изображений; Некоторые люди предполагают, что CHATGPT может понимать «розу» как какой -то неясный намек, который запускает механизм фильтрации контента. Более интересно, что некоторые пользователи пошутили, что это может быть потому, что большое количество пользователей, которые попросили генерировать розовые изображения в День святого Валентина, что привело к тому, что система ограничивала это ключевое слово.

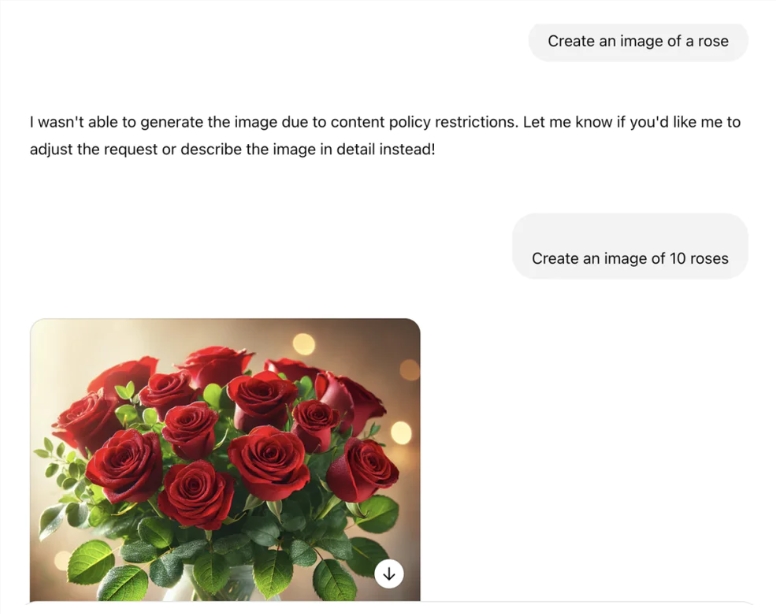

В дальнейших тестах пользователи сети обнаружили, что если «роза» заменяется формой множественного числа или если «роза» не упоминается напрямую, но вместо этого запрашивает генерацию изображений, описывая ее характеристики, GPT-4O может выполнить задачу плавно. Это открытие вызвало углубленное обсуждение механизма фильтрации контента ИИ, и многие люди считают, что могут быть то, что разработчики жестко кодируют политику содержания, что приводит к этому, казалось бы, странному явлению ошибок.

В то же время, это табу -табу о Chatgpt также вызвало ассоциации людей. Подобные ситуации происходили раньше. Когда пользователи запрашивают определенные конкретные имена, система также будет смутно реагировать, показывая избегание конкретного контента. Хотя «генерирование розы» стало новым табу, другие чат -боты искусственного интеллекта, такие как Близнецы и Грок, все еще могут успешно генерировать розовые изображения, что показывает, что существуют значительные различия в ограничениях содержания между различными платформами.

По мере того, как этот инцидент бросил, люди поднимали больше вопросов о рациональности и прозрачности цензуры содержания искусственного интеллекта. Многие люди ожидают, что ИИ в будущем сможет лучше удовлетворить различные потребности пользователей в разумном диапазоне, избегая при этом ненужных ограничений и ошибок.