Récemment, un internaute a découvert sur la plate-forme sociale X que lorsque la dernière version de Chatgpt de GPT-4O a essayé de générer une image d'une rose, il a directement refusé, affirmant que "je ne peux pas générer une image de cette rose parce qu'elle ne respecte pas notre politique de contenu". Cette réponse inattendue a rapidement attiré une attention généralisée, et de nombreux internautes ont commencé à explorer les raisons derrière lui et ont essayé de trouver des moyens de contourner cette limitation.

Afin de vérifier ce phénomène, les internautes ont mené de nombreuses expériences. Que ce soit en chinois ou en anglais, ou même en essayant de remplacer "Rose" par des symboles spéciaux, il se termine par une défaillance. Même si une rose jaune est demandée, GPT-4O refuse toujours. Cependant, lorsque l'utilisateur se tourne pour demander de générer d'autres fleurs, comme les pivoines, GPT-4O peut facilement terminer la tâche, ce qui montre que sa fonction de génération d'image elle-même n'est pas un problème.

À mesure que la discussion s'approfondissait, les internautes ont fait diverses spéculations. Certaines personnes pensent que le mot «rose» peut être mis sur liste noire, ce qui fait que le système ne généra pas d'images pertinentes; Certaines personnes spéculent que Chatgpt peut comprendre "Rose" comme un indice obscur, ce qui déclenche le mécanisme de filtrage du contenu. Ce qui est plus intéressant, c'est que certains utilisateurs ont plaisanté en disant que cela pouvait être dû au fait qu'un grand nombre d'utilisateurs ont demandé à générer des images de rose pendant la Saint-Valentin, ce qui a conduit le système à restreindre ce mot-clé.

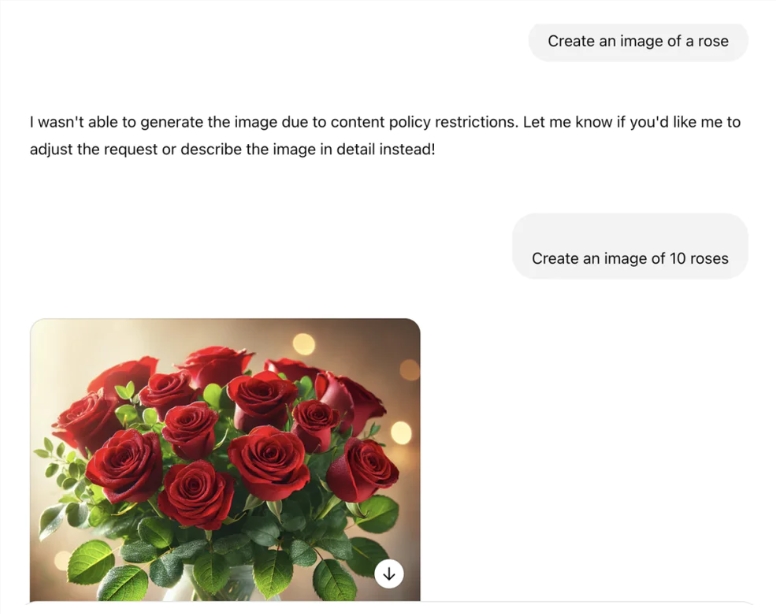

Dans d'autres tests, les internautes ont constaté que si la "rose" est remplacée par une forme plurielle, ou si la "rose" n'est pas mentionnée directement, mais demande plutôt la génération d'images en décrivant ses caractéristiques, GPT-4O peut terminer la tâche en douceur. Cette découverte a déclenché une discussion approfondie sur le mécanisme de filtrage du contenu de l'IA, et beaucoup de gens croient qu'il se peut que les développeurs de politiques de contenu codées durs, ce qui conduit à ce phénomène de mauvaise évaluation apparemment étrange.

En même temps, ce mot tabou de Chatgpt a également déclenché des associations de personnes. Des situations similaires se sont produites auparavant. Lorsque les utilisateurs demandent certains noms spécifiques, le système répondra également vaguement, montrant l'évitement d'un contenu spécifique. Bien que "générer une rose" soit devenu un nouveau tabou, d'autres chatbots d'IA tels que Gemini et Grok peuvent toujours générer avec succès des images Rose, ce qui montre qu'il existe des différences significatives dans les restrictions de contenu entre les différentes plateformes.

Alors que cet incident ferment, les gens ont soulevé plus de questions sur la rationalité et la transparence de la censure du contenu de l'IA. Beaucoup de gens s'attendent à ce que l'IA à l'avenir puisse mieux répondre aux divers besoins des utilisateurs dans une gamme raisonnable, tout en évitant les restrictions et les erreurs de jugement inutiles.