Recientemente, un internautor descubrió en la plataforma social X que cuando la última versión de Chatgpt de GPT-4O intentó generar una imagen de una rosa, se negó directamente, alegando que "no puedo generar una imagen de esta rosa porque no cumple con nuestra política de contenido". Esta respuesta inesperada rápidamente atrajo una atención generalizada, y muchos internautas comenzaron a explorar las razones detrás de esto e intentaron encontrar formas de evitar esta limitación.

Para verificar este fenómeno, los internautas realizaron muchos experimentos. Ya sea en chino o inglés, o incluso tratando de reemplazar la "rosa" con símbolos especiales, termina en el fracaso. Incluso si se solicita una rosa amarilla, GPT-4O todavía se niega. Sin embargo, cuando el usuario recurre a solicitar generar otras flores, como las peonías, GPT-4O puede completar fácilmente la tarea, que muestra que su función de generación de imágenes en sí no es un problema.

A medida que se profundizó la discusión, los internautas hicieron varias especulaciones. Algunas personas piensan que la palabra "rosa" puede estar en la lista negra, lo que hace que el sistema no genere imágenes relevantes; Algunas personas especulan que ChatGPT puede entender "Rose" como una pista oscura, lo que desencadena el mecanismo de filtrado de contenido. Lo más interesante es que algunos usuarios bromearon que puede deberse a que una gran cantidad de usuarios solicitaron generar imágenes de rosas durante el Día de San Valentín, lo que llevó al sistema a restringir esta palabra clave.

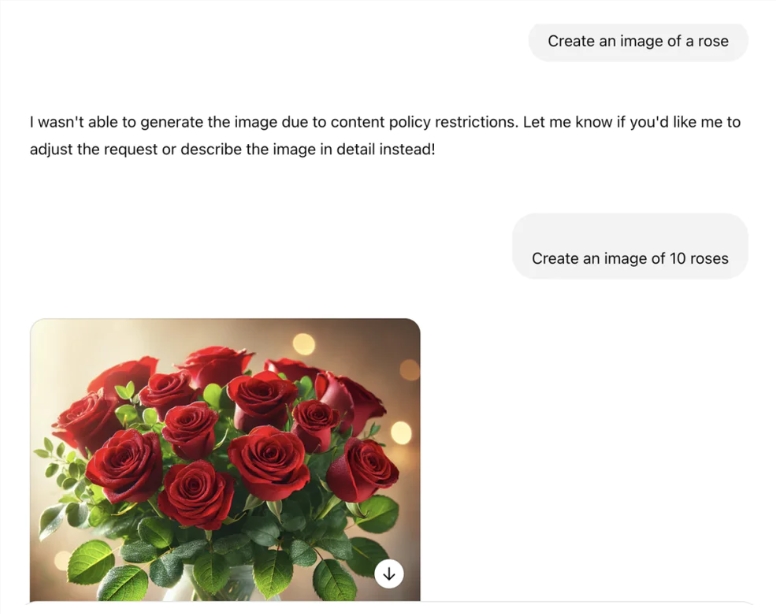

En pruebas adicionales, los internautas encontraron que si la "rosa" se reemplaza con una forma plural, o si la "rosa" no se menciona directamente, sino que solicita la generación de imágenes describiendo sus características, GPT-4O puede completar la tarea sin problemas. Este descubrimiento desencadenó una discusión en profundidad del mecanismo de filtrado de contenido de IA, y muchas personas creen que puede ser que los desarrolladores codifican las políticas de contenido, lo que lleva a este fenómeno de juicio erróneo aparentemente extraño.

Al mismo tiempo, esta palabra tabú de chatgpt también desencadenó las asociaciones de las personas. Situaciones similares han ocurrido antes. Cuando los usuarios solicitan ciertos nombres específicos, el sistema también responderá vagamente, mostrando la evitación de contenido específico. Aunque "Generación de una rosa" se ha convertido en un nuevo tabú, otros chatbots de IA como Gemini y Grok aún pueden generar con éxito imágenes de rosa, lo que muestra que existen diferencias significativas en las restricciones de contenido entre diferentes plataformas.

A medida que este incidente fermenta, las personas han planteado más preguntas sobre la racionalidad y la transparencia de la censura de contenido de IA. Muchas personas esperan que la IA en el futuro pueda satisfacer mejor las diversas necesidades de los usuarios dentro de un rango razonable, al tiempo que evita restricciones innecesarias y juicios erróneos.