Recentemente, um internautas descobriu na plataforma social X que, quando a versão mais recente do GPT-4O do ChatGPT tentou gerar uma imagem de uma rosa, ele recusou diretamente, alegando que "não posso gerar uma imagem disso porque ela não cumpre nossa política de conteúdo". Essa resposta inesperada rapidamente atraiu atenção generalizada, e muitos internautas começaram a explorar as razões por trás disso e tentaram encontrar maneiras de ignorar essa limitação.

Para verificar esse fenômeno, os internautas realizaram muitas experiências. Seja em chinês ou inglês ou até mesmo tentando substituir "rosa" por símbolos especiais, termina em falha. Mesmo que uma rosa amarela seja solicitada, o GPT-4O ainda se recusa. No entanto, quando o usuário se volta para solicitar outras flores, como peônias, o GPT-4O pode concluir facilmente a tarefa, o que mostra que sua função de geração de imagens em si não é um problema.

À medida que a discussão se aprofundava, os internautas fizeram várias especulações. Algumas pessoas pensam que a palavra "rosa" pode estar na lista negra, fazendo com que o sistema não tenha gerado imagens relevantes; Algumas pessoas especulam que o ChatGPT pode entender "Rose" como uma dica obscura, que desencadeia o mecanismo de filtragem de conteúdo. O mais interessante é que alguns usuários brincavam que pode ser porque um grande número de usuários solicitados a gerar imagens de rosas durante o Dia dos Namorados, o que levou ao sistema restringir essa palavra -chave.

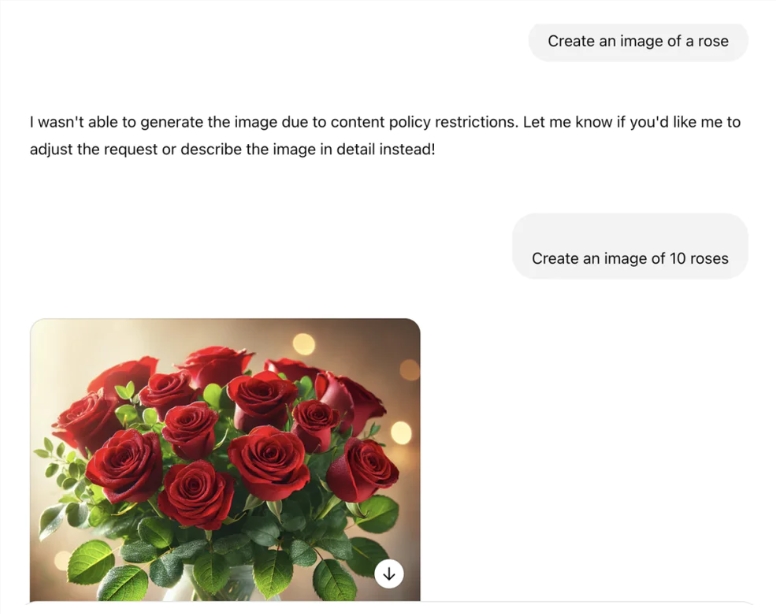

Em outros testes, os internautas descobriram que, se a "rosa" for substituída por uma forma plural ou se a "rosa" não for mencionada diretamente, mas solicitar a geração de imagens descrevendo suas características, o GPT-4O pode concluir a tarefa sem problemas. Essa descoberta desencadeou uma discussão aprofundada sobre o mecanismo de filtragem de conteúdo de IA, e muitas pessoas acreditam que pode ser que os desenvolvedores codificam políticas de conteúdo, levando a esse fenômeno de julgamento aparentemente estranho.

Ao mesmo tempo, essa palavra tabu de chatgpt também desencadeou as associações de pessoas. Situações semelhantes já ocorreram antes. Quando os usuários solicitam certos nomes específicos, o sistema também responderá vagamente, mostrando a prevenção de conteúdo específico. Embora "gerar uma rosa" tenha se tornado um novo tabu, outros chatbots da IA, como Gemini e Grok, ainda podem gerar com sucesso imagens de rosas, o que mostra que existem diferenças significativas nas restrições de conteúdo entre diferentes plataformas.

À medida que esse incidente fermenta, as pessoas levantaram mais questões sobre a racionalidade e a transparência da censura de conteúdo de IA. Muitas pessoas esperam que a IA no futuro possa atender melhor às diversas necessidades dos usuários dentro de um intervalo razoável, evitando restrições e julgamentos desnecessários.