A Universidade de Hong Kong e a ByteDance lançaram em conjunto o LlamaGen, uma tecnologia inovadora que aplica o paradigma de previsão de modelos de linguagem em grande escala ao campo da geração de imagens e alcançou resultados notáveis. Ao redesenhar o segmentador de imagem e treinar o modelo em larga escala, o LlamaGen alcança desempenho líder de geração de imagem sem a necessidade de viés de indução de sinal visual, trazendo novos avanços para o campo de geração de imagem. Esta tecnologia não só tem um bom desempenho no benchmark ImageNet, mas também demonstra excelentes capacidades em qualidade de imagem e alinhamento de texto, e alcança aceleração significativa através da estrutura de serviço vllm. Os vários modelos e ferramentas que fornece fornecem recursos valiosos para desenvolvedores e pesquisadores.

Entrada do produto: https://top.aibase.com/tool/llamagen

LlamaGen é uma inovação disruptiva em relação aos modelos tradicionais de geração de imagens, demonstrando que modelos autorregressivos comuns podem alcançar desempenho líder de geração de imagens mesmo na ausência de viés de indução de sinal visual, desde que sejam dimensionados adequadamente. A autorregressão LlamaGen é a saída do Transformer e o próximo token é usado como entrada para prever o próximo token. Ele usa a arquitetura LLaMA e não usa o modelo Diffusion. Esta descoberta traz novas possibilidades e inspirações para o campo da geração de imagens e fornece novas ideias e direções para futuras pesquisas em geração de imagens.

Os recursos do LlamaGen incluem:

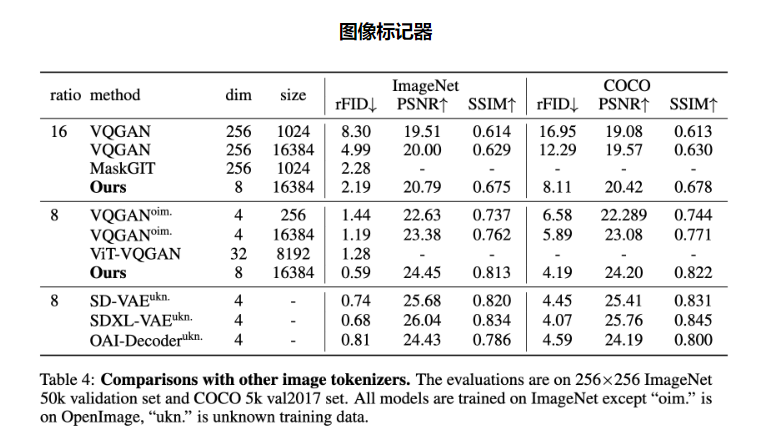

Tokenizer de imagem: lançou um tokenizer de imagem com taxa de redução de resolução de 16x, qualidade de reconstrução de 0,94 e utilização de livro de código de 97%, que teve um bom desempenho no benchmark ImageNet.

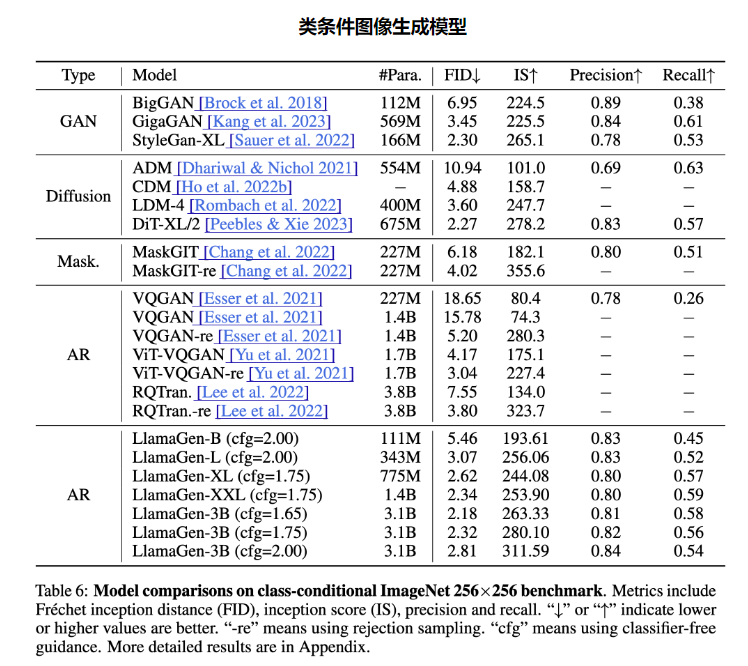

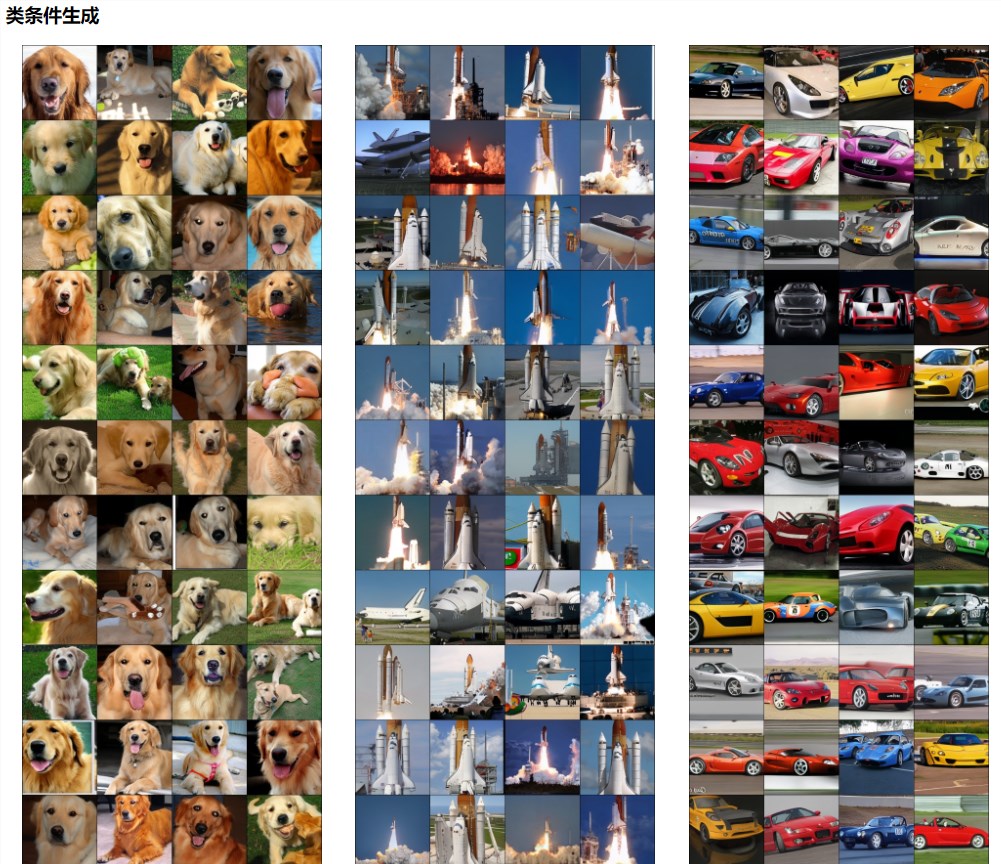

Modelo de geração de imagem condicional por categoria: Uma série de modelos de geração de imagem condicional por categoria com faixas de parâmetros de 111M a 3,1B foi lançada, alcançando um FID de 2,18 no benchmark ImageNet256×256, superando o popular modelo de difusão.

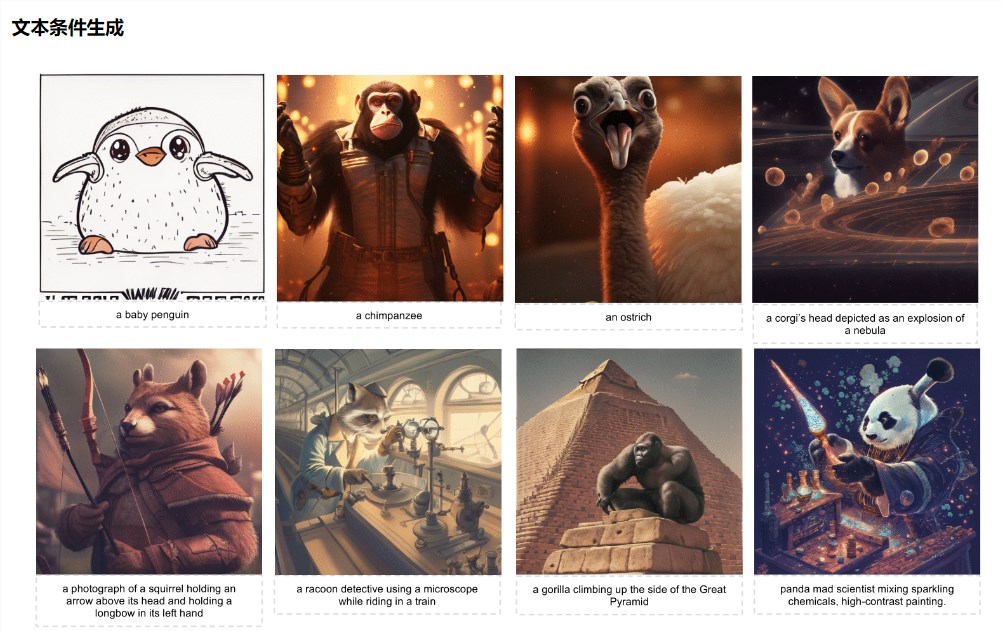

Modelo de geração de imagem condicional de texto: Um modelo de geração de imagem condicional de texto com parâmetros de 775M foi lançado após treinamento em duas etapas pela LAION-COCO, ele pode gerar imagens estéticas de alta qualidade e demonstrar excelente qualidade visual e desempenho de alinhamento de texto.

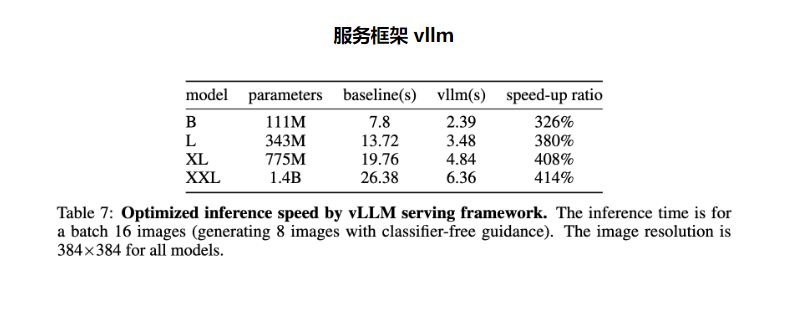

Estrutura de serviço vllm: Verificou a eficácia da estrutura de serviço LLM na otimização da velocidade de inferência do modelo de geração de imagens, alcançando uma aceleração de 326% a 414%.

Neste projeto, a equipe de pesquisa lançou dois segmentadores de imagem, modelos de geração condicional de sete categorias e dois modelos de geração condicional de texto, ao mesmo tempo que fornece demonstrações online e uma estrutura de serviço de alto rendimento. O lançamento desses modelos e ferramentas fornece aos desenvolvedores e pesquisadores uma riqueza de recursos e ferramentas, permitindo-lhes compreender e aplicar melhor a tecnologia LlamaGen.

O surgimento do LlamaGen não apenas promove o avanço da tecnologia de geração de imagens, mas também fornece novos rumos e ideias para pesquisas futuras no campo da inteligência artificial. Vale a pena aguardar sua aplicação e desenvolvimento em mais campos.