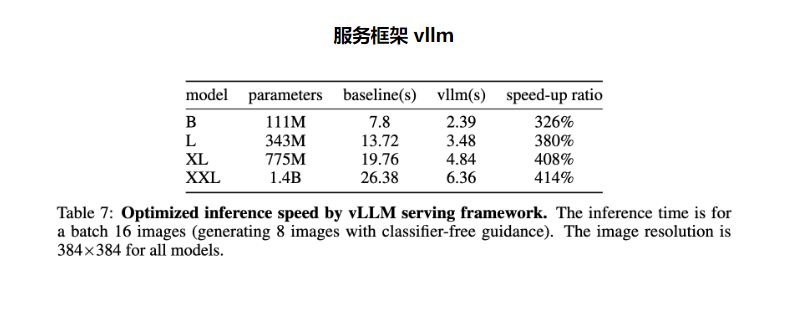

Die Universität Hongkong und ByteDance haben gemeinsam LlamaGen veröffentlicht, eine innovative Technologie, die das Vorhersageparadigma groß angelegter Sprachmodelle auf den Bereich der Bilderzeugung anwendet und bemerkenswerte Ergebnisse erzielt hat. Durch die Neugestaltung des Bildsegmentierers und das Training des Modells in großem Maßstab erreicht LlamaGen eine führende Bilderzeugungsleistung, ohne dass eine visuelle Signalinduktionsvorspannung erforderlich ist, und bringt so neue Durchbrüche auf dem Gebiet der Bilderzeugung. Diese Technologie schneidet nicht nur im ImageNet-Benchmark gut ab, sondern zeigt auch hervorragende Fähigkeiten in der Bildqualität und Textausrichtung und erreicht durch das vllm-Service-Framework eine deutliche Beschleunigung. Die verschiedenen Modelle und Tools, die es bereitstellt, stellen wertvolle Ressourcen für Entwickler und Forscher bereit.

Produkteingang: https://top.aibase.com/tool/llamagen

LlamaGen ist eine bahnbrechende Innovation gegenüber herkömmlichen Bilderzeugungsmodellen und zeigt, dass gewöhnliche autoregressive Modelle auch ohne visuelle Signalinduktionsverzerrung eine führende Bilderzeugungsleistung erzielen können, sofern sie ordnungsgemäß skaliert sind. Die LlamaGen-Autoregression ist die Ausgabe des Transformers und der nächste Token wird als Eingabe für die Vorhersage des nächsten Tokens verwendet. Sie verwendet die LLaMA-Architektur und nicht das Diffusionsmodell. Diese Entdeckung bringt neue Möglichkeiten und Inspirationen auf dem Gebiet der Bilderzeugung und liefert neue Ideen und Richtungen für die zukünftige Bilderzeugungsforschung.

Zu den Funktionen von LlamaGen gehören:

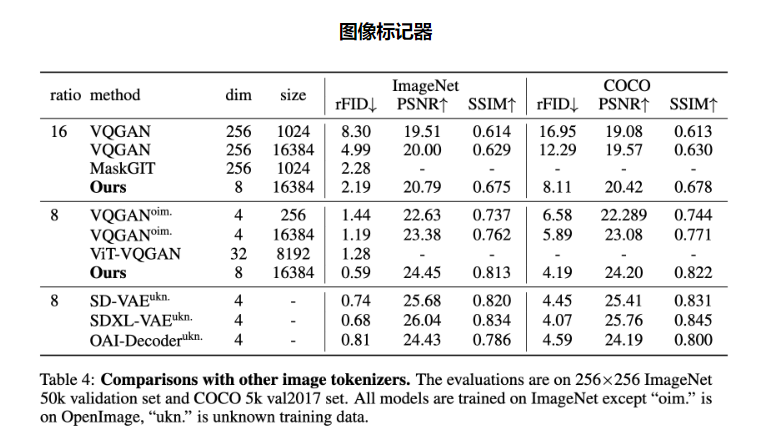

Image-Tokenizer: Einführung eines Image-Tokenizers mit 16-fachem Downsampling-Verhältnis, 0,94-Rekonstruktionsqualität und 97 % Codebuchauslastung, der beim ImageNet-Benchmark gut abschnitt.

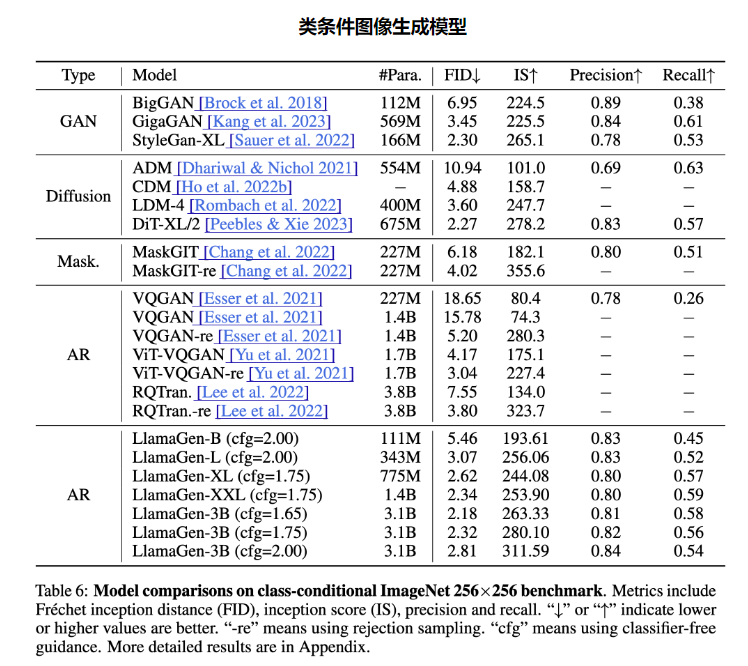

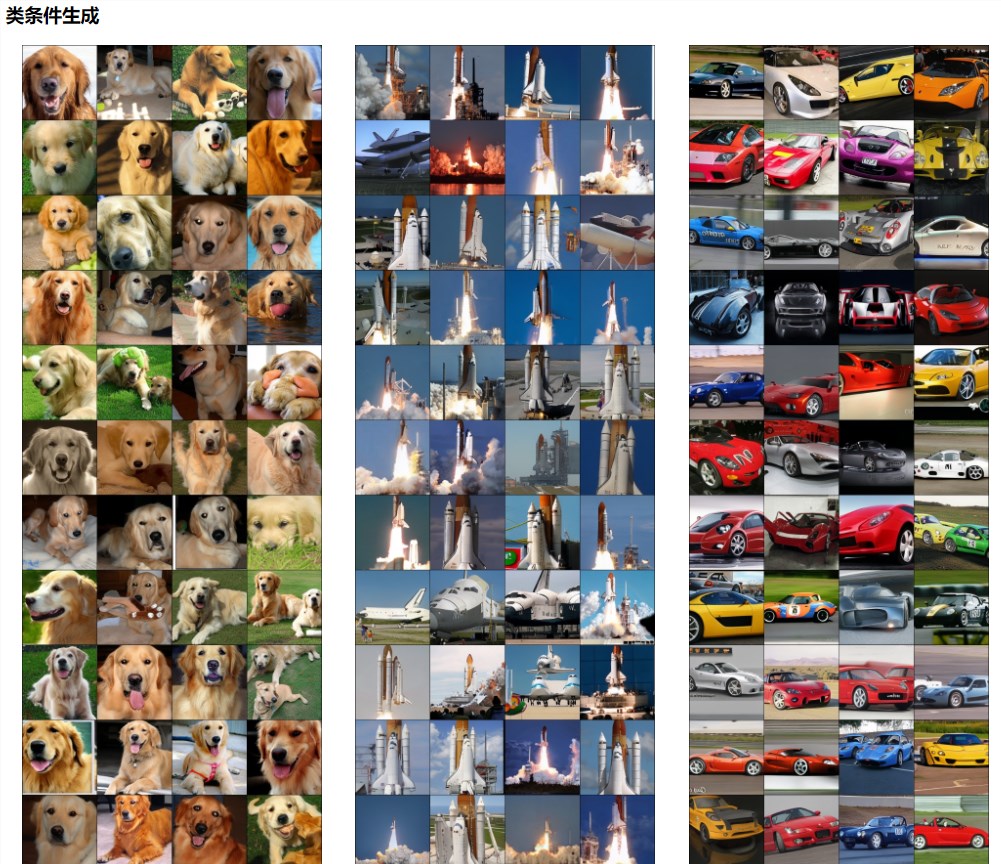

Kategoriebedingtes Bildgenerierungsmodell: Eine Reihe kategoriebedingter Bildgenerierungsmodelle mit Parameterbereichen von 111M bis 3,1B wurden eingeführt und erreichten einen FID von 2,18 beim ImageNet256×256-Benchmark, was das beliebte Diffusionsmodell übertrifft.

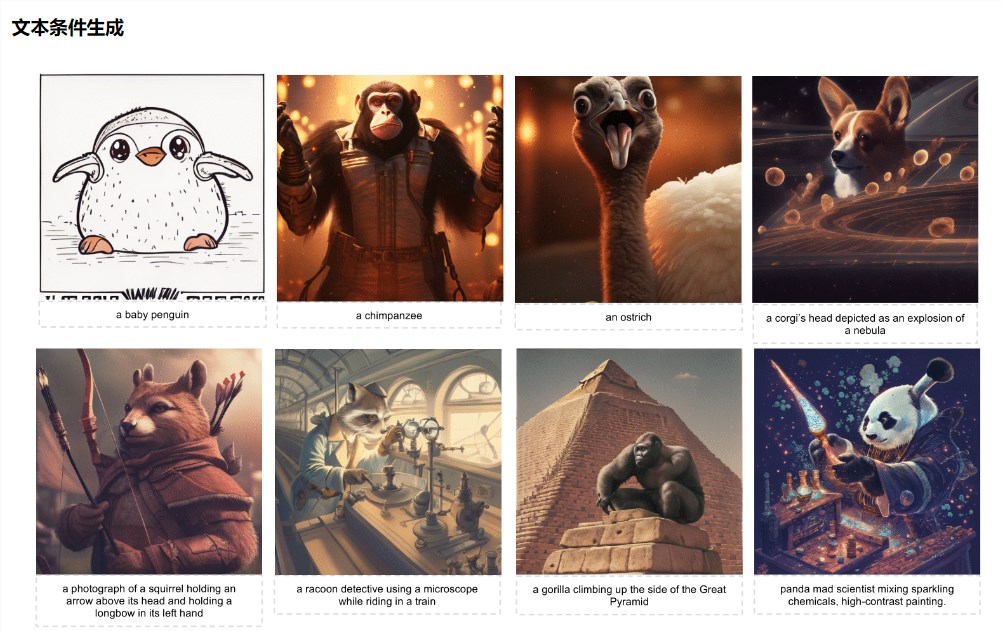

Textbedingtes Bildgenerierungsmodell: Ein textbedingtes Bildgenerierungsmodell mit 775 Millionen Parametern wurde eingeführt. Nach einem zweistufigen Training durch LAION-COCO kann es hochwertige ästhetische Bilder erzeugen und eine hervorragende visuelle Qualität und Textausrichtungsleistung zeigen.

Service-Framework vllm: Verifizierte die Wirksamkeit des LLM-Service-Frameworks bei der Optimierung der Inferenzgeschwindigkeit des Bildgenerierungsmodells und erreichte eine Beschleunigung von 326 % auf 414 %.

In diesem Projekt veröffentlichte das Forschungsteam zwei Bildsegmentierer, Modelle zur bedingten Generierung mit sieben Kategorien und zwei Modelle zur bedingten Textgenerierung und stellte gleichzeitig Online-Demonstrationen und ein Service-Framework mit hohem Durchsatz bereit. Die Veröffentlichung dieser Modelle und Tools stellt Entwicklern und Forschern eine Fülle von Ressourcen und Tools zur Verfügung, die es ihnen ermöglichen, die LlamaGen-Technologie besser zu verstehen und anzuwenden.

Das Aufkommen von LlamaGen fördert nicht nur die Weiterentwicklung der Bilderzeugungstechnologie, sondern bietet auch neue Richtungen und Ideen für die zukünftige Forschung auf dem Gebiet der künstlichen Intelligenz. Es lohnt sich, auf seine Anwendung und Entwicklung in weiteren Bereichen zu blicken.