香港大学とバイトダンスは、大規模言語モデルの予測パラダイムを画像生成の分野に適用する革新的な技術である LlamaGen を共同リリースし、目覚ましい成果を上げています。画像セグメンターを再設計し、モデルを大規模にトレーニングすることにより、LlamaGen は視覚信号誘導バイアスを必要とせずに優れた画像生成パフォーマンスを達成し、画像生成の分野に新たなブレークスルーをもたらします。このテクノロジーは、ImageNet ベンチマークで優れたパフォーマンスを発揮するだけでなく、画質とテキストの配置においても優れた機能を実証し、vllm サービス フレームワークを通じて大幅な高速化を実現します。提供されるさまざまなモデルとツールは、開発者や研究者に貴重なリソースを提供します。

製品入口:https://top.aibase.com/tool/llamagen

LlamaGen は、従来の画像生成モデルに対する破壊的なイノベーションであり、通常の自己回帰モデルが適切にスケーリングされている限り、視覚信号誘導バイアスがない場合でも優れた画像生成パフォーマンスを達成できることを示しています。 LlamaGen 自己回帰は、Transformer の出力であり、次のトークンを予測するための入力として使用されます。LLaMA アーキテクチャが使用され、拡散モデルは使用されません。この発見は、画像生成の分野に新たな可能性とインスピレーションをもたらし、将来の画像生成研究に新しいアイデアと方向性をもたらします。

LlamaGen の機能は次のとおりです。

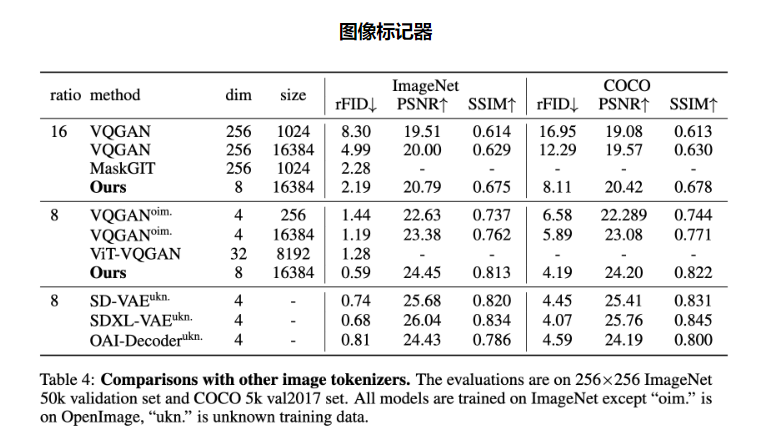

画像トークナイザー: 16 倍のダウンサンプリング比、0.94 の再構成品質、97% のコードブック使用率を備えた画像トークナイザーをリリースしました。これは、ImageNet ベンチマークで良好なパフォーマンスを発揮しました。

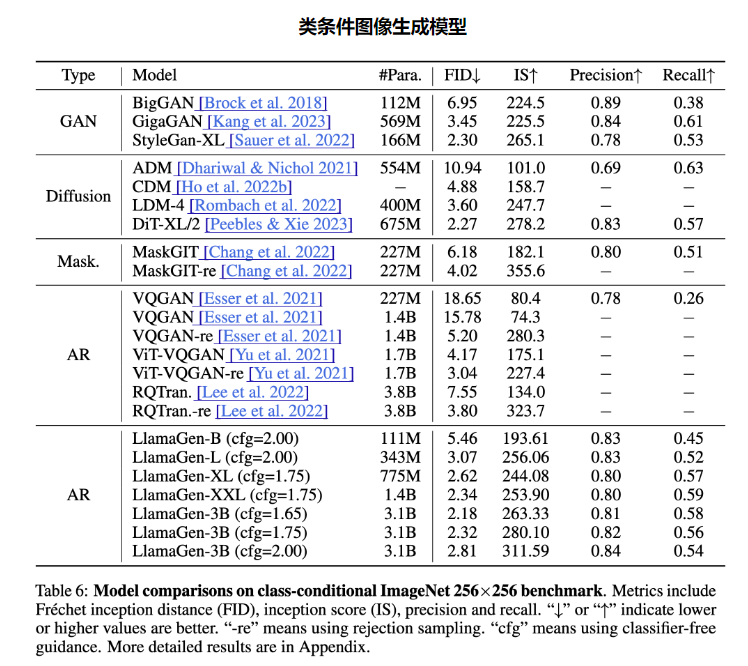

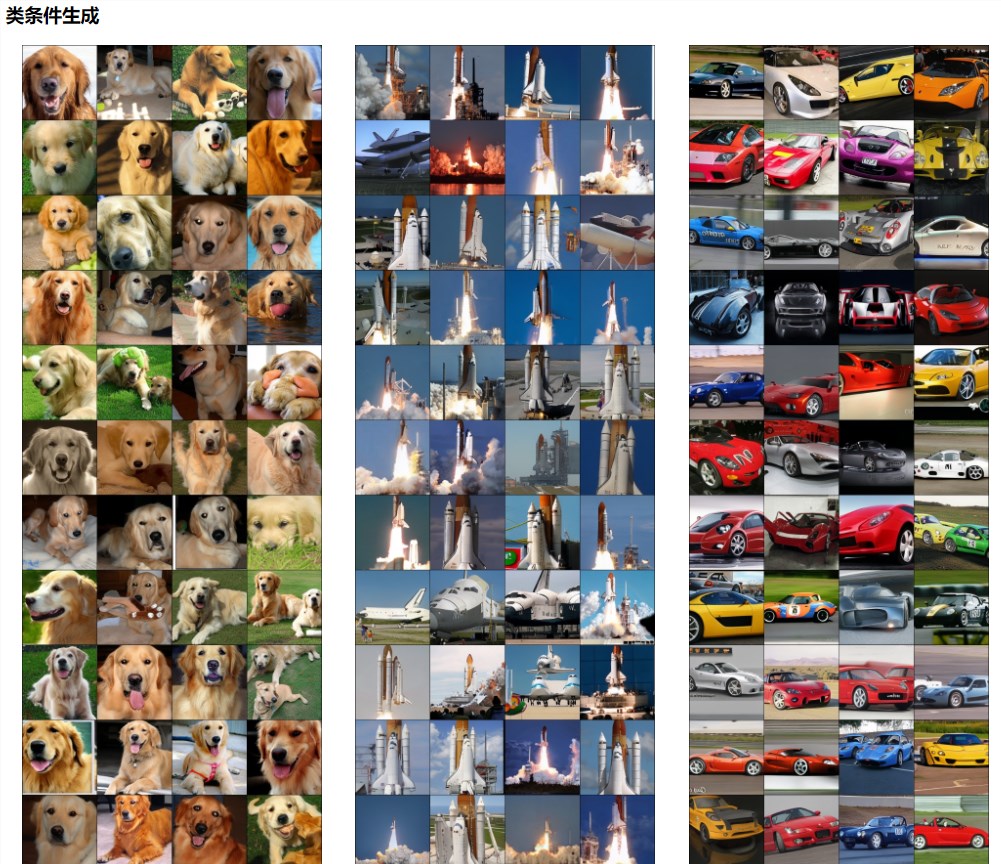

カテゴリ条件付き画像生成モデル: パラメータ範囲が 111M から 3.1B の一連のカテゴリ条件付き画像生成モデルが開始され、ImageNet256×256 ベンチマークで FID 2.18 を達成し、一般的な普及モデルを上回りました。

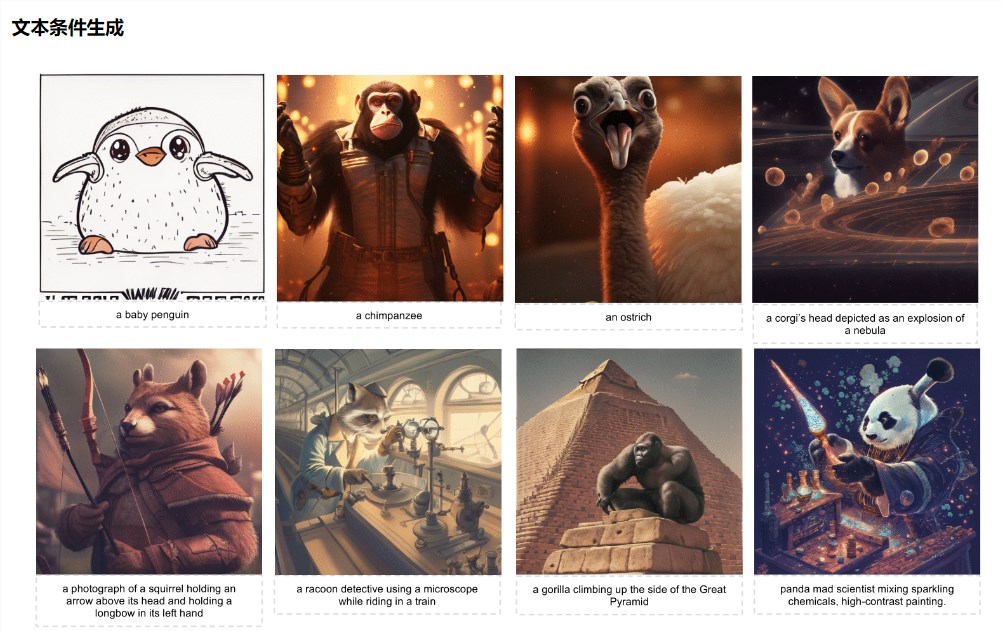

テキスト条件付き画像生成モデル: LAION-COCO による 2 段階のトレーニングを経て、7 億 7500 万個のパラメーターを備えたテキスト条件付き画像生成モデルが起動され、高品質の美しい画像を生成し、優れた視覚品質とテキスト配置パフォーマンスを実証できます。

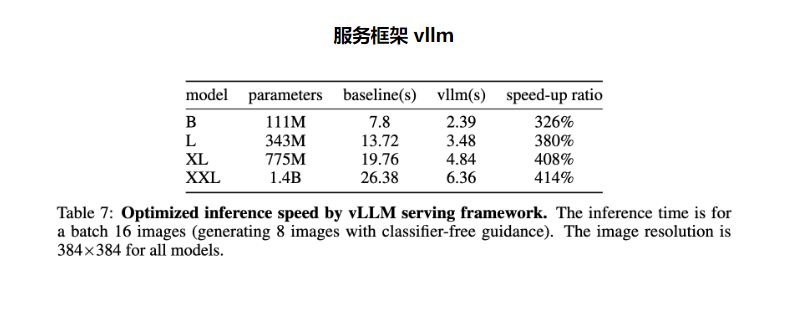

サービス フレームワーク vllm: 画像生成モデルの推論速度の最適化における LLM サービス フレームワークの有効性を検証し、326% から 414% の高速化を達成しました。

このプロジェクトでは、研究チームは 2 つの画像セグメンタ、7 カテゴリの条件付き生成モデル、および 2 つのテキスト条件付き生成モデルをリリースし、同時にオンライン デモと高スループットのサービス フレームワークを提供しました。これらのモデルとツールのリリースは、開発者と研究者に豊富なリソースとツールを提供し、LlamaGen テクノロジーをより深く理解し、適用できるようにします。

LlamaGen の出現は、画像生成技術の進歩を促進するだけでなく、人工知能分野における将来の研究に新たな方向性とアイデアを提供するものであり、より多くの分野での応用と発展を期待する価値があります。