️ AVISO : Infelizmente, Blindai não é mantido ativamente no momento. Assim, você não deve usar o Blindai para processar dados confidenciais . Se você tiver um caso de uso que envolva dados confidenciais e esteja interessado em usar o Blindai, entre em contato conosco para discutir potenciais suporte e colaboração.

A Blindai é uma solução de privacidade de IA , permitindo que os usuários consultem modelos populares de IA ou sirvam seus próprios modelos, garantindo que os dados dos usuários permaneçam privados a cada passo do caminho.

Explore os documentos »

Experimente a demonstração · Relatório Bug · Solicitar recurso

A Blindai é uma solução de código aberto para consultar e implantar modelos de IA, garantindo a privacidade dos dados . A consulta de modelos é feita através da nossa biblioteca Python fácil de usar .

Os dados enviados pelos usuários para o modelo de IA são mantidos em confidencialmente por todos os momentos por ambientes de execução confiáveis imorados com hardware. Explicamos como eles mantêm dados e modelos seguros em detalhes aqui.

Existem dois cenários principais para Blindai:

Você pode encontrar mais sobre a API Blindai e o núcleo Blindai aqui.

(de volta ao topo)

Recomendamos fortemente que você comece com o nosso rápido passeio para descobrir Blindai com o modelo de modelo aberto.

Mas aqui está um gostinho do que usar Blindai poderia ser?

transcript = blindai . api . Audio . transcribe (

file = "patient_104678.wav"

)

print ( transcript )

The patient is a 55 - year old male with known coronary artery disease .Uma empresa de IA de IA deseja fornecer seu modelo como um serviço fácil de usar. Eles o carregam para o servidor, que é atribuído a um ID do modelo.

response = client_1 . upload_model ( model = "./COVID-Net-CXR-2.onnx" )

MODEL_ID = response . model_id

print ( MODEL_ID )

8 afcdab8 - 209e-4 b93 - 9403 - f3ea2dc0c3aeAo colaborar com os clientes, a empresa de IA pode excluir seu modelo do servidor.

# AI company deletes model after use

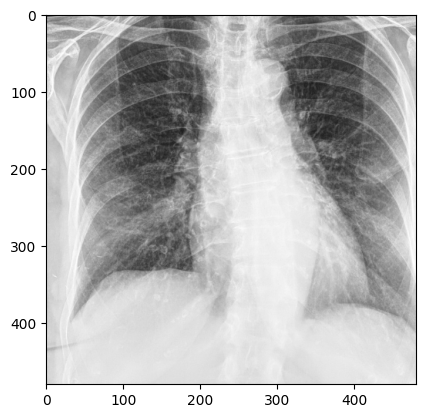

client_1 . delete_model ( MODEL_ID )O cliente deseja alimentar seus dados confidenciais ao modelo, protegendo-os do acesso de terceiros. Eles conectam e executam o modelo na seguinte imagem confidencial.

pos_ret = client_2 . run_model ( MODEL_ID , positive )

print ( "Probability of Covid for positive image is" , pos_ret . output [ 0 ]. as_flat ()[ 0 ][ 1 ])

Probability of Covid for positive image is 0.890598714351654Para mais exemplos, consulte a documentação

(de volta ao topo)

Distribuído sob a licença Apache, versão 2.0. Consulte LICENSE.md para obter mais informações.

Mithril Security - @MithrilSecurity - [email protected]

Link do projeto: https://github.com/mithril-security/blindai

(de volta ao topo)