️ ADVERTENCIA : Desafortunadamente, Kindai no se mantiene activamente en este momento. Por lo tanto, no debe usar Kindai para procesar datos confidenciales . Si tiene un caso de uso que implica datos confidenciales y está interesado en usar Winkai, contáctenos para discutir el soporte y la colaboración potencial.

Kindai es una solución de privacidad de IA , que permite a los usuarios consultar modelos de IA populares o servir a sus propios modelos al tiempo que garantiza que los datos de los usuarios sigan siendo privados en cada paso del camino.

Explore los documentos »

Pruebe la demostración · Informe de error · Función de solicitud

Kindai es una solución de código abierto para consultar e implementar modelos AI al tiempo que garantiza la privacidad de los datos . La consulta de modelos se realiza a través de nuestra biblioteca de Python fácil de usar .

Los datos enviados por los usuarios al modelo de IA se mantienen confidenciales en todo momento por entornos de ejecución confiables para hardware. Explicamos cómo mantienen los datos y los modelos seguros en detalle aquí.

Hay dos escenarios principales para Winkai:

Puede encontrar nuestro más sobre la API de Kindai y el núcleo de Kindai aquí.

(De vuelta a la cima)

Recomendamos encarecidamente que comience con nuestro rápido recorrido para descubrir Kindai con el modelo de código abierto Whisper.

¿Pero aquí hay una muestra de cómo podría ser el uso de winkai?

transcript = blindai . api . Audio . transcribe (

file = "patient_104678.wav"

)

print ( transcript )

The patient is a 55 - year old male with known coronary artery disease .Una compañía de IA Company AI quiere proporcionar su modelo como un servicio fácil de usar. Lo suben al servidor, al que se le asigna una ID de modelo.

response = client_1 . upload_model ( model = "./COVID-Net-CXR-2.onnx" )

MODEL_ID = response . model_id

print ( MODEL_ID )

8 afcdab8 - 209e-4 b93 - 9403 - f3ea2dc0c3aeCuando se realiza una colaboración con los clientes, la compañía AI puede eliminar su modelo del servidor.

# AI company deletes model after use

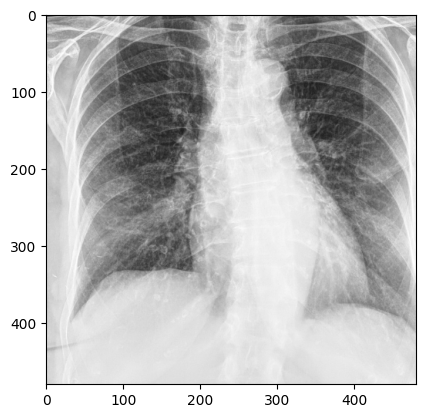

client_1 . delete_model ( MODEL_ID )El cliente quiere alimentar sus datos confidenciales al modelo mientras lo protege del acceso de terceros. Se conectan y ejecutan el modelo en la siguiente imagen confidencial.

pos_ret = client_2 . run_model ( MODEL_ID , positive )

print ( "Probability of Covid for positive image is" , pos_ret . output [ 0 ]. as_flat ()[ 0 ][ 1 ])

Probability of Covid for positive image is 0.890598714351654Para más ejemplos, consulte la documentación

(De vuelta a la cima)

Distribuido bajo la licencia Apache, versión 2.0. Vea LICENSE.md para obtener más información.

Mithril Security - @mithrilsecurity - [email protected]

Enlace del proyecto: https://github.com/mithril-security/blindai

(De vuelta a la cima)