️ AVERTISSEMENT : Malheureusement, Blindai n'est pas activement maintenu pour le moment. Ainsi, vous ne devez pas utiliser Blindai pour traiter les données sensibles . Si vous avez un cas d'utilisation qui implique des données confidentielles et que vous souhaitez utiliser Blindai, veuillez nous contacter pour discuter du soutien potentiel et de la collaboration.

Blindai est une solution de confidentialité de l'IA , permettant aux utilisateurs d'interroger les modèles d'IA populaires ou de servir leurs propres modèles tout en veillant à ce que les données des utilisateurs restent privées à chaque étape.

Explorez les documents »

Essayez la démo · Rapport Bogue · Demande de la demande

Blindai est une solution open source pour interroger et déployer des modèles d'IA tout en garantissant la confidentialité des données . La requête des modèles se fait via notre bibliothèque Python facile à utiliser .

Les données envoyées par les utilisateurs au modèle d'IA sont maintenues confidentielles à tout moment par des environnements d'exécution de confiance renforcés par le matériel. Nous expliquons comment ils gardent en détail les données et les modèles ici.

Il y a deux scénarios principaux pour Blindai:

Vous pouvez en trouver plus sur Blindai API et Blindai Core ici.

(retour en haut)

Nous vous recommandons fortement de commencer avec notre tournée rapide pour découvrir Blindai avec le modèle de modèle open source.

Mais voici un avant-goût de ce à quoi pourrait ressembler Blindai?

transcript = blindai . api . Audio . transcribe (

file = "patient_104678.wav"

)

print ( transcript )

The patient is a 55 - year old male with known coronary artery disease .Une entreprise d'IA d'entreprise AI souhaite fournir son modèle en tant que service facile à utiliser. Ils le téléchargent sur le serveur, qui se voit attribuer un ID de modèle.

response = client_1 . upload_model ( model = "./COVID-Net-CXR-2.onnx" )

MODEL_ID = response . model_id

print ( MODEL_ID )

8 afcdab8 - 209e-4 b93 - 9403 - f3ea2dc0c3aeLorsque la collaboration avec les clients est terminée, la société d'IA peut supprimer son modèle du serveur.

# AI company deletes model after use

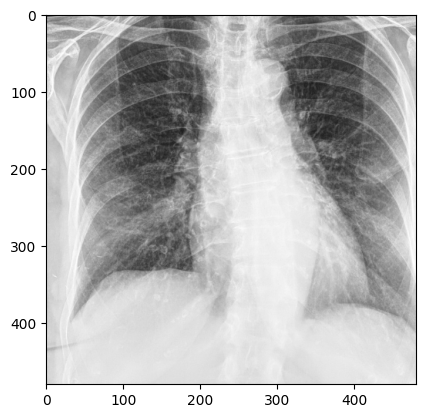

client_1 . delete_model ( MODEL_ID )Le client souhaite alimenter ses données confidentielles au modèle tout en les protégeant de l'accès tiers. Ils connectent et exécutent le modèle sur l'image confidentielle suivante.

pos_ret = client_2 . run_model ( MODEL_ID , positive )

print ( "Probability of Covid for positive image is" , pos_ret . output [ 0 ]. as_flat ()[ 0 ][ 1 ])

Probability of Covid for positive image is 0.890598714351654Pour plus d'exemples, veuillez vous référer à la documentation

(retour en haut)

Distribué sous la licence Apache, version 2.0. Voir LICENSE.md pour plus d'informations.

Mithril Security - @mithrilsecurity - [email protected]

Lien du projet: https://github.com/mithril-security/blindai

(retour en haut)