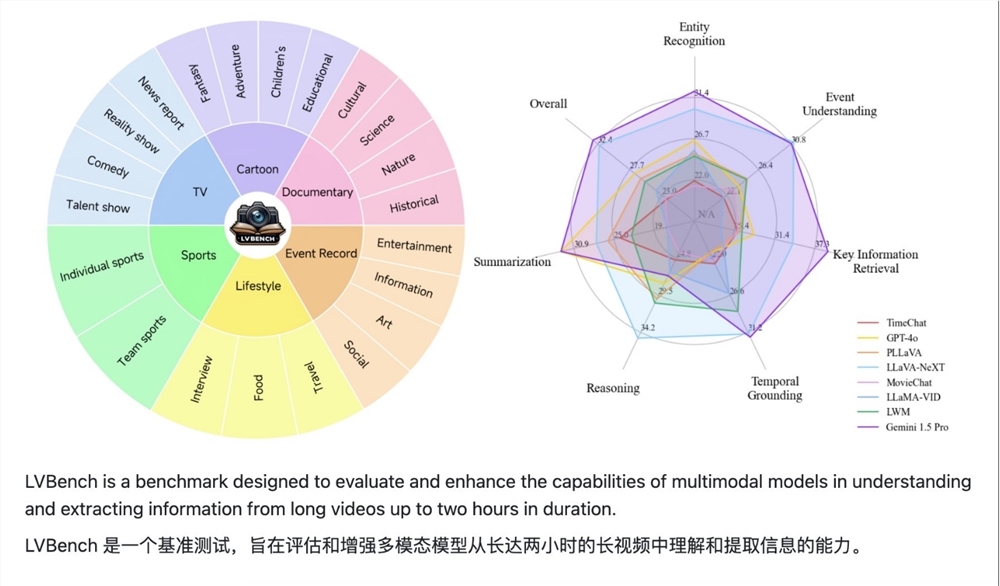

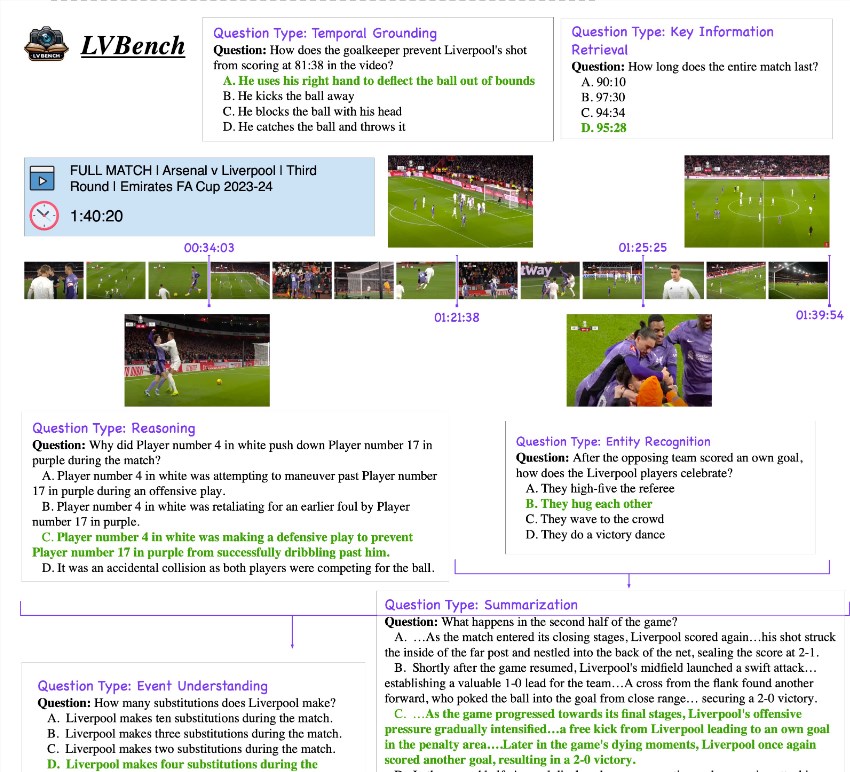

Zhipu, Tsinghua University 및 Peking University가 공동으로 시작한 긴 비디오 이해 벤치마크 프로젝트인 LVBench는 긴 비디오를 처리할 때 기존 다중 모드 대형 언어 모델이 직면한 문제를 해결하는 것을 목표로 합니다. 이 프로젝트는 TV 시리즈, 스포츠 방송, 감시 비디오 등 다양한 유형의 비디오 콘텐츠를 포괄하는 몇 시간의 QA 데이터를 제공하며, 6개의 주요 카테고리와 21개의 하위 카테고리가 포함되어 있습니다. 데이터에는 고품질 주석이 추가되고 LLM을 사용하여 필터링합니다. 비디오 요약, 이벤트 감지, 문자 인식, 장면 이해 등 다양한 작업을 다루는 도전적인 문제입니다. LVBench의 출시는 장기 비디오 이해 기술의 돌파구와 혁신을 촉진하여 구체화된 지능형 의사 결정, 심층적인 영화 및 TV 리뷰, 전문 스포츠 해설과 같은 애플리케이션에 대한 강력한 지원을 제공할 것입니다.

이 프로젝트에는 TV 시리즈, 스포츠 방송, 공개 소스의 일일 감시 영상 등 다양한 유형의 비디오 콘텐츠를 다루는 6개 주요 카테고리와 21개 하위 카테고리의 몇 시간 분량의 QA 데이터가 포함되어 있습니다. 데이터에는 모두 고품질의 주석이 달려 있으며 LLM은 까다로운 문제를 필터링하는 데 사용됩니다. LVBench 데이터 세트는 비디오 요약, 이벤트 감지, 문자 인식, 장면 이해 등 다양한 작업을 다루는 것으로 보고되었습니다.

LVBench 벤치마크 출시는 긴 비디오 시나리오에서 모델의 추론 및 운영 기능을 테스트하는 것을 목표로 할 뿐만 아니라 구현된 지능형 의사 결정, 심층적인 영화 및 TV 리뷰, 프로 스포츠를 달성하기 위해 관련 기술의 혁신과 혁신을 촉진합니다. 장편 영상 분야의 해설은 새로운 자극을 줄 필요가 있습니다.

많은 연구 기관이 LVBench 데이터 세트 작업을 시작했으며, 긴 비디오 작업을 위한 대규모 모델을 구축하여 장기적인 정보 흐름을 이해하는 데 있어 인공 지능의 경계를 점차 확장하고, 비디오 이해, 다중 모드에 대한 지속적인 탐색에 새로운 아이디어를 주입했습니다. 학습 및 기타 활력 분야.

깃허브:https://github.com/THUDM/LVBench

프로젝트: https://lvbench.github.io

논문: https://arxiv.org/abs/2406.08035

LVBench 프로젝트의 출시는 긴 비디오 이해 기술 개발의 새로운 단계를 의미하며, LVBench가 제공하는 풍부한 데이터 세트와 도전적인 작업은 더 많은 연구자의 참여를 유도하고 긴 비디오 이해 분야에서 인공 지능의 발전을 가속화할 것입니다. 미래의 애플리케이션에 더 많은 가능성을 제공합니다. 앞으로도 LVBench를 기반으로 한 더 많은 연구 결과가 기대됩니다.