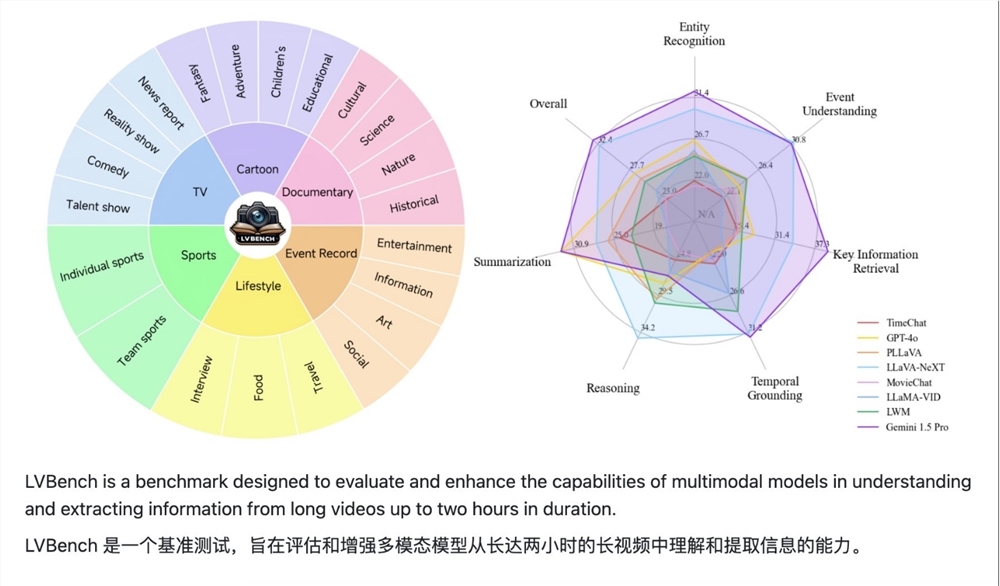

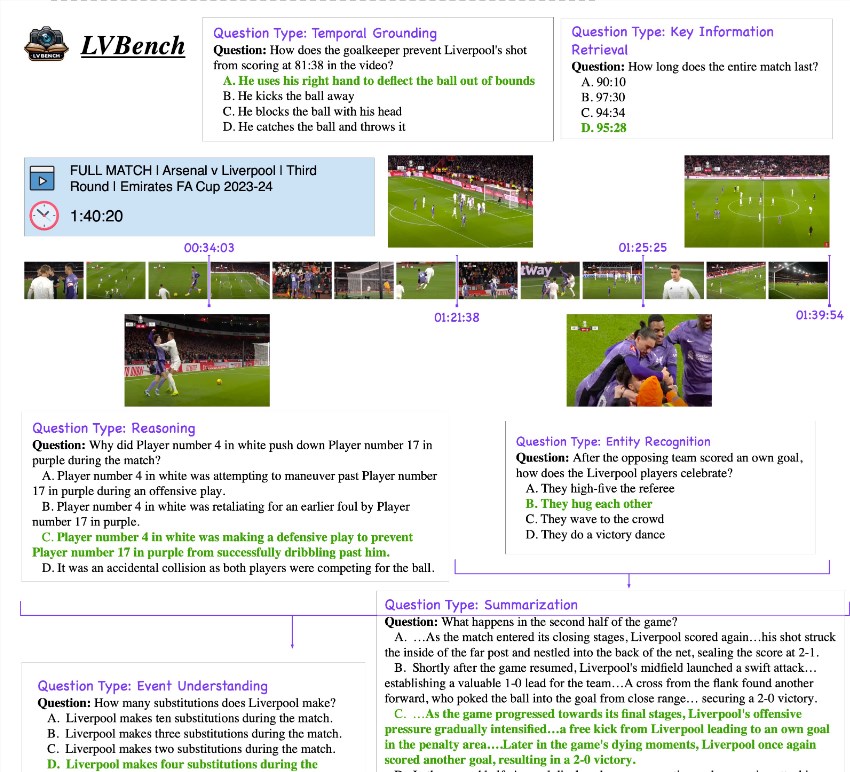

LVBench は、Zhipu、清華大学、北京大学が共同で立ち上げた長時間ビデオ理解ベンチマーク プロジェクトで、長時間ビデオを処理する際に既存のマルチモーダル大規模言語モデルが直面する課題を解決することを目的としています。このプロジェクトは、テレビ シリーズ、スポーツ放送、監視ビデオなどのさまざまな種類のビデオ コンテンツをカバーする数時間の QA データを提供し、6 つのメイン カテゴリと 21 のサブカテゴリが含まれています。データには高品質の注釈が付けられ、LLM を使用してフィルタリングされます。ビデオの要約、イベント検出、文字認識、シーンの理解など、さまざまなタスクをカバーする難しい問題。 LVBench の発売は、長時間ビデオ理解テクノロジーの画期的な進歩と革新を促進し、具体化されたインテリジェントな意思決定、詳細な映画やテレビのレビュー、プロスポーツの解説などのアプリケーションに強力なサポートを提供します。

このプロジェクトには、6 つのメイン カテゴリと 21 のサブカテゴリに数時間の QA データが含まれており、テレビ シリーズ、スポーツ放送、公共情報源からの毎日の監視映像など、さまざまな種類のビデオ コンテンツをカバーしています。データはすべて高品質の注釈が付けられており、LLM を使用して困難な問題を除外します。 LVBench データセットは、ビデオの要約、イベント検出、文字認識、シーン理解などのさまざまなタスクをカバーしていると報告されています。

LVBench ベンチマークの開始は、長いビデオ シナリオでモデルの推論と操作能力をテストすることを目的としているだけでなく、具体化されたインテリジェントな意思決定、映画やテレビの詳細なレビュー、プロ スポーツを実現する関連テクノロジーの画期的な進歩と革新も促進します。長いビデオの分野での解説には、新たな刺激が必要です。

多くの研究機関が LVBench データセットに取り組み始めており、長時間のビデオタスク用の大規模なモデルを構築し、マルチモーダルなビデオ理解の継続的な探求に新しいアイデアを注入することで、長期的な情報フローの理解における人工知能の限界を徐々に拡大しています。学習やその他の活力の分野。

github:https://github.com/THUDM/LVBench

プロジェクト: https://lvbench.github.io

論文: https://arxiv.org/abs/2406.08035

LVBench プロジェクトの開始は、長時間ビデオ理解技術の開発における新たな段階を示し、それが提供する豊富なデータセットとやりがいのあるタスクにより、より多くの研究者が参加し、長時間ビデオ理解の分野における人工知能の進歩が加速します。将来のアプリケーションにさらなる可能性をもたらします。 今後、LVBenchをベースにしたさらなる研究結果が期待されます。