Detext 는 NLP 관련 순위, 분류 및 언어 생성 작업을위한 De EP 텍스트 이해 프레임 워크입니다. 깊은 신경망을 사용하여 의미 론적 매칭을 활용하여 검색 및 추천 시스템의 회원 의도를 이해합니다.

일반적인 NLP 프레임 워크로서 DeText는 검색 및 권장 순위, 멀티 클래스 분류 및 쿼리 이해 작업을 포함한 많은 작업에 적용될 수 있습니다.

자세한 내용은 LinkedIn 엔지니어링 블로그 게시물에서 찾을 수 있습니다.

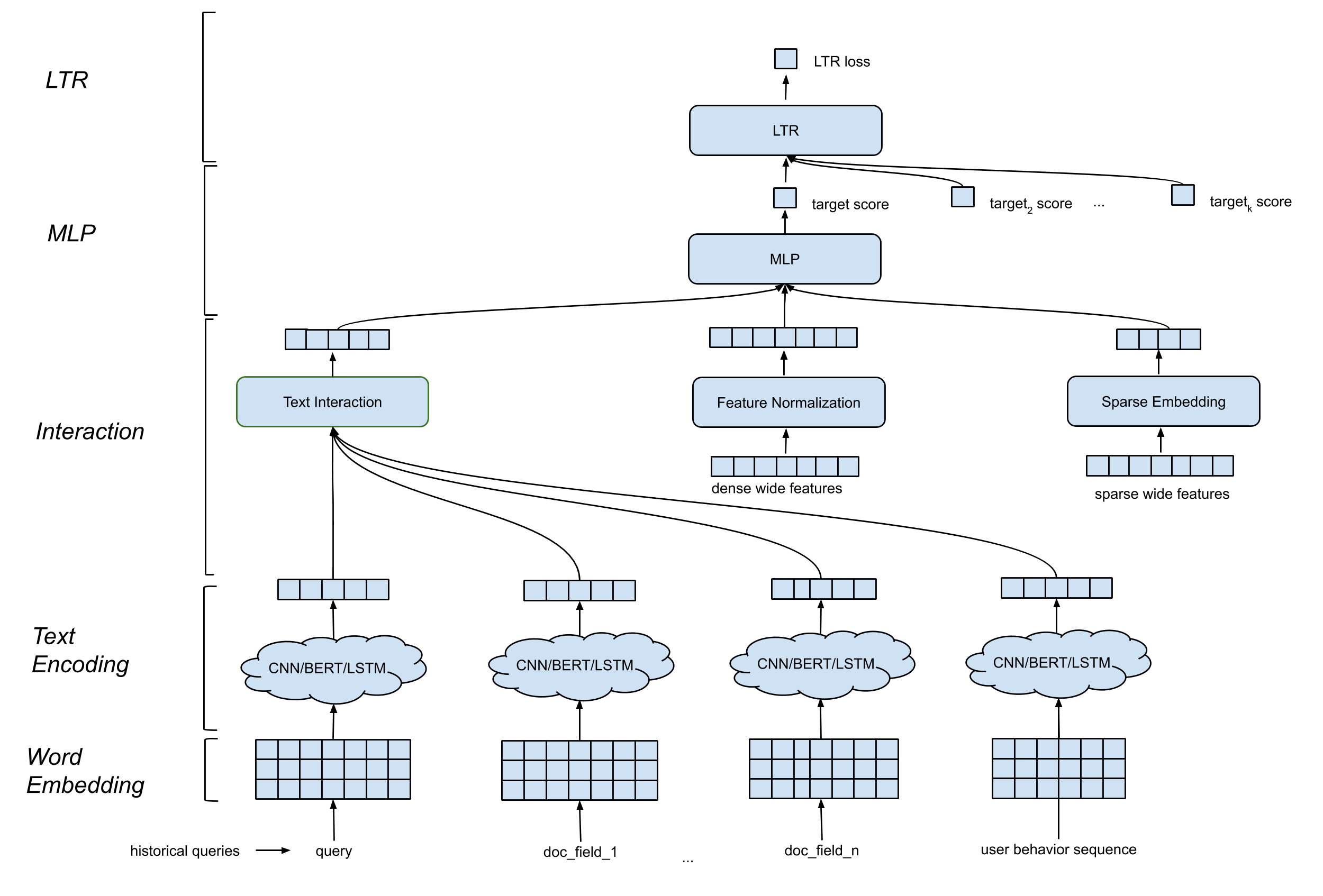

Detext는 다음 구성 요소를 포함하는 일반적인 모델 아키텍처를 지원합니다.

단어 임베딩 레이어 . N 행렬에 의해 단어 시퀀스를 AD로 변환합니다.

텍스트 인코딩 레이어에 대한 CNN/BERT/LSTM . 입력으로 매트릭스를 포함시키고 텍스트 데이터를 고정 길이 임베딩으로 맵핑합니다.

상호 작용 계층 . 텍스트 임베딩을 기반으로 깊은 기능을 생성합니다. 옵션에는 연결, 코사인 유사성 등이 포함됩니다.

넓고 깊은 기능 처리 . 우리는 전통적인 기능과 상호 작용 기능 (깊은 기능)을 넓고 깊은 방식으로 결합합니다.

MLP 층 . MLP 층은 넓은 기능과 깊은 기능을 결합하는 것입니다.

교육 목표를 최적화하기 위해 모든 매개 변수가 공동 업데이트됩니다.

DeText는 고객이 자신의 사용 사례에 맞는 맞춤형 네트워크를 구축 할 수있는 유연성을 제공합니다.

LTR/분류 계층 : 사내 LTR 손실 구현 또는 TF-Ranking LTR 손실, 멀티 클래스 분류 지원.

MLP 레이어 : 사용자 정의 가능한 레이어 수 및 치수 수.

상호 작용 계층 : 코사인 유사성, 하다마르 제품 및 연결을 지원합니다.

텍스트 임베딩 레이어 : 필터, 레이어, 치수 등에 맞춤형 매개 변수가 포함 된 CNN, Bert, LSTM을 지원합니다.

연속 기능 정규화 : 요소 별 재조정, 가치 정규화.

범주 형 기능 처리 : 엔티티 임베딩으로 모델링됩니다.

이 모든 것은 detext 템플릿의 하이퍼 파라미터를 통해 사용자 정의 할 수 있습니다. TF-Ranking은 Detext 프레임 워크에서 지원됩니다. 즉, 사용자는 Detext에 정의 된 LTR 손실 및 메트릭을 선택할 수 있습니다.

VENV_DIR = < your venv dir >

python3 -m venv $VENV_DIR # Make sure your python version >= 3.7

source $VENV_DIR /bin/activate # Enter the virtual environmentpip3 install -U pip

pip3 install -U setuptoolspip install . -epytest 도서관에서 간단한 시도를 원한다면 튜토리얼의 다음 노트북을 참조하십시오.

text_classification_demo.ipynb

이 노트북은 Detext를 사용하여 공개 쿼리 의도 분류 데이터 세트에서 멀티 클래스 텍스트 분류 모델을 훈련시키는 방법을 보여줍니다. 데이터 준비, 모델 교육, 모델 추론에 대한 자세한 지침이 포함되어 있습니다.

autocompletion.ipynb

이 노트북은 Detext를 사용하여 공개 쿼리 자동 완료 데이터 세트에서 텍스트 순위 모델을 훈련시키는 방법을 보여줍니다. 데이터 준비, 모델 교육, 모델 추론 예제에 대한 자세한 단계가 포함되어 있습니다.

연구에 도움이된다면 간행물에서 Detext를 인용하십시오.

@manual{guo-liu20,

author = {Weiwei Guo and

Xiaowei Liu and

Sida Wang and

Huiji Gao and

Bo Long},

title = {DeText: A Deep NLP Framework for Intelligent Text Understanding},

url = {https://engineering.linkedin.com/blog/2020/open-sourcing-detext},

year = {2020}

}

@inproceedings{guo-gao19,

author = {Weiwei Guo and

Huiji Gao and

Jun Shi and

Bo Long},

title = {Deep Natural Language Processing for Search Systems},

booktitle = {ACM SIGIR 2019},

year = {2019}

}

@inproceedings{guo-gao19,

author = {Weiwei Guo and

Huiji Gao and

Jun Shi and

Bo Long and

Liang Zhang and

Bee-Chung Chen and

Deepak Agarwal},

title = {Deep Natural Language Processing for Search and Recommender Systems},

booktitle = {ACM SIGKDD 2019},

year = {2019}

}

@inproceedings{guo-liu20,

author = {Weiwei Guo and

Xiaowei Liu and

Sida Wang and

Huiji Gao and

Ananth Sankar and

Zimeng Yang and

Qi Guo and

Liang Zhang and

Bo Long and

Bee-Chung Chen and

Deepak Agarwal},

title = {DeText: A Deep Text Ranking Framework with BERT},

booktitle = {ACM CIKM 2020},

year = {2020}

}

@inproceedings{jia-long20,

author = {Jun Jia and

Bo Long and

Huiji Gao and

Weiwei Guo and

Jun Shi and

Xiaowei Liu and

Mingzhou Zhou and

Zhoutong Fu and

Sida Wang and

Sandeep Kumar Jha},

title = {Deep Learning for Search and Recommender Systems in Practice},

booktitle = {ACM SIGKDD 2020},

year = {2020}

}

@inproceedings{wang-guo20,

author = {Sida Wang and

Weiwei Guo and

Huiji Gao and

Bo Long},

title = {Efficient Neural Query Auto Completion},

booktitle = {ACM CIKM 2020},

year = {2020}

}

@inproceedings{liu-guo20,

author = {Xiaowei Liu and

Weiwei Guo and

Huiji Gao and

Bo Long},

title = {Deep Search Query Intent Understanding},

booktitle = {arXiv:2008.06759},

year = {2020}

}