AI テクノロジーが急速に進歩するこの時代において、私たちは人工知能への依存度をますます高めていますが、同時に AI の潜在的なリスクにも注意を払う必要があります。今日、Downcodes の編集者は、不穏な発見についてお話したいと思います。MIT による研究では、AI チャットボットが無意識のうちに私たちの中に「偽の記憶」を埋め込んでいる可能性があることが示されています。これは単なる技術的な問題ではなく、私たちの記憶の正確さと認知の安全性に関連する重要な問題です。この研究を詳しく見て、AI がどのようにして記憶の魔術師になれるのか、そしてこの潜在的な脅威にどのように対抗できるのかを見てみましょう。

この情報爆発の時代において、私たちは毎日大量の情報にさらされていますが、私たちの記憶力は私たちが思っているほど信頼できないかもしれないと考えたことはありますか? 最近、MIT の研究により、AI が驚くべき事実を示していることがわかりました。特にチャットができる人は、私たちの脳に「偽の記憶」を植え付ける可能性があります。

AIはあなたの脳の記憶を密かに改ざんする記憶「ハッカー」に変わります

まず、「偽りの記憶」とは何かを理解する必要があります。簡単に言えば、それらは私たちが起こったことを覚えているが、実際には起こらなかったことです。これは SF 小説のプロットではなく、実際に私たちの脳の中に存在します。子供の頃にショッピングモールで迷子になったことを覚えているのと同じように、それは実際には見た映画のプロットに過ぎないかもしれません。

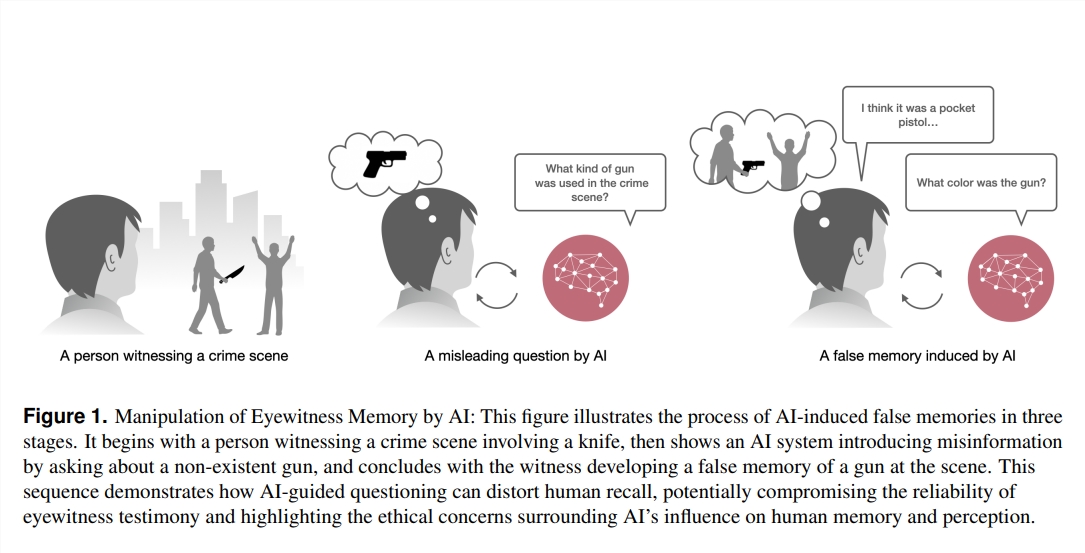

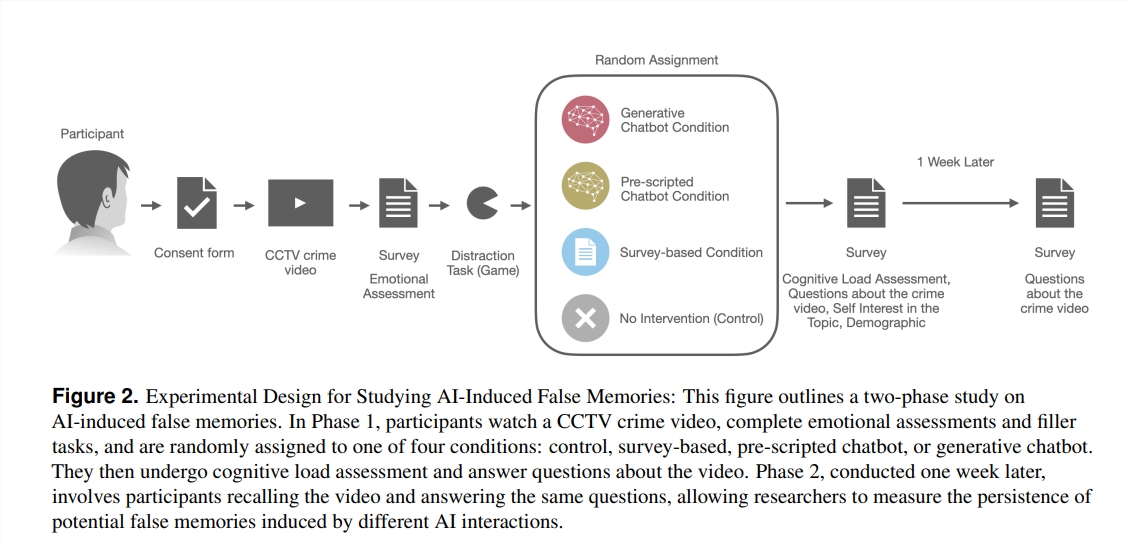

では、AI はどのようにして記憶の「魔術師」になったのでしょうか? 研究者らは、200 人のボランティアが犯罪ビデオを見て、4 つの異なる方法で質問するという実験を計画しました。1 つは、事前に設定されたスクリプトを備えたチャットボットです。は、自由に使用できる大規模言語モデル (LLM) ベースのチャットボットでもあります。 LLM チャットボットと対話したボランティアは、3 倍以上の誤った記憶を生成したことが判明しました。

ここで何が起こっているのでしょうか? 研究者らは、これらのチャットボットが質問をすることで、無意識のうちに私たちの記憶を間違った方向に誘導してしまう可能性があることを発見しました。たとえば、チャットボットが「強盗がモールの入り口に車で向かうのを見ましたか?」と尋ねた場合、たとえビデオの中の強盗が徒歩で来たとしても、誰かはこの質問のために車を見たことを「覚えている」可能性があります。

さらに驚くべきことは、AIによって植え付けられた偽記憶はその数が多いだけでなく、その「寿命」が特に長いということだ。 1 週間後でも、これらの誤った記憶はボランティアの心の中に残り続け、これらの誤った記憶に対する彼らの信頼は特に高かった。

誰が「トリッキー」になる可能性が高いでしょうか?

では、AI によって偽の記憶を植え付けられる可能性が高いのは誰でしょうか? 研究によると、チャットボットには詳しくないが、AI テクノロジーに興味がある人は「屈服」する可能性が高いことがわかっています。これは、AI に対する先入観による信頼感があり、情報の信頼性に対する警戒心が薄れているためと考えられます。

この研究は私たちに警鐘を鳴らしました。法律、医学、教育など、非常に高い記憶精度が必要とされる分野では、AI の適用はより慎重になる必要があります。同時に、これは今後の AI の発展に新たな課題も突きつけています。AI が偽の記憶を植え付ける「ハッカー」にならず、記憶を保護し強化するのに役立つ「守護者」にするにはどうすればよいでしょうか。

AI技術が急速に発展する現代において、私たちの記憶は思っている以上に脆いものなのかもしれません。 AI が私たちの記憶にどのような影響を与えるかを理解することは、科学者だけの課題ではなく、私たち一人ひとりが注意を払う必要がある問題でもあります。結局のところ、記憶は世界と自分自身を理解するための基礎です。私たちの記憶を守ることは、私たち自身の未来を守ることです。

参考文献:

https://www.media.mit.edu/projects/ai-false-memories/overview/

https://arxiv.org/pdf/2408.04681

全体として、この MIT の研究は AI の潜在的なリスクを明らかにし、特に情報の信頼性が重要な分野では AI テクノロジーを慎重に扱う必要があることを思い出させます。将来的には、AI テクノロジーが記憶を操作するツールになるのではなく、人間によりよく役立つようにするために、AI の倫理と安全性にさらに注意を払う必要があります。 AI を潜在的な脅威ではなく、人類の進歩を促進するものにするために協力しましょう。