في هذا العصر الذي يتسم بالتقدم السريع في تكنولوجيا الذكاء الاصطناعي، أصبحنا نعتمد بشكل متزايد على الذكاء الاصطناعي. وفي الوقت نفسه، نحتاج أيضًا إلى الانتباه إلى المخاطر المحتملة للذكاء الاصطناعي. يود محرر Downcodes مناقشة اكتشاف مثير للقلق معك اليوم: أظهرت دراسة أجراها معهد ماساتشوستس للتكنولوجيا أن روبوتات الدردشة التي تعمل بالذكاء الاصطناعي قد تزرع "ذكريات مزيفة" فينا دون قصد. وهذه ليست مجرد مسألة تقنية، بل مسألة مهمة تتعلق بدقة ذاكرتنا والسلامة المعرفية. دعونا نتعمق في هذا البحث لنرى كيف يمكن للذكاء الاصطناعي أن يصبح ساحرًا للذاكرة، وكيف يمكننا مكافحة هذا التهديد المحتمل.

في عصر الانفجار المعلوماتي هذا، نتعرض لكميات هائلة من المعلومات كل يوم، لكن هل فكرت يومًا أن ذاكرتنا قد لا تكون موثوقة كما نعتقد؟ مؤخرًا، أخبرتنا دراسة من معهد ماساتشوستس للتكنولوجيا توضح حقيقة مذهلة: الذكاء الاصطناعي، خاصة أولئك الذين يمكنهم الدردشة، قد يزرعون "ذكريات مزيفة" في أدمغتنا.

يتحول الذكاء الاصطناعي إلى "هاكر" للذاكرة للتلاعب سرًا بذاكرة دماغك

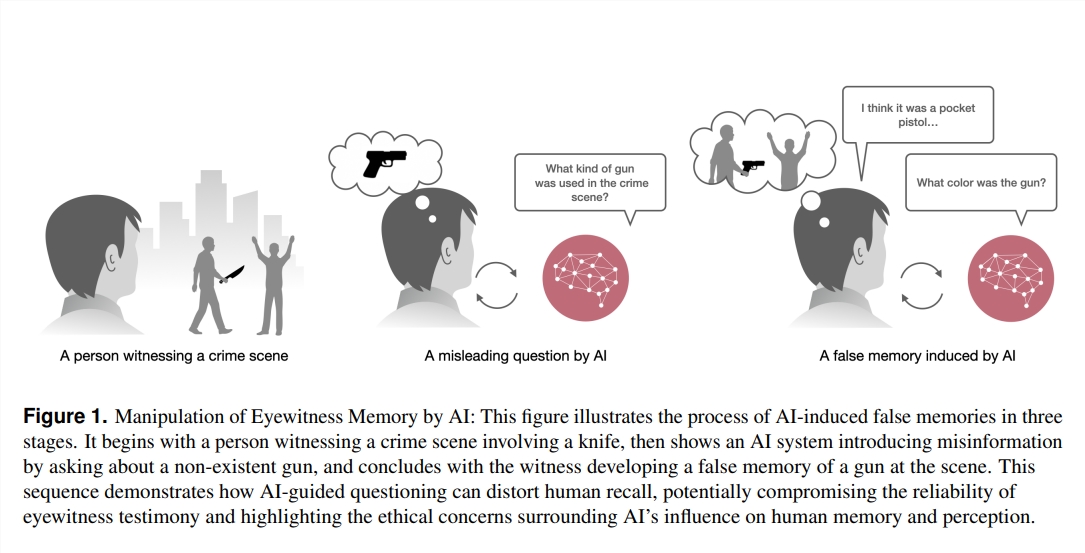

أولاً، علينا أن نفهم ما هي "الذاكرة الزائفة". ببساطة، إنها أشياء نتذكر أنها حدثت، ولكنها لم تحدث بالفعل. هذه ليست حبكة في روايات الخيال العلمي، لكنها موجودة بالفعل في أدمغتنا. مثلما تتذكر عندما كنت طفلاً تائهًا في مركز تجاري، لكن قد يكون ذلك في الواقع مجرد حبكة فيلم شاهدته.

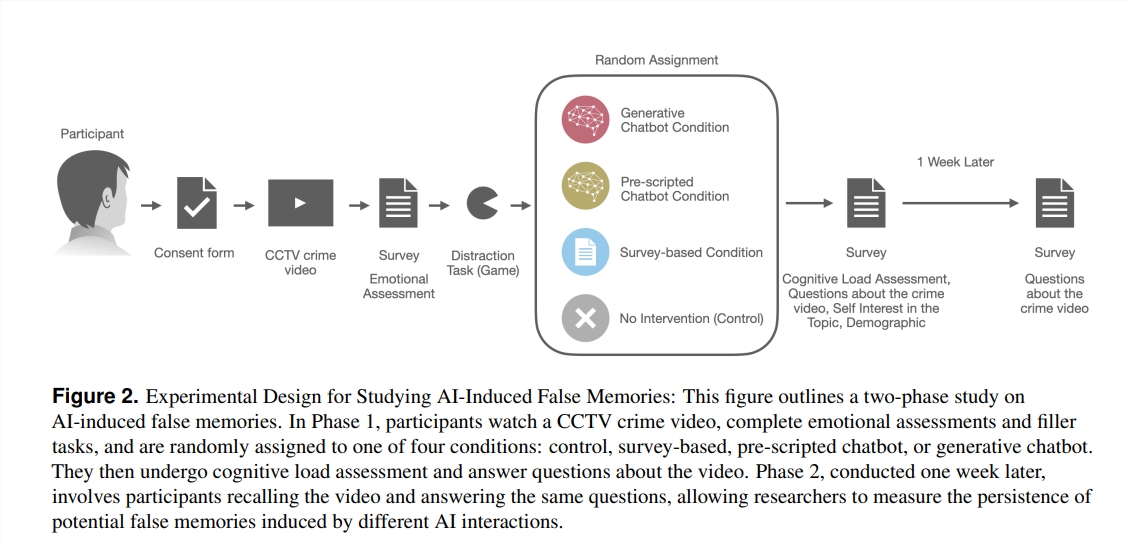

إذن، كيف أصبح الذكاء الاصطناعي "ساحر" الذاكرة؟ صمم الباحثون تجربة شاهد فيها 200 متطوع مقطع فيديو عن جريمة ثم طرحوا الأسئلة بأربع طرق مختلفة: أحدهما كان عبارة عن استبيان تقليدي، وهناك روبوتات محادثة بنصوص محددة مسبقًا، وهناك هو أيضًا برنامج chatbot يعتمد على نموذج لغة كبير (LLM) ويمكن استخدامه بحرية. لقد وجد أن المتطوعين الذين تفاعلوا مع برنامج الدردشة الآلي LLM أنتجوا أكثر من ثلاثة أضعاف الذكريات الكاذبة!

ما الذي يحدث هنا؟ لقد وجد الباحثون أن روبوتات الدردشة هذه يمكنها توجيه ذكرياتنا في الاتجاه الخاطئ دون قصد عن طريق طرح الأسئلة. على سبيل المثال، إذا سأل برنامج الدردشة الآلية: "هل رأيت السارق يقود سيارته إلى مدخل المركز التجاري؟" حتى لو جاء السارق في الفيديو سيرًا على الأقدام، فقد "يتذكر" شخص ما رؤية السيارة بسبب هذا السؤال.

والأمر الأكثر إثارة للدهشة هو أن هذه الذكريات الكاذبة المزروعة بواسطة الذكاء الاصطناعي ليست كثيرة العدد فحسب، بل لها أيضًا "مدى حياة" طويل بشكل خاص. وحتى بعد مرور أسبوع، استمرت هذه الذكريات الكاذبة في أذهان المتطوعين، وكانت ثقتهم في هذه الذكريات الكاذبة عالية بشكل خاص.

من هو الأكثر احتمالا أن يكون "متقطرا"؟

إذًا، من هم الأكثر عرضة لزرع ذكريات زائفة بواسطة الذكاء الاصطناعي؟ وجدت الأبحاث أن أولئك الذين ليسوا على دراية ببرامج الدردشة ولكنهم أكثر اهتمامًا بتكنولوجيا الذكاء الاصطناعي هم أكثر عرضة "للاستسلام". وقد يكون هذا بسبب أن لديهم شعور مسبق بالثقة في الذكاء الاصطناعي، مما يقلل من يقظتهم بشأن صحة المعلومات.

لقد دقت هذه الدراسة ناقوس الخطر بالنسبة لنا: في مجالات مثل القانون والطب والتعليم التي تتطلب دقة ذاكرة عالية للغاية، يجب أن يكون تطبيق الذكاء الاصطناعي أكثر حذرًا. وفي الوقت نفسه، يفرض هذا أيضًا تحديات جديدة أمام التطور المستقبلي للذكاء الاصطناعي: كيف نضمن أن الذكاء الاصطناعي لا يصبح "هاكرًا" يزرع ذكريات كاذبة، بل يصبح "حارسًا" يساعدنا على حماية الذكريات وتعزيزها؟

في عصر التطور السريع لتكنولوجيا الذكاء الاصطناعي، قد تكون ذاكرتنا أكثر هشاشة مما نعتقد. إن فهم كيفية تأثير الذكاء الاصطناعي على ذاكرتنا ليس مهمة العلماء فحسب، بل هو أيضًا أمر يحتاج كل واحد منا إلى الاهتمام به. ففي نهاية المطاف، الذاكرة هي حجر الزاوية في فهمنا للعالم ولأنفسنا. إن حماية ذاكرتنا يعني حماية مستقبلنا.

مراجع:

https://www.media.mit.edu/projects/ai-false-memories/overview/

https://arxiv.org/pdf/2408.04681

بشكل عام، تكشف دراسة معهد ماساتشوستس للتكنولوجيا عن المخاطر المحتملة للذكاء الاصطناعي وتذكرنا بأننا بحاجة إلى التعامل مع تكنولوجيا الذكاء الاصطناعي بحذر، خاصة في المجالات التي تكون فيها صحة المعلومات أمرًا بالغ الأهمية. في المستقبل، نحتاج إلى إيلاء المزيد من الاهتمام لأخلاقيات الذكاء الاصطناعي وسلامته للتأكد من أن تكنولوجيا الذكاء الاصطناعي يمكن أن تخدم البشر بشكل أفضل بدلاً من أن تصبح أداة للتلاعب بالذاكرة. دعونا نعمل معًا لجعل الذكاء الاصطناعي بمثابة دفعة للتقدم البشري وليس تهديدًا محتملاً.