LLM security and privacy

1.0.0

セキュリティとプライバシーの観点から、LLMの脅威と脆弱性をカバーする論文とツールのキュレーションリスト。概要、主要なポイント、および各ペーパーの追加の詳細は、紙こみフォルダーにあります。

Main.BIBファイルには、ここにリストされている論文の最新の引用が含まれています。

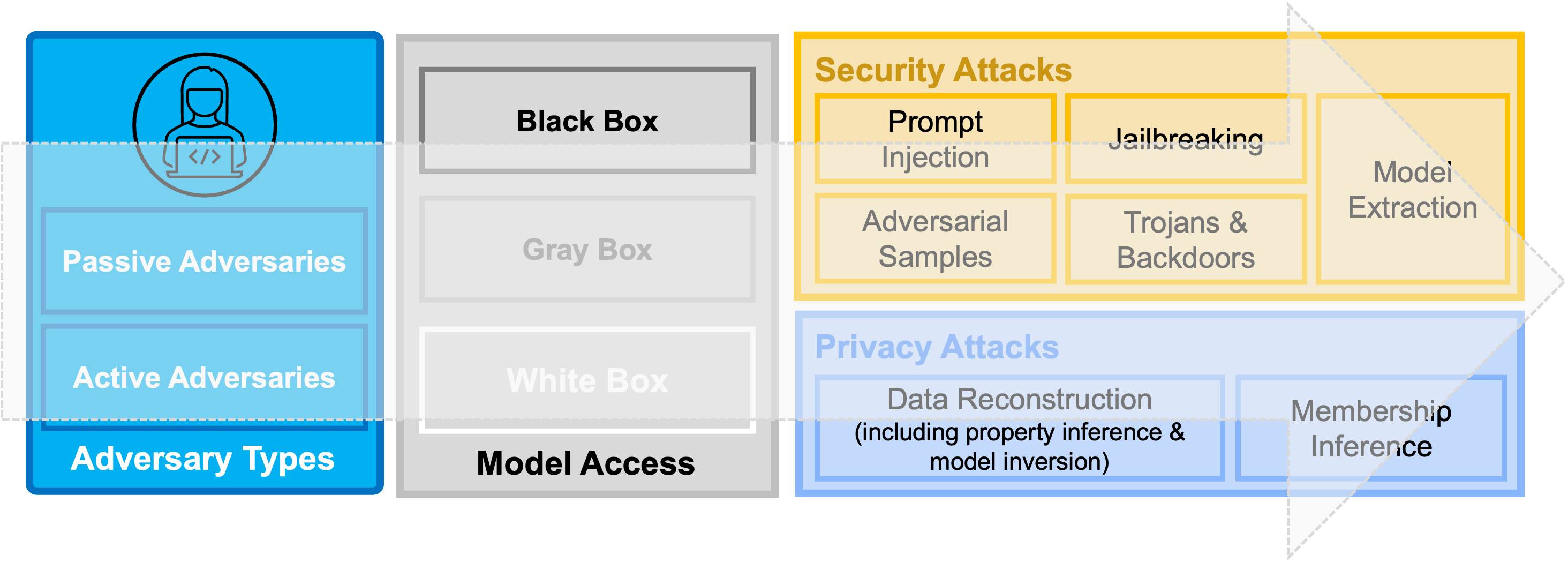

概要図:深い学習モデルと連続的に大規模な言語モデル(LLM)に対する現在のセキュリティおよびプライバシーの脅威の分類法。

概要図:深い学習モデルと連続的に大規模な言語モデル(LLM)に対する現在のセキュリティおよびプライバシーの脅威の分類法。

| いいえ。 | ペーパータイトル | 会場 | 年 | カテゴリ | コード | まとめ |

|---|---|---|---|---|---|---|

| 1。 | 注射器:ツール統合された大手言語モデルエージェントの間接的な迅速な注入ベンチマーク | プリプリント | 2024 | 迅速な噴射 | n/a | TBD |

| 2。 | LLMエージェントは、Webサイトを自律的にハッキングできます | プリプリント | 2024 | アプリケーション | n/a | TBD |

| 3。 | 壊滅的なAIのリスクの概要 | プリプリント | 2023 | 一般的な | n/a | TBD |

| 4。 | 違法な目的でのLLMSの使用:脅威、予防措置、および脆弱性 | プリプリント | 2023 | 一般的な | n/a | TBD |

| 5。 | LLM検閲:機械学習の課題またはコンピューターセキュリティの問題? | プリプリント | 2023 | 一般的な | n/a | TBD |

| 6。 | セーフガードを超えて:ChatGptのセキュリティリスクの調査 | プリプリント | 2023 | 一般的な | n/a | TBD |

| 7。 | LLM統合アプリケーションに対する迅速な注入攻撃 | プリプリント | 2023 | 迅速な噴射 | n/a | TBD |

| 8。 | 生成AIのセキュリティリスクを特定して緩和します | プリプリント | 2023 | 一般的な | n/a | TBD |

| 9。 | PASSGPT:パスワードモデリングと(ガイド付き)大規模な言語モデルを使用した生成 | エソリック | 2023 | アプリケーション | TBD | |

| 10。 | サイバーセキュリティGRCポリシーの生成のためのGPT-4の活用:ランサムウェア攻撃緩和への焦点 | コンピューターとセキュリティ | 2023 | アプリケーション | n/a | TBD |

| 11。 | あなたがサインアップしたものではありません:間接的な迅速な注入で現実世界のLLM統合アプリケーションの妥協 | プリプリント | 2023 | 迅速な噴射 | TBD | |

| 12。 | 大規模な言語モデルでゼロショットの脆弱性修復を調べます | IEEE S&P | 2023 | アプリケーション | n/a | TBD |

| 13。 | LLMプラットフォームセキュリティ:OpenAIのChatGPTプラグインに体系的な評価フレームワークを適用する | プリプリント | 2023 | 一般的な | n/a | TBD |

| 14。 | チェーンのverificationは、大規模な言語モデルの幻覚を減らします | プリプリント | 2023 | 幻覚 | n/a | TBD |

| 15。 | ポップクイズ!大規模な言語モデルはリバースエンジニアリングに役立ちますか? | プリプリント | 2022 | アプリケーション | n/a | TBD |

| 16。 | 大規模な言語モデルからトレーニングデータを抽出します | Usenixセキュリティ | 2021 | データ抽出 | TBD | |

| 17。 | AIワームが登場します:genaiを搭載したアプリケーションをターゲットにするゼロクリックワームを解き放つ | プリプリント | 2024 | プロンプトインジェクション | TBD | |

| 18。 | 崖:抽象的な要約における忠実さと事実を改善するための対照的な学習 | emnlp | 2021 | 幻覚 | TBD |

このリポジトリに貢献することに興味がある場合は、ガイドラインの詳細については、Convinting.MDを参照してください。

現在の貢献者のリストはここにあります。

このリポジトリおよび/または可能性(研究)のコラボレーションに関する質問については、Briland Hitajに連絡してください。