中文版

AI.Labs est un projet open source qui vise à intégrer les technologies d'intelligence artificielle les plus avancées pour fournir une puissante plate-forme d'IA. Le cœur de ce projet réside dans l'intégration de divers services d'IA, y compris les modèles de langues importants, la reconnaissance de la parole et la synthèse de la parole, pour soutenir les fonctionnalités telles que le dialogue, l'interaction vocale et la transcription de la réunion.

Groupe QQ: 306499618

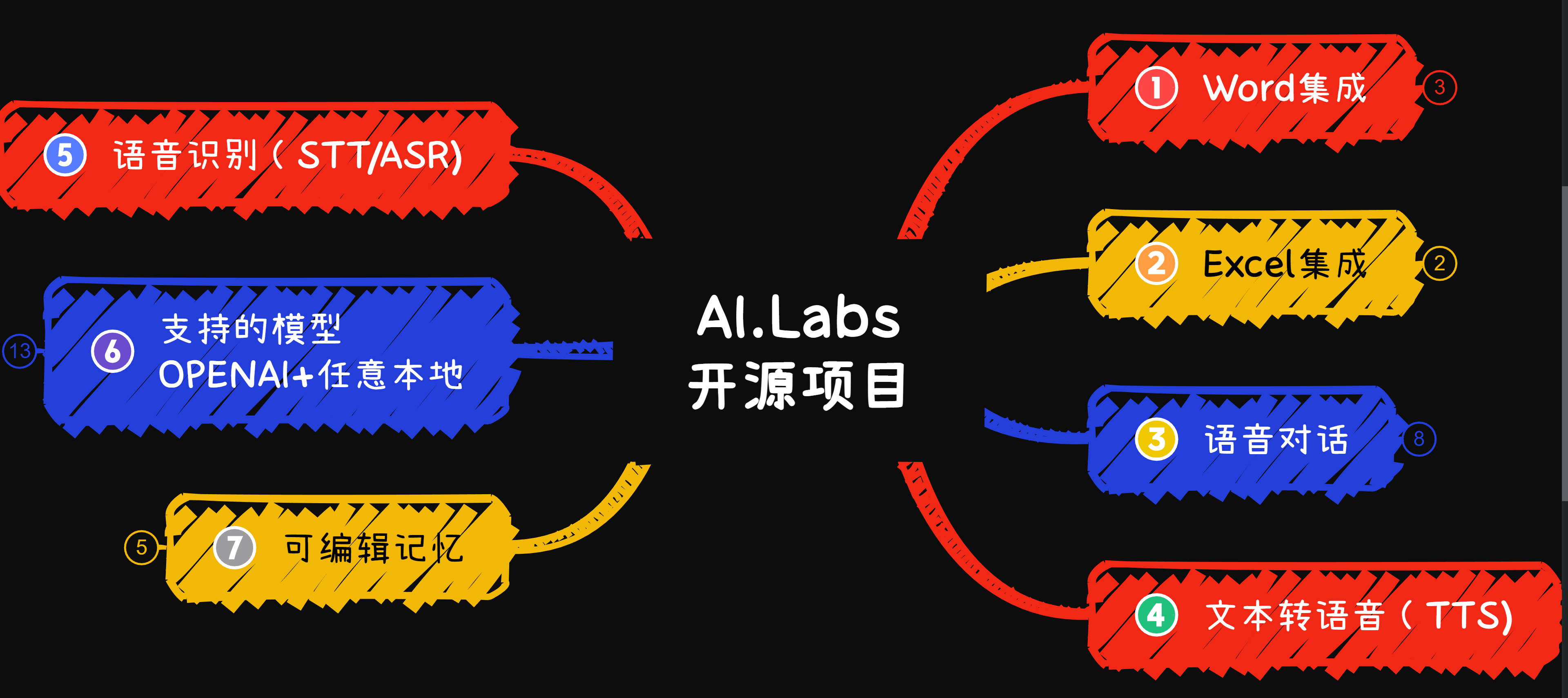

Ce projet comprend les fonctionnalités suivantes:

Vidéo de démonstration de fonction Bilibili 1 Cliquez sur le triple lien vous procurera le package d'installation + modèle

Bilibili Chat Video Démonstration 2

Comment exécuter la documentation

Référentiel de projet:

Caractéristiques principales

Le projet intègre la prise en charge du GPT-3.5 et du GPT-4 d'OpenAI, permettant un dialogue intelligent en temps réel via l'API OpenAI. Utilise le projet suivant: https://github.com/betalgo/openai

Déployer des modèles de grande langue (LLM) localement à l'aide de LMStudio ou ChatGLM3-6B, en interagissant avec une API similaire à OpenAI, assurant la confidentialité des données tout en améliorant la vitesse de réponse. Remarque: les services de modèle et de modèle ne sont pas limités; Tout avec le support API de style OpenAI peut être utilisé.

Télécharger l'adresse: https://lmstudio.ai/

Téléchargement du modèle: https://huggingface.co/thebloke (VPN requis)

Téléchargement du modèle: https://hf-mirror.com/thebloke (VPN non requis)

Téléchargement du modèle: https://wisemodel.cn/models (VPN non requis)

Téléchargement du modèle: https://gpt4all.io/ (vpn non requis)

Implémentez la reconnaissance de la parole locale, réduisant la dépendance à l'égard des services externes et améliorant la vitesse de réponse.

Fournit également l'intégration du service de reconnaissance vocale d'Azure pour tirer parti de sa technologie avancée de reconnaissance vocale basée sur le cloud.

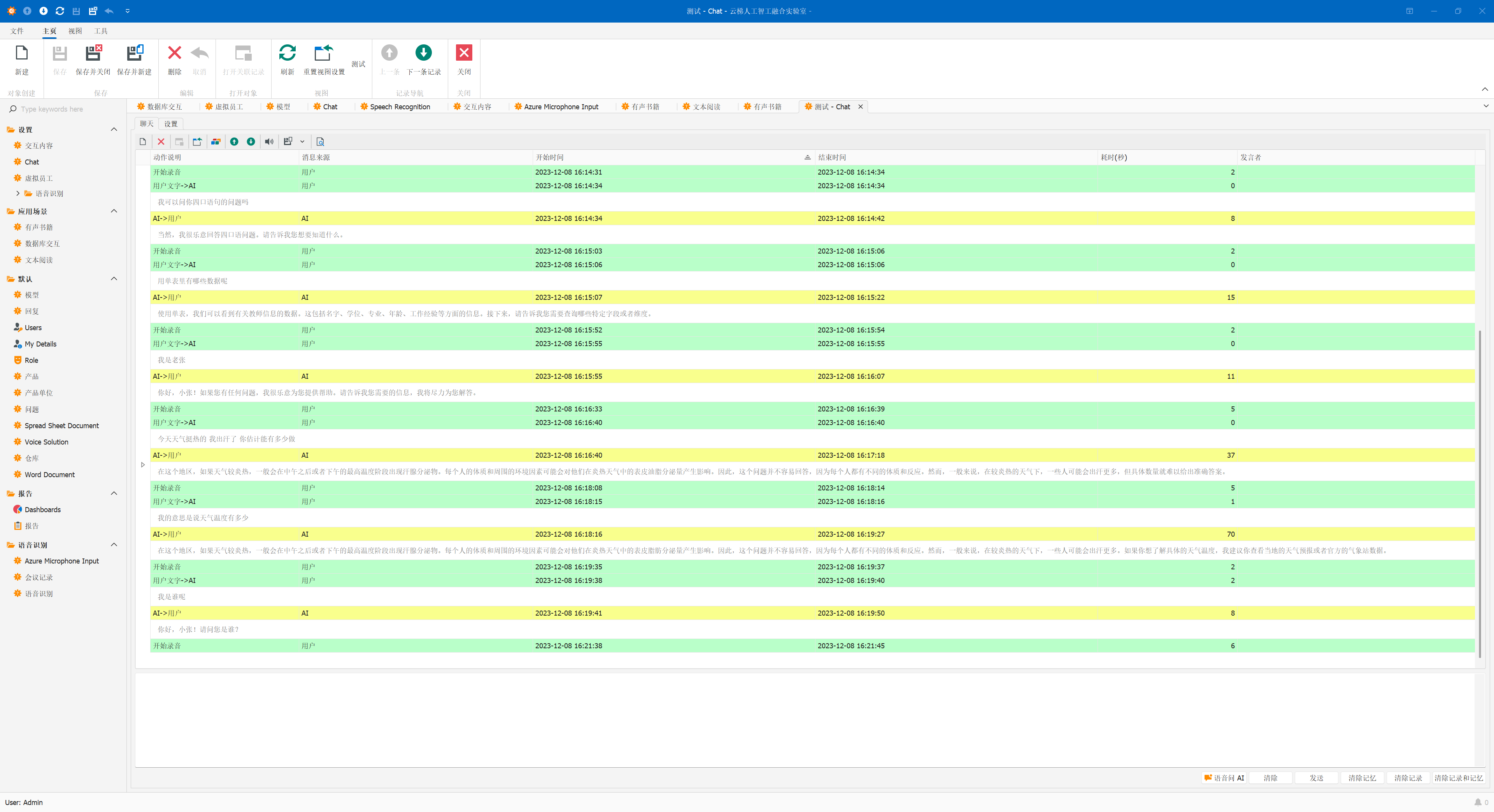

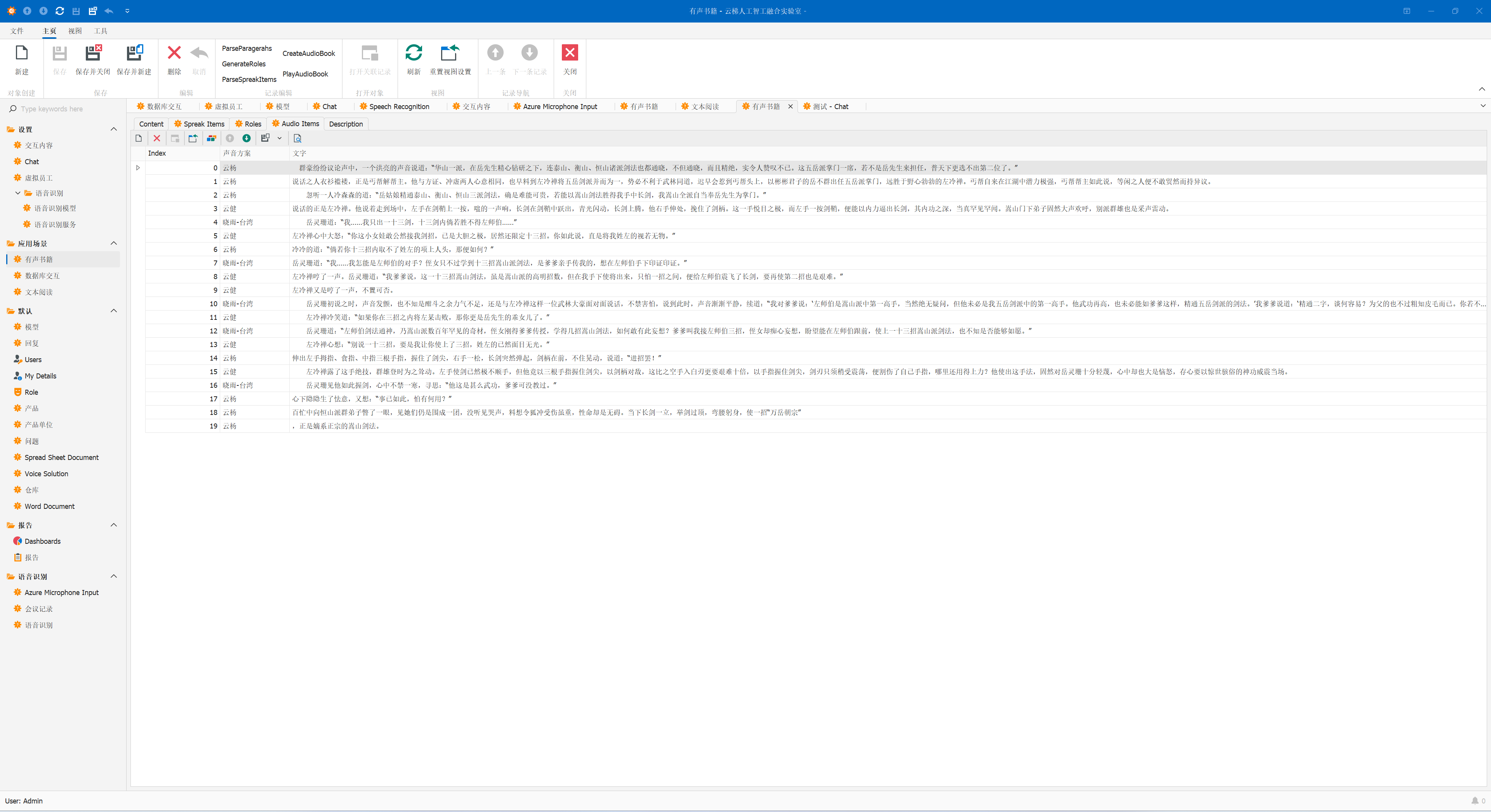

En utilisant les capacités de reconnaissance de la parole du projet, AI.Labs peut effectuer un enregistrement en temps réel du contenu de la réunion, rendant l'archivage des informations et la récupération plus efficace. Technology Stack Le projet utilise le framework d'application Devexpress, garantissant la modernisation et la personnalisation élevée de l'interface utilisateur.

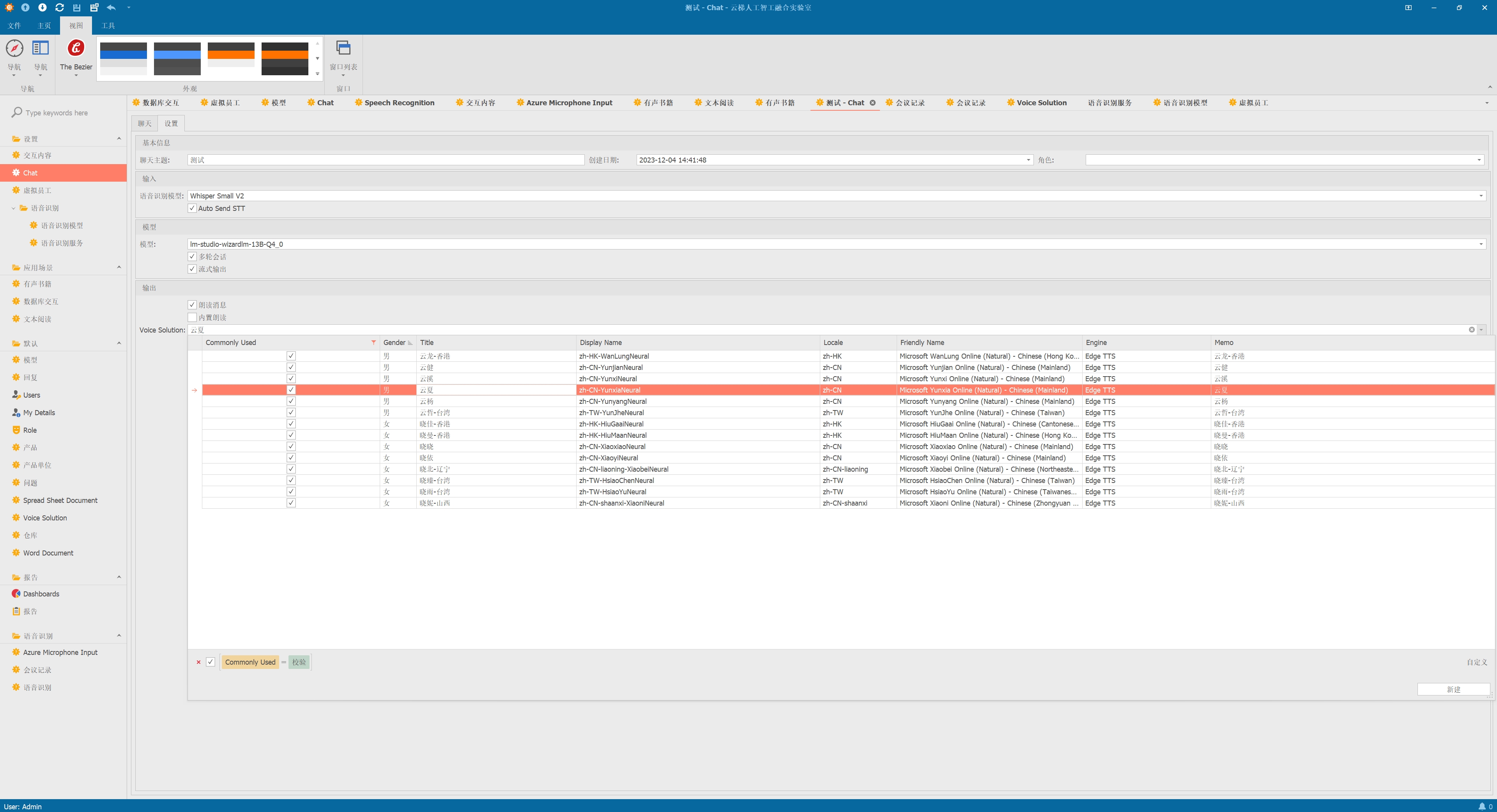

Utilise gratuitement Edgetts pour la sortie vocale locale. Utilise le projet Python Edge-TTS. Nécessite une installation locale de ce programme Python. Guide d'installation: https://github.com/rany2/edge-tts

Les utilisateurs peuvent enregistrer leurs propres comptes, avec 5 heures par mois gratuitement ou 5 millions de caractères. Prend en charge le service Azure TTS, permettant aux utilisateurs d'opter pour le service de synthèse vocale basé sur le cloud. Adresse d'inscription: https://portal.azure.com/

Le projet utilise XAF, site Web: http://www.devexpress.com Veuillez acheter la version légitime de Devexpress pour une utilisation dans des environnements réels. À des fins de test, une version d'essai d'un mois peut être téléchargée.

AI.Labs est basé sur une combinaison de technologies comprenant C # (.NET 6.0 +) / SQLite Database + XAF + OpenAI API + TTS + STT et plus. La dépendance à Python est minimisée autant que possible. Cependant, par exemple, Edge-TTS doit encore être appelé.

Ii Questions et doutes

Confidentialité et sécurité des données: comment la confidentialité et la sécurité des données des utilisateurs sont-elles assurées? Si vous faites attention à cette option, vous pouvez utiliser LMStudio pour construire un modèle privé localement (ou dans un LAN). Prend en charge la plupart des modèles au format GGUF ou des modèles de LLAMA2.cpp. Ce processus est introduit dans la vidéo Bilibili. Remarque: la vidéo est en chinois. https://www.bilibili.com/video/bv1fc411d7ek/

Support multilingue: le projet prend-il en charge plusieurs langues et comment les traductions entre différentes langues sont-elles gérées? XAF facilite l'expansion pratique pour plusieurs langues. Diverses versions seront déployées progressivement.