El equipo de DeepMind de Google lanzó recientemente el conjunto de datos WEBLI-100B, que contiene 100 mil millones de pares de texto de imagen, marcando un gran avance en el campo de los modelos de lenguaje visual de inteligencia artificial. El objetivo central de este conjunto de datos es mejorar significativamente el rendimiento de los modelos de IA en el tratamiento de diferentes tareas culturales y multilingües a través de recursos de datos ricos, promoviendo así la inclusión y la diversidad de las tecnologías de inteligencia artificial.

Los modelos de lenguaje visual (VLMS) son puentes que conectan imágenes y textos, y se usan ampliamente en tareas como la generación de subtítulos de imágenes, preguntas visuales y respuestas. El rendimiento de estos modelos depende en gran medida de la calidad y cantidad de datos de capacitación. En el pasado, los investigadores se han basado principalmente en grandes conjuntos de datos, como subtítulos conceptuales y Laion. demanda.

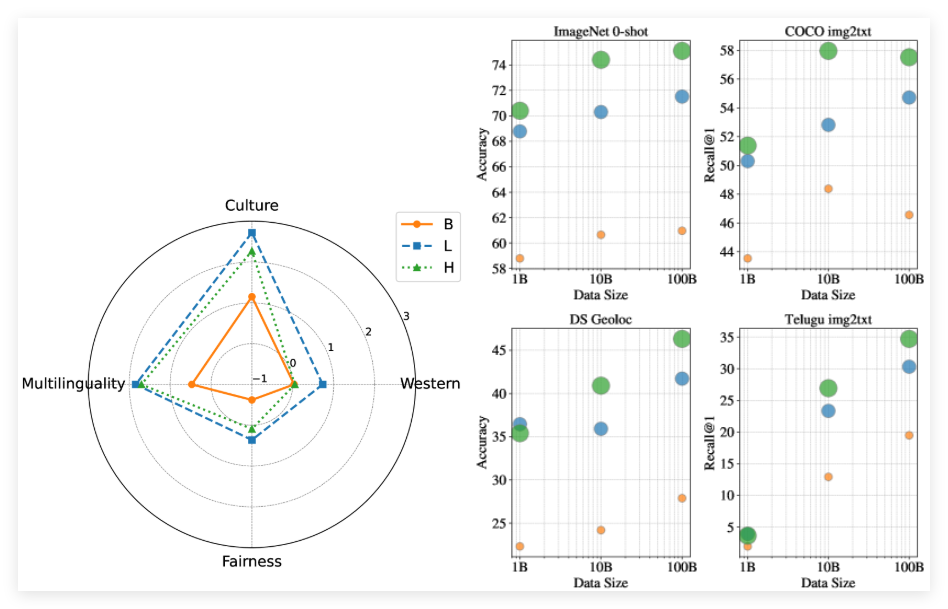

El lanzamiento del conjunto de datos WEBLI-100B es precisamente para resolver este problema de cuello de botella. A diferencia de los conjuntos de datos anteriores, WEBLI-100B ya no adopta un mecanismo de filtrado estricto, que a menudo elimina los detalles culturales importantes. En cambio, se centra más en expandir la cobertura de los datos, especialmente en áreas como el lenguaje de baja recursos y diversas expresiones culturales. El equipo de investigación realizó el modelo previo en diferentes subconjuntos de WEBLI-100B para analizar profundamente el impacto de la escala de datos en el rendimiento del modelo.

Los resultados experimentales muestran que los modelos entrenados con el conjunto de datos WEBLI-100B completo tuvieron un rendimiento significativamente mejor en las tareas culturales y multilingües que las capacitadas en conjuntos de datos más pequeños, incluso con los mismos recursos informáticos. Además, el estudio encontró que expandir el conjunto de datos de 10B a 100B tuvo menos impacto en los puntos de referencia centrados en el oeste, pero trajo mejoras significativas en las tareas de diversidad cultural y la recuperación del lenguaje de baja recursos.

Documento: https://arxiv.org/abs/2502.07617

Puntos clave:

** Nuevo conjunto de datos **: WEBLI-100B es un gran conjunto de datos que contiene 100 mil millones de pares de texto de imagen, diseñados para mejorar la diversidad cultural y la multilingüidad de los modelos AI.

** Mejora del rendimiento del modelo **: Modelos capacitados con un conjunto de datos WEBLI-100B funcionan mejor que los conjuntos de datos anteriores en tareas multiculturales y multilingües.

** Reducir el sesgo **: el conjunto de datos de WEBLI-100B evita el filtrado estricto, conserva más detalles culturales y mejora la inclusión y la precisión del modelo.