Ejemplos de traducción al inglés y chino de los gráficos de conocimiento de sentido común del evento japonés de la Universidad de Waseda

En Inglés

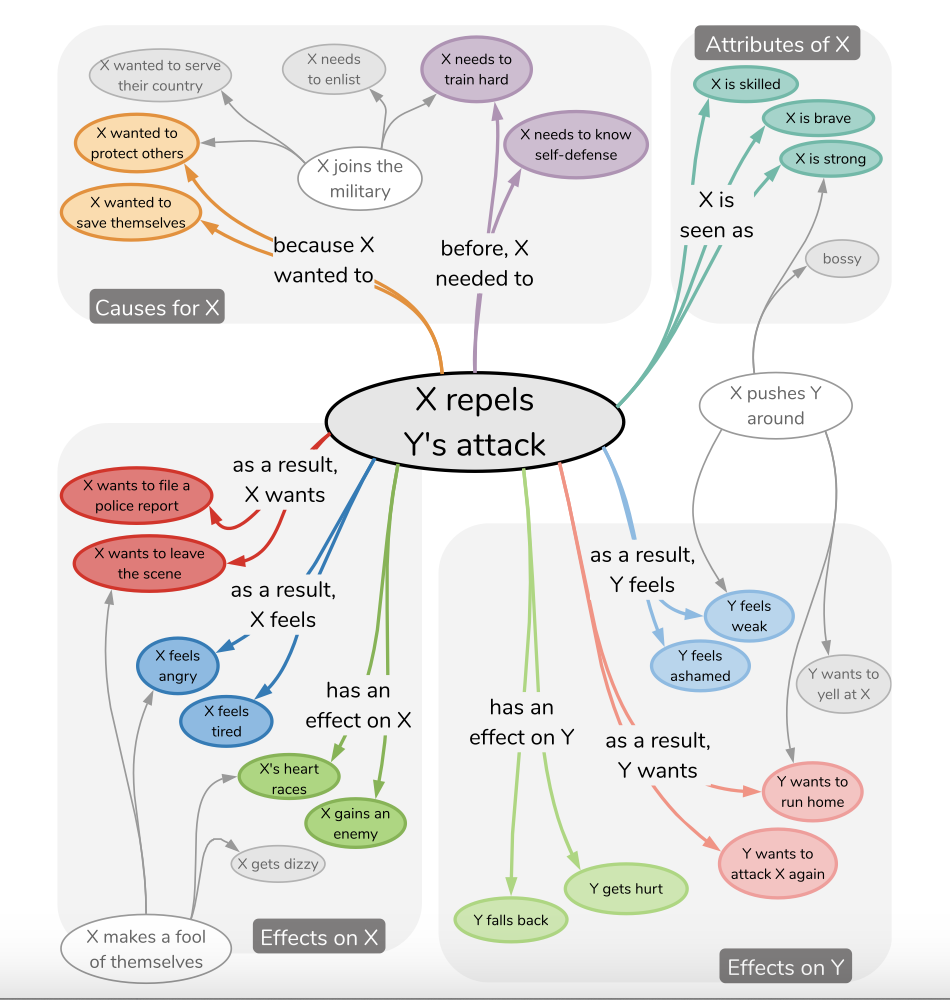

El razonamiento diario de sentido común en la vida se puede obtener a través de algunas relaciones de conocimiento de inferencia densa, como se muestra en la figura a continuación:

La Universidad de Waseda etiquetó un conjunto de datos NLP-WaskaSa/Comet-Atomic-JA en japonés y estudió si el modelo podría aprender inferencias de eventos de sentido común que no se habían visto antes. Exploraron los modelos GPT2 y T5 respectivamente. (Dada la frase E y la dimensión de inferencia C, el modelo genera el objetivo t = fθ (e, c).) Esto se puede lograr fácilmente con la ayuda de los métodos de modelado de problemas de aprendizaje de señales de hoy.

El enfoque de este proyecto es traducir su corpus al inglés y el chino, y capacitar al modelo de estilo T5 para verificar la adaptabilidad del aprendizaje rápido para lidiar con tales problemas en inglés y chino.

Ejemplo de estructura json

{ 'event': {'event': 'Xがパチンコ屋へ行く', 'mental_state': 'Xがパチンコ屋へ行く' },

'inference': {'event': {'before': ['Xが小遣いをもらう',

'Xがパチンコで勝つ',

'Xが金を用意する',

'Xがギャンブル依存症だと自覚する',

'Xが車を運転する',

'Xが金を稼ぐ',

'Xが金を持っている',

'Xが時間的余裕を持つ'],

'after': ['Xが負ける']},

'mental_state': {'before': ['時間をつぶしたい',

'ギャンブルがしたい',

'何か面白いことないかな',

'時間つぶしだ',

'暇だ',

'お金が欲しい',

'お金を儲ける',

'ストレス発散したい'],

'after': ['お金を失う',

'お金がなくなった',

'お金をたくさん使う',

'もう少ししたら帰る',

'お金が減る',

'また負けた',

'当たりそうだ',

'勝ったら嬉しい',

'負けて帰ってくる',

'お金がなくなる']}}} Ejemplo de estructura json

{ 'en_event': {'event': 'X is going to the pachinko parlor',

'mental_state': 'X is going to the pachinko parlor' },

'en_inference': {'event': {'before': ['X gets an allowance',

'X wins at pachinko.',

'X gets the money.',

'Realize X has a gambling problem',

'X drives a car',

'X makes money',

'X has money',

'X has time to spare'],

'after': ['X will lose']},

'mental_state': {'before': ['X wants to kill time',

'X wants to gamble',

'I need something fun to do',

'X is killing time',

" I'm not busy " ,

'I want money',

'Make some money',

'I want to relieve stress'],

'after': ['Lose money',

'Money is running out',

'Spend a lot of money',

" I'll be home in a little while " ,

'X will have less money',

'I lost again.',

" I think I'm going to win. " ,

" I'll be happy if I win " ,

'X comes home defeated',

'X runs out of money']}}} Ejemplo de estructura json

{ 'zh_event': {'event': 'X要去柏青哥店。', 'mental_state': 'X要去柏青哥店。' },

'zh_inference': {'event': {'before': ['X得到一笔津贴',

'X在弹子机上赢了。',

'X拿到钱',

'X意识到自己有赌博问题',

'X驾驶汽车',

'X 挣钱',

'X有钱了',

'X有时间'],

'after': ['X输了一场比赛']},

'mental_state': {'before': ['X想打发时间',

'X想赌博',

'我需要一些有趣的事情来做',

'X在打发时间',

'我不忙。',

'我想要钱',

'赚点钱',

'我想缓解压力'],

'after': ['失去了金钱。',

'我已经没有钱了',

'我花了很多钱',

'我一会儿就回家了',

'X有更少的钱',

'我又输了。',

'我想我要赢了。',

'如果我赢了,我会很高兴。',

'X败兴而归',

'X钱用完了']}}} Atingué modelos basados en T5 y basados en T5 en inglés y chino (con la ayuda de PEFT) en el gráfico que construí.

Se puede ver más información y ejemplos sobre Lora en https://github.com/svjack/controllora-chinese, una aplicación ControlNet basada en Lora en el dominio del modelo de difusión estable para controlar la salida de imagen a través de Controlnet basada en Lora.

pip install -r requirements.txtModelos disponibles en Huggingface:

| Nombre | Enlace del modelo Huggingface | Enlace espacial de Huggingface |

|---|---|---|

| ¿Cometa inglés atómico? | https://huggingface.co/svjack/comet-atomic-en | https://huggingface.co/spaces/svjack/english-comet-atomic |

| Cometa chino atómico | https://huggingface.co/svjack/comet-atomic-zh | https://huggingface.co/spaces/svjack/chinese-comet-atomic |

| Cometa china Atómica T5 lora | https://huggingface.co/svjack/mt0-large-comet-atomic-zh-peft-early-cpu | https://huggingface.co/spaces/svjack/chinese-comet-atomic-t5-large-lora |

Puede usarlo en línea o basado en tarjetas modelo.

svjack - [email protected] - [email protected]

Enlace del proyecto: https: //github.com/svjack/comet-atomic-en-zh