中國人工智能公司DeepSeek在其“開源週”的第三天宣布推出了一款名為DeepGEMM的開源庫,該庫支持FP8通用矩陣乘法(GEMM)。這一工具專為密集型和混合專家(MoE)矩陣運算設計,旨在為DeepSeek V3和R1模型的訓練與推理提供強大的支持。官方消息通過X平台發布後,迅速引發了技術社區的廣泛關注和熱烈討論。

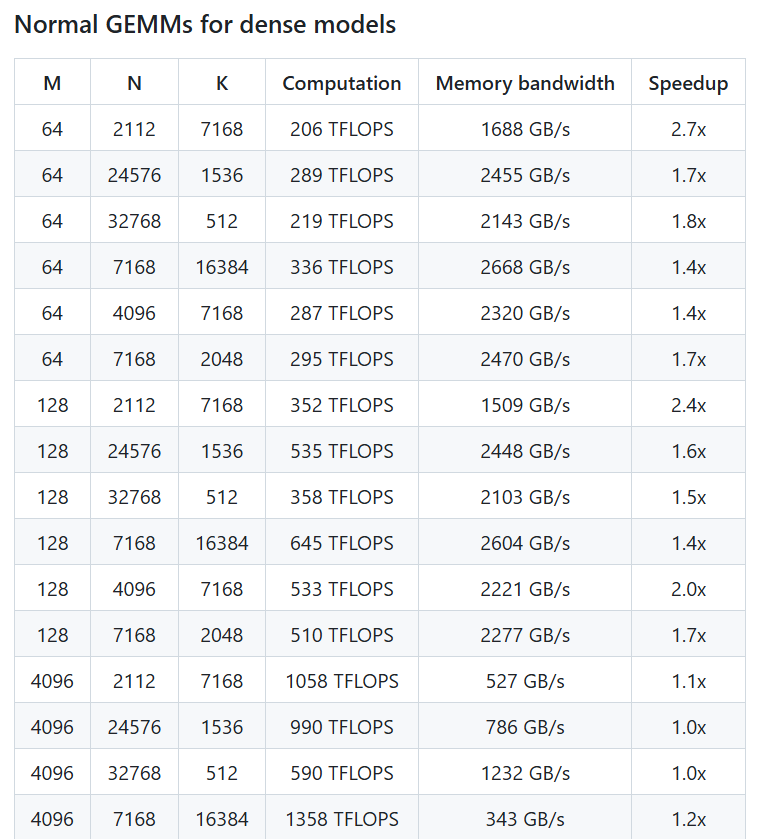

根據DeepSeek官方賬號發布的帖子,DeepGEMM在NVIDIA Hopper GPU上能夠實現高達1350+ TFLOPS的FP8計算性能。儘管其核心邏輯僅包含約300行代碼,但該庫在大多數矩陣尺寸上的表現甚至超越了經過專家調優的內核,展現了極高的效率和簡潔性。 DeepGEMM無需複雜的依賴,採用即時編譯(Just-In-Time)技術,支持密集佈局和兩種MoE佈局,設計上“像教程一樣乾淨”,便於開發者學習和使用。

X用戶@TechBitDaily評論道:“DeepGEMM的發布是DeepSeek開源週的一大亮點,其FP8性能和簡潔設計令人印象深刻。”另一位用戶@AIObserverCN則指出,該庫在支持MoE模型的高效訓練方面具有顯著優勢,可能會推動AI社區在Hopper架構上的進一步創新。

作為開源週的一部分,DeepGEMM的發布延續了DeepSeek推動AI技術透明化和社區協作的承諾。此前,該公司已在開源週的前兩天發布了FlashMLA和DeepEP工具,分別聚焦於快速語言模型架構和專家並行通信。此次DeepGEMM的亮相,進一步展示了DeepSeek在AI基礎設施建設上的技術實力。業內人士認為,這款庫不僅將提升DeepSeek自家模型的性能,也為全球開發者提供了一個高效、易用的矩陣運算工具,未來應用前景廣闊。用戶現可通過GitHub獲取DeepGEMM,探索其在AI訓練與推理中的潛力。

項目地址:https://github.com/deepseek-ai/DeepGEMM