في اليوم الثالث من "الأسبوع المفتوح المصدر" ، أعلنت شركة الذكاء الاصطناعي الصينية ديبسيك عن مكتبة مفتوحة المصدر تسمى DeepGemm ، والتي تدعم مضاعفة المصفوفة العالمية FP8 (GEMM). تم تصميم هذه الأداة لعمليات مصفوفة الخبراء المكثفة والهجينة (MOE) ، وتم تصميم هذه الأداة لتوفير دعم قوي للتدريب والاستدلال لنماذج Deepseek V3 و R1. بعد إصدار الأخبار الرسمية من خلال منصة X ، أثارت اهتمامًا واسع النطاق والمناقشات الساخنة من مجتمع التكنولوجيا.

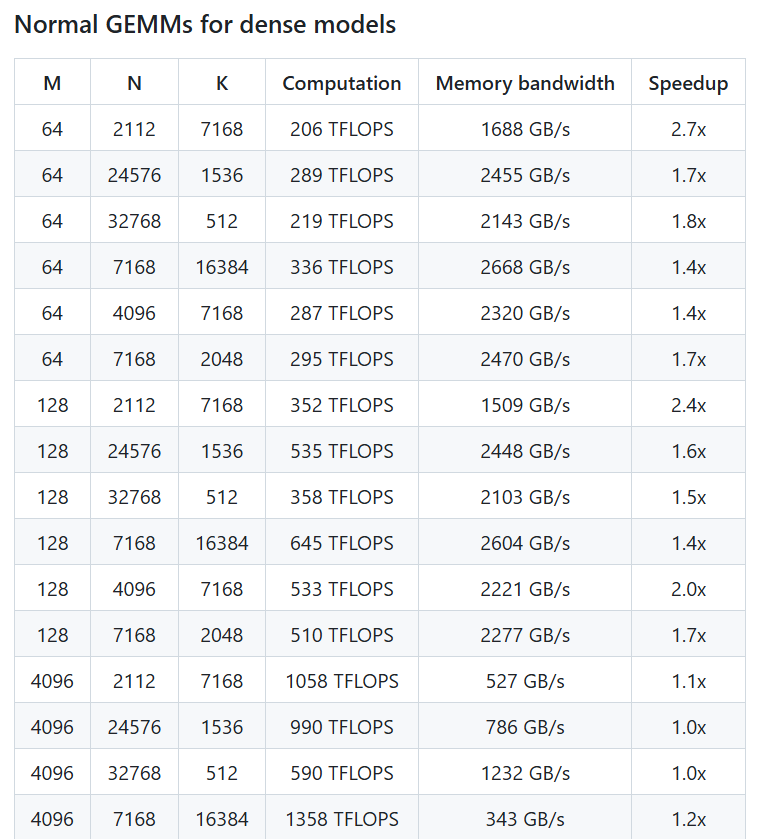

وفقًا لنشر نشره حساب Deepseek الرسمي ، يمكن لـ DEPEGEMM تحقيق أداء حوسبة FP8 يصل إلى 1350 TFLOPS على NVIDIA HOPPER GPU. على الرغم من أن منطقها الأساسي يحتوي على حوالي 300 سطر من التعليمات البرمجية ، إلا أن المكتبة تؤدي حتى إلى ما وراء النواة التي تم ضبطها بخبرة على معظم أحجام المصفوفة ، مما يدل على كفاءة وبساطة عالية للغاية. لا يتطلب DeepGemm تبعيات معقدة ، ويعتمد التكنولوجيا في الوقت المناسب ، ويدعم تخطيطًا مكثفًا وتخطيطين MOE. إنه مصمم ليكون "نظيفًا مثل البرنامج التعليمي" ويسهل على المطورين التعلم والاستخدام.

علق usechbitdaily userdaily: "إن إطلاق DEPEGEMM هو تسليط الضوء على أسبوع Deepseek Open Source ، مع أداء FP8 المثير للإعجاب وتصميم البساطة." أشار مستخدم آخر raiobservercn إلى أن المكتبة لديها مزايا كبيرة في دعم تدريب فعال لنماذج وزارة الواحدة وقد تعزز المزيد من الابتكار في مجتمع الذكاء الاصطناعى في الهندسة المعمارية.

كجزء من أسبوع المصدر المفتوح ، يواصل إطلاق DeepGemm التزام Deepseek بتعزيز الشفافية في تكنولوجيا الذكاء الاصطناعي والتعاون المجتمعي. في السابق ، كانت الشركة قد أصدرت Flashmla و DeepeP Tools قبل يومين من أسبوع مفتوح المصدر ، مع التركيز على بنية نموذج اللغة السريعة والاتصالات المتوازية الخبراء ، على التوالي. يوضح ظهور DeepGemm لأول مرة القوة التقنية لـ Deepseek في بناء البنية التحتية لمنظمة العفو الدولية. يعتقد المطلعون على الصناعة أن هذه المكتبة لن تعمل فقط على تحسين أداء نموذج Deepseek الخاص ، ولكن أيضًا يوفر للمطورين العالميين أداة حوسبة مصفوفة فعالة وسهلة الاستخدام ، مع آفاق تطبيقات مستقبلية عريضة. يمكن للمستخدمين الآن الحصول على DeepGemm من خلال Github لاستكشاف إمكاناته في تدريب الذكاء الاصطناعي والتفكير.

عنوان المشروع: https://github.com/deepeek-ai/deepgemm