ICLR2023纸的代码和数据集“知识图上的多模式类比推理”

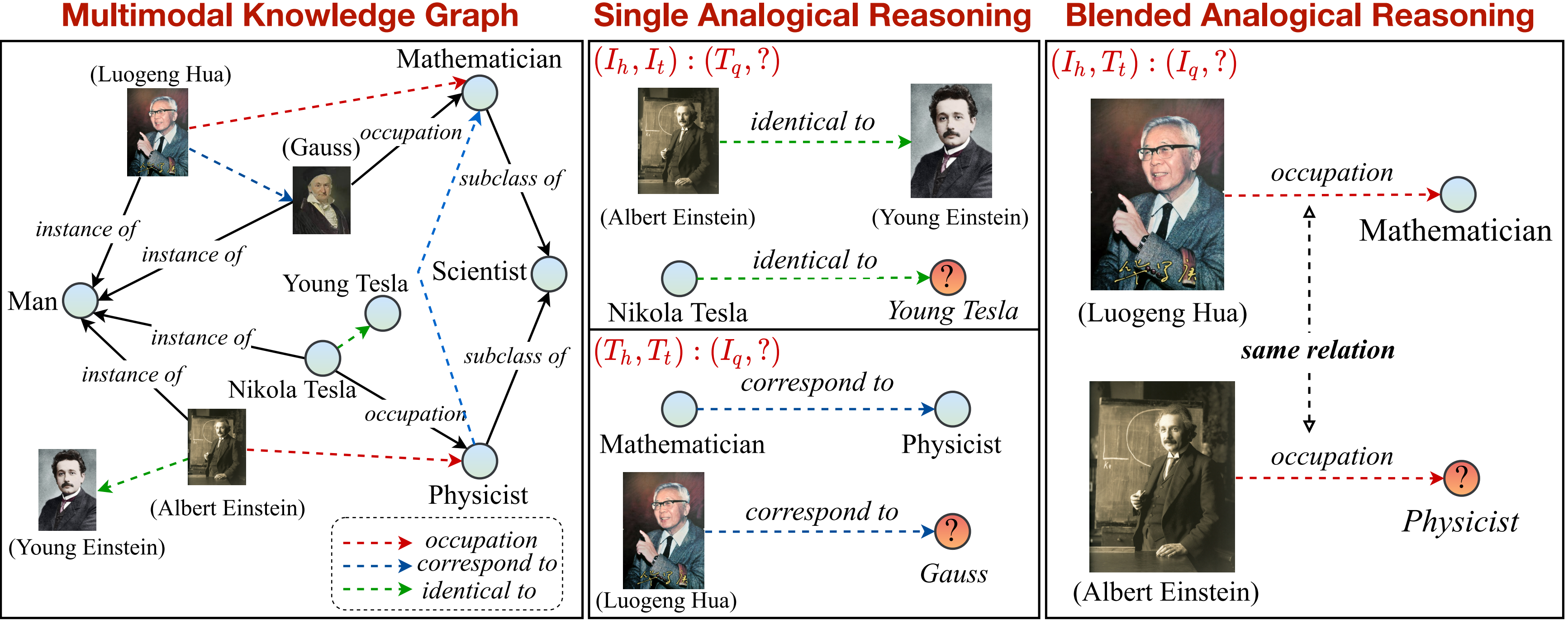

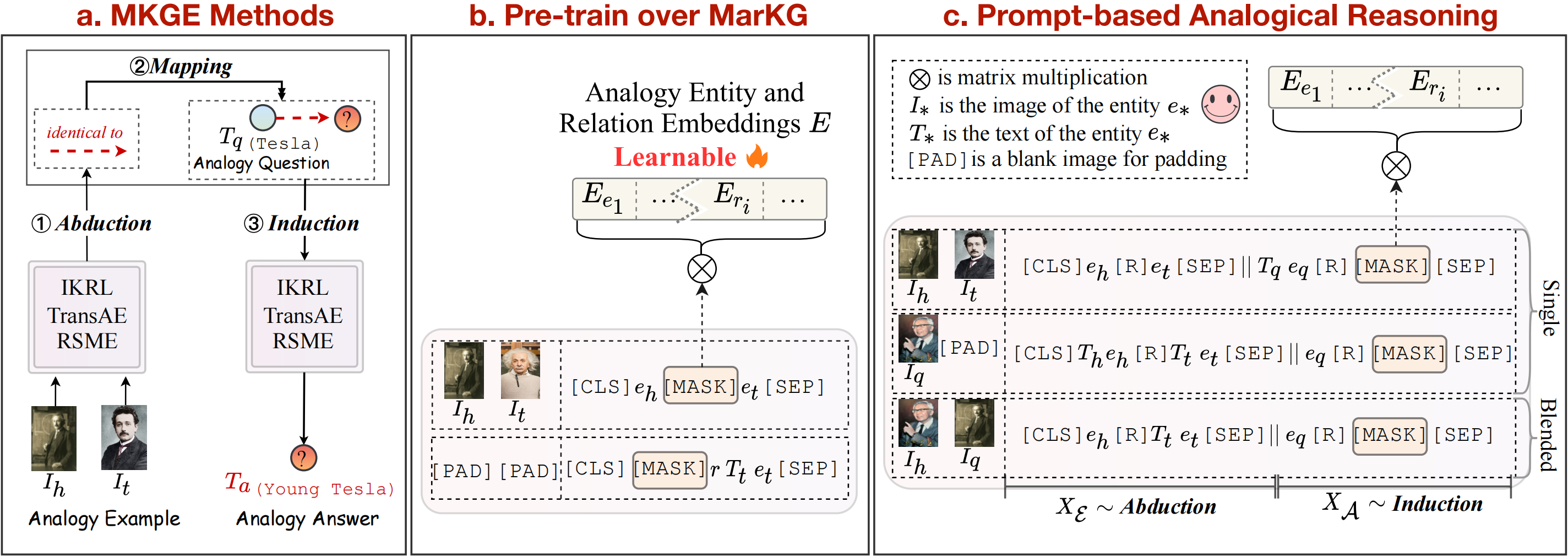

在这项工作中,我们提出了一项关于知识图的多模式类似推理的新任务。多模式类似推理任务的概述可以看如下:

我们提供一个知识图,以支持并将任务进一步分为单个和混合模式。请注意,用虚线标记的关系(

pip install -r requirements.txt

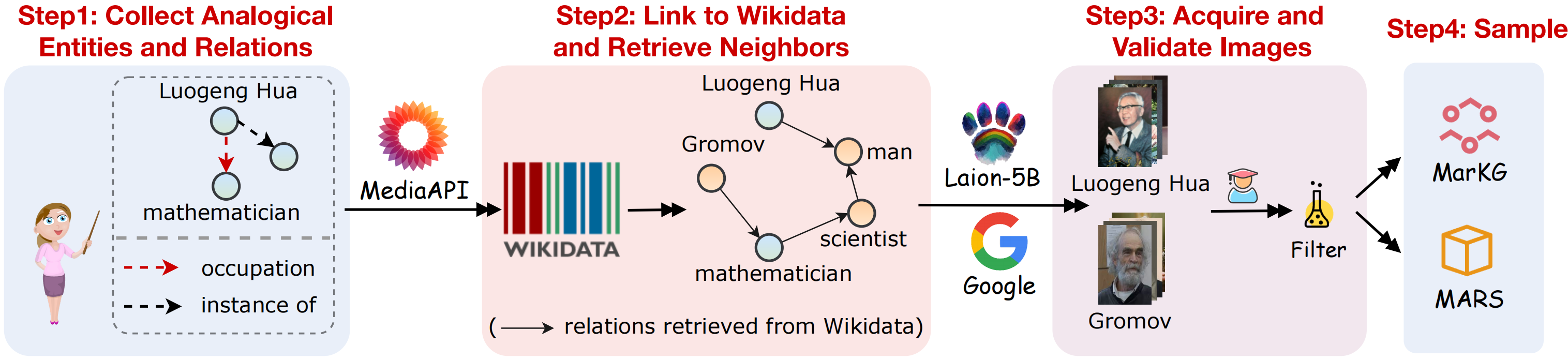

为了支持多模式类似推理任务,我们收集了多模式知识图数据集标记和多模式类似推理数据集火星。数据收集的视觉轮廓如下图所示:

我们收集数据集以下以下步骤:

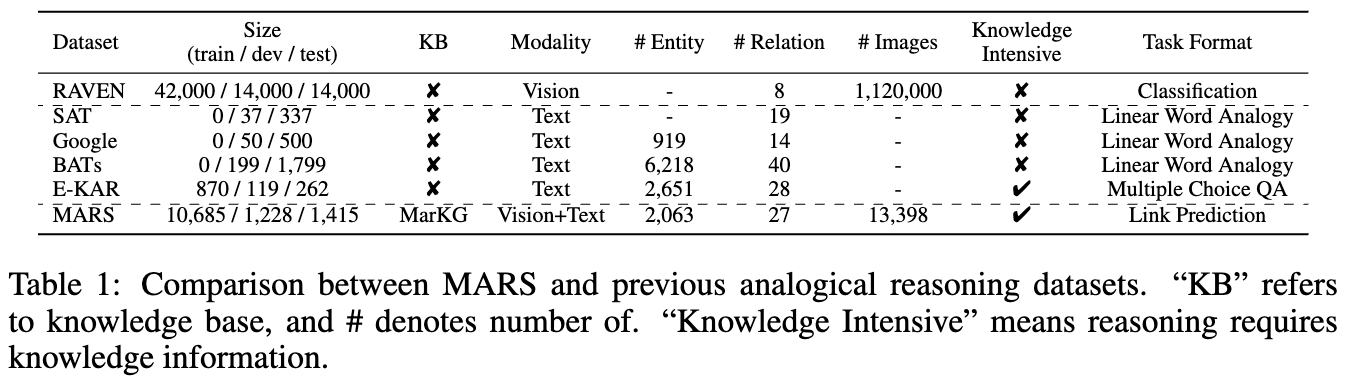

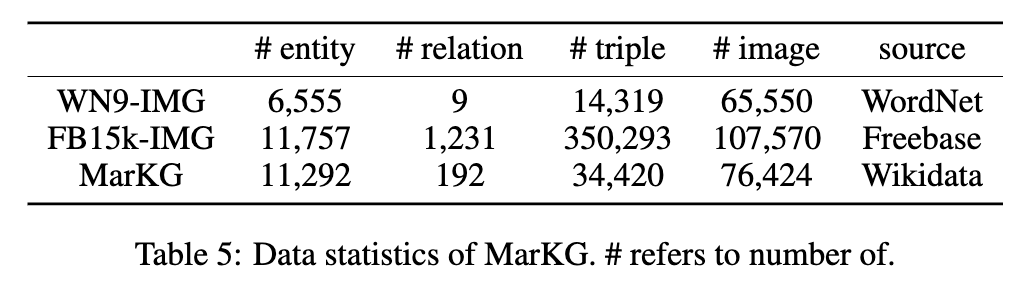

两个数据集的统计数据如下图所示:

我们将文本数据放在MarT/dataset/下方,可以通过Google Drive或Baidu Pan(Terabox)(代码:7HOC)下载图像数据,并放置在MarT/dataset/MARS/images上。请参阅MART以获取详细信息。

文件的预期结构是:

MKG_Analogy

|-- M-KGE # multimodal knowledge representation methods

| |-- IKRL_TransAE

| |-- RSME

|-- MarT

| |-- data # data process functions

| |-- dataset

| | |-- MarKG # knowledge graph data

| | |-- MARS # analogical reasoning data

| |-- lit_models # pytorch_lightning models

| |-- models # source code of models

| |-- scripts # running scripts

| |-- tools # tool function

| |-- main.py # main function

|-- resources # image resources

|-- requirements.txt

|-- README.md

我们选择一些基线方法来建立火星上的初始基准结果,包括多模式知识表示方法(IKRL,Transae,RSME),预训练的视觉模型(Visualbert,Vilbert,Vilbert,Vilt,Flava)和多模式知识图形完成方法(MKGGEFFORMER)。

此外,我们遵循结构映射理论,以将暂停映射诱导视为多模式知识表示方法的显式管道步骤。至于基于变压器的方法,我们进一步提出了一个新型框架,该框架将这三个步骤隐含结合起来,以完成多模式的类似推理任务端到端,可以避免在类似推理期间避免错误传播。基线方法的概述可以在上图中看到。

我们通过Transae框架重现IKRL模型,以评估IKRL,以下代码运行:

cd M-KGE/IKRL_TransAE

python IKRL.py您可以分别在IKRL.py中修改finetune和analogy参数,从而选择预训练/微调和Transe/类比。

要在IKRL上评估,请按照代码运行:

cd M-KGE/IKRL_TransAE

python TransAE.py您可以分别在TransAE.py中修改finetune和analogy参数,从而选择预训练/微调和TRANSE/类比。

我们仅提供RSME的一部分数据。要在RSME上进行评估,您需要通过以下脚本生成完整数据:

cd M-KGE/RSME

python image_encoder.py # -> analogy_vit_best_img_vec.pickle

python utils.py # -> img_vec_id_analogy_vit.pickle首先,预先培训模型超过Markg:

bash run.sh然后修改--checkpoint参数,然后在火星上微调模型:

bash run_finetune.sh有关上述模型的更多培训详细信息可能是指他们的官方存储库。

我们利用MART框架用于基于变压器的模型。 Mart包含两个步骤:预训练和微调。

为了快速训练模型,我们使用此脚本预先对图像数据进行编码(请注意,编码数据的大小约为7GB):

cd MarT

python tools/encode_images_data.py以Mkgformer为例,首先通过以下脚本预先培训模型:

bash scripts/run_pretrain_mkgformer.sh预训练后,通过以下脚本微调模型:

bash scripts/run_finetune_mkgformer.sh ?在此Google驱动器上的微调和预训练短语中,我们提供了基于变压器的模型的最佳检查点。下载它们并在scripts/run_finetune_xxx.sh中添加--only_test进行测试实验。

如果您使用或扩展我们的工作,请如下引用纸张:

@inproceedings {

zhang2023multimodal,

title = { Multimodal Analogical Reasoning over Knowledge Graphs } ,

author = { Ningyu Zhang and Lei Li and Xiang Chen and Xiaozhuan Liang and Shumin Deng and Huajun Chen } ,

booktitle = { The Eleventh International Conference on Learning Representations } ,

year = { 2023 } ,

url = { https://openreview.net/forum?id=NRHajbzg8y0P }

}