HeartGPT

1.0.0

心脏时序数据的可解释的预训练的变压器:链接到纸张

在此存储库中,有训练有素的模型文件,包括预先训练的模型ECGPT和PPGPT,以及用于Arrythmias和Beat检测的模型。也有用于生成,可解释性和实施微调模型的GUIS。

在这项工作中,我们将生成的预训练的变压器(GPT)框架应用于定期心脏时序数据,以创建两个预训练的通用心脏模型,即PPG-PT和ECG-PT。这些模型能够针对许多不同的心脏相关任务进行微调,例如筛查芳香族。这项工作的一个重大强调是表明预培训的模型是完全可解释的,并且这种可解释性延续到微调的任务中。预先训练的变压器可以通过以下方式解释 -

总体注意力图表明,该模型的重点是先前心脏周期中的相似点,以进行预测并逐渐在更深的层中扩大其注意力:

具有相同值的令牌(相当于同音词的时间序列),在ECG和PPG周期中不同的不同点上发生的代币根据其在心脏周期中的位置在高维空间中单独的簇形成单独的簇,因为它们通过变压器块的其他代币进行了更新。

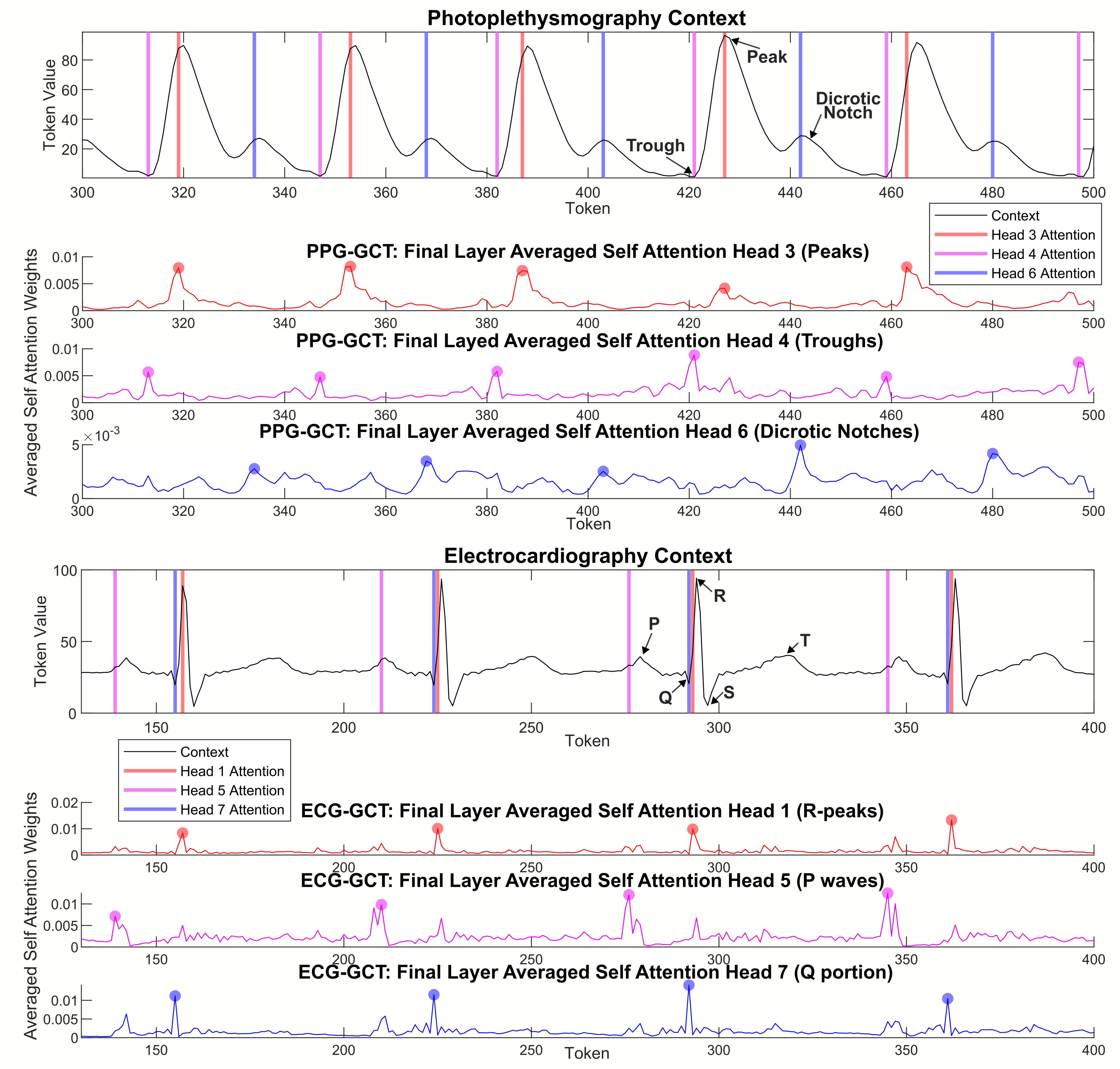

个人注意力负责人对特定的生理相关特征做出了反应,例如PPG中的双子档和ECG中的P波。

这项工作的灵感来自Andrej Karpathy创建的教程。

heart_pt_generate.py是一个Python脚本,在ECG或PPG的示例上下文中加载,并使用适当的模型来生成未来的时间步骤。

预训练的Pytorch模型文件位于ZIP文件夹( ECGPT_560K_ITERS和PPGPT_500K_ITERS )中。

一个示例改编的微调模型定义在“ heart_pt_finetune.py”中提供,以及如何冷冻不同的层。